Proximal policy optimization

Deep Reinforcement Learning in Python

Timothée Carayol

Principal Machine Learning Engineer, Komment

A2C

- A2C policy-updates:

- Gebaseerd op volatiele schattingen

- Kunnen groot en instabiel zijn

- Kan prestaties schaden

PPO

- PPO begrenst de grootte van elke policy-update

- Verbetert stabiliteit

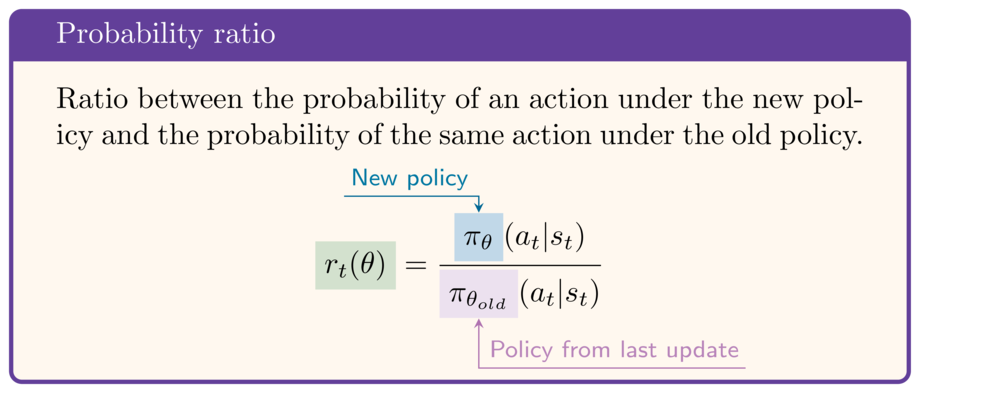

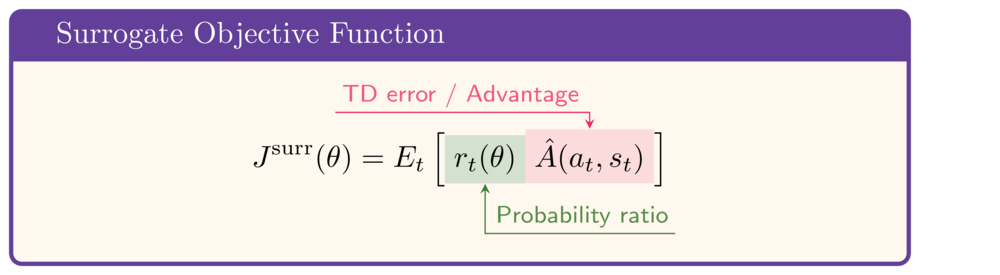

De kansratio

- Belangrijkste vernieuwing in PPO: nieuwe doelfunctie

- Kernidee:

- Hoeveel waarschijnlijker is actie $a_t$ met $\theta$ dan met $\theta_{old}$?

ratio = action_log_prob.exp() / old_action_log_prob.exp().detach()# Of gelijkwaardig ratio = torch.exp(action_log_prob - old_action_log_prob.detach())

detachde noemer om gradiënten niet door te geven

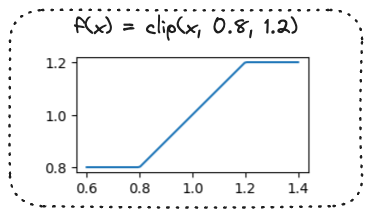

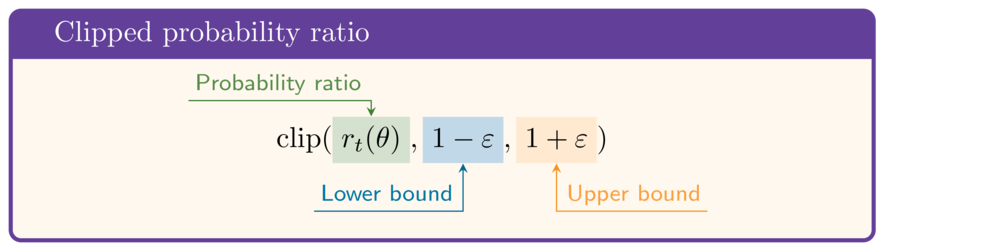

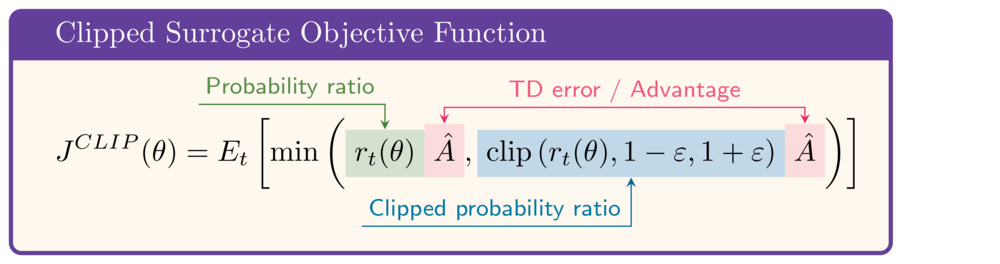

De kansratio clippen

- Clip-functie:

clipped_ratio = torch.clamp(ratio,

1-epsilon,

1+epsilon)

De functie calculate_ratios

def calculate_ratios(action_log_prob, action_log_prob_old, epsilon):prob = action_log_prob.exp() prob_old = action_log_prob_old.exp() prob_old_detached = prob_old.detach() ratio = prob / prob_old_detached clipped_ratio = torch.clamp(ratio, 1-epsilon, 1+epsilon)return (ratio, clipped_ratio)

Voorbeeld met epsilon = .2:Ratio: tensor(1.25)Afgeklemde ratio: tensor(1.20)

De PPO-doelfunctie

surr1 = ratio * td_error.detach()surr2 = clipped_ratio * td_error.detach()objective = torch.min(surr1, surr2)

- Surrogaat met afgeklemde ratio:

$$\mathrm{clip}(r_t(\theta),1-\varepsilon,1+\varepsilon)\hat{A}$$

- PPO-doelfunctie met clipping:

- Stabieler dan A2C

PPO-verlies berekenen

def calculate_losses(critic_network,

action_log_prob,

action_log_prob_old,

reward, state, next_state,

done

):

# bereken TD-fout (zoals A2C)

value = critic_network(state)

next_value = critic_network(next_state)

td_target = (reward +

gamma * next_value * (1-done))

td_error = td_target - value

...

... ratio, clipped_ratio = calculate_ratios(action_log_prob, action_log_prob_old, epsilon)surr1 = ratio * td_error.detach()surr2 = clipped_ratio * td_error.detach()objective = torch.min(surr1, surr2)actor_loss = -objectivecritic_loss = td_error ** 2 return actor_loss, critic_loss

Laten we oefenen!

Deep Reinforcement Learning in Python