Upserts batchen

Vector-databases voor embeddings met Pinecone

James Chapman

Curriculum Manager, DataCamp

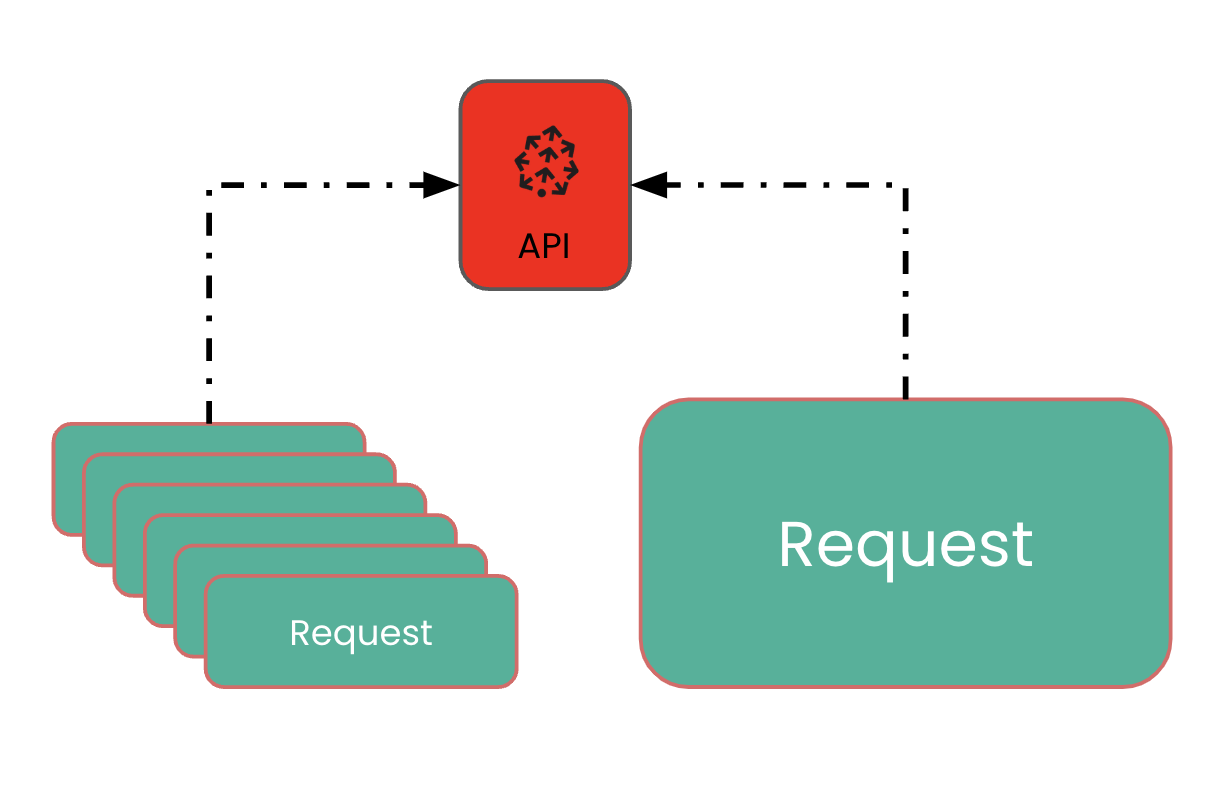

Beperkingen bij upserts

- Snelheid van requests

- Grootte van requests

- Batching: requests opsplitsen in kleine chunks

1 https://docs.pinecone.io/reference/quotas-and-limits#rate-limits

Een chunk-functie definiëren

def chunks(iterable, batch_size=100):it = iter(iterable)chunk = tuple(itertools.islice(it, batch_size))while chunk:yield chunkchunk = tuple(itertools.islice(it, batch_size))

Sequentieel batchen

- Requests splitsen en sequentieel één-voor-één versturen

pc.Pinecone(api_key="YOUR API KEY") index = pc.Index('datacamp-index')for chunk in chunks(vectors): index.upsert(vectors=chunk)

Voordelen:

- Lost snelheids- en groottelimieten op

Nadelen:

- Erg traag!

Parallel batchen

- Requests splitsen en parallel versturen

pc = Pinecone(api_key="YOUR_API_KEY", pool_threads=30)with pc.Index('datacamp-index', pool_threads=30) as index:async_results = [index.upsert(vectors=chunk, async_req=True) for chunk in chunks(vectors, batch_size=100)][async_result.get() for async_result in async_results]

Laten we oefenen!

Vector-databases voor embeddings met Pinecone