Informed search: van grof naar fijn

Hyperparameter Tuning in Python

Alex Scriven

Data Scientist

Informed vs. uninformed search

Tot nu toe deden we uninformed search:

Uninformed search: elke iteratie van hyperparametertuning leert niet van eerdere iteraties.

Zo kunnen we paralleliseren. Maar is dit efficiënt?

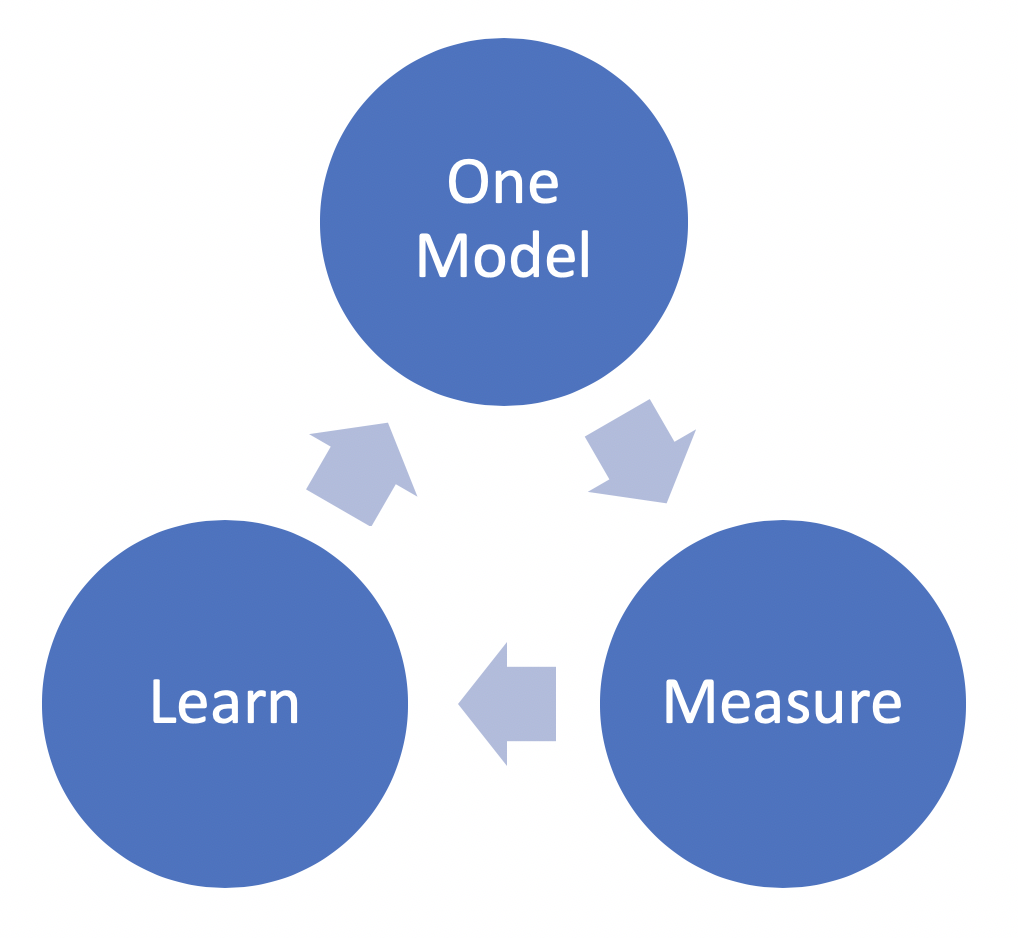

Informed vs. uninformed

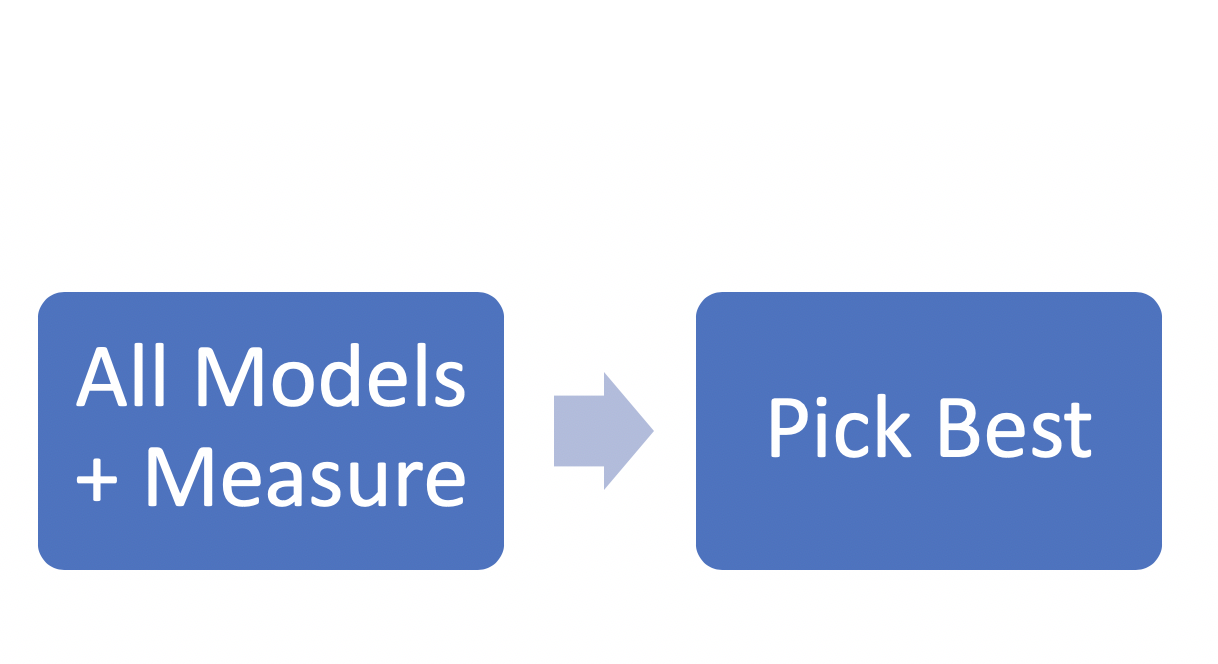

Het proces tot nu toe:

Een alternatieve manier:

Van grof naar fijn tunen

Een basisaanpak voor informed search:

Begin grof en willekeurig en verfijn iteratief.

De stappen:

- Random search

- Vind veelbelovende gebieden

- Grid search in de kleinere regio

- Ga door tot de optimale score is behaald

Je kunt (3) vervangen door extra random searches vóór de grid search

Waarom grof-naar-fijn?

Voordelen van grof-naar-fijn tunen:

- Benut de pluspunten van grid en random search.

- Breed zoeken in het begin

- Dieper zoeken zodra je weet waar het goed kan zijn

- Beter gebruik van tijd en rekenkracht, dus sneller itereren

Geen tijd verspillen aan zoekruimtes met slechte resultaten!

Let op: Dit is informed op batches, niet op één model

Aanpak: van grof naar fijn

Neem dit voorbeeld met deze hyperparameterranges:

max_depth_listtussen 1 en 65min_sample_listtussen 3 en 17learn_rate_list150 waarden tussen 0.01 en 150

Hoeveel mogelijke modellen hebben we?

combinations_list = [list(x) for x in product(max_depth_list, min_sample_list, learn_rate_list)]

print(len(combinations_list))

134400

Visualiseren: van grof naar fijn

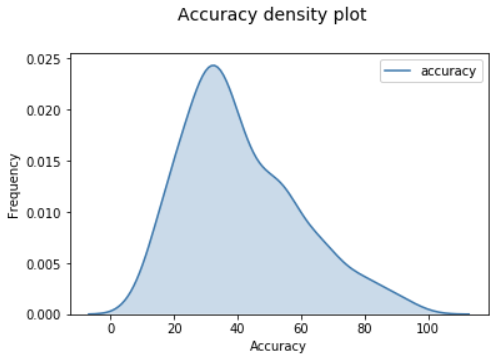

We doen een random search op 500 combinaties.

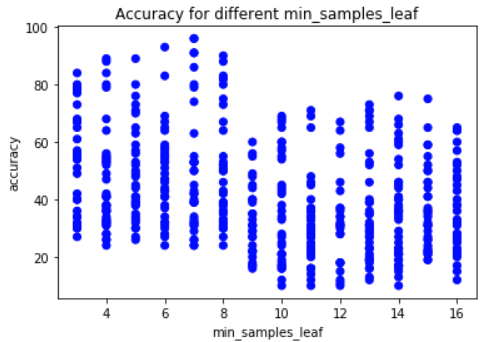

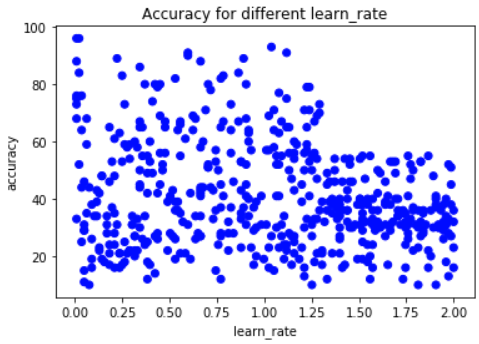

Hier plotten we de accuraciescores:

Welke modellen waren goed?

Visualiseren: van grof naar fijn

Topresultaten:

| max_depth | min_samples_leaf | learn_rate | accuracy |

|---|---|---|---|

| 10 | 7 | 0.01 | 96 |

| 19 | 7 | 0.023355705 | 96 |

| 30 | 6 | 1.038389262 | 93 |

| 27 | 7 | 1.11852349 | 91 |

| 16 | 7 | 0.597651007 | 91 |

Visualiseren: van grof naar fijn

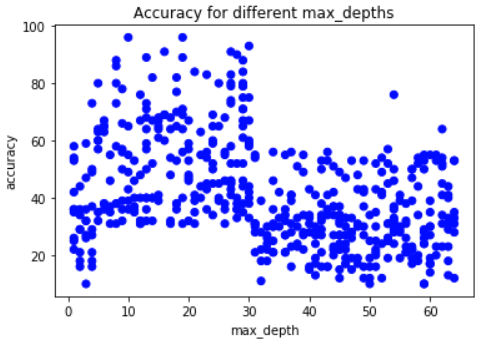

Visualiseer max_depth versus accuracyscore:

Visualiseren: van grof naar fijn

min_samples_leaf beter onder 8

learn_rate slechter boven 1.3

Volgende stappen

Wat we weten na iteratie één:

max_depthtussen 8 en 30learn_ratekleiner dan 1.3min_samples_leafmogelijk kleiner dan 8

Wat nu? Nog een random of grid search met wat we weten!

Let op: Dit was alleen bivariate analyse. Je kunt ook meerdere hyperparameters (3, 4 of meer!) in één grafiek verkennen, maar dat valt buiten deze cursus.

Laten we oefenen!

Hyperparameter Tuning in Python