Methoden voor het verzamelen van feedback van hoge kwaliteit

Reinforcement Learning from Human Feedback (RLHF)

Mina Parham

AI Engineer

Methoden voor het verzamelen van feedback van hoge kwaliteit

Methoden voor het verzamelen van feedback van hoge kwaliteit

Paargewijze vergelijkingen

- Kiezen tussen twee opties:

- Voordelen: simpel, intuïtief, minder bias

- Uitdagingen: minder informatie per label

- Voorbeeld: Film A vs. Film B: "Welke heeft je voorkeur?

Paargewijze vergelijkingen

def evaluate_responses(responses_A, responses_B):

wins_A, wins_B = 0, 0

for (response_A, score_A), (response_B, score_B) in zip(responses_A, responses_B):

if score_A > score_B:

wins_A += 1

else:

wins_B += 1

success_rate_A = (wins_A / len(responses_A)) * 100

success_rate_B = (wins_B / len(responses_B)) * 100

return success_rate_A, success_rate_B

Beoordelingen

Een score toekennen op een schaal:

Voordelen: levert gedetailleerdere feedback op

- Uitdagingen: gevoelig voor bias, inconsistente schalen

- Voorbeeld:

Film A: 4/5 Film B: 3/5

Psychologische factoren

- Cognitieve biases:

- Framing-effect: hoe een vraag is geformuleerd beïnvloedt antwoorden

- Serieel posititie-effect: de volgorde van opties beïnvloedt keuzes

- Anchoring: eerdere info kleurt huidige beslissingen

Richtlijnen voor het verzamelen van feedback van hoge kwaliteit

- Cognitieve belasting: vermoeide gebruikers, inconsistente feedback

- Formuleer vragen zorgvuldig

- Om risico's door cognitieve belasting te beperken

- Randomiseer volgorde

- Om bias door anchoring en framing te verminderen

- Verzamel diverse data

- Om ruis te beperken

Laten we oefenen!

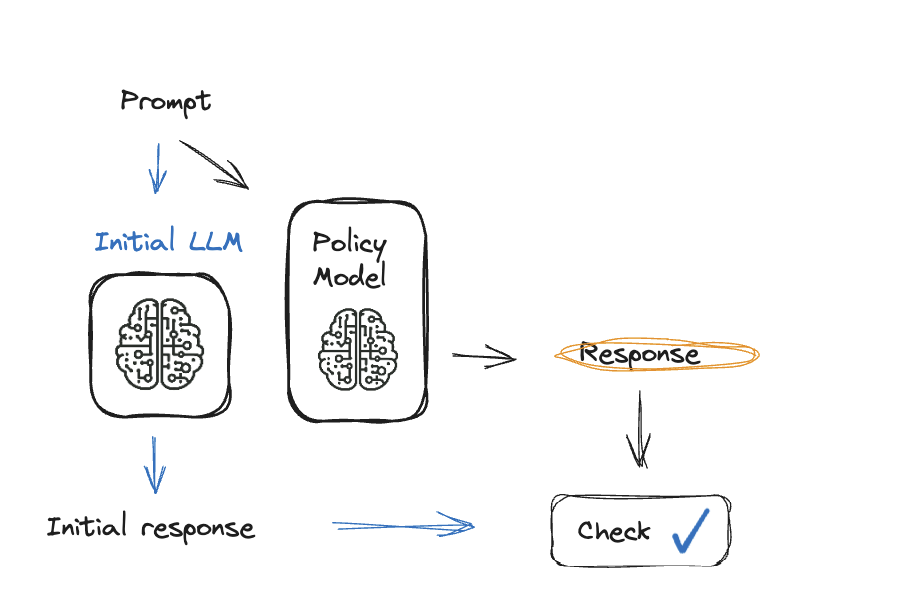

Reinforcement Learning from Human Feedback (RLHF)