Efficiënt finetunen in RLHF

Reinforcement Learning from Human Feedback (RLHF)

Mina Parham

AI Engineer

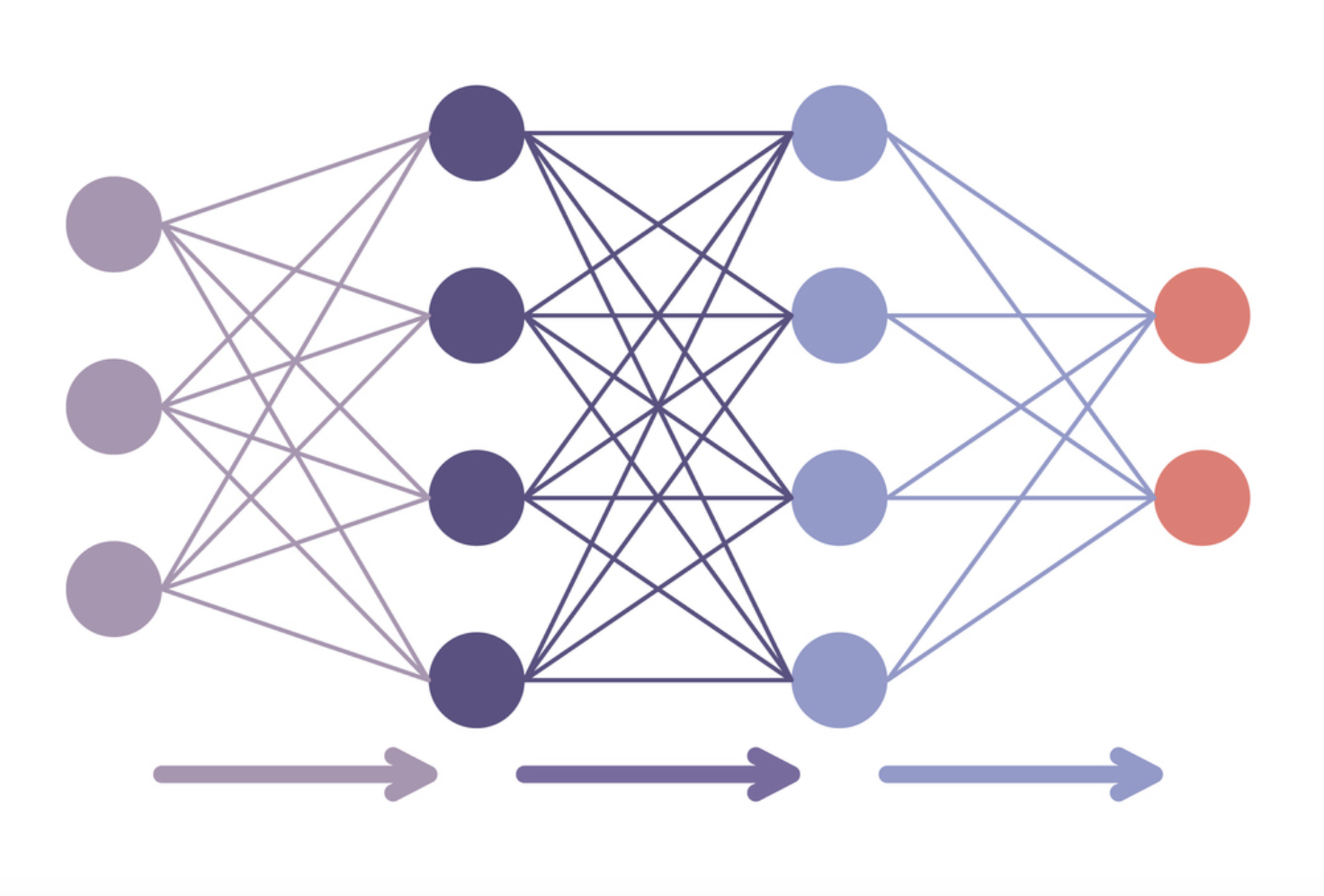

Parameter-efficiënt finetunen

- Een volledig model finetunen

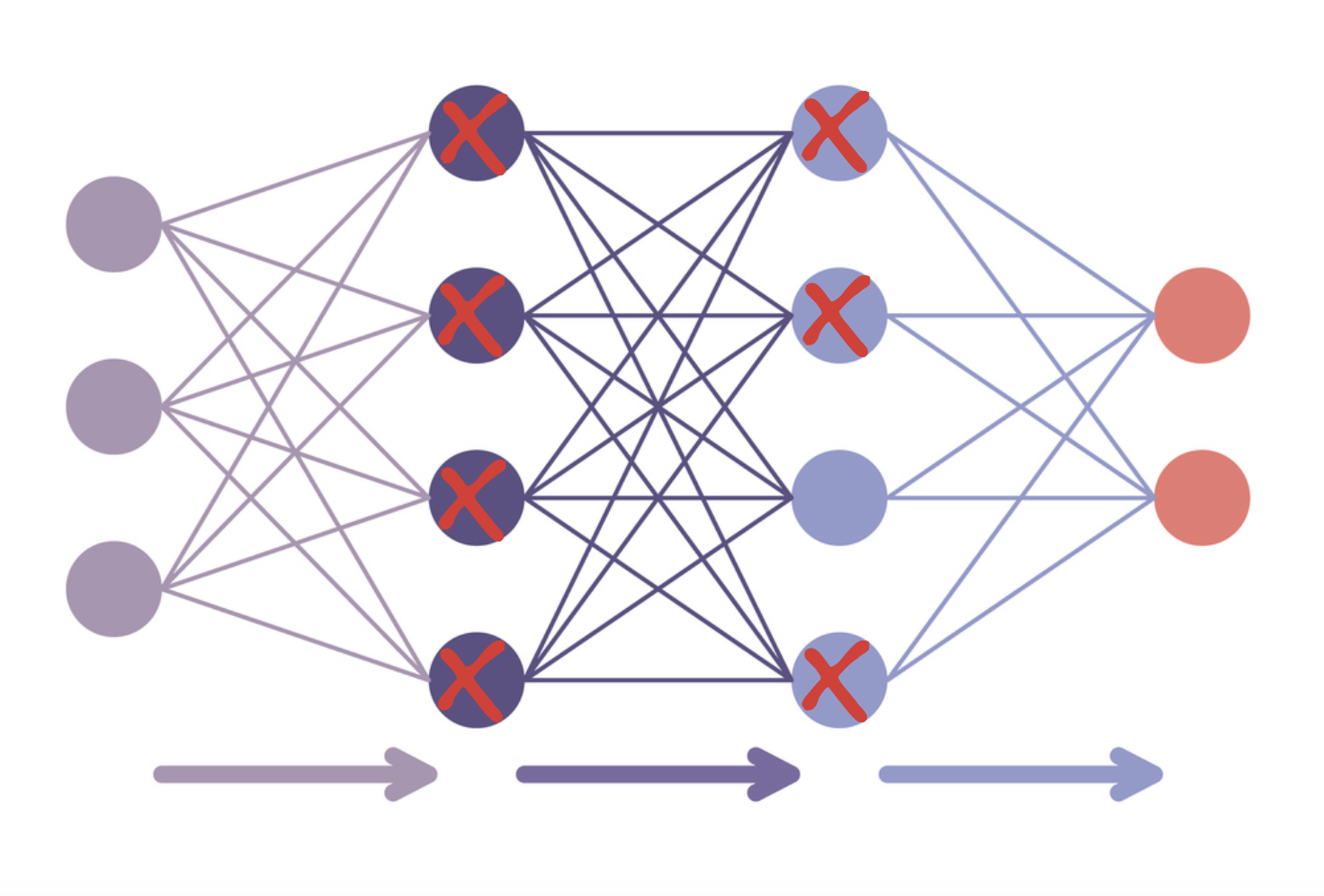

Parameter-efficiënt finetunen

- Finetunen met PEFT

- LoRA: past slechts enkele lagen aan

- Kwantisatie: verlaagt datatype-precisie

Stap 1: laad je actieve model in 8‑bit precisie

from peft import prepare_model_for_int8_trainingpretrained_model = AutoModelForCausalLM.from_pretrained( model_name, load_in_8bit=True )pretrained_model_8bit = prepare_model_for_int8_training(pretrained_model)

Stap 2: voeg extra trainbare adapters toe met peft

from peft import LoraConfig, get_peft_modelconfig = LoraConfig(r=32, # Rang van de low-rank-matriceslora_alpha=32, # Schaalfactor voor de LoRA-updateslora_dropout=0.1, # Dropoutrate voor LoRA-lagenbias="lora_only"# Alleen bias-termen updaten voor LoRA-lagen, rest blijft bevroren)lora_model = get_peft_model(pretrained_model_8bit, config) model = AutoModelForCausalLMWithValueHead.from_pretrained(lora_model)

Stap 3: gebruik één model voor referentie en actieve logits

ppo_trainer = PPOTrainer(

config, # De config die we zojuist hebben gedefinieerd

model, # Onze PPO‑model

ref_model=None,

tokenizer=tokenizer,

dataset=dataset,

data_collator=collator,

optimizer=optimizer

)

Laten we oefenen!

Reinforcement Learning from Human Feedback (RLHF)