Trainen met PPO

Reinforcement Learning from Human Feedback (RLHF)

Mina Parham

AI Engineer

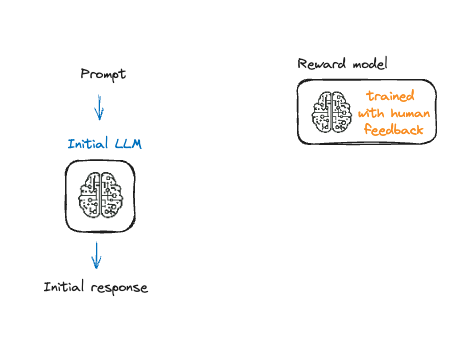

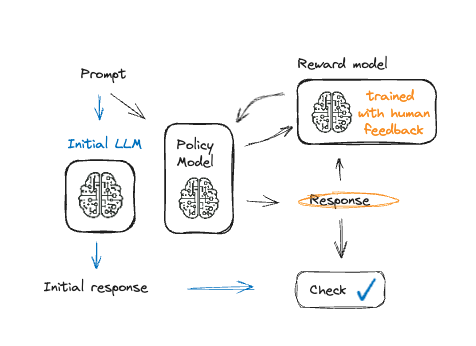

Fine-tunen met reinforcement learning

Fine-tunen met reinforcement learning

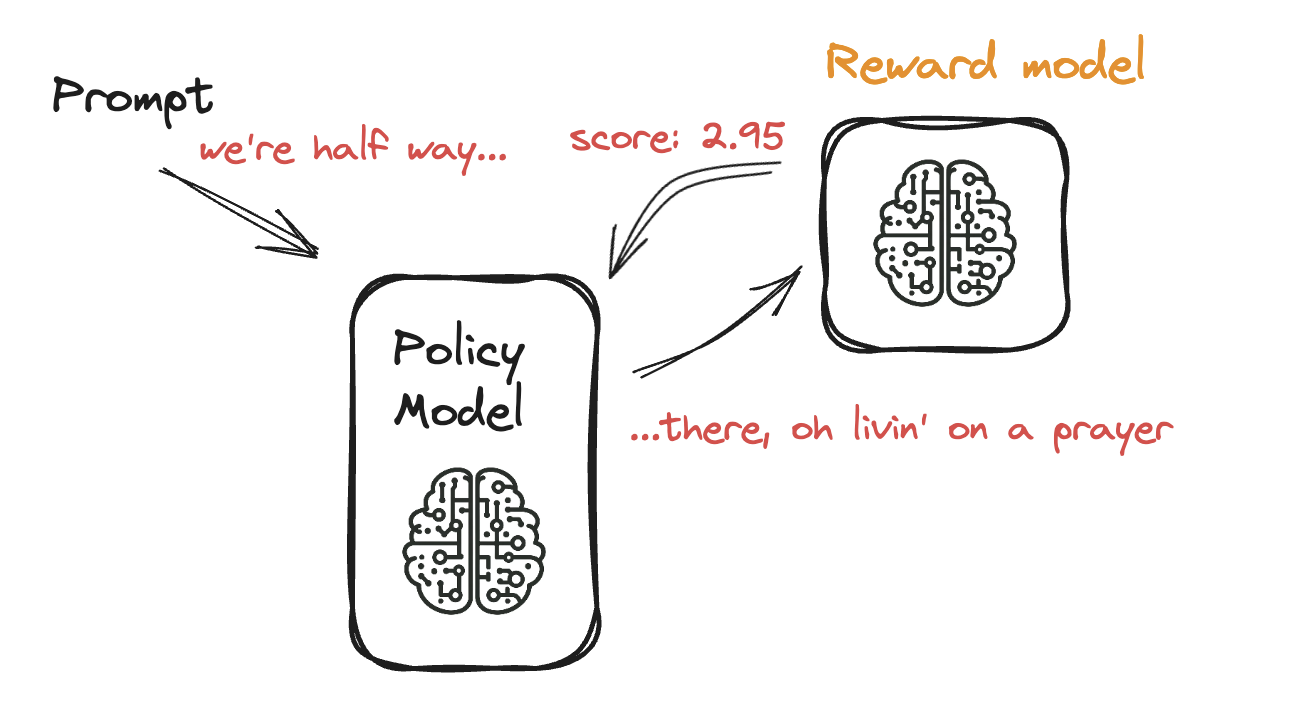

Een taalmodel fine-tunen met PPO

Een taalmodel fine-tunen met PPO

Een taalmodel fine-tunen met PPO

Een taalmodel fine-tunen met PPO

- PPO: geleidelijke aanpassing van het model

- Voorkomt overfitting op feedback

PPOTrainer implementeren met TRL

from trl import PPOConfig

config = PPOConfig(model_name="gpt2",learning_rate=1.4e-5)

from trl import AutoModelForCausalLMWithValueHead

model = AutoModelForCausalLMWithValueHead.from_pretrained(config.model_name)

tokenizer = AutoTokenizer.from_pretrained(config.model_name)

from trl import PPOTrainer

ppo_trainer = PPOTrainer(model=model,config=config,dataset=dataset,

tokenizer=tokenizer)

De trainingslus starten

for epoch in tqdm(range(10), "epoch: "):for batch in tqdm(ppo_trainer.dataloader):# Get responses response_tensors = ppo_trainer.generate(batch["input_ids"])batch["response"] = [tokenizer.decode(r.squeeze()) for r in response_tensors]# Compute reward score texts = [q + r for q, r in zip(batch["query"], batch["response"])]rewards = reward_model(texts)stats = ppo_trainer.step(query_tensors, response_tensors, rewards) ppo_trainer.log_stats(stats, batch, rewards)

Laten we oefenen!

Reinforcement Learning from Human Feedback (RLHF)