Modelmetrics en -afstellingen

Reinforcement Learning from Human Feedback (RLHF)

Mina Parham

AI Engineer

Waarom een referentiemodel gebruiken?

- Zinloze outputs

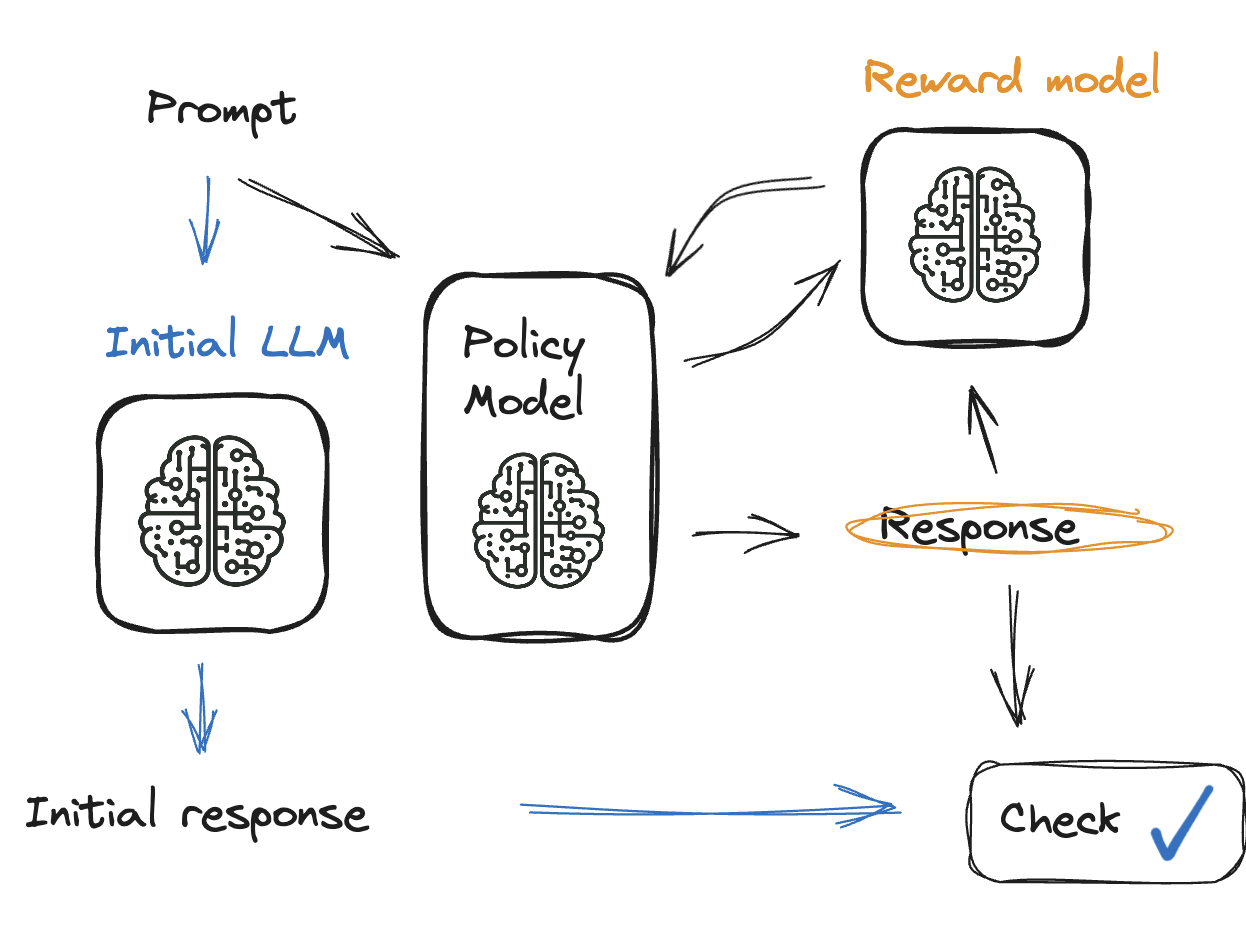

Modeloutput controleren

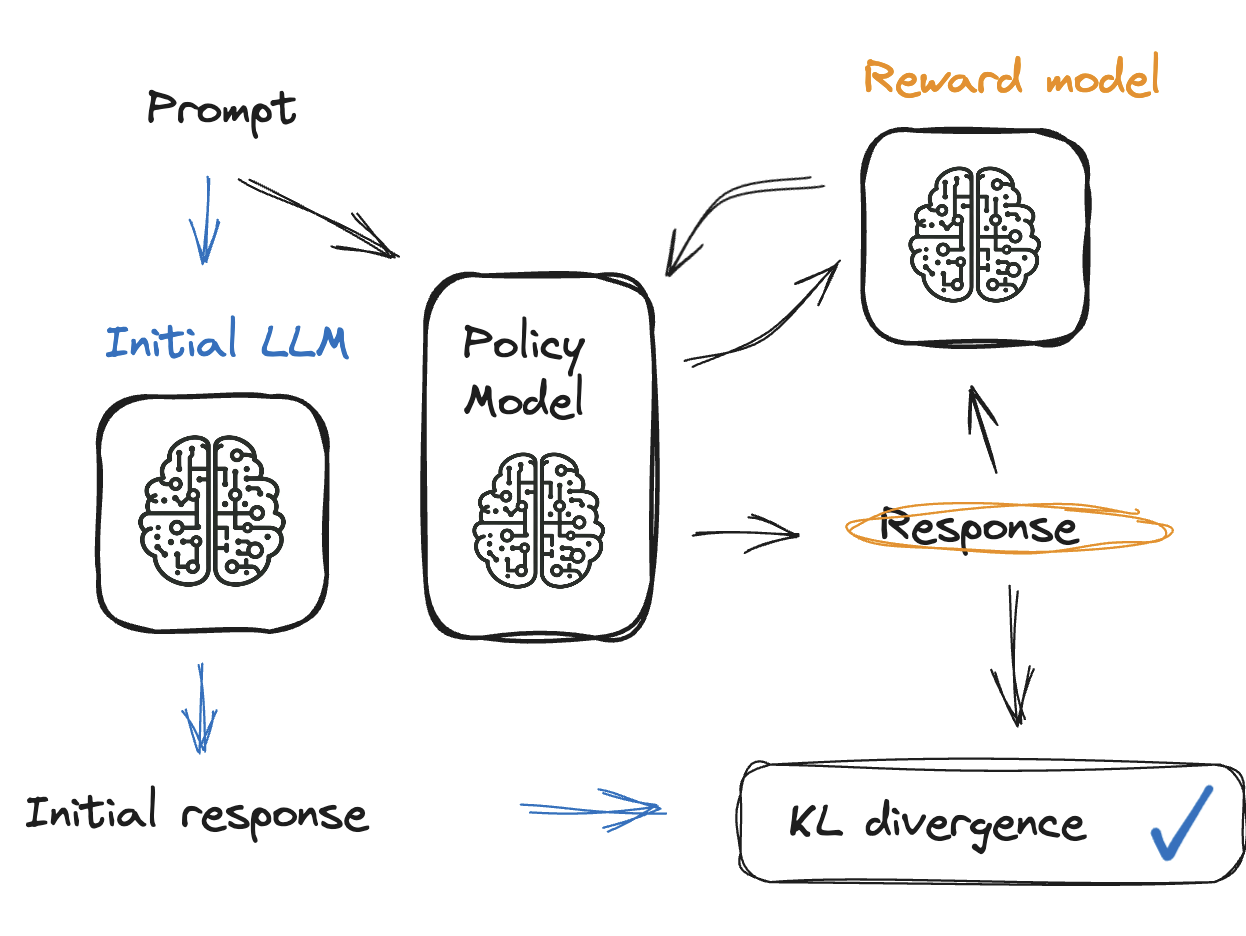

Oplossing: KL-divergentie

Oplossing: KL-divergentie

- Er wordt een straf aan het rewardmodel toegevoegd

- Straf stuurt het model bij bij irrelevante outputs

- KL-divergentie vergelijkt huidige en rewardmodel

- Tussen 0 en 10, en nooit negatief

Parameters afstellen

generation_kwargs = {"min_length": -1, # don't ignore the EOS token"top_k": 0.0, # no top-k sampling"top_p": 1.0, "do_sample": True, "pad_token_id": tokenizer.eos_token_id, "max_new_tokens": 32}

- Parameters worden doorgegeven aan het beleidmodel

Het rewardmodel controleren

Rewardmodel controleren

Output (reward) bekijken

reward_model_results.head()

|ID | Comment |Sentiment |Reward|

|---|---------------------------------------------|----------|------|

| 1 | This event was lit! So much fun! | Positive | 0.9 |

| 2 | Terrible experience, never attending again. | Negative | -0.8 |

| 3 | It was okay, nothing extraordinary. | Neutral | 0.2 |

| 4 | The event was poorly organized and chaotic. | Negative | -0.85|

| 5 | Had an amazing time with great people! | Positive | 0.95|

Het rewardmodel controleren

- 👍 👎 Extreme cases checken

extreme_positive = reward_model_results[reward_model_results['Reward'] >= 0.9] extreme_negative = reward_model_results[reward_model_results['Reward'] <= -0.8]

🧘 Dataset in balans houden

sentiment_distribution = reward_model_results['Sentiment'].value_counts()📊 Rewardmodel normaliseren

from sklearn.preprocessing import MinMaxScaler scaler = MinMaxScaler(feature_range=(-1, 1)) scaler.fit_transform(reward_model_results[['Reward']])

Laten we oefenen!

Reinforcement Learning from Human Feedback (RLHF)