Feedback uit diverse bronnen integreren

Reinforcement Learning from Human Feedback (RLHF)

Mina Parham

AI Engineer

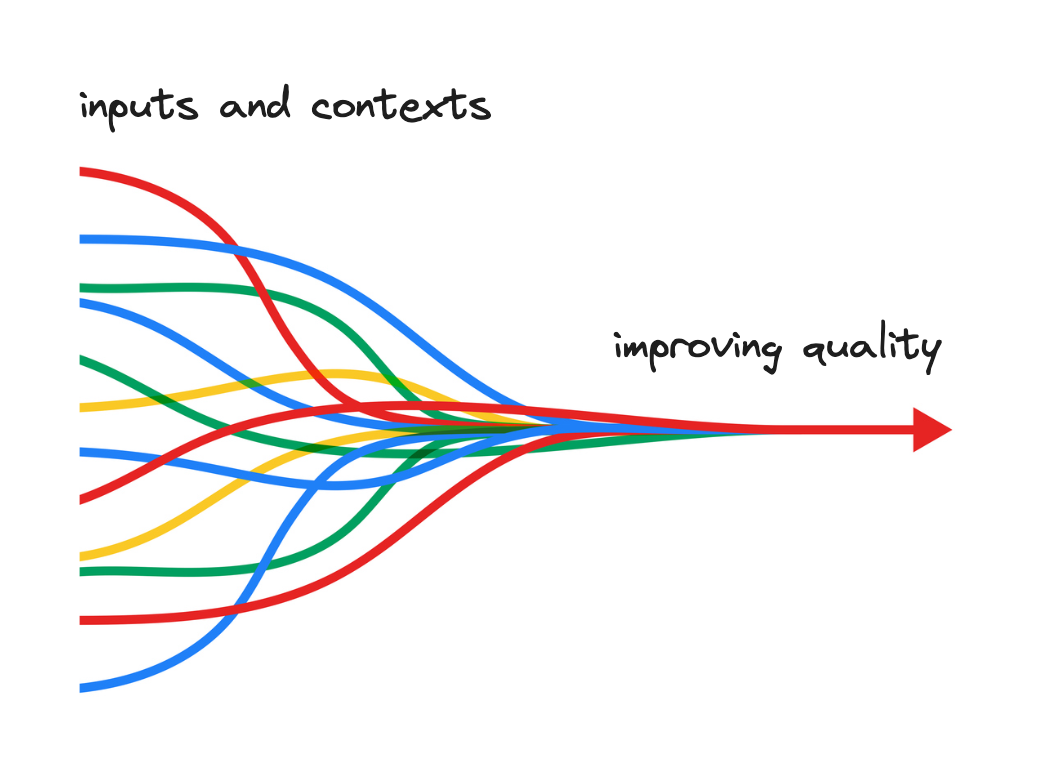

Betere generalisatie van het model

- Verschillende perspectieven en contexten weergeven

- Generaliseert voorkeuren en waarden

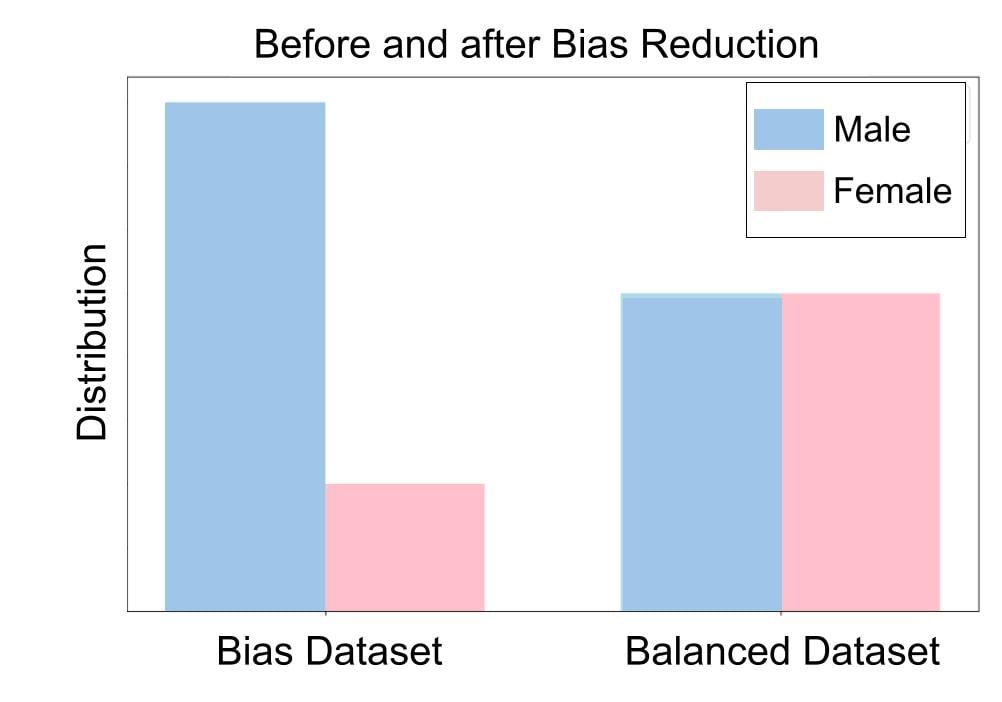

Minder bias

- Vermindert individuele biases

- Levert evenwichtigere en eerlijkere modeluitvoer op

Betere afstemming op menselijke waarden

- Complexe menselijke voorkeuren

- Culturen en achtergronden vertegenwoordigd

Meer aanpassingsvermogen

- Model reageert op meer soorten behoeften en voorkeuren

- Verschillende perspectieven vertegenwoordigen

Meer robuustheid

- Bestand tegen verschillende soorten input

- Prestaties verbeteren

Preferentiedata uit meerdere bronnen integreren

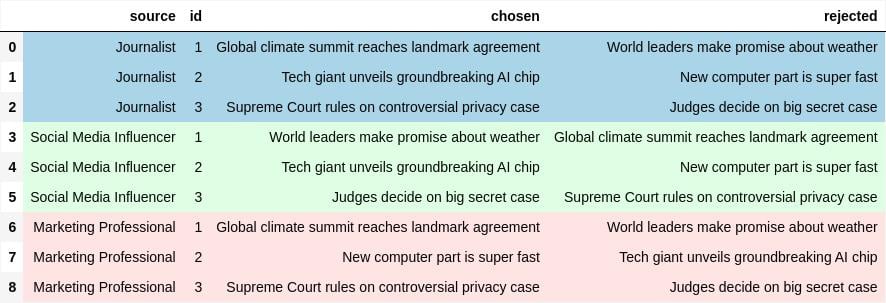

Preferentiedata preference_df met bronnen 'Journalist', 'Social Media Influencer' en 'Marketing Professional':

Meerderheidsstemming

Deze voorbeelddata kun je eenvoudig integreren door te groeperen op 'id':

df_majority = preference_df.groupby(['id']).apply(majority_vote)

Vervolgens met meerderheid van stemmen:

from collections import Counter

def majority_vote(df):

votes = Counter(zip(df['chosen'], df['rejected']))

return max(votes, key=votes.get)

Onbetrouwbare preferentiebronnen

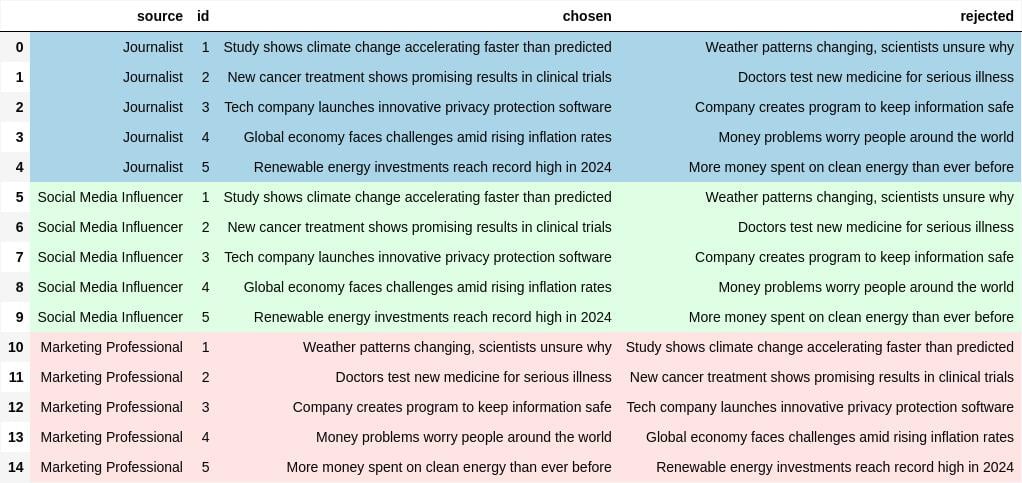

Preferentiedata preference_df2 met dezelfde drie experts:

Onbetrouwbare preferentiebronnen

- Itereren over de rijen van

preference_df2om onbetrouwbare bronnen te vinden:

df_majority = preference_df2.groupby('id').apply(majority_vote)disagreements = {source: 0 for source in preference_df2['source'].unique()}for _, row in preference_df2.iterrows(): if (row['chosen'], row['rejected']) != df_majority[row['id']]: disagreements[row['source']] += 1detect_unreliable_source = max(disagreements, key=disagreements.get)

Laten we oefenen!

Reinforcement Learning from Human Feedback (RLHF)