Gradient boosting

Ensemblemethoden in Python

Román de las Heras

Data Scientist, Appodeal

Introductie tot gradient boosting machines

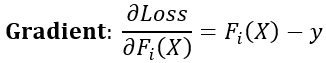

- Initieel model (zwakke schatter): $y\sim f_1(X)$

- Nieuw model past op residuen: $y-f_1(X)\sim f_2(X)$

- Nieuw additief model: $y\sim f_1(X)+f_2(X)$

- Herhaal $n$ keer of tot de fout klein genoeg is

- Eind-additief model: $$y\sim f_1(X)+f_2(X)+ ... +f_n(x)=\sum_{i=1}^{n} f_i(X)$$

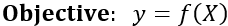

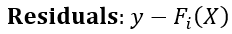

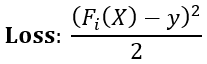

Equivalent aan gradient descent

Gradient descent:

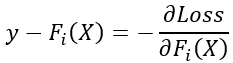

Residuen = negatieve gradiënt

Gradient boosting-classifier

Gradient Boosting Classifier

from sklearn.ensemble import GradientBoostingClassifier

clf_gbm = GradientBoostingClassifier(

n_estimators=100,

learning_rate=0.1,

max_depth=3,

min_samples_split,

min_samples_leaf,

max_features

)

n_estimators- Standaard: 100

learning_rate- Standaard: 0.1

max_depth- Standaard: 3

min_samples_splitmin_samples_leafmax_features

Gradient boosting-regressor

Gradient Boosting Regressor

from sklearn.ensemble import GradientBoostingRegressor

reg_gbm = GradientBoostingRegressor(

n_estimators=100,

learning_rate=0.1,

max_depth=3,

min_samples_split,

min_samples_leaf,

max_features

)

Tijd om te boosten!

Ensemblemethoden in Python