GRU- en LSTM-cellen

Recurrent Neural Networks (RNN's) voor taalmodellen met Keras

David Cecchini

Data Scientist

Geen verdwijnende gradiënten meer

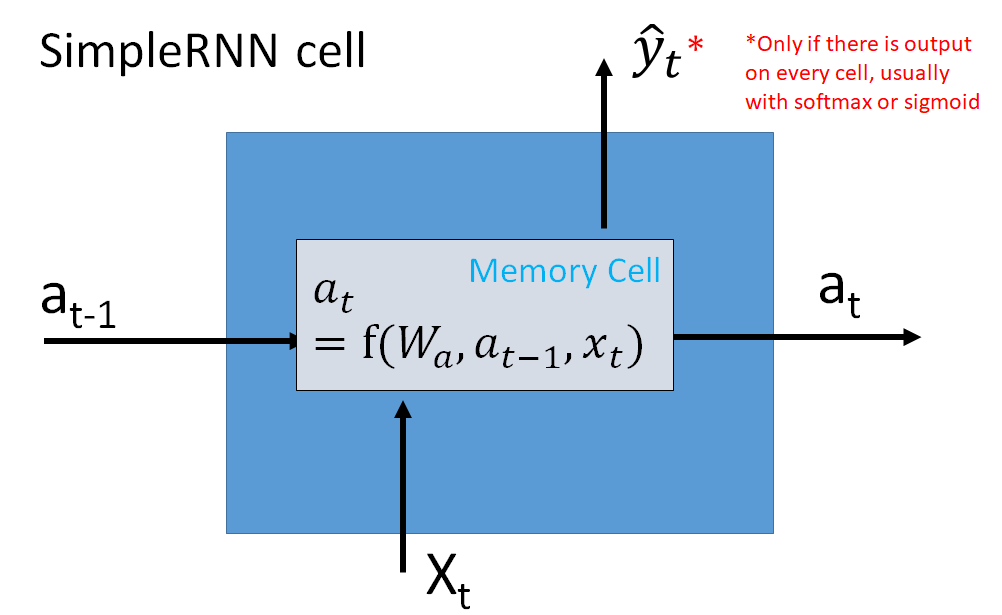

De

simpleRNN-cel kan gradiëntproblemen hebben.- De gewichtenmatrix tot de t-de macht vermenigvuldigt andere termen

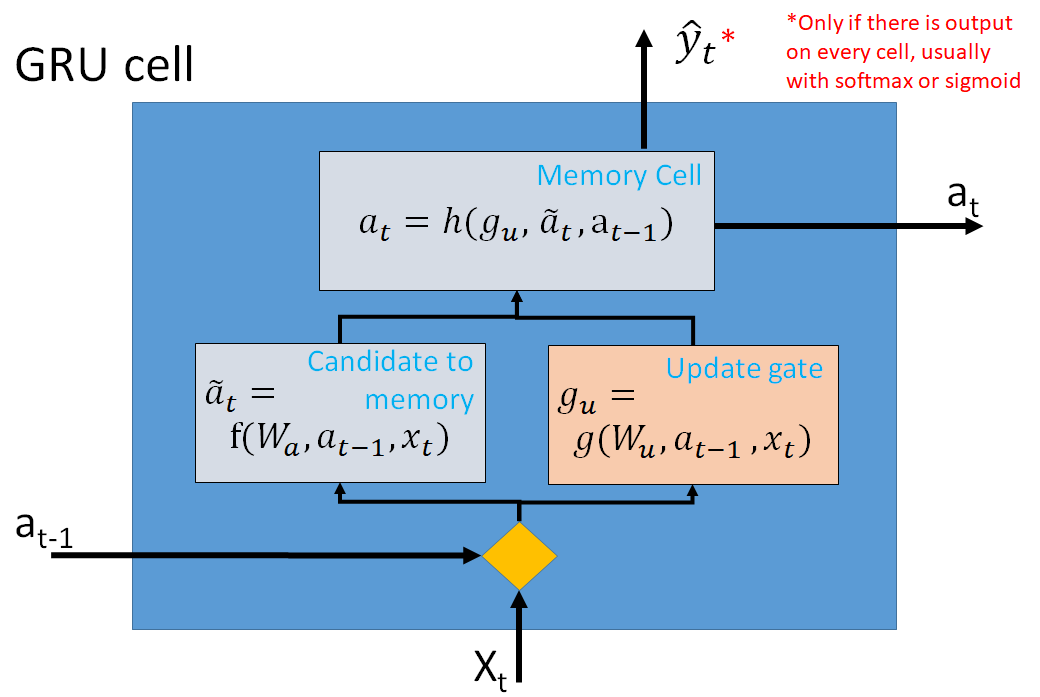

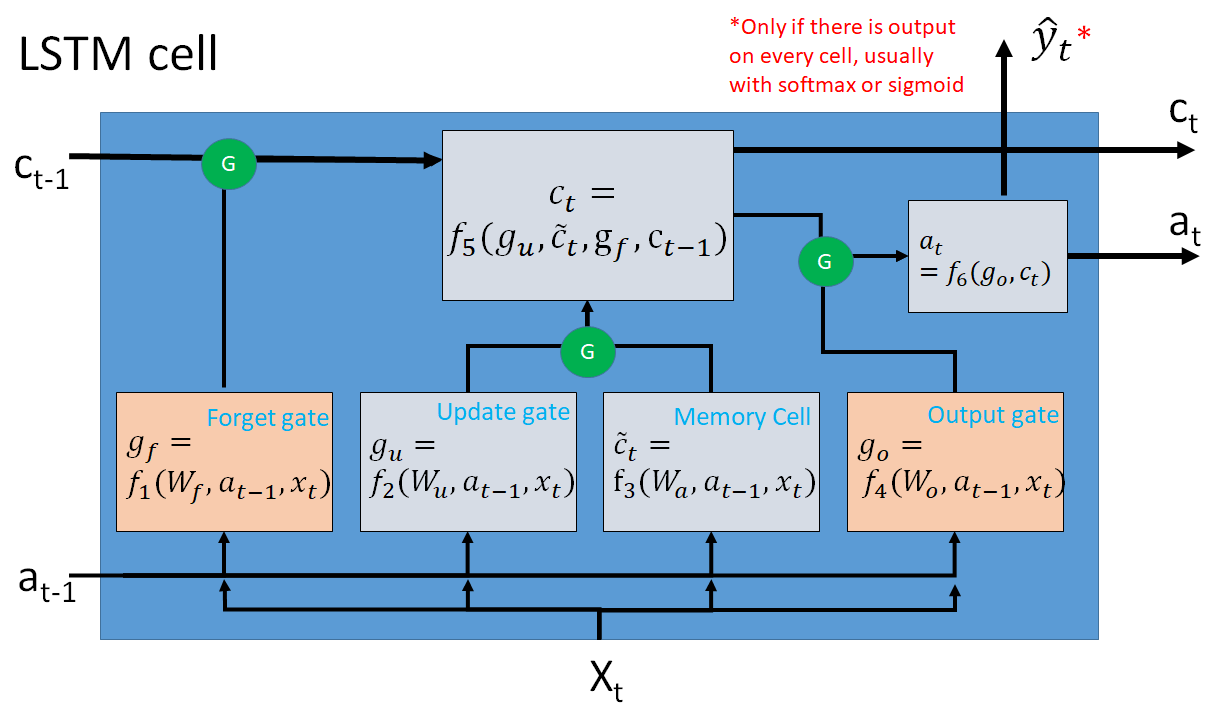

GRU- enLSTM-cellen hebben geen verdwijnende gradiënten- Dankzij hun poorten

- Geen gewichtenmatrices die de rest vermenigvuldigen

- Exploderende gradiënten zijn makkelijker te verhelpen

Gebruik in Keras

# Import the layers

from tensorflow import keras

from tensorflow.keras.layers import GRU, LSTM

# Add the layers to a model

model.add(GRU(units=128, return_sequences=True, name='GRU layer'))

model.add(LSTM(units=64, return_sequences=False, name='LSTM layer'))

Laten we oefenen!

Recurrent Neural Networks (RNN's) voor taalmodellen met Keras