Delta Lake-tabeloptimalisatie

Gegevens transformeren en analyseren met Microsoft Fabric

Luis Silva

Solution Architect - Data & AI

Wat is Delta Lake?

- Open-source opslaglaag voor lakehouses

- ACID-transacties, metadatabeheer en versiebeheer

- Fabric gebruikt Delta Lake-tabelindeling (Parquet) als standaard

- Interoperabiliteit tussen Fabric-ervaringen

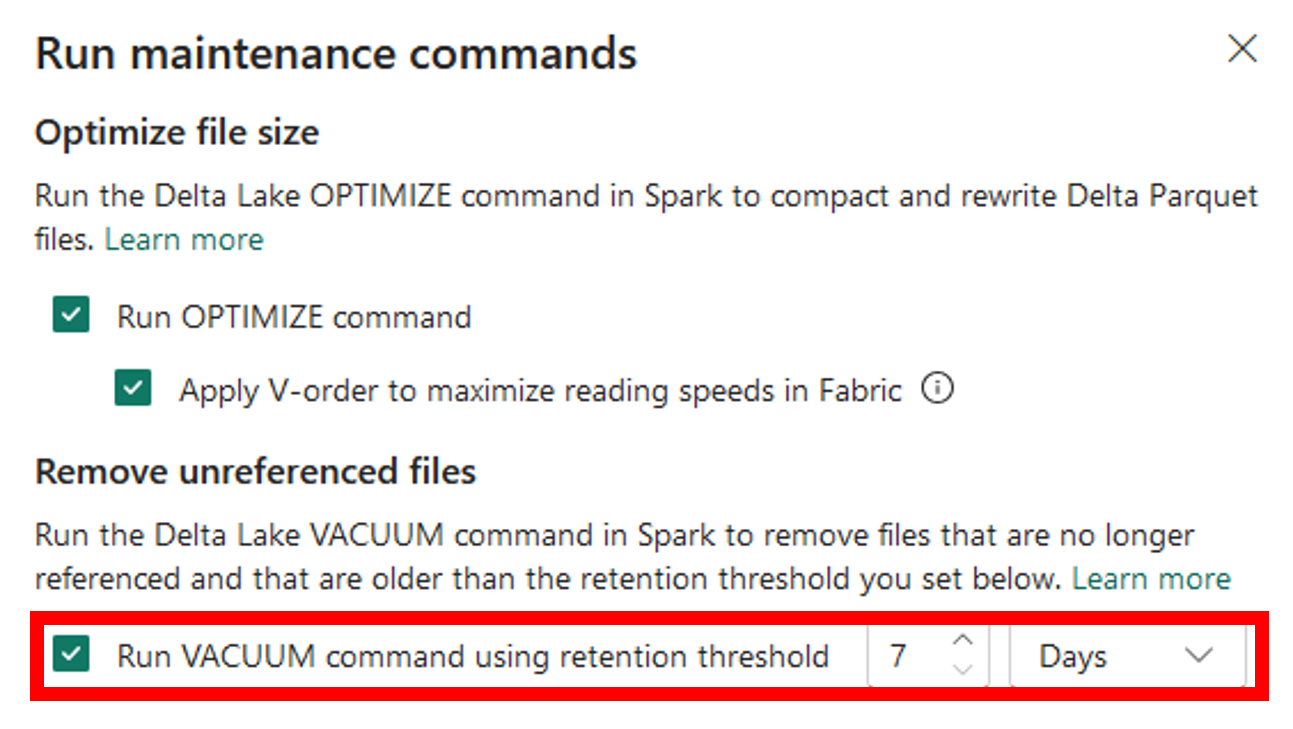

Tabelonderhoud

- Houd Delta-tabellen in vorm

- Tabelonderhoud:

- Optimize

- V-Order

- Vacuum

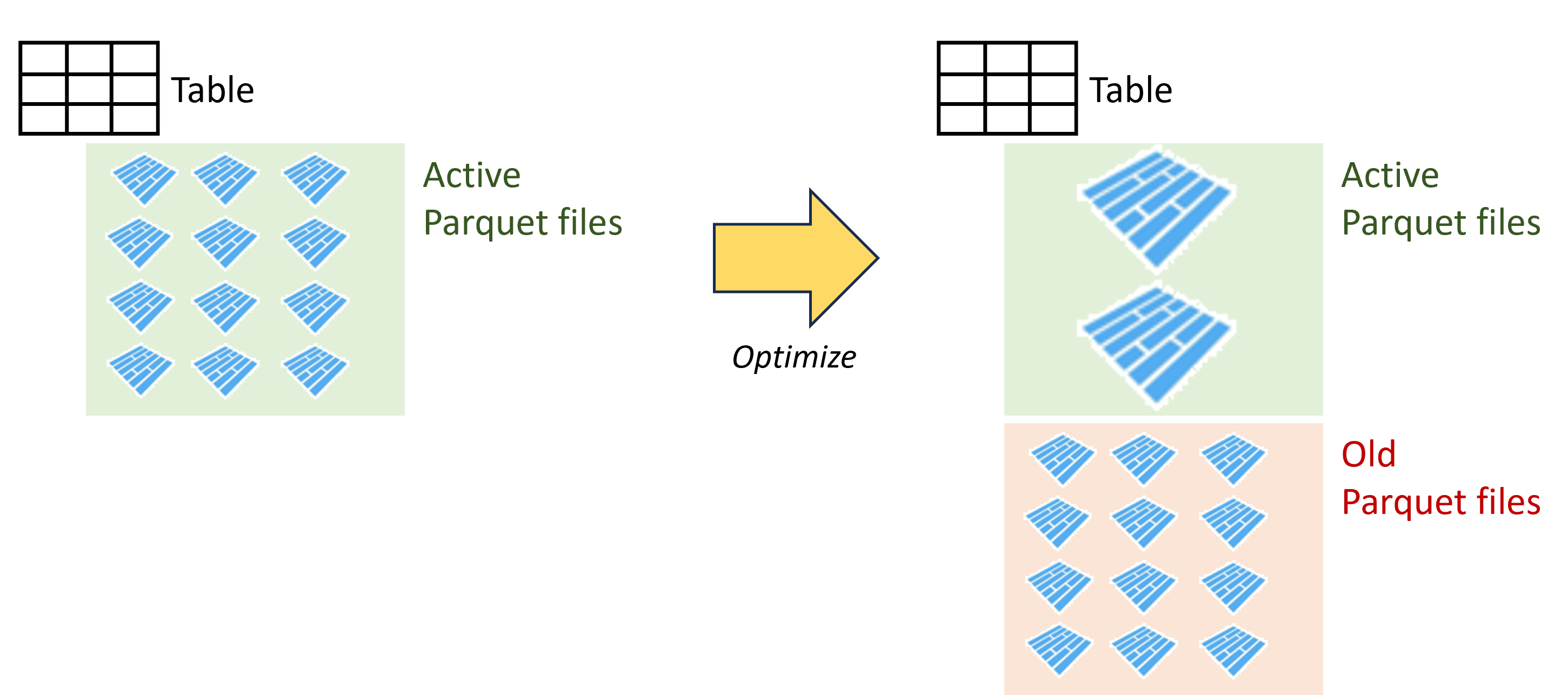

Optimize

- Bundel meerdere kleine Parquet-bestanden tot één groot bestand

- Ideale bestandsgrootte: 128 MB–1 GB

- Betere compressie en verdeling voor efficiënt lezen

- Aanraden na het laden van grote tabellen

Optimize

- Bundel meerdere kleine Parquet-bestanden tot één groot bestand

- Ideale bestandsgrootte: 128 MB–1 GB

- Betere compressie en verdeling voor efficiënt lezen

- Aanraden na het laden van grote tabellen

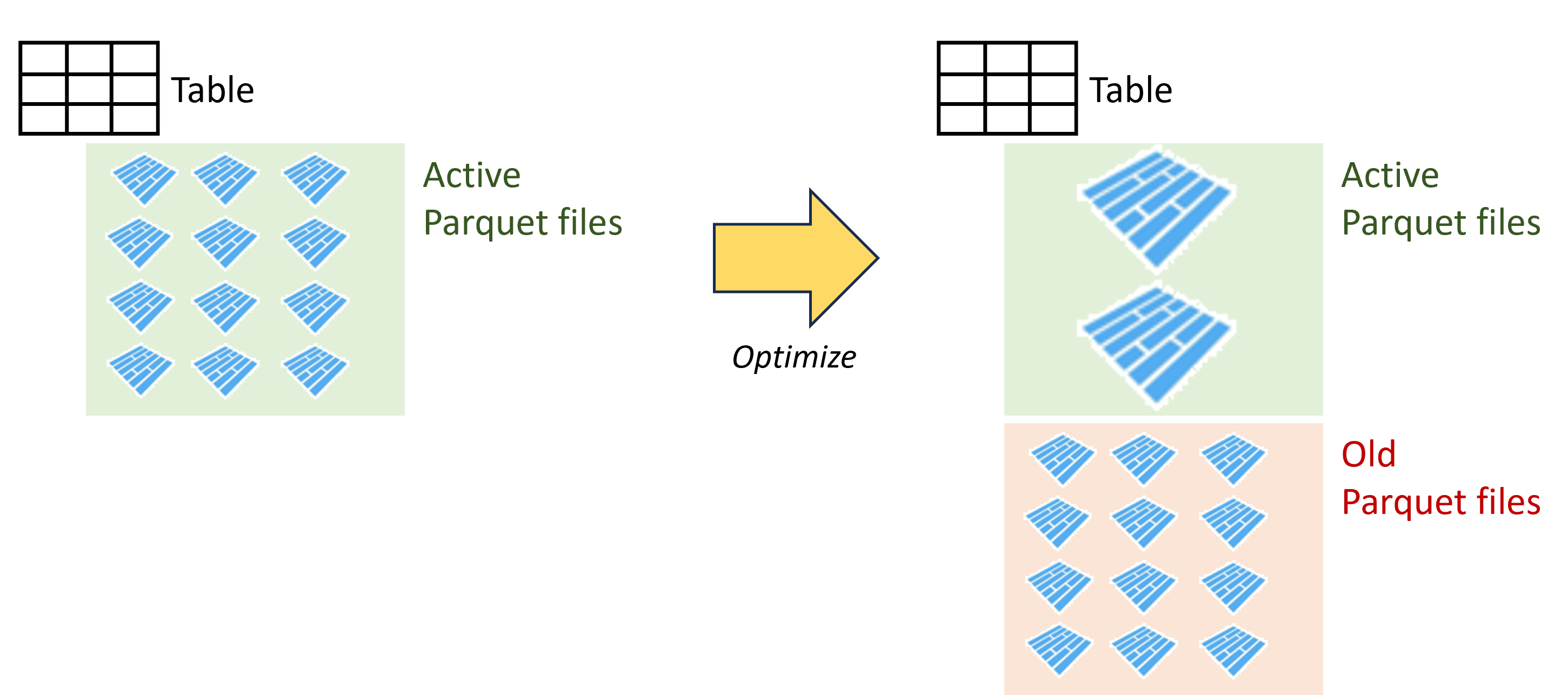

De Optimize-opdracht uitvoeren via Lakehouse Explorer

De Optimize-opdracht uitvoeren in Spark SQL

%%sql

OPTIMIZE <lakehouse>.<table>;

De Optimize-opdracht uitvoeren in PySpark

from delta.tables import DeltaTable

dt = DeltaTable.forPath( spark, "Tables/<table>" )

dt.optimize().executeCompaction()

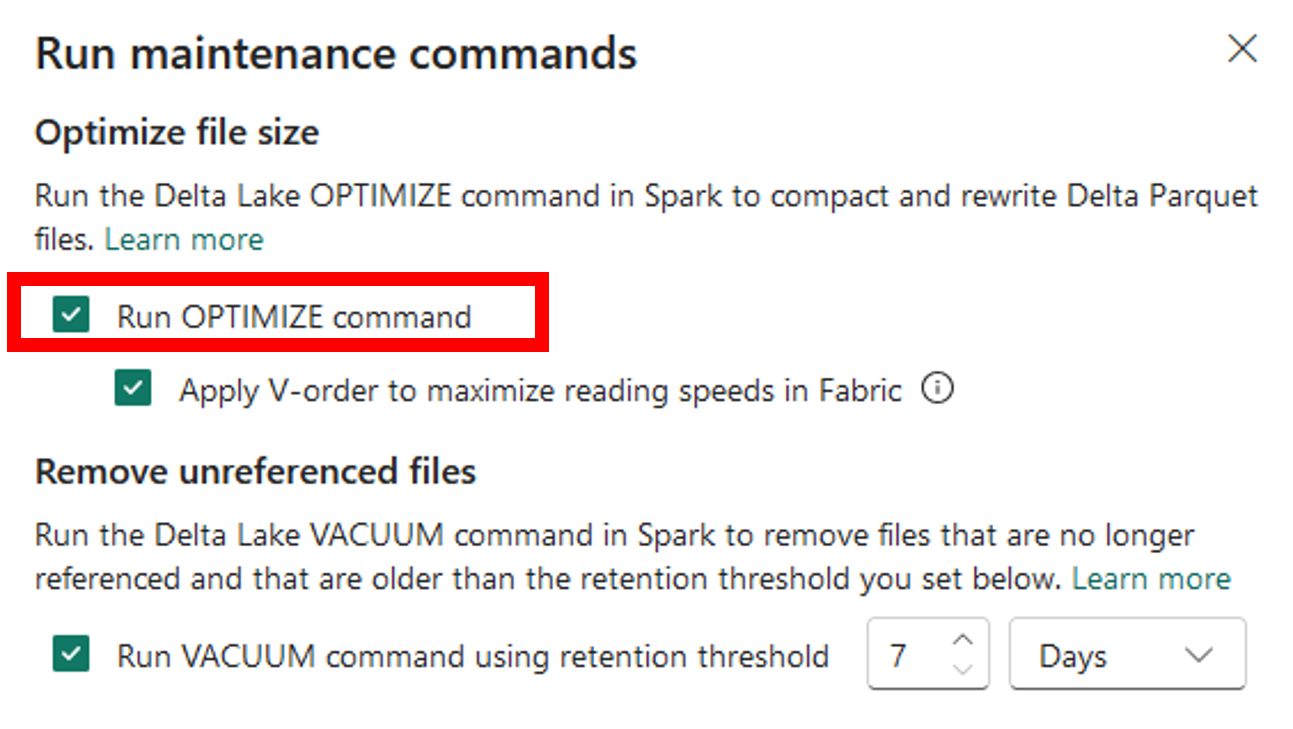

V-Order

- Speciale optimalisatie bij het schrijven van Parquet-bestanden

- Standaard ingeschakeld

V-Order toepassen via Lakehouse Explorer

V-Order schrijven beheren in een Apache Spark-sessie

V-Order voor de sessie inschakelen

%%sql SET spark.sql.parquet.vorder.enabled=TRUEV-Order voor de sessie uitschakelen

%%sql SET spark.sql.parquet.vorder.enabled=FALSE

V-Order toepassen tijdens het optimaliseren van een tabel

%%sql

OPTIMIZE <table|fileOrFolderPath> VORDER;

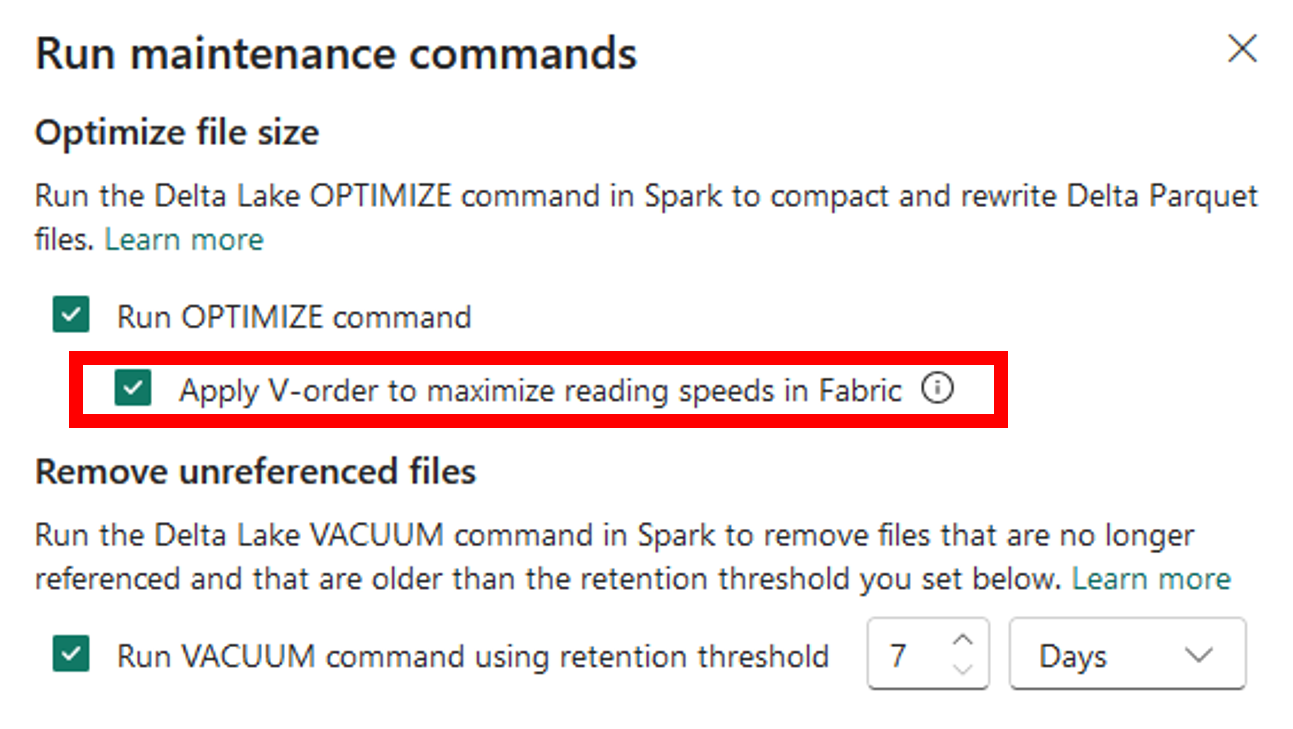

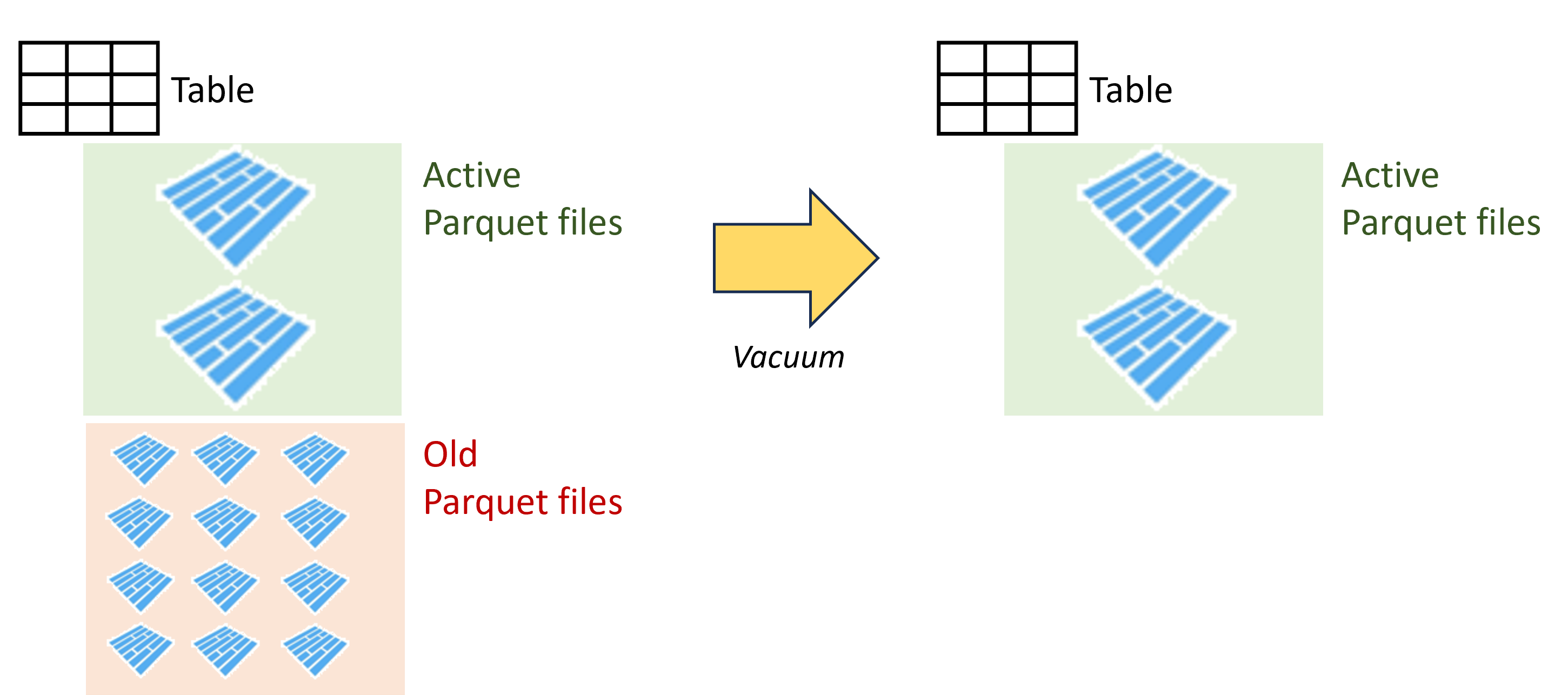

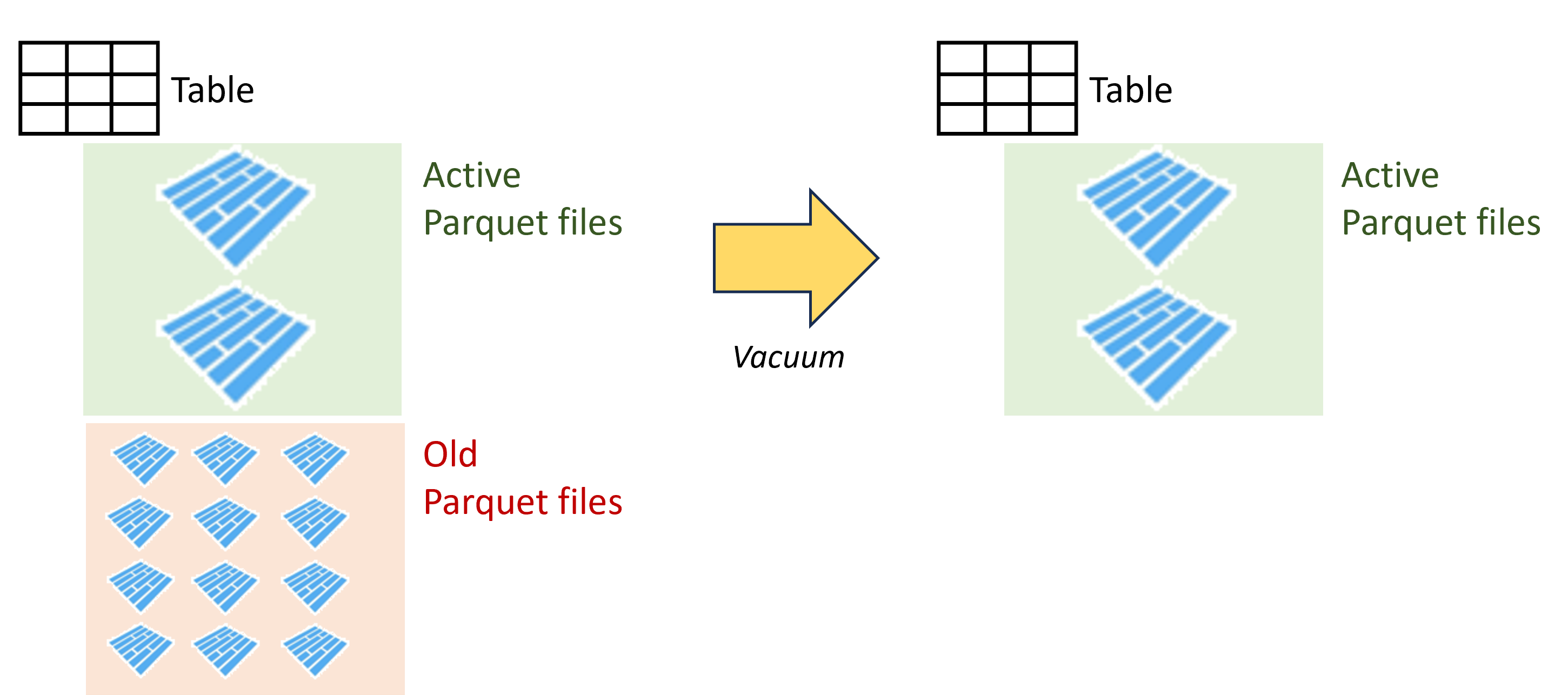

Vacuum

- Verwijder oude, overbodige bestanden ouder dan de retentiedrempel

- Verlaag cloudopslagkosten

Vacuum

- Verwijder oude, overbodige bestanden ouder dan de retentiedrempel

- Verlaag cloudopslagkosten

Vacuum uitvoeren via Lakehouse Explorer

Laten we oefenen!

Gegevens transformeren en analyseren met Microsoft Fabric