Het model trainen met Teacher Forcing

Machine Translation met Keras

Thushan Ganegedara

Data Scientist and Author

Modeltraining in detail

- Voor het trainen heb je nodig:

- Een verliesfunctie (bijv. categorical crossentropy)

- Een optimizer (bijv. Adam)

Modeltraining in detail

Voor het verlies heb je nodig:

- Probabilistische voorspellingen op inputs (

[batch_size, seq_len, vocab_size])- bijv.

[[0.11,...,0.81,0.04], [0.05,...,0.01, 0.93], ..., [0.78,..., 0.03,0.01]]

- bijv.

- One-hot gecodeerde Franse targets (

[batch_size, seq_len, vocab_size])- bijv.

[[0, ..., 1, 0], [0, ..., 0, 1],..., [0, ..., 1, 0]]

- bijv.

- Crossentropy: verschil tussen targets en voorspelde woorden

- Probabilistische voorspellingen op inputs (

De loss gaat naar een optimizer die de modelparameters aanpast om de loss te minimaliseren

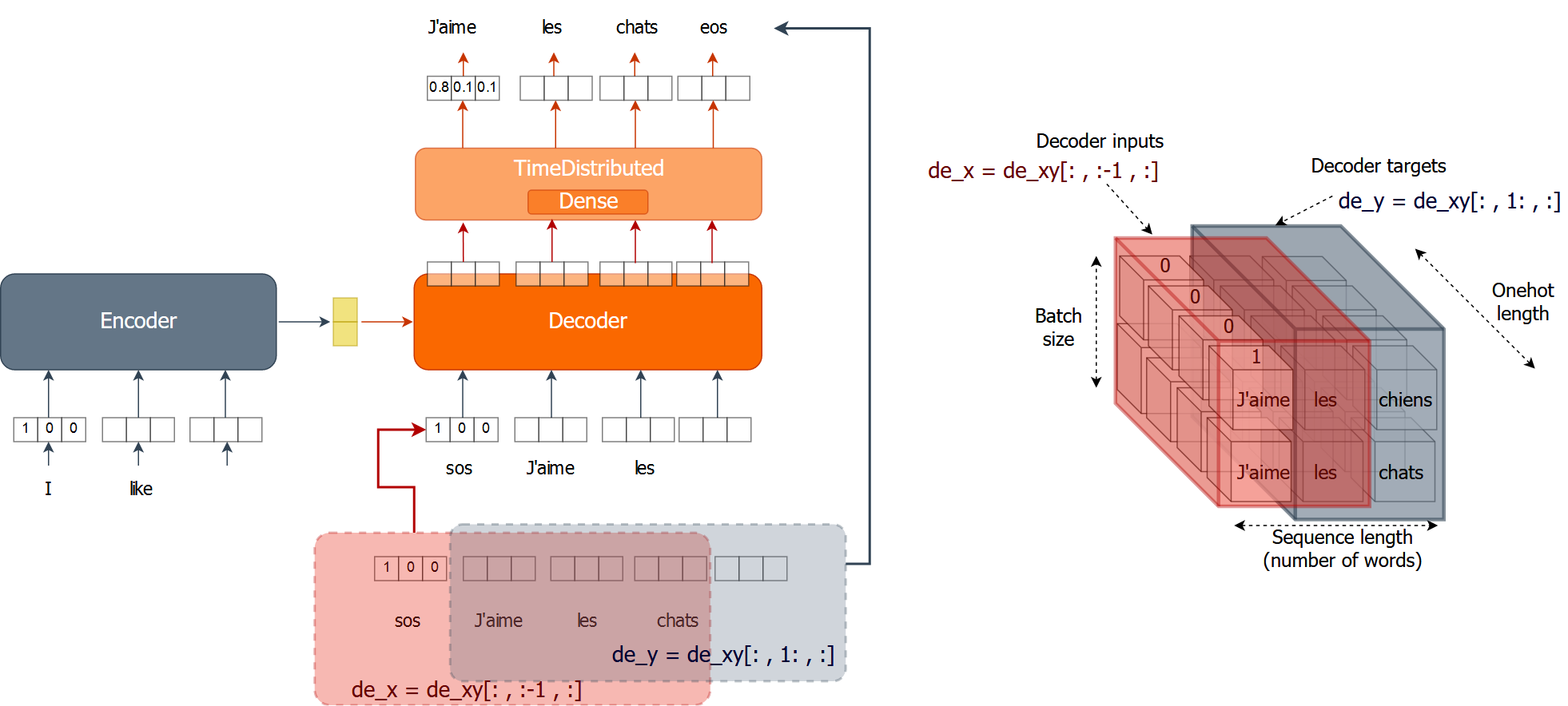

Het model trainen met Teacher Forcing

n_epochs, bsize = 3, 250 for ei in range(n_epochs): for i in range(0,data_size,bsize):# Encoder-invoer, decoder-invoer en -uitvoer en_x = sents2seqs('source', en_text[i:i+bsize], onehot=True, reverse=True) de_xy = sents2seqs('target', fr_text[i:i+bsize], onehot=True)# Decoder-invoer en -uitvoer scheiden de_x = de_xy[:,:-1,:] de_y = de_xy[:,1:,:]# Trainen en evalueren op één batch nmt_tf.train_on_batch([en_x,de_x], de_y) res = nmt_tf.evaluate([en_x,de_x], de_y, batch_size=bsize, verbose=0) print("{} => Train Loss:{}, Train Acc: {}".format(ei+1,res[0], res[1]*100.0))

Array slicing uitgelegd

de_x = de_xy[:,:-1,:]

de_y = de_xy[:,1:,:]

Trainings- en validatiedata maken

train_size, valid_size = 800, 200 # Indexen voor de data maken inds = np.arange(len(en_text)) np.random.shuffle(inds)# Train- en validatie-indexen splitsen train_inds = inds[:train_size] valid_inds = inds[train_size:train_size+valid_size]# Train- en validatiedata ophalen tr_en = [en_text[ti] for ti in train_inds] tr_fr = [fr_text[ti] for ti in train_inds] v_en = [en_text[vi] for vi in valid_inds] v_fr = [fr_text[vi] for vi in valid_inds]print('Training (EN):\n', tr_en[:2], '\nTraining (FR):\n', tr_fr[:2]) print('\nValid (EN):\n', tr_en[:2], '\nValid (FR):\n', tr_fr[:2])

Valid (EN): ['she saw that rusty blue truck .', 'france is usually snowy during autumn , ...']

Valid (FR): ['elle a vu ce camion bleu rouillé .', 'la france est généralement enneigée en automne ...']

Trainen met validatie

for ei in range(n_epochs): for i in range(0,train_size,bsize): en_x = sents2seqs('source', tr_en[i:i+bsize], onehot=True, reverse=True) de_xy = sents2seqs('target', tr_fr[i:i+bsize], onehot=True) de_x, de_y = de_xy[:,:-1,:], de_xy[:,1:,:] nmt_tf.train_on_batch([en_x, de_x], de_y)v_en_x = sents2seqs('source', v_en, onehot=True, reverse=True) v_de_xy = sents2seqs('target', v_fr, onehot=True) v_de_x, v_de_y = v_de_xy[:,:-1,:], v_de_xy[:,1:,:]res = nmt_tf.evaluate([v_en_x, v_de_x], v_de_y, batch_size=valid_size, verbose=0) print("Epoch {} => Loss:{}, Val Acc: {}".format(ei+1,res[0], res[1]*100.0))

Epoch 1 => Loss:4.784221172332764, Val Acc: 1.4999999664723873

Epoch 2 => Loss:4.716882228851318, Val Acc: 44.458332657814026

Epoch 3 => Loss:4.63267183303833, Val Acc: 47.333332896232605

Laten we trainen!

Machine Translation met Keras