Afronding en de finale

Machine Translation met Keras

Thushan Ganegedara

Data Scientist and Author

Wat je tot nu toe hebt gedaan

- Hoofdstuk 1

- Introductie van de encoder-decoder-architectuur

- Uitleg van de GRU-laag

- Hoofdstuk 2

- Encoder implementeren

- Decoder implementeren

- Voorspellingslaag van de decoder implementeren

Wat je tot nu toe hebt gedaan

- Hoofdstuk 3

- Data preprocesen

- Het vertaalmodel trainen

- Vertalingen genereren

- Hoofdstuk 4

- Introductie van teacher forcing

- Een model trainen met teacher forcing

- Vertalingen genereren

- Woordembeddings gebruiken voor machinevertaling

Modellen voor machinevertaling

- Model 1

- De encoder leest Engelse woorden (one-hot gecodeerd) en geeft een contextvector

- De decoder leest de contextvector en geeft de vertaling

- Model 2

- De encoder leest Engelse woorden (one-hot gecodeerd) en geeft een contextvector

- De decoder leest een gegeven woord (one-hot gecodeerd) van de vertaling en voorspelt het volgende woord

- Model 3

- Gebruikt woordvectoren in plaats van one-hot-codering

- Woordvectoren vangen semantische relaties tussen woorden

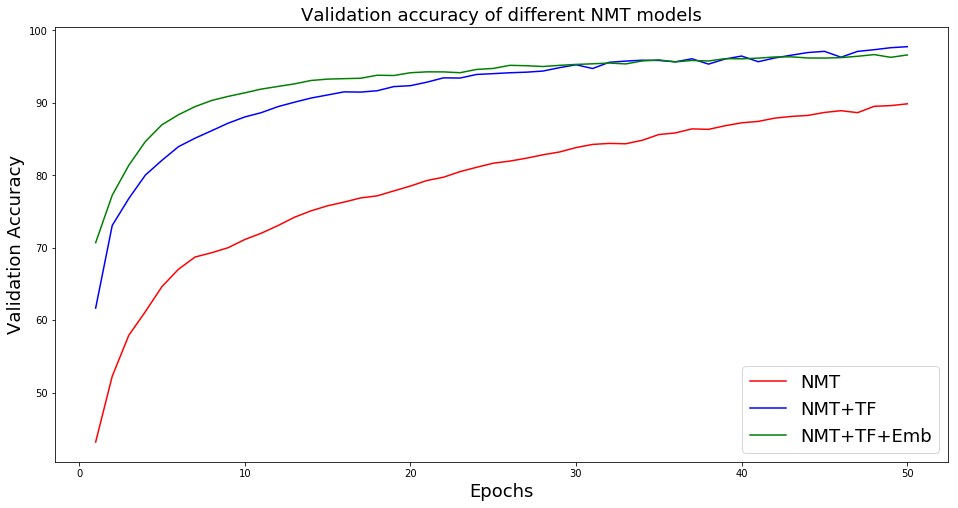

Prestaties van verschillende modellen

Recente ontwikkelingen en leestips

- Evaluatie van vertaalmodellen

- Wordpiece-modellen

- Helpen out-of-vocabulary woorden te vermijden (Sennrich et al., Neural Machine Translation of Rare Words with Subword Units.)

- Transformer-modellen (Vaswani et al., Attention Is All You Need)

- State-of-the-art op veel NLP-taken, incl. machinevertaling

- Heeft een encoder-decoder-architectuur, maar geen sequentiële modellen

- Google’s nieuwste vertaler is een Transformer-model

Veel succes!

Machine Translation met Keras