Informatie en feature-importance

Dimensionality Reduction in R

Matt Pickard

Owner, Pickard Predictives, LLC

1 Provost, Foster; Fawcett, Tom (2013-07-27). Data Science for Business: What you need to know about data mining and data-analytic thinking. O'Reilly Media. Kindle Edition.

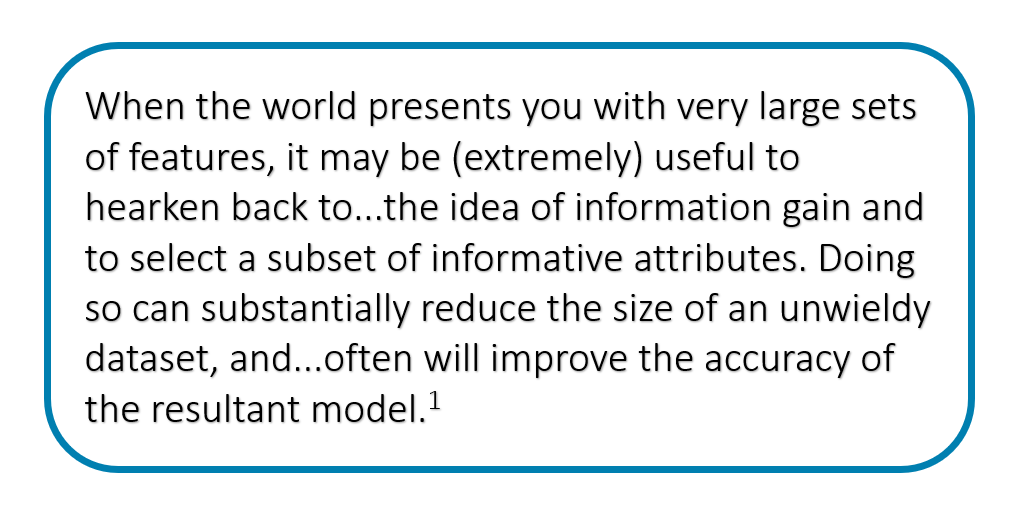

Feature-importance

Feature-importance: een maat voor informatie bij modelbouw

Meerdere manieren om feature-importance te meten

- Correlatie (met targetvariabele)

- Gestandaardiseerde regressiecoëfficiënten

- Information gain

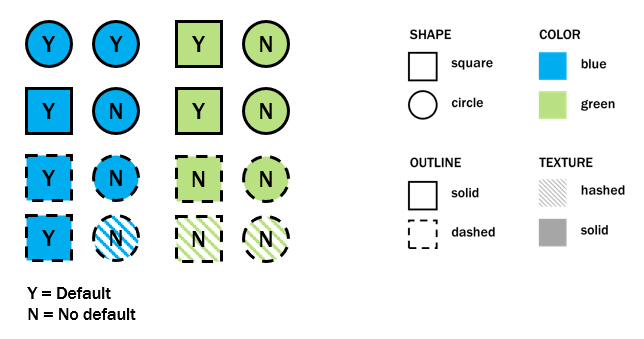

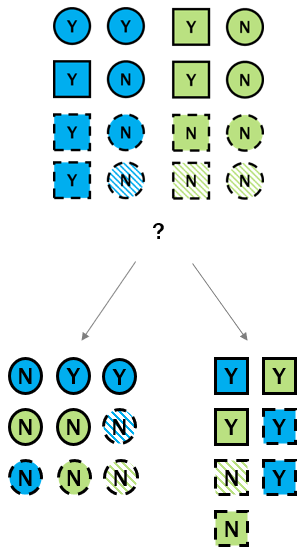

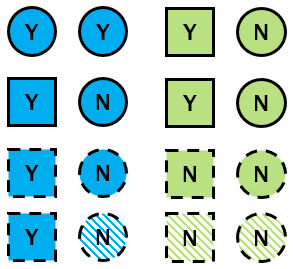

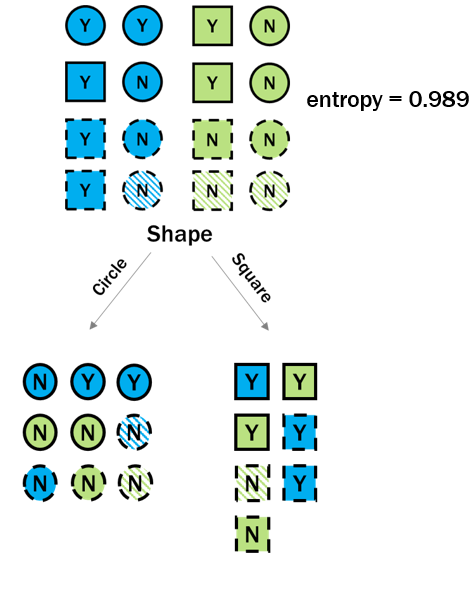

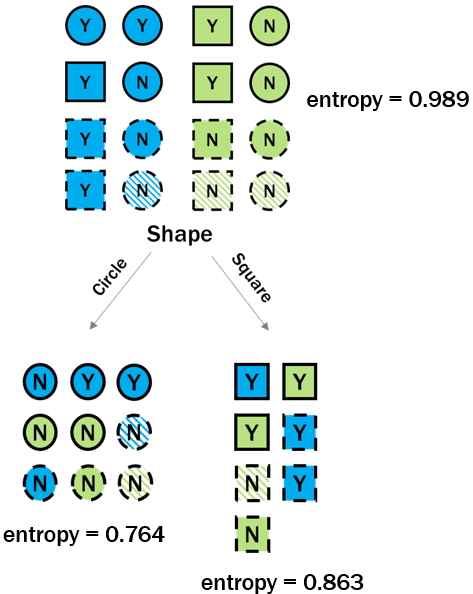

Voorbeeld van een beslissingsboom

Beslissingsboom en information gain

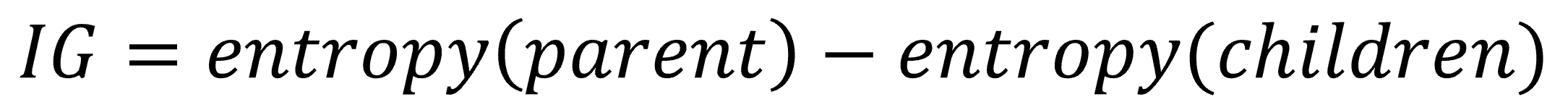

Information gain: hoeveel we over de ene variabele weten door de andere te observeren

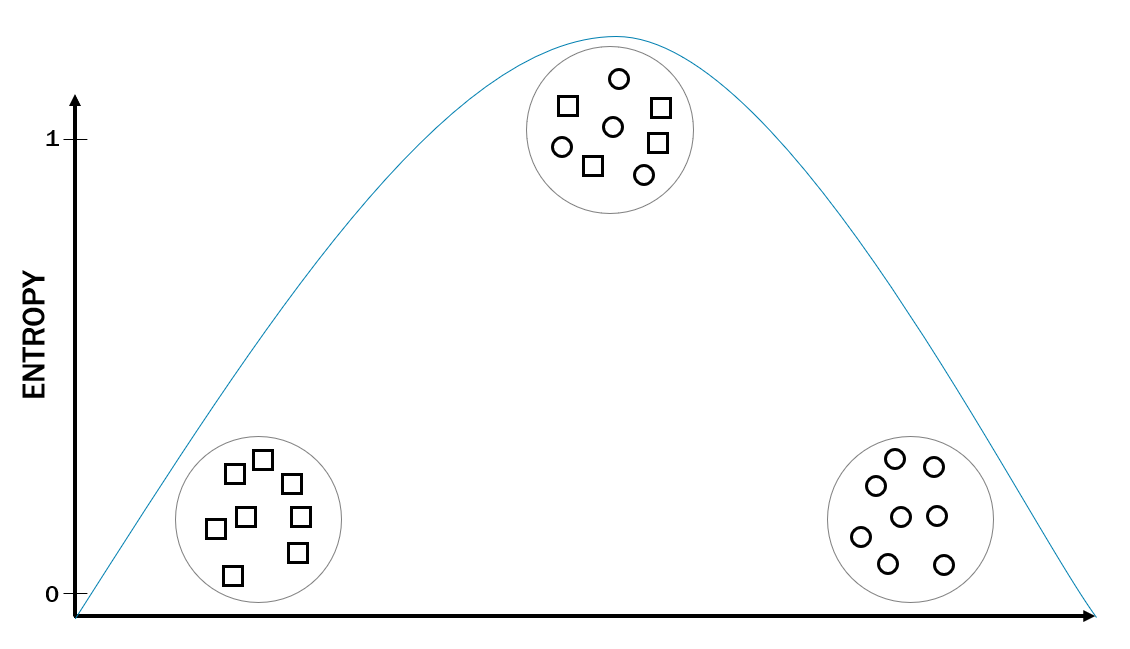

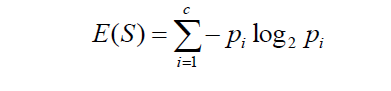

Entropie

- Een maat voor wanorde

- Hoe zuiverder, hoe lager de entropie

- Entropie loopt van 0 (perfecte zuiverheid) tot 1 (maximale entropie)

Entropie: rootnode

p_yes <- 7/16p_no <- 9/16entropy_root <- -(p_yes * log2(p_yes)) + -(p_no * log2(p_no))entropy_root

0.989

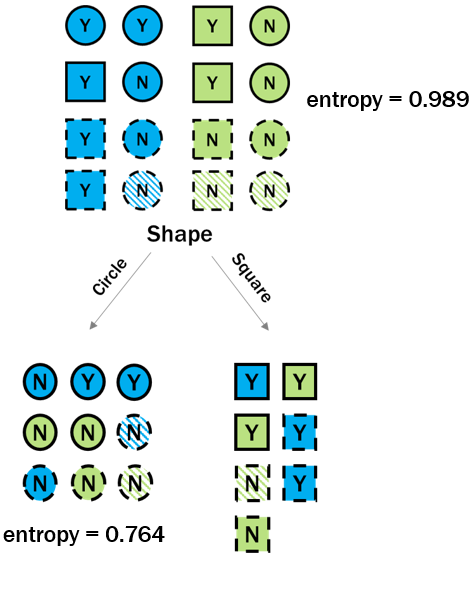

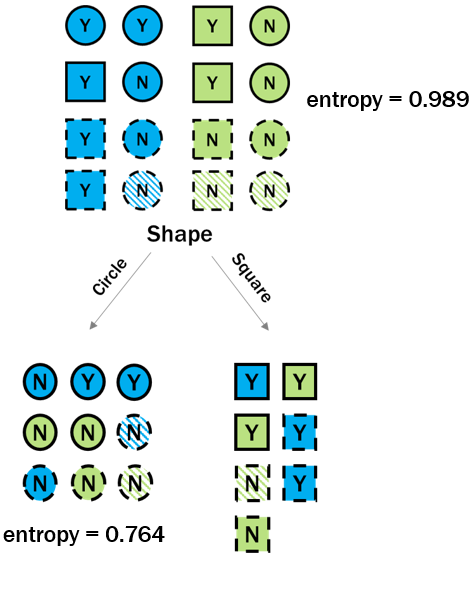

Entropie: kindknopen

p_left_yes <- 2/9p_left_no <- 7/9entropy_left <- -(p_left_yes * log2(p_left_yes)) + -(p_left_no * log2(p_left_no))

Entropie: kindknopen

p_left_yes <- 2/9p_left_no <- 7/9entropy_left <- -(p_left_yes * log2(p_left_yes)) + -(p_left_no * log2(p_left_no))entropy_left

0.764

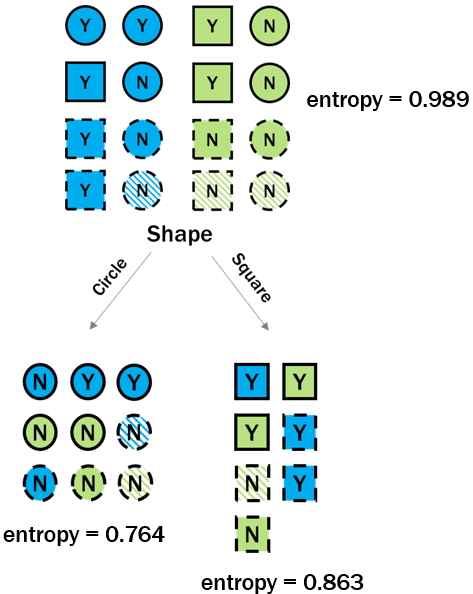

Entropie: kindknopen

p_right_yes <- 5/7p_right_no <- 2/7entropy_right <- -(p_right_yes * log2(p_right_yes)) + -(p_right_no * log2(p_right_no))

Entropie: kindknopen

p_right_yes <- 5/7p_right_no <- 2/7entropy_right <- -(p_right_yes * log2(p_right_yes)) + -(p_right_no * log2(p_right_no))entropy_right

0.863

Information gain: van root naar kinderen

p_left <- 9/16p_right <- 7/16info_gain <- entropy_root - (p_left * entropy_left + p_right * entropy_right)info_gain

0.181

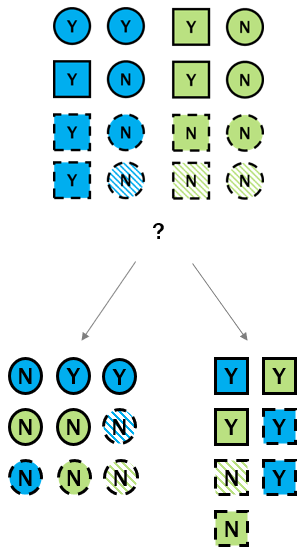

Vergelijk information gain per feature

| Feature | Information gain |

|---|---|

| shape | 0.181 |

| texture | 0.180 |

| outline | 0.106 |

| color | 0.106 |

Laten we oefenen!

Dimensionality Reduction in R