Spraakherkenning en audiogeneratie

Multi-modale modellen met Hugging Face

James Chapman

Curriculum Manager, DataCamp

Spraak

Wat zijn de belangrijke onderdelen van spraakgolven?

- Pitch: gem. frequentie mannen 85–180 Hz, vrouwen 165–255 Hz

- Klemtoon: per taal, accent en emotie

- Ritme: beïnvloed door context, emotie en taal

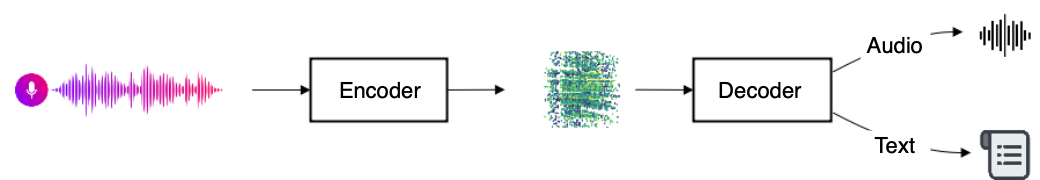

Automatische spraakherkenning

- Tekst en audio zijn allebei sequentieel

- Voorbeelden: transcriptie, vertaling, tekst-naar-spraak

Automatische spraakherkenning

- Tiny-model: 39M parameters, modelgrootte 150 MB

- Trainingsdata: 680k uur (gelabeld)

from transformers import WhisperProcessor, WhisperForConditionalGeneration

processor = WhisperProcessor.from_pretrained("openai/whisper-tiny")

model = WhisperForConditionalGeneration.from_pretrained("openai/whisper-tiny")

1 https://github.com/openai/whisper

Automatische spraakherkenning

from datasets import load_dataset, Audio dataset = load_dataset("CSTR-Edinburgh/vctk")["train"] dataset = dataset.cast_column("audio", Audio(sampling_rate=16_000))sample = dataset[0]["audio"]input_preprocessed = processor(sample["array"], sampling_rate=sample["sampling_rate"], return_tensors="pt")predicted_ids = model.generate(input_preprocessed.input_features)transcription = processor.batch_decode(predicted_ids, skip_special_tokens=True) print(transcription)

['Please cool Stella.']

Audiogeneratie

Drie componenten voor audiogeneratie:

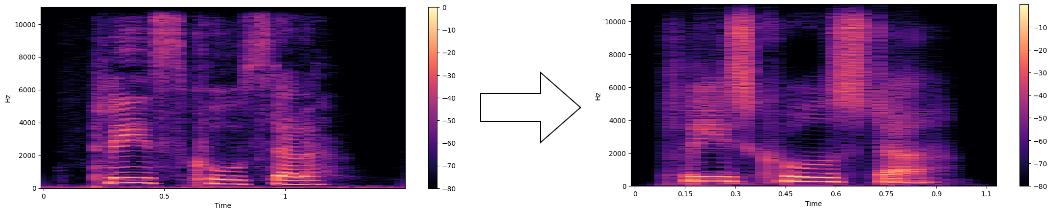

- Preprocessor: resampling en feature-extractie

- Model: featuretransformatie

- Vocoder: apart generatief model voor audiogolven

from transformers import SpeechT5Processor, SpeechT5ForSpeechToSpeech, SpeechT5HifiGanprocessor = SpeechT5Processor.from_pretrained("microsoft/speecht5_vc") model = SpeechT5ForSpeechToSpeech.from_pretrained("microsoft/speecht5_vc") vocoder = SpeechT5HifiGan.from_pretrained("microsoft/speecht5_hifigan")

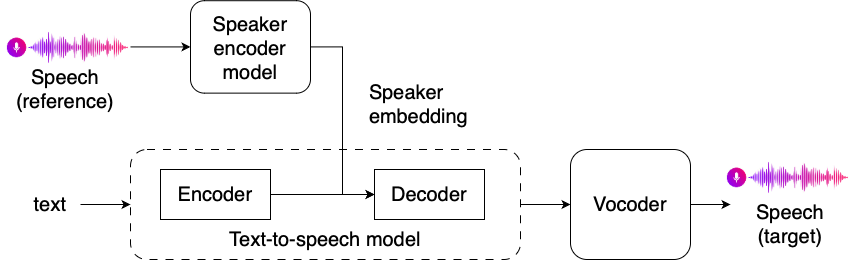

Spraakembeddings

Spreker-embeddings genereren

- Voorgetrainde encoder: audiogolf-array → gecodeerde array (meestal 512 dimensies)

from speechbrain.inference.speaker import EncoderClassifier

speaker_model = EncoderClassifier.from_hparams(source="speechbrain/spkrec-xvect-voxceleb")

speaker_embeddings = speaker_model.encode_batch(torch.tensor(dataset[0]["audio"]["array"]))speaker_embeddings = torch.nn.functional.normalize(speaker_embeddings, dim=2).unsqueeze(0)

Audiogeneratie

inputs = processor(audio=dataset[0]["audio"], sampling_rate=dataset[0]["audio"]["sampling_rate"], return_tensors="pt")speech = model.generate_speech(inputs["input_values"], speaker_embedding, vocoder=vocoder)

Laten we oefenen!

Multi-modale modellen met Hugging Face