Preprocessing van verschillende modaliteiten

Multi-modale modellen met Hugging Face

James Chapman

Curriculum Manager, DataCamp

Tekst preprocesen

- Tokenizer: zet tekst → modelinput

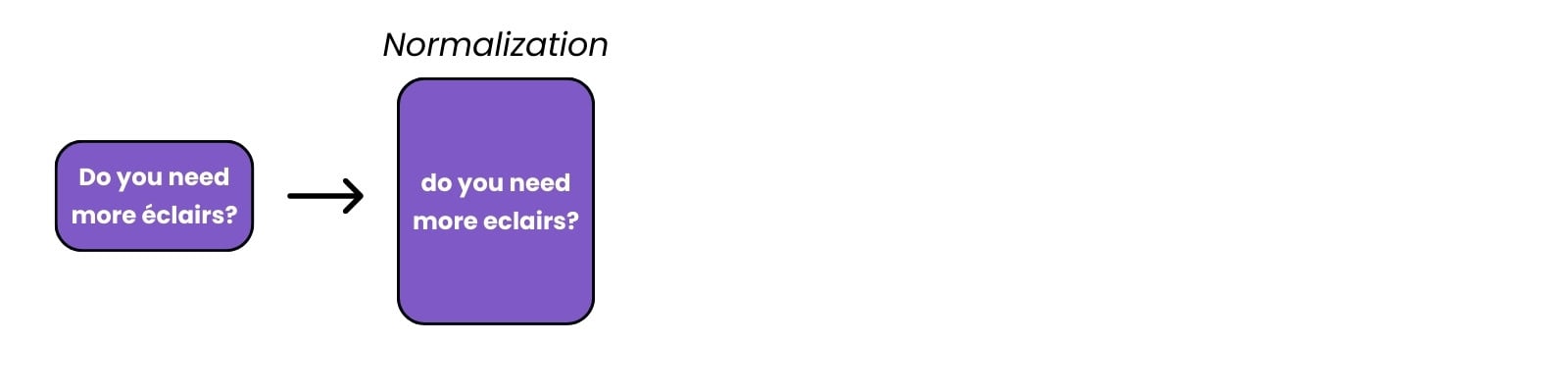

Tekst preprocesen

- Tokenizer: zet tekst → modelinput

- Normaliseren: lowercasing, speciale tekens verwijderen, extra witruimte verwijderen

Tekst preprocesen

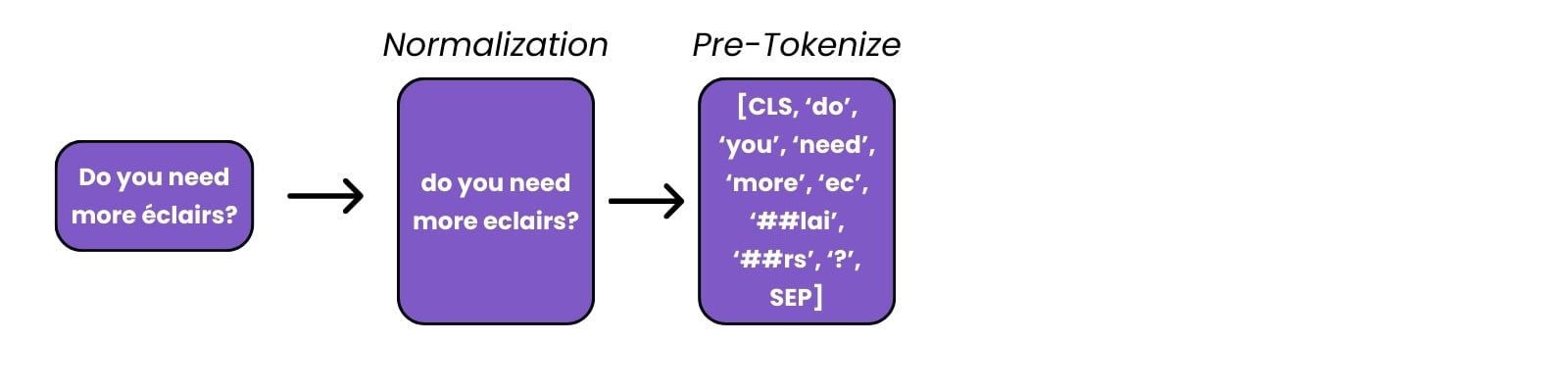

- Tokenizer: zet tekst → modelinput

- Normaliseren: lowercasing, speciale tekens verwijderen, extra witruimte verwijderen

- (Pre-)tokenization: tekst splitsen in (sub)woorden

Tekst preprocesen

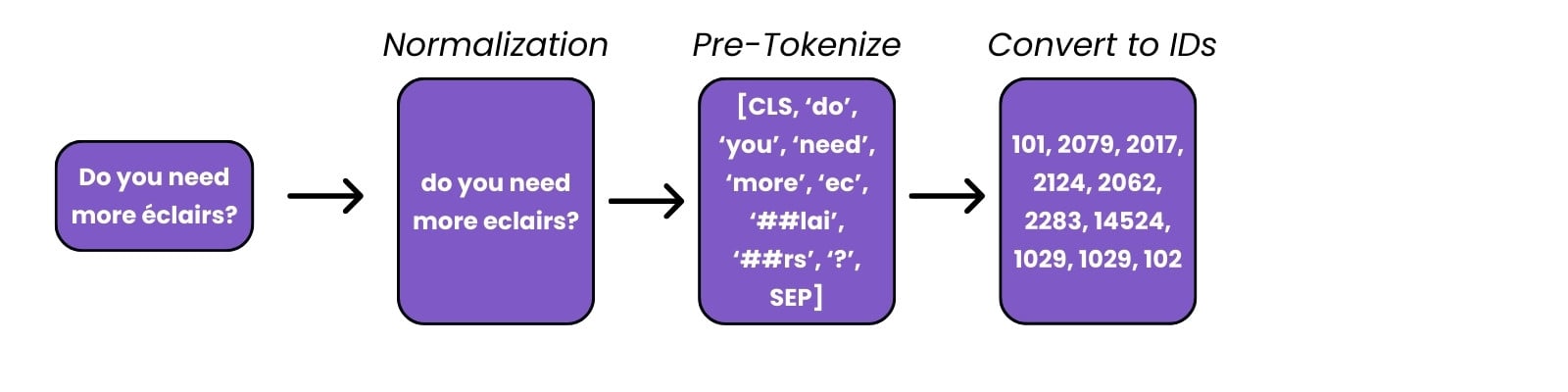

- Tokenizer: zet tekst → modelinput

- Normaliseren: lowercasing, speciale tekens en witruimte verwijderen

- (Pre-)tokenization: tekst splitsen in (sub)woorden

- ID-conversie: tokens naar gehele getallen m.b.v. een vocabulaire

Tekst preprocesen

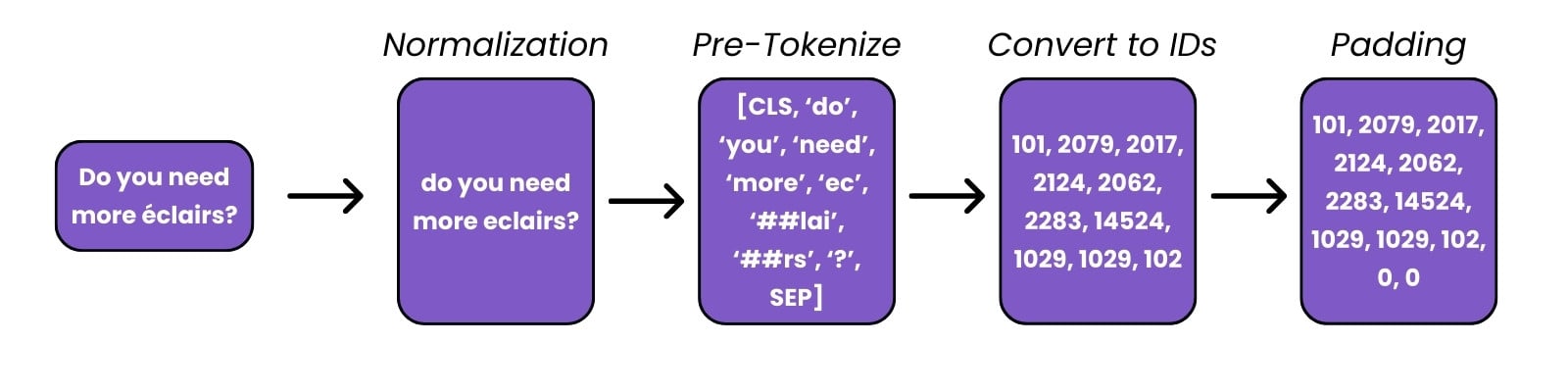

- Tokenizer: zet tekst → modelinput

- Normaliseren: lowercasing, speciale tekens en witruimte verwijderen

- (Pre-)tokenization: tekst splitsen in (sub)woorden

- ID-conversie: tokens naar gehele getallen m.b.v. een vocabulaire

- Padding: extra tokens toevoegen voor gelijke lengte

Tekst preprocesen

from transformers import AutoTokenizer tokenizer = AutoTokenizer.from_pretrained('distilbert/distilbert-base-uncased')text = "Do you need more éclairs?"print(tokenizer.backend_tokenizer.normalizer.normalize_str(text))

do you need more eclairs

tokenizer(text, return_tensors='pt', padding=True)

{'input_ids': tensor([[ 101, ..., 102]]), ...}

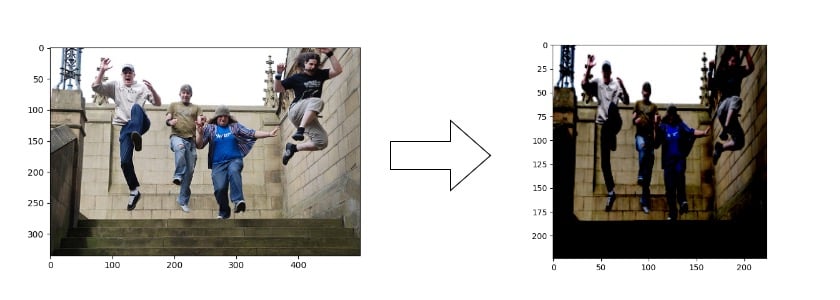

Afbeeldingen preprocesen

- Normaliseren: pixelintensiteit aanpassen

- Resizen: afstemmen op inputlaag van model

- Vuistregel → gebruik preprocessing van het originele model

1 https://huggingface.co/datasets/nlphuji/flickr30k

Afbeeldingen preprocesen

Multimodale taken vereisen consistente preprocessing:

from transformers import BlipProcessor, BlipForConditionalGenerationcheckpoint = "Salesforce/blip-image-captioning-base"model = BlipForConditionalGeneration.from_pretrained(checkpoint) processor = BlipProcessor.from_pretrained(checkpoint)

Encode afbeelding → transformeer naar tekstencoding → decodeer tekst

image = load_dataset("nlphuji/flickr30k")['test'][11]["image"] inputs = processor(images=image, return_tensors="pt")output = model.generate(**inputs)print(processor.decode(output[0]))

[{'generated_text': 'a group of people jumping'}]

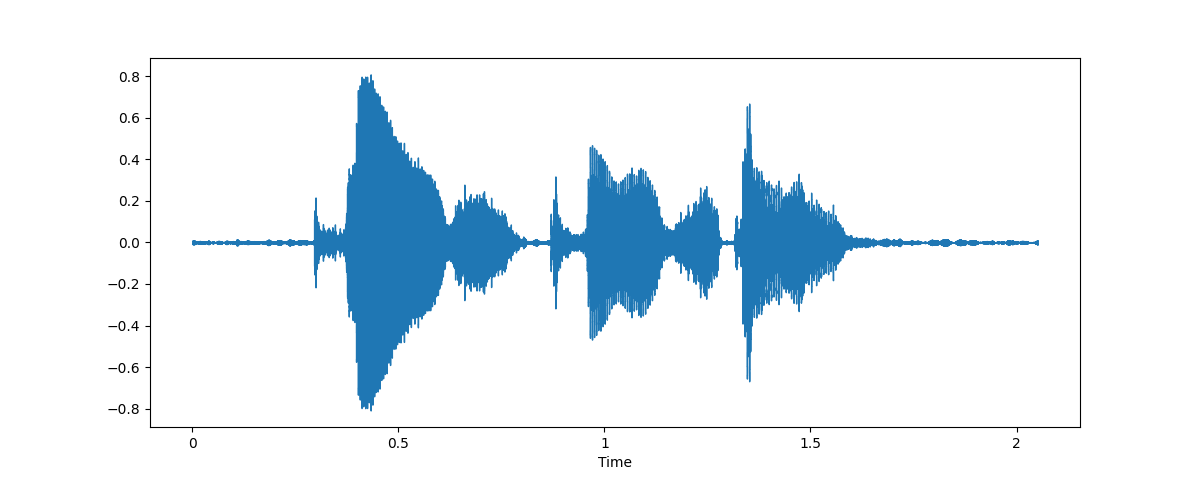

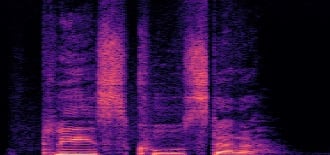

Audio preprocesen

- Audio-preprocessing:

- Sequentiële array → filter/padding

- Samplefrequentie → resampling

Feature-extractie als modelinput (spectrogram)

Audio preprocesen

from datasets import load_dataset, Audiodataset = load_dataset("CSTR-Edinburgh/vctk")["train"] dataset = dataset.cast_column("audio", Audio(sampling_rate=16_000))

- Modelspecifieke, volledige preprocessors zijn beschikbaar:

from transformers import AutoProcessor

processor = AutoProcessor.from_pretrained("openai/whisper-small")

audio_pp = processor(dataset[0]["audio"]["array"],

sampling_rate=16_000, return_tensors="pt")

- Samplefrequentie moet aansluiten op modelinput

1 https://huggingface.co/datasets/CSTR-Edinburgh/vctk

Laten we oefenen!

Multi-modale modellen met Hugging Face