Mengenal fungsi aktivasi

Pengantar Deep Learning dengan PyTorch

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

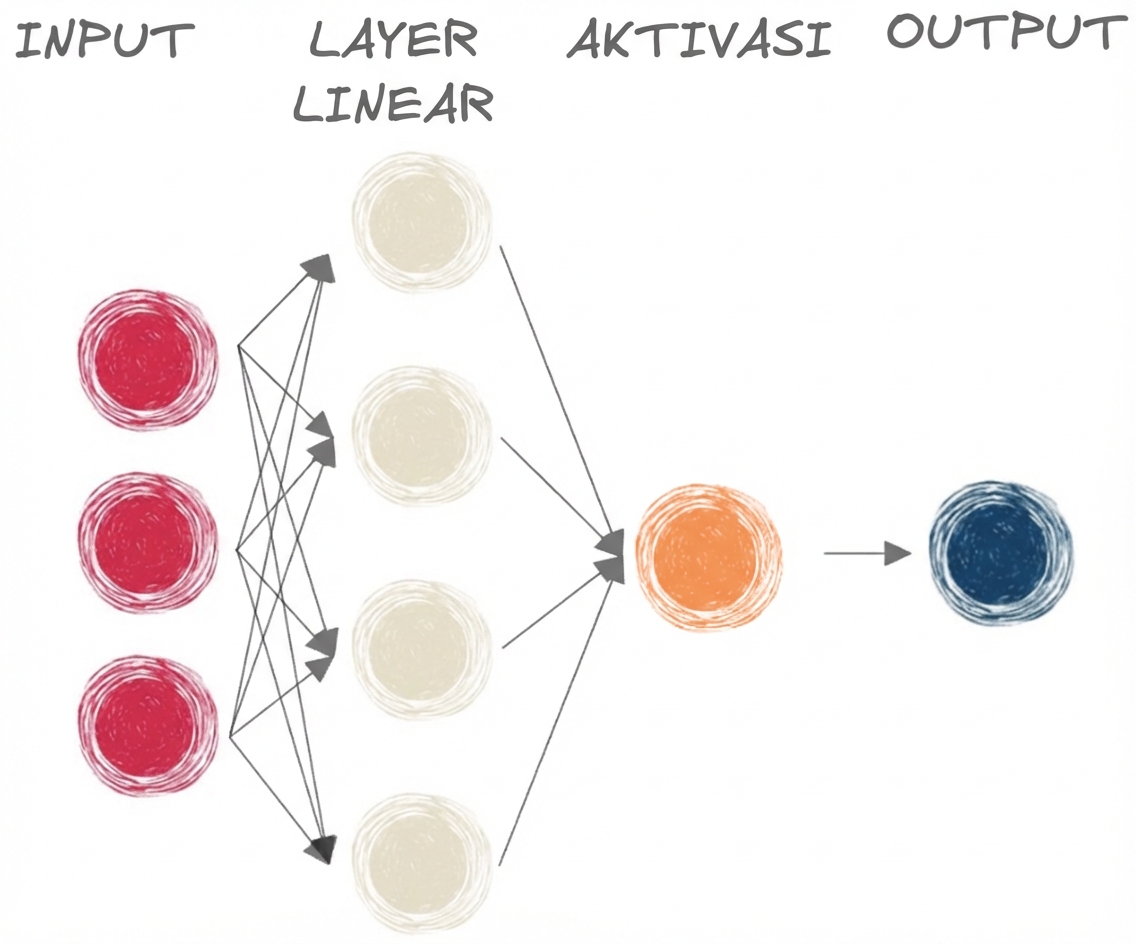

Fungsi aktivasi

$$

- Fungsi aktivasi menambah nonlinearitas pada jaringan

- Sigmoid untuk klasifikasi biner

- Softmax untuk klasifikasi multi-kelas

- Nonlinearitas memungkinkan belajar hubungan yang lebih kompleks

- Keluaran "pra-aktivasi" diteruskan ke fungsi aktivasi

Mengenal fungsi sigmoid

- Mamalia atau bukan?

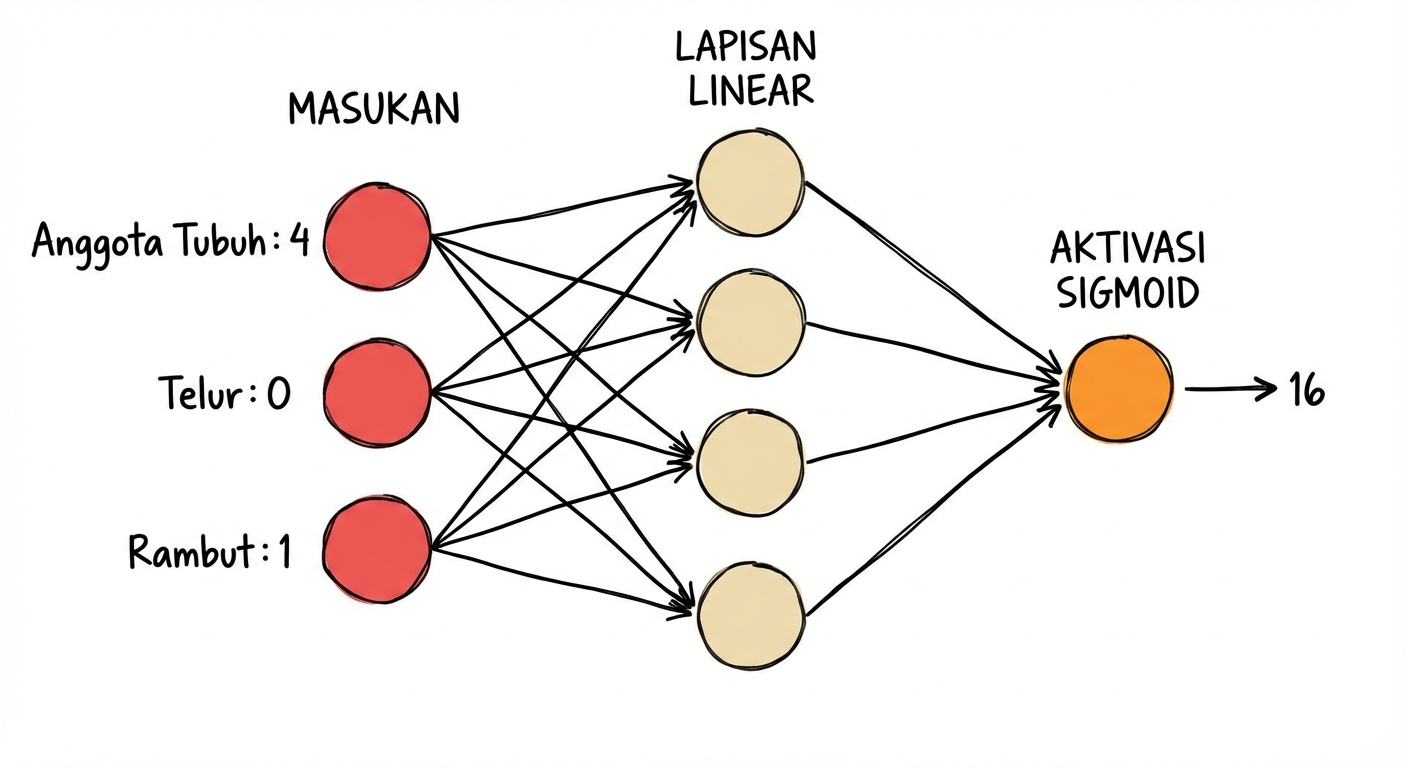

Mengenal fungsi sigmoid

- Mamalia atau bukan?

- Masukan:

- Kaki: 4

- Telur: 0

- Bulu: 1

Mengenal fungsi sigmoid

- Mamalia atau bukan?

- Keluaran ke layer linear adalah 6

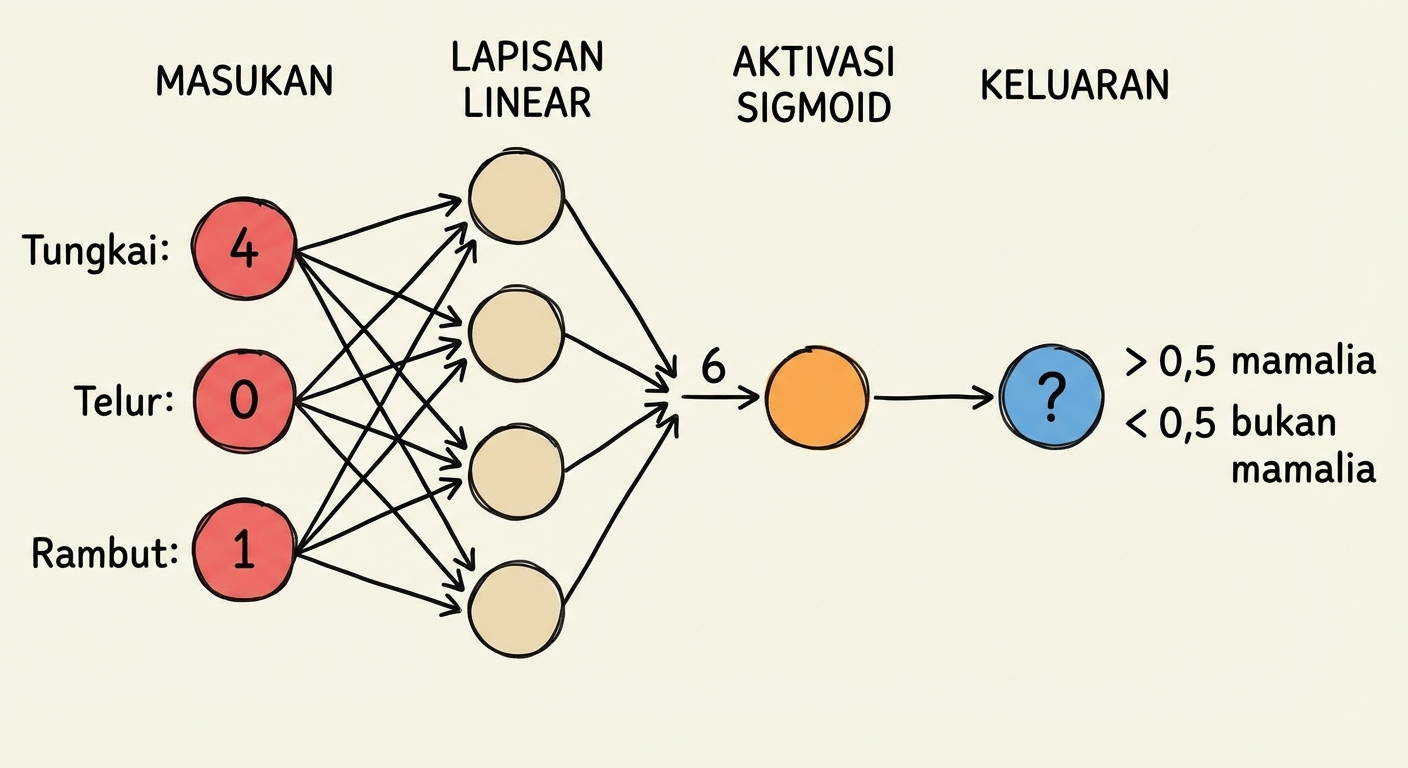

Mengenal fungsi sigmoid

- Mamalia atau bukan?

- Ambil keluaran pra-aktivasi (6) lalu masukkan ke fungsi sigmoid

Mengenal fungsi sigmoid

- Mamalia atau bukan?

- Ambil keluaran pra-aktivasi (6) lalu masukkan ke fungsi sigmoid

Hasilkan nilai antara 0 dan 1

Jika keluaran > 0,5, label kelas = 1 (mamalia)

- Jika keluaran <= 0,5, label kelas = 0 (bukan mamalia)

Mengenal fungsi sigmoid

import torch import torch.nn as nn input_tensor = torch.tensor([[6]]) sigmoid = nn.Sigmoid()output = sigmoid(input_tensor) print(output)

tensor([[0.9975]])

Aktivasi sebagai layer terakhir

model = nn.Sequential(

nn.Linear(6, 4), # First linear layer

nn.Linear(4, 1), # Second linear layer

nn.Sigmoid() # Sigmoid activation function

)

Sigmoid sebagai langkah terakhir pada jaringan layer linear setara dengan regresi logistik tradisional

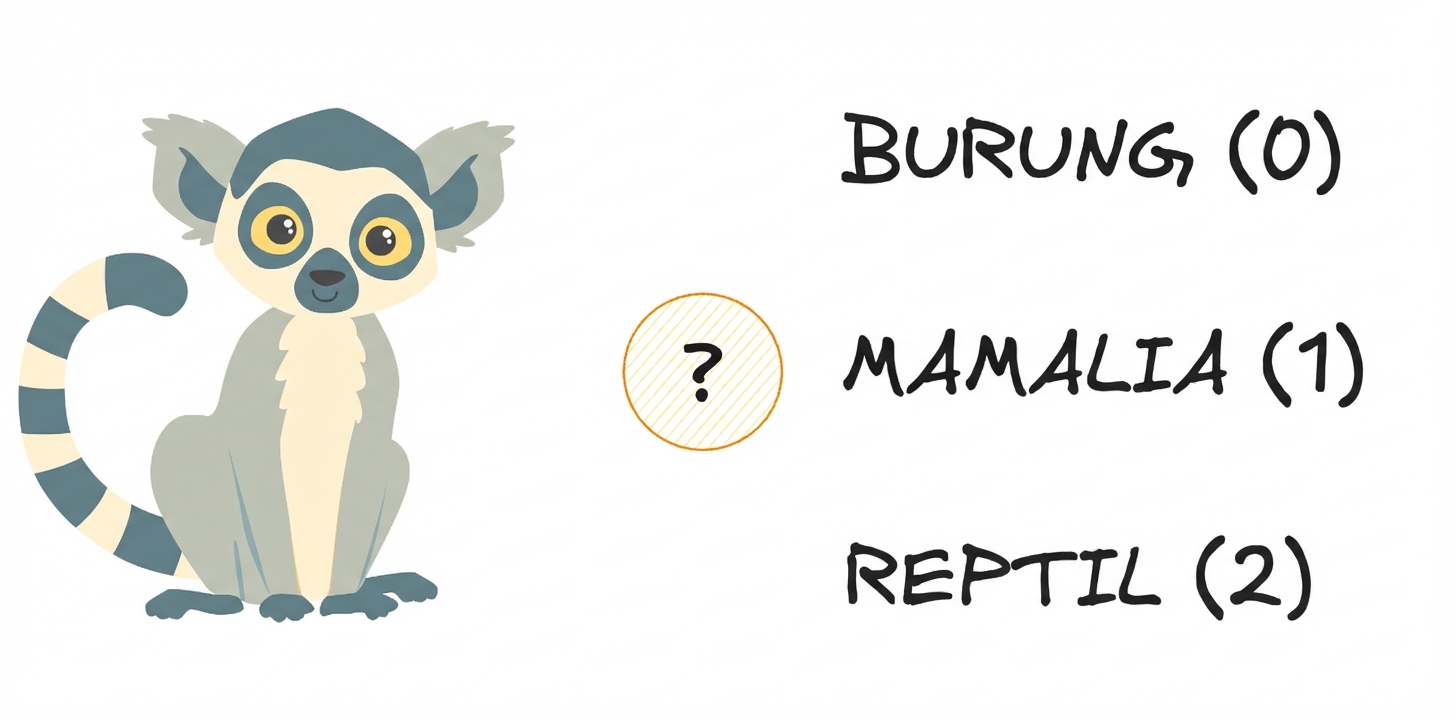

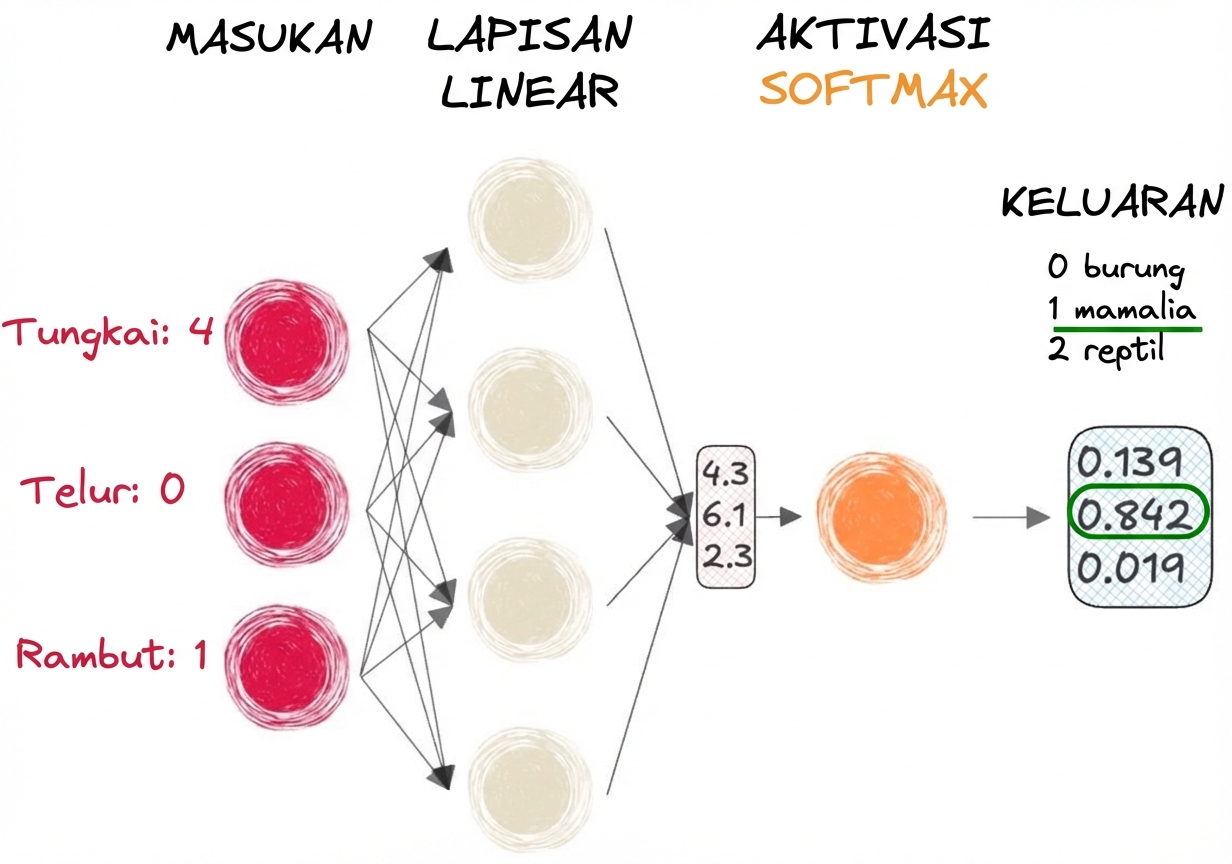

Mengenal softmax

- Tiga kelas:

Mengenal softmax

- Tiga kelas:

Mengenal softmax

- Tiga kelas:

Mengenal softmax

- Tiga kelas:

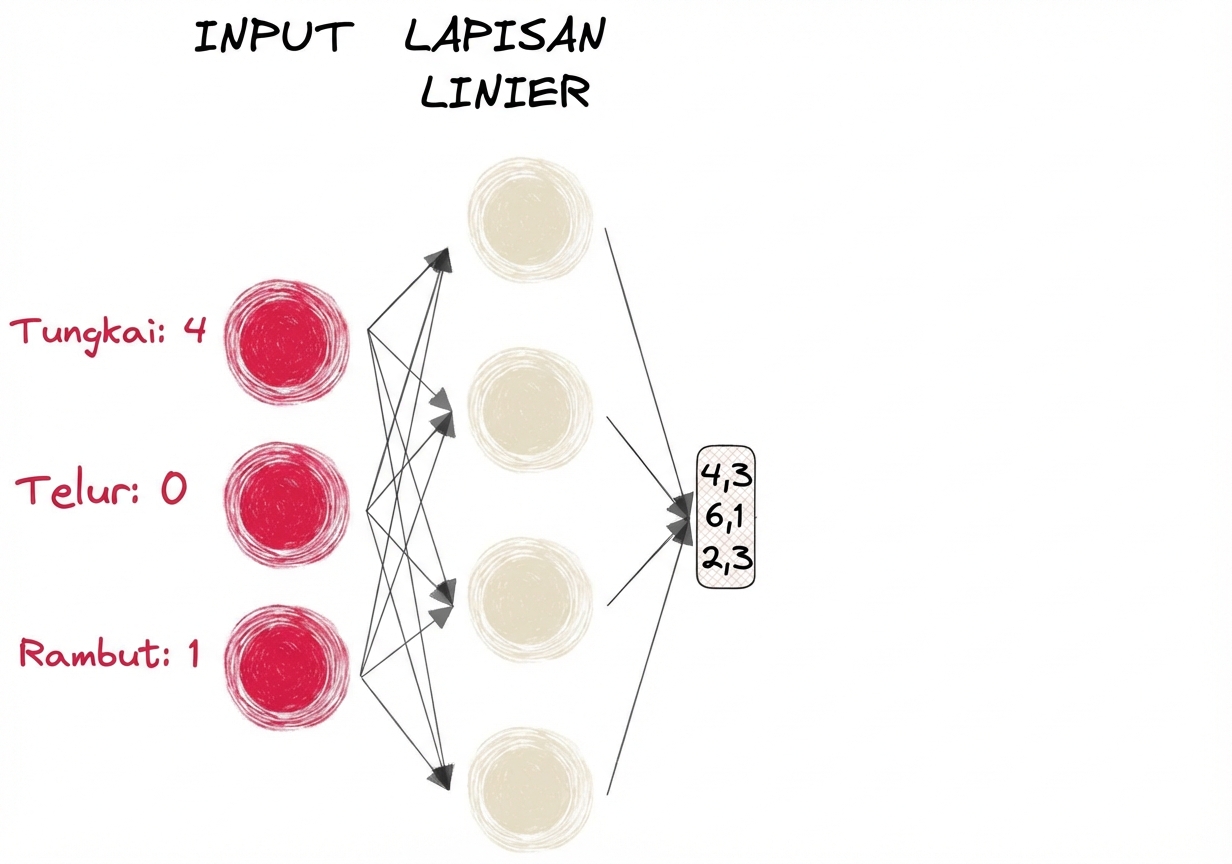

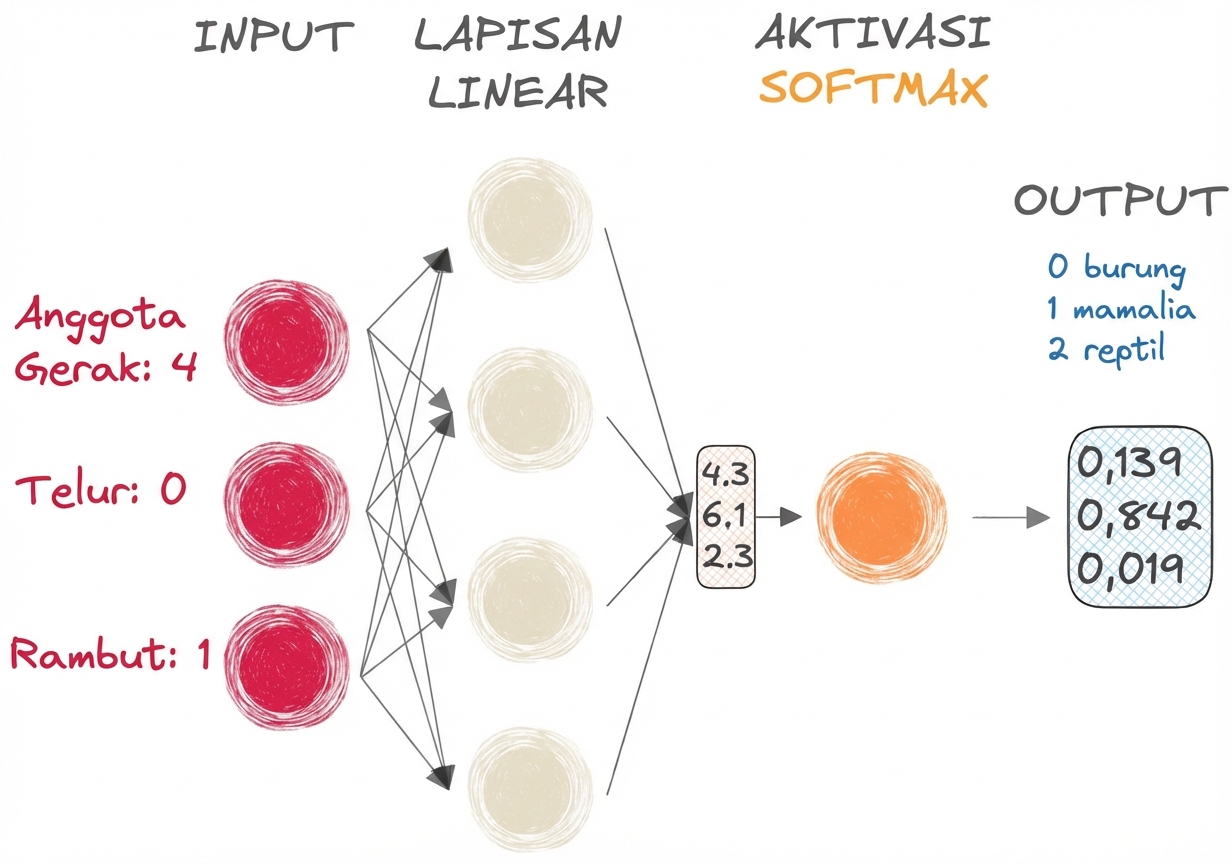

Mengenal softmax

- Menerima masukan berdimensi tiga dan mengeluarkan bentuk yang sama

Mengenal softmax

- Menerima masukan berdimensi tiga dan mengeluarkan bentuk yang sama

- Menghasilkan sebaran probabilitas:

- Tiap elemen adalah probabilitas (dibatasi antara 0 dan 1)

- Jumlah vektor keluaran sama dengan 1

Mengenal softmax

- Menerima masukan berdimensi tiga dan mengeluarkan bentuk yang sama

- Menghasilkan sebaran probabilitas:

- Tiap elemen adalah probabilitas (dibatasi antara 0 dan 1)

- Jumlah vektor keluaran sama dengan 1

Mengenal softmax

import torch import torch.nn as nn # Create an input tensor input_tensor = torch.tensor( [[4.3, 6.1, 2.3]]) # Apply softmax along the last dimensionprobabilities = nn.Softmax(dim=-1) output_tensor = probabilities(input_tensor) print(output_tensor)

tensor([[0.1392, 0.8420, 0.0188]])

dim = -1menunjukkan softmax diterapkan pada dimensi terakhir tensor masukannn.Softmax()dapat dipakai sebagai langkah terakhir dalamnn.Sequential()

Ayo berlatih!

Pengantar Deep Learning dengan PyTorch