Fungsi aktivasi ReLU

Pengantar Deep Learning dengan PyTorch

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

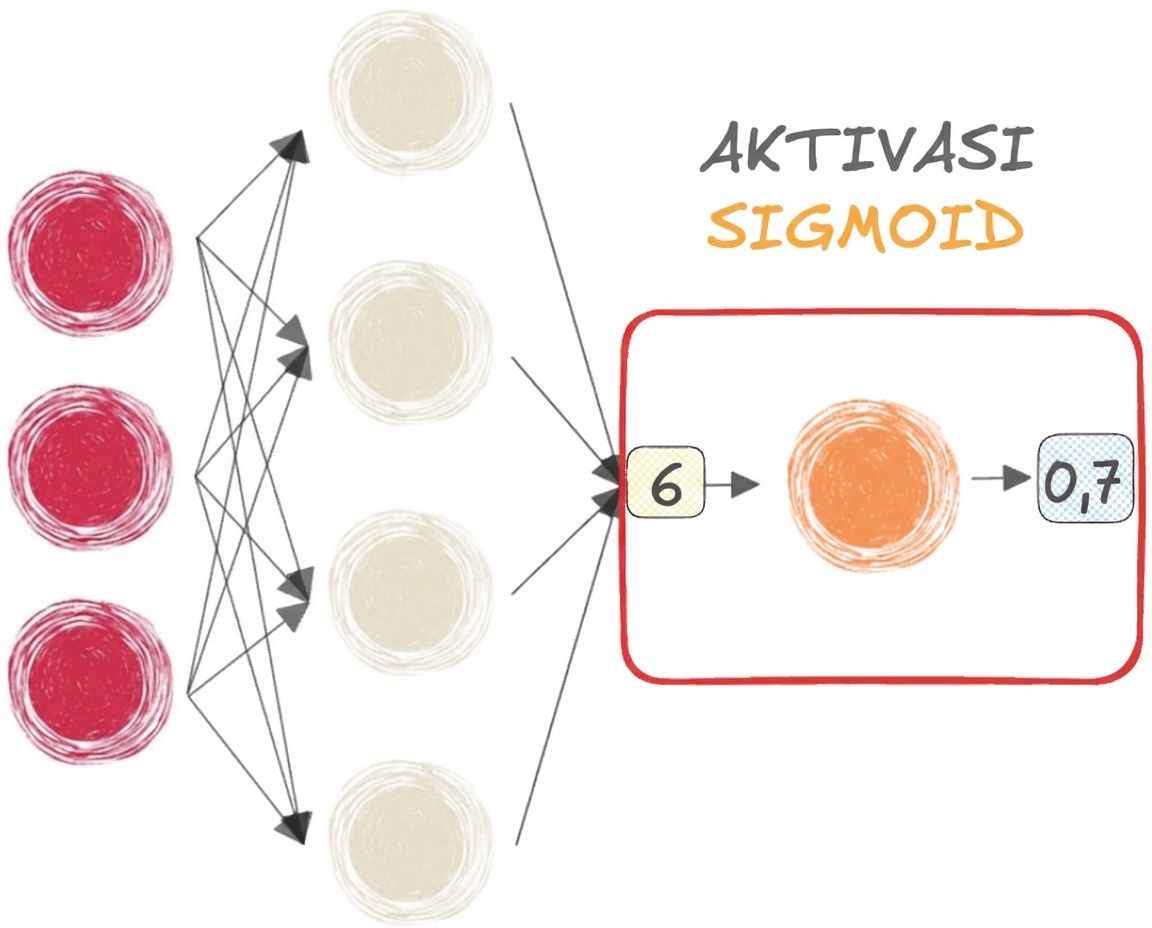

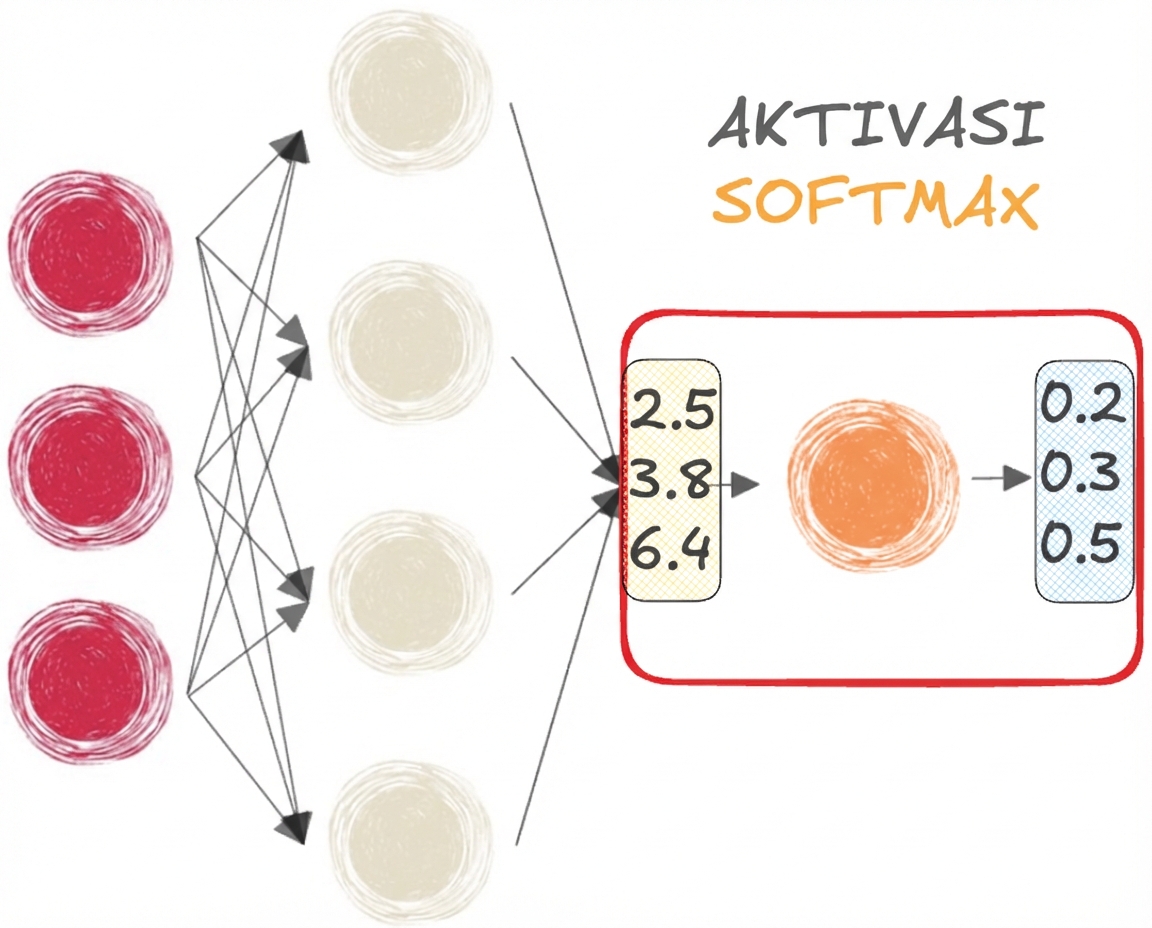

Fungsi sigmoid dan softmax

$$

- SIGMOID untuk klasifikasi BINER

$$

- SOFTMAX untuk klasifikasi MULTI-KELAS

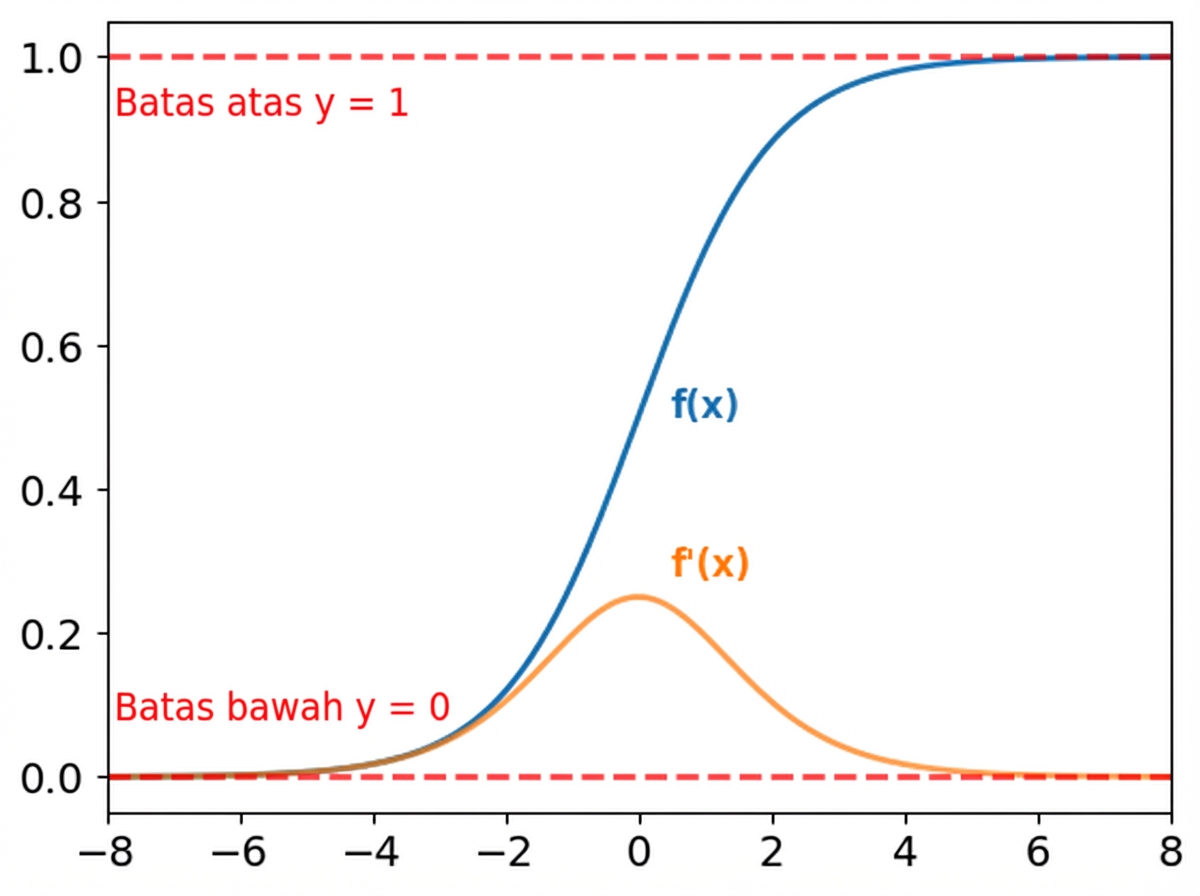

Keterbatasan fungsi sigmoid dan softmax

Fungsi sigmoid:

- Keluaran dibatasi antara 0 dan 1

- Dapat dipakai di mana saja dalam jaringan

Gradien:

- Sangat kecil untuk nilai x besar maupun kecil

- Menyebabkan saturasi, memicu masalah gradien hilang

$$

Fungsi softmax juga mengalami saturasi

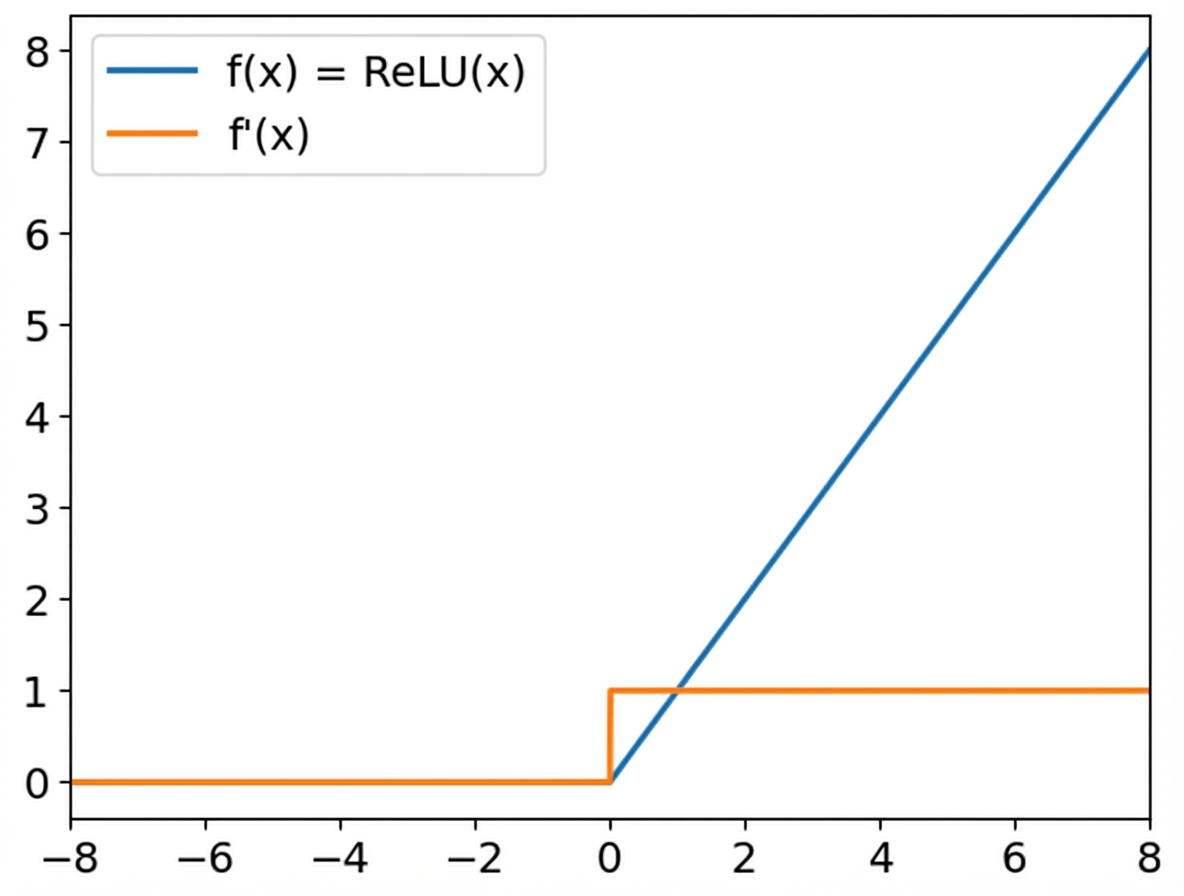

ReLU

Rectified Linear Unit (ReLU):

f(x) = max(x, 0)- Untuk input positif: keluaran sama dengan input

- Untuk input negatif: keluaran 0

- Membantu mengatasi gradien hilang

$$

Di PyTorch:

relu = nn.ReLU()

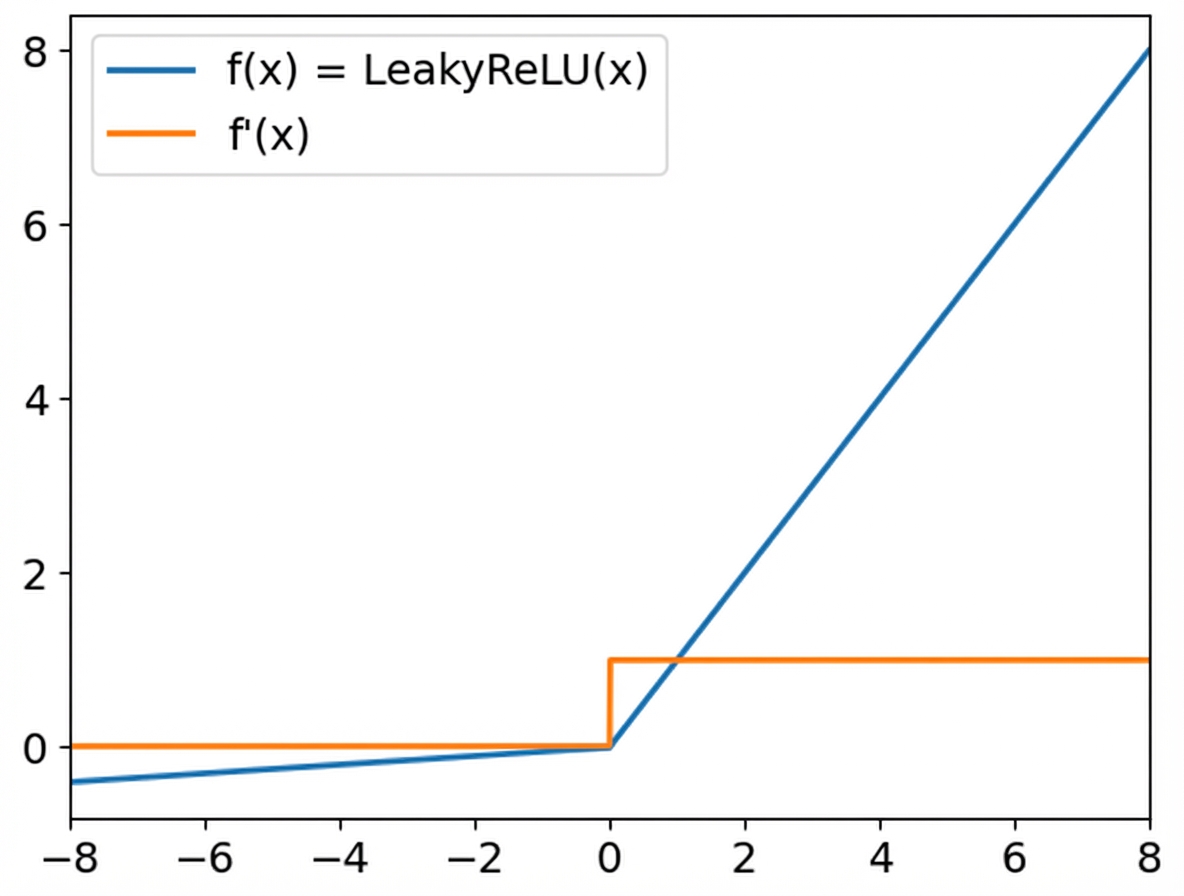

Leaky ReLU

Leaky ReLU:

- Input positif berperilaku seperti ReLU

- Input negatif diskalakan dengan koefisien kecil (default 0,01)

- Gradien untuk input negatif tidak nol

$$

Di PyTorch:

leaky_relu = nn.LeakyReLU(

negative_slope = 0.05)

Ayo berlatih!

Pengantar Deep Learning dengan PyTorch