Laju belajar dan momentum

Pengantar Deep Learning dengan PyTorch

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

Memperbarui bobot dengan SGD

- Melatih jaringan saraf = menyelesaikan masalah optimisasi.

Optimizer Stochastic Gradient Descent (SGD)

sgd = optim.SGD(model.parameters(), lr=0.01, momentum=0.95)

- Dua argumen:

- learning rate: mengatur besar langkah

- momentum: menambah inersia agar tidak macet

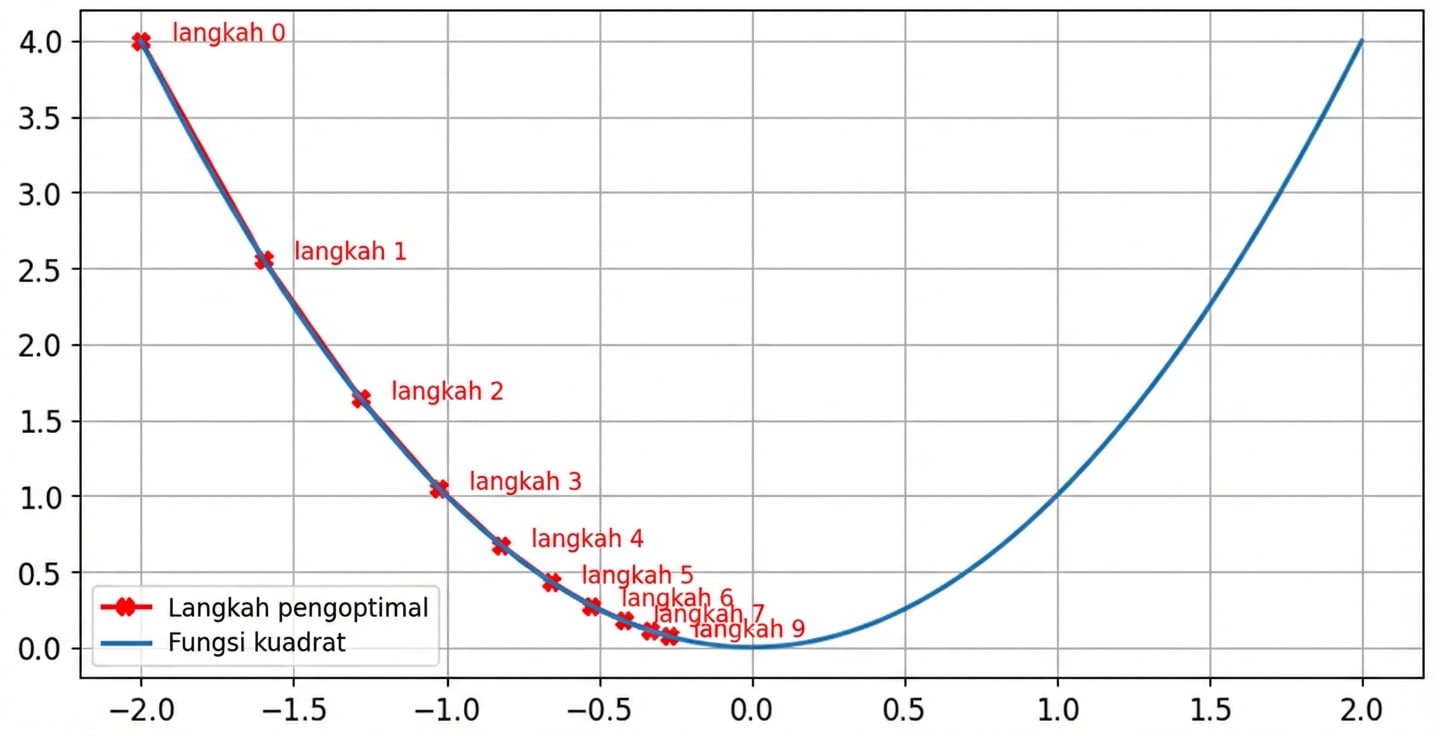

Dampak laju belajar: laju optimal

- Langkah mengecil dekat nol saat gradien makin kecil

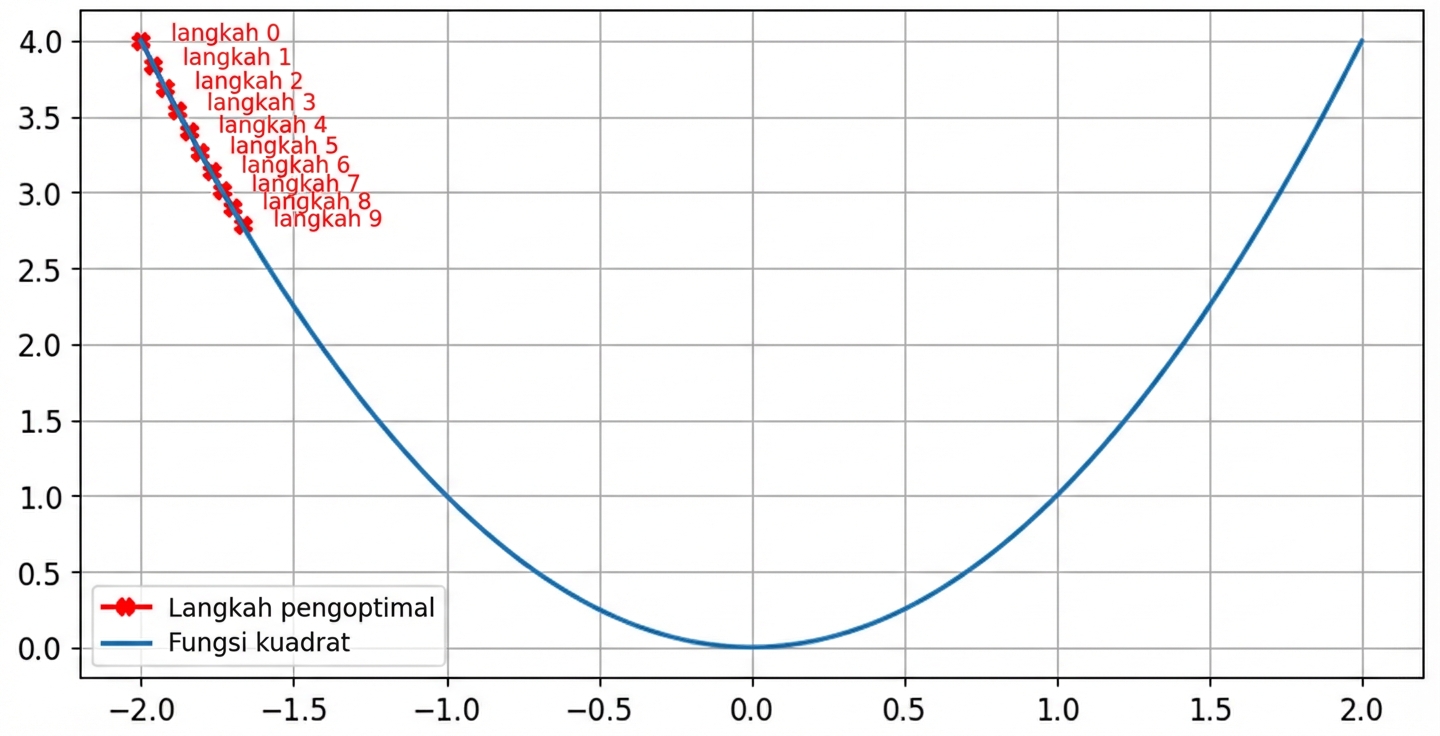

Dampak laju belajar: laju kecil

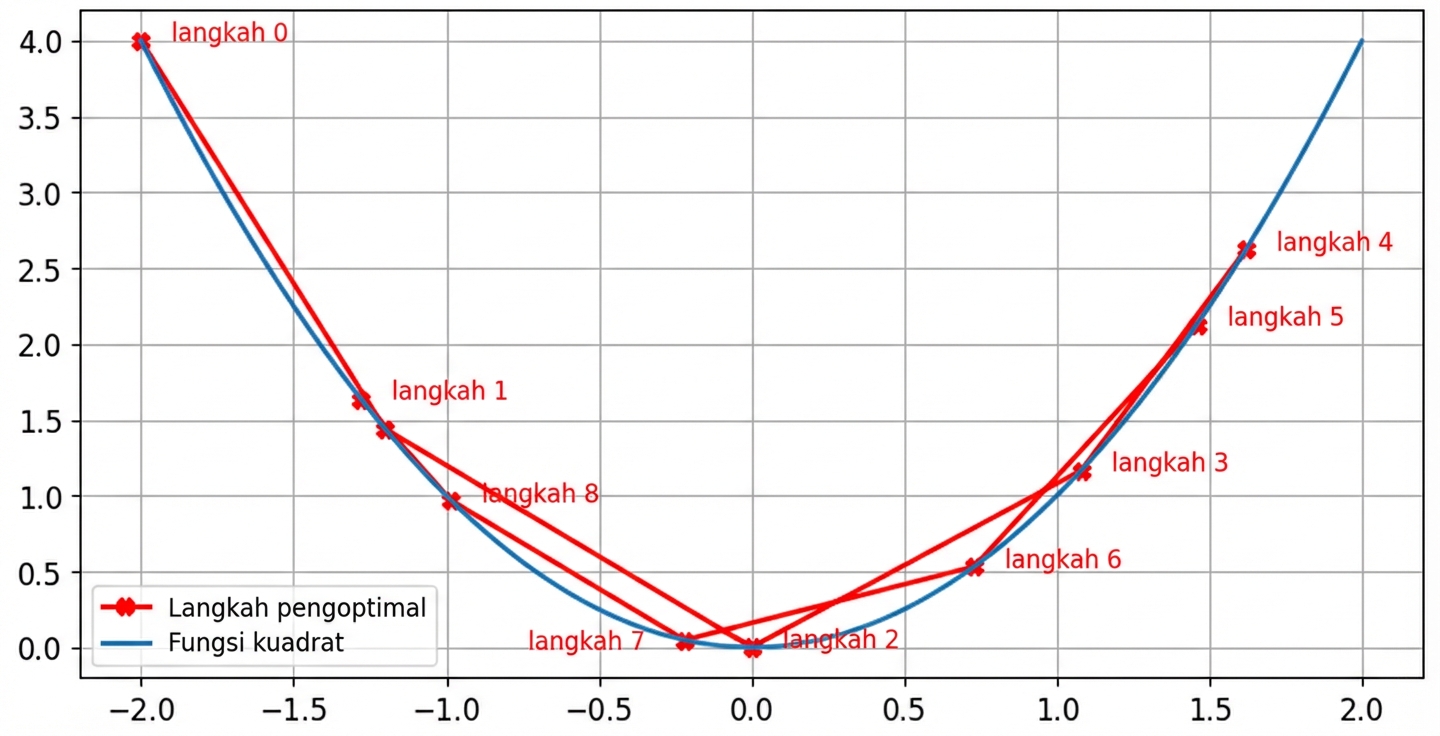

Dampak laju belajar: laju tinggi

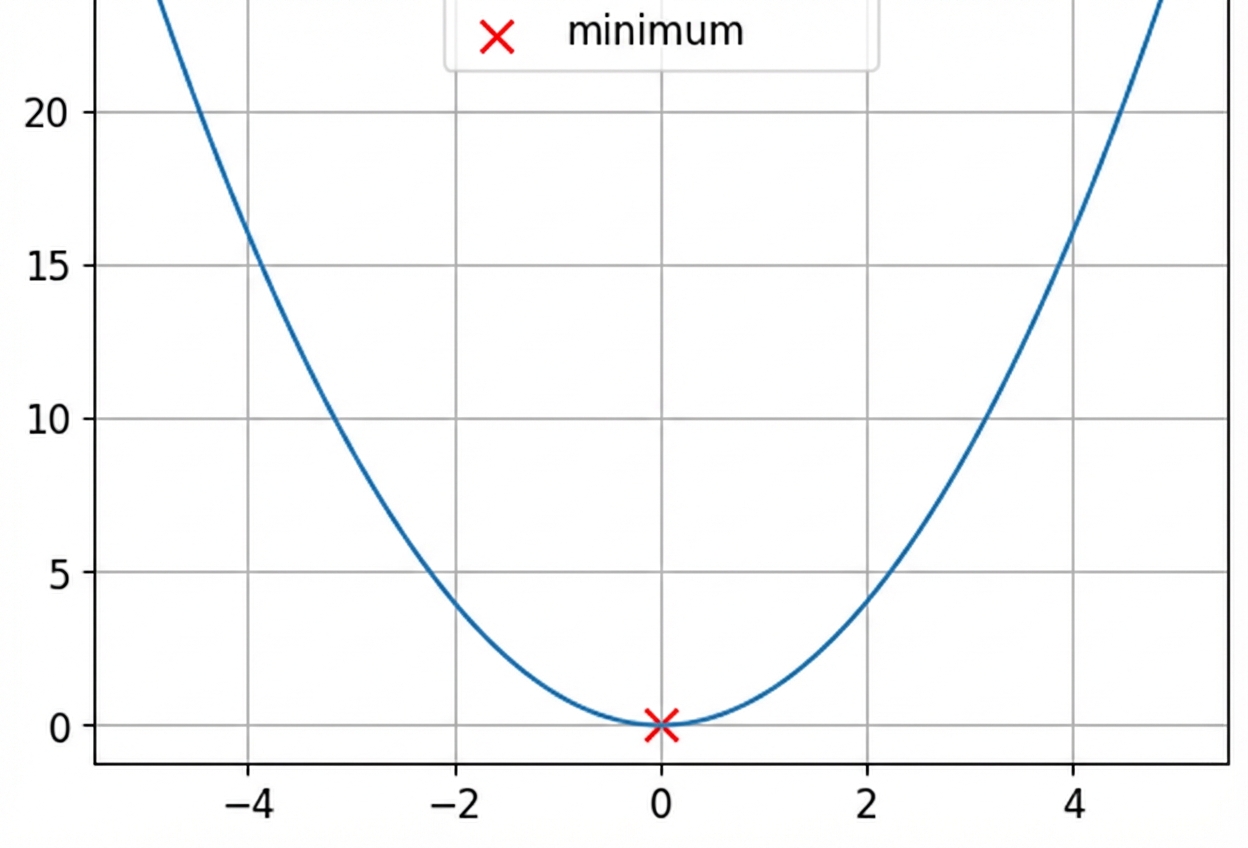

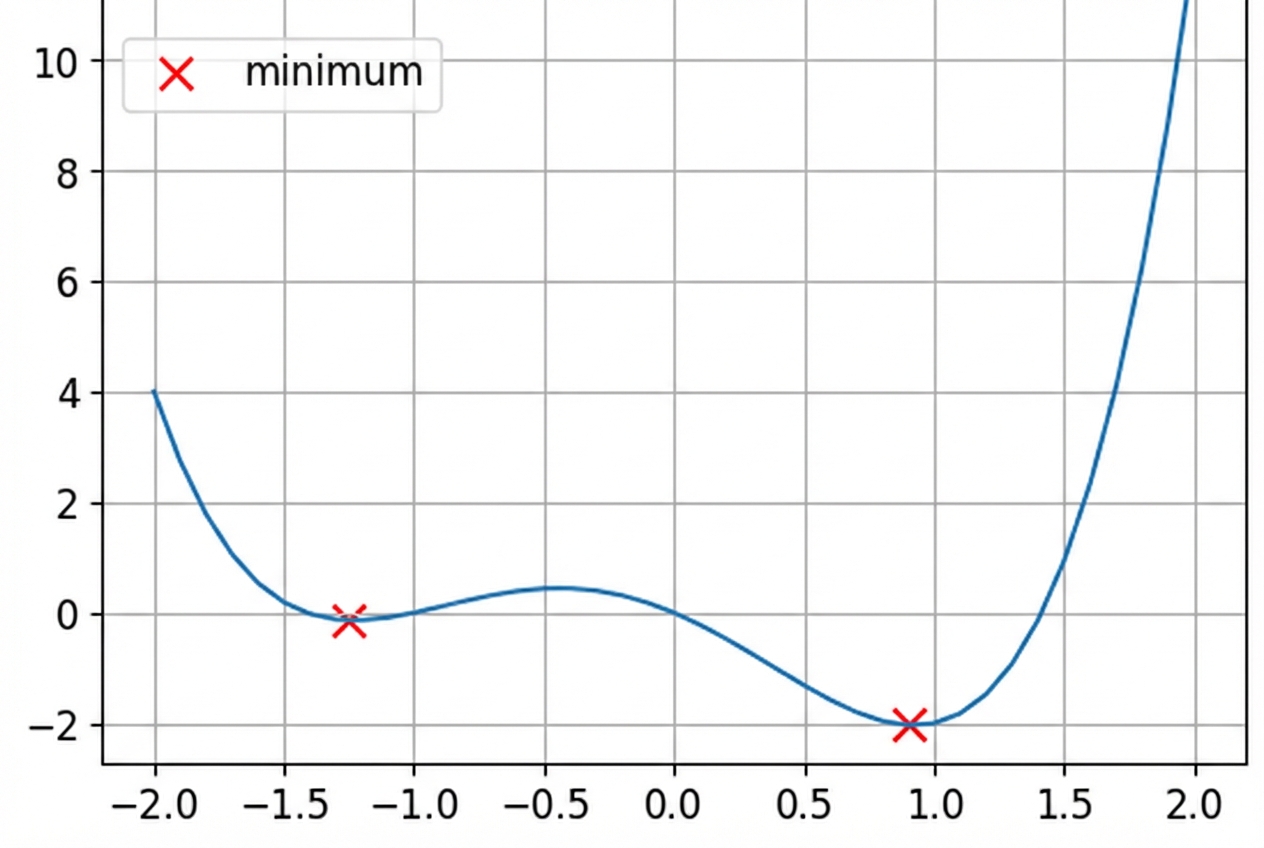

Fungsi cembung vs. tak cembung

Ini adalah fungsi cembung (convex).

Ini adalah fungsi tak cembung (non-convex).

- Fungsi loss umumnya tak cembung

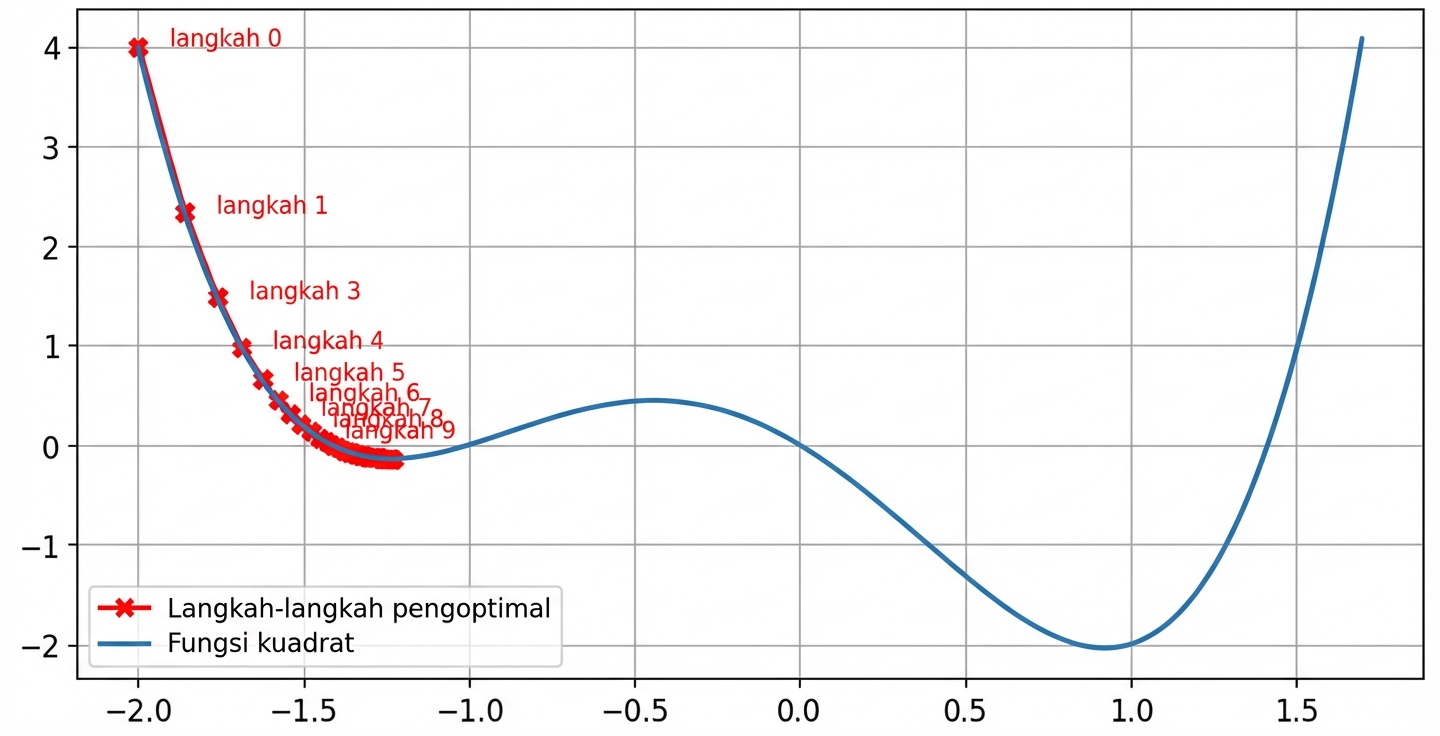

Tanpa momentum

lr = 0.01momentum = 0, setelah 100 langkah minimum ditemukan padax = -1.23dany = -0.14

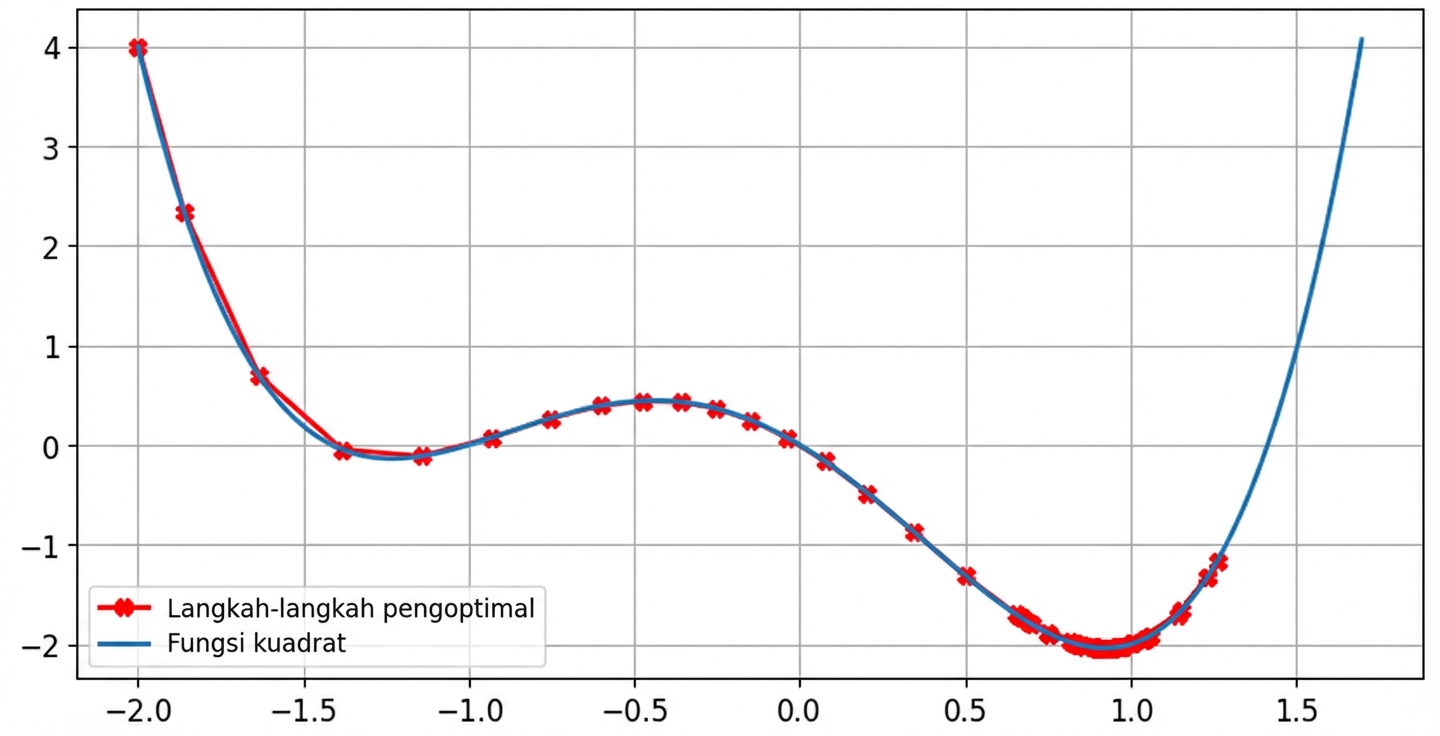

Dengan momentum

lr = 0.01momentum = 0.9, setelah 100 langkah minimum ditemukan padax = 0.92dany = -2.04

Ringkasan

$$

| Laju Belajar | Momentum |

|---|---|

| Mengatur besar langkah | Mengatur inersia |

| Terlalu tinggi → kinerja buruk | Membantu keluar dari minimum lokal |

| Terlalu rendah → pelatihan lambat | Terlalu kecil → optimizer macet |

| Rentang umum: 0.01 ($10^{-2}$) dan 0.0001 ($10^{-4}$) | Rentang umum: 0.85–0.99 |

Ayo berlatih!

Pengantar Deep Learning dengan PyTorch