Fine-tuning lanjutan

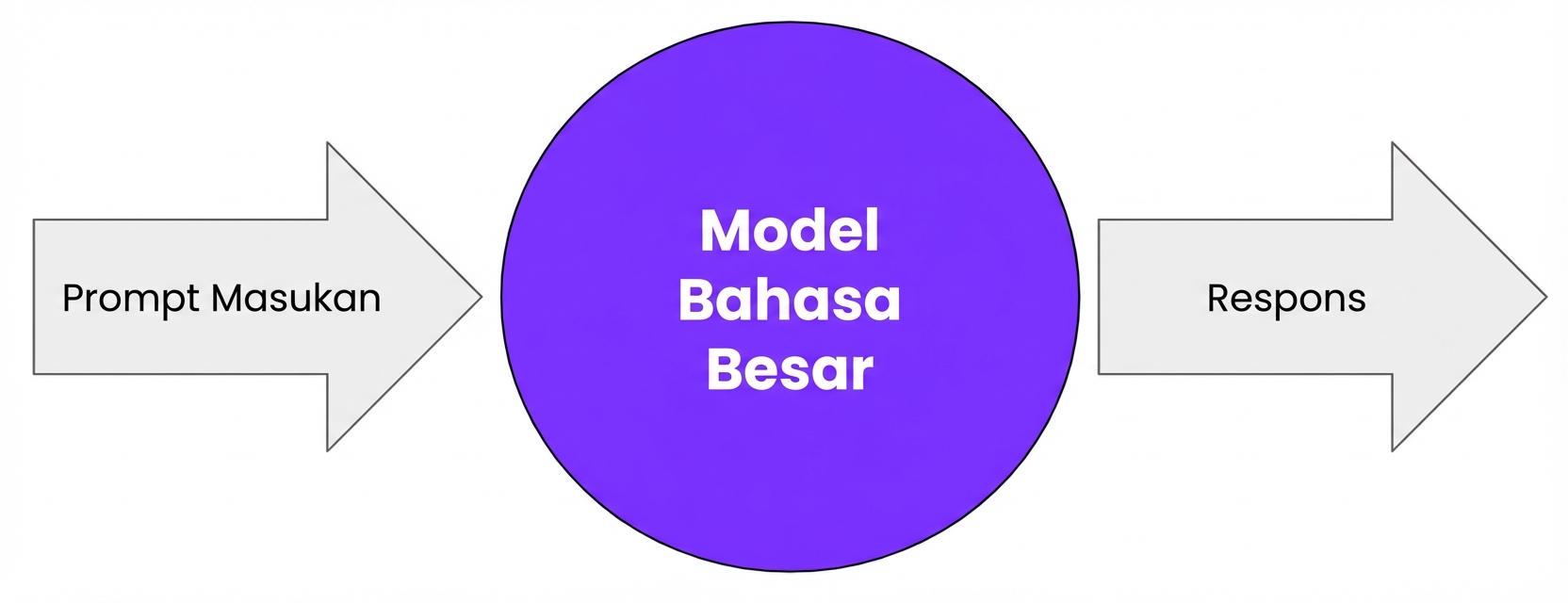

Konsep Large Language Models (LLM)

Vidhi Chugh

AI strategist and ethicist

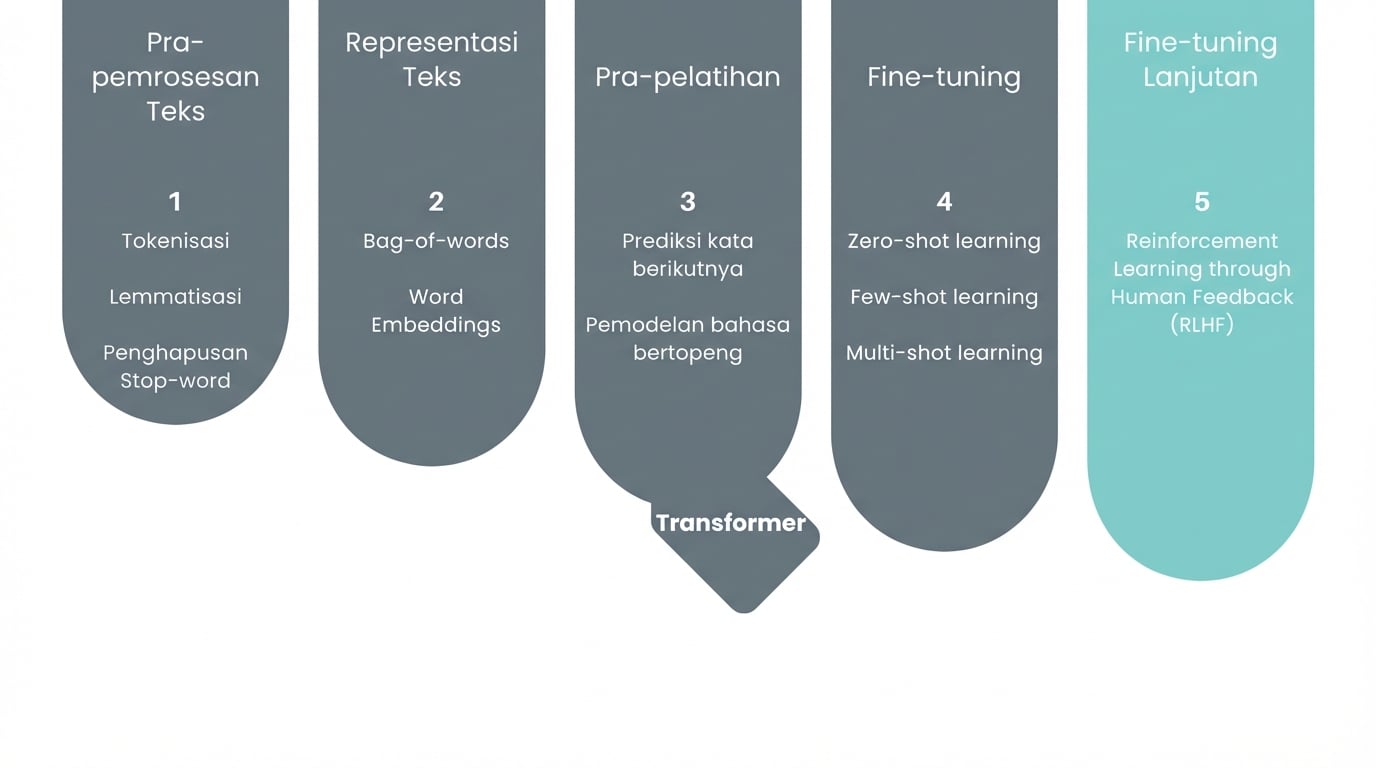

Kita di mana?

Reinforcement Learning melalui Umpan Balik Manusia

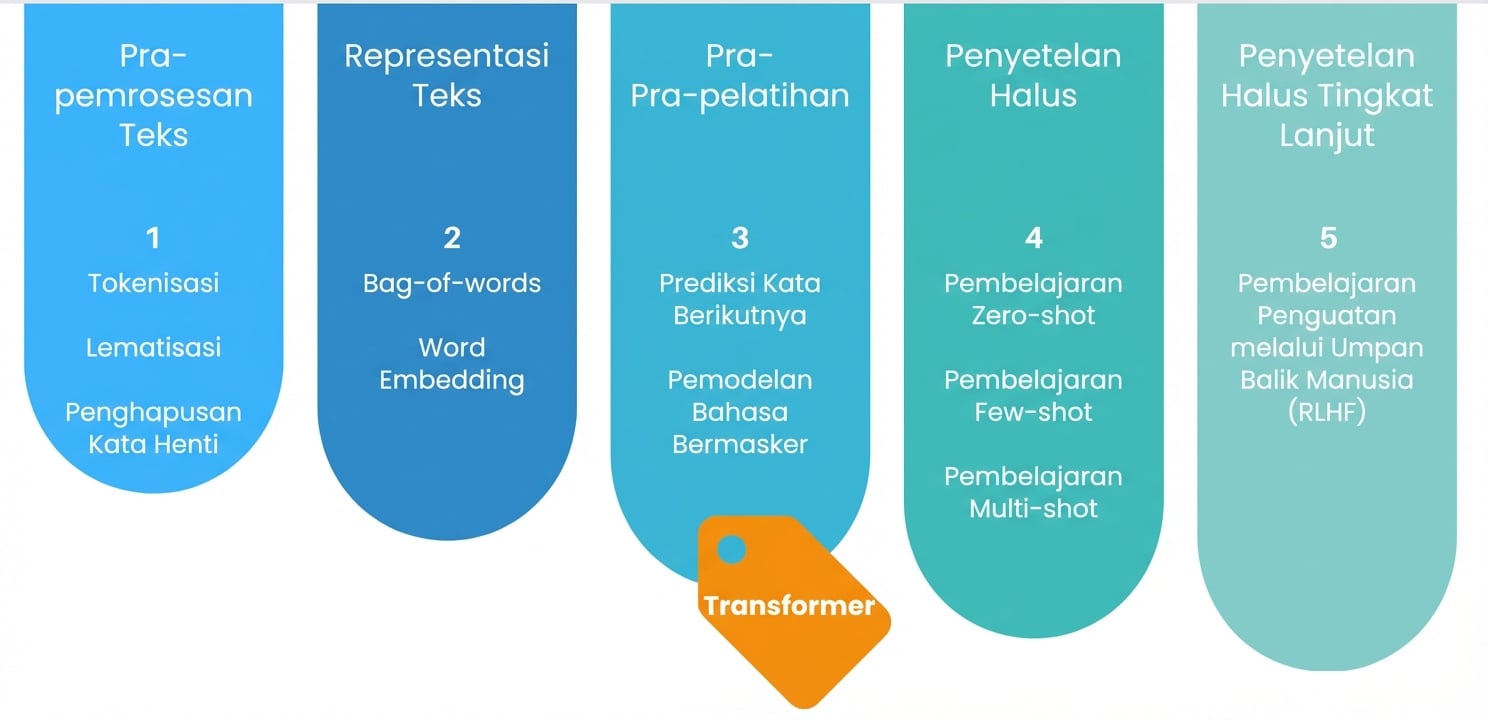

- Pre-training

- Fine-tuning

- Reinforcement Learning through Human Feedback (RLHF)

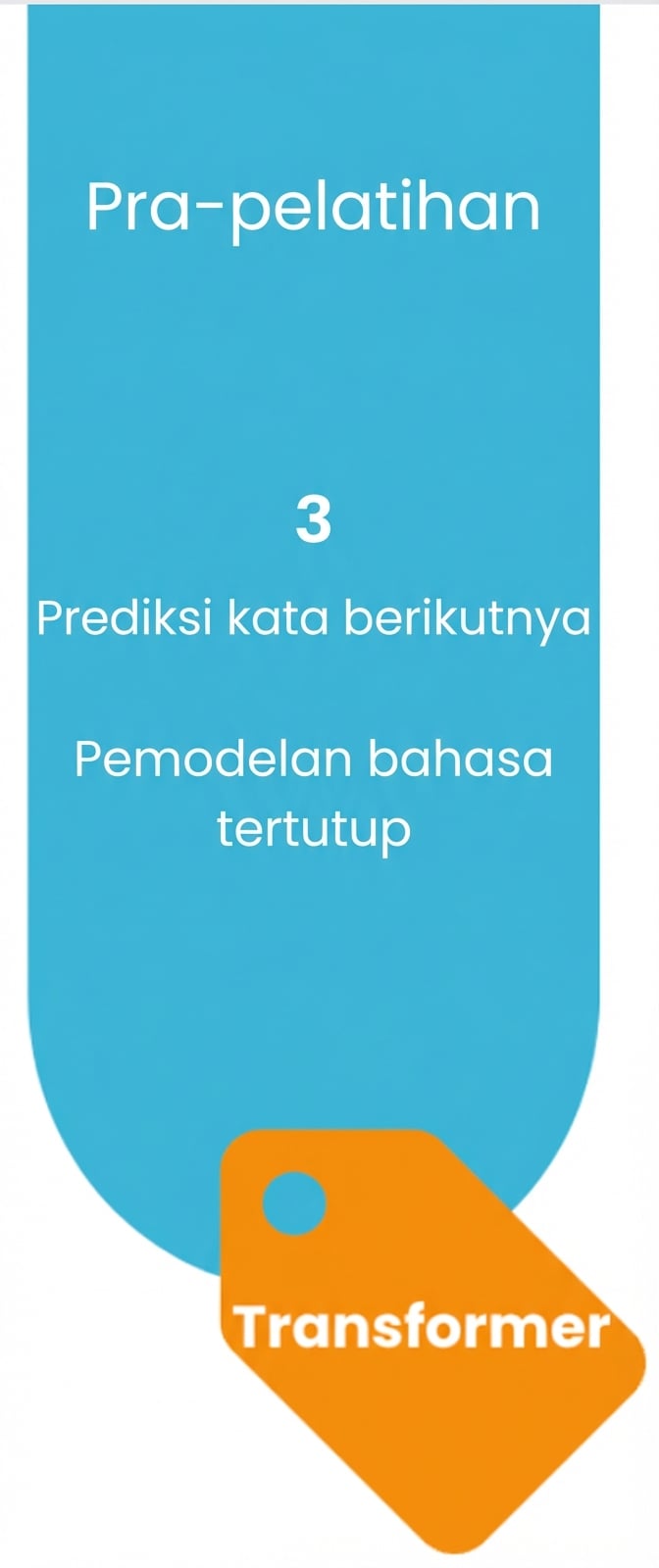

Pre-training

- Data teks dalam jumlah besar:

- Situs web, buku, dan artikel

- Arsitektur Transformer

- Mempelajari pola bahasa umum, tata bahasa, dan fakta

- Prediksi kata berikutnya

- Pemodelan bahasa bertopeng

1 Freepik

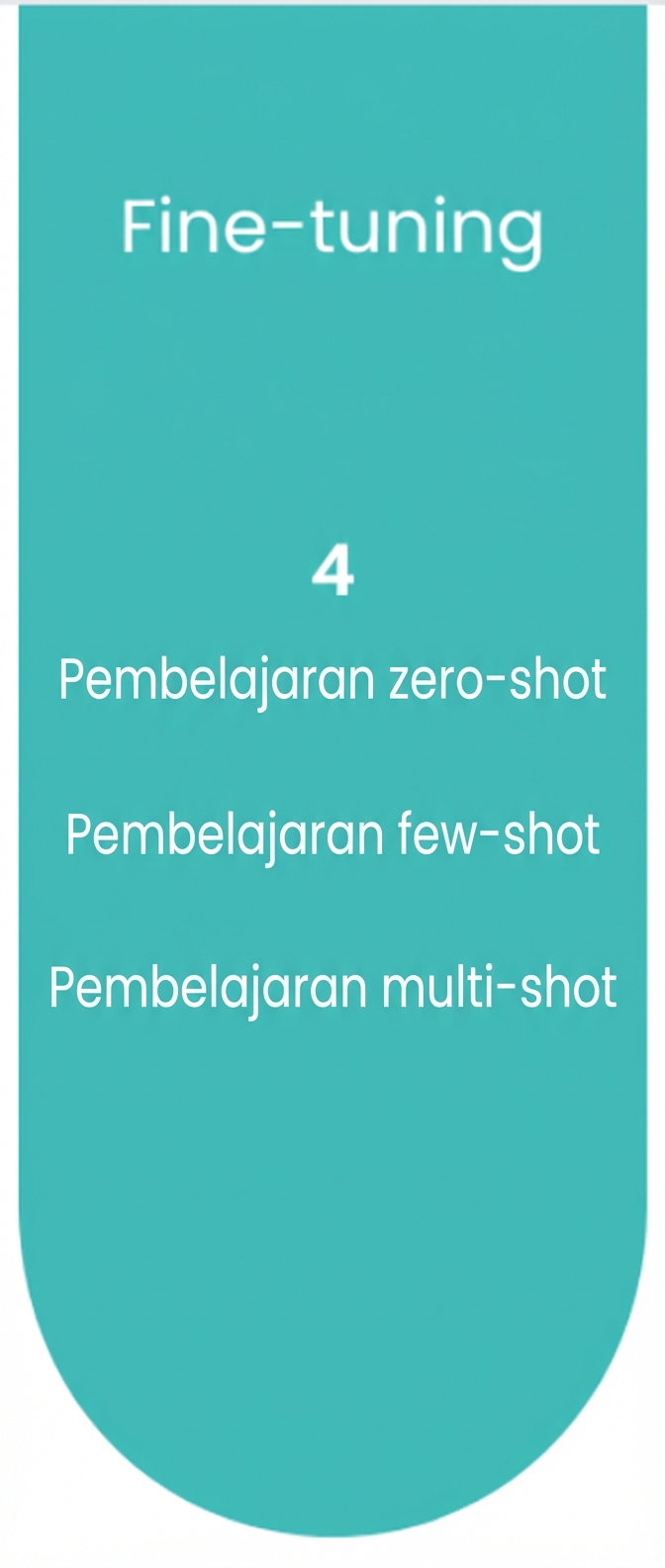

Fine-tuning

- Pelatihan N-shot

- Dataset berlabel kecil untuk tugas terkait

Mengapa RLHF?

- Data pelatihan umum kurang berkualitas

- Noise

- Kesalahan

- Ketidakkonsistenan

- Akurasi menurun

Contoh akurasi menurun:

- Dilatih pada data forum diskusi online

- Opini dan fakta tidak tervalidasi

- Perlu validasi pakar eksternal

Berawal dari kebutuhan fine-tuning

- Pre-training

- Mempelajari pola bahasa dasar

- Tidak menangkap kompleksitas kontekstual

- Fine-tuning

- Data berlabel berkualitas meningkatkan kinerja

- Masuk RLHF!

- Umpan balik manusia

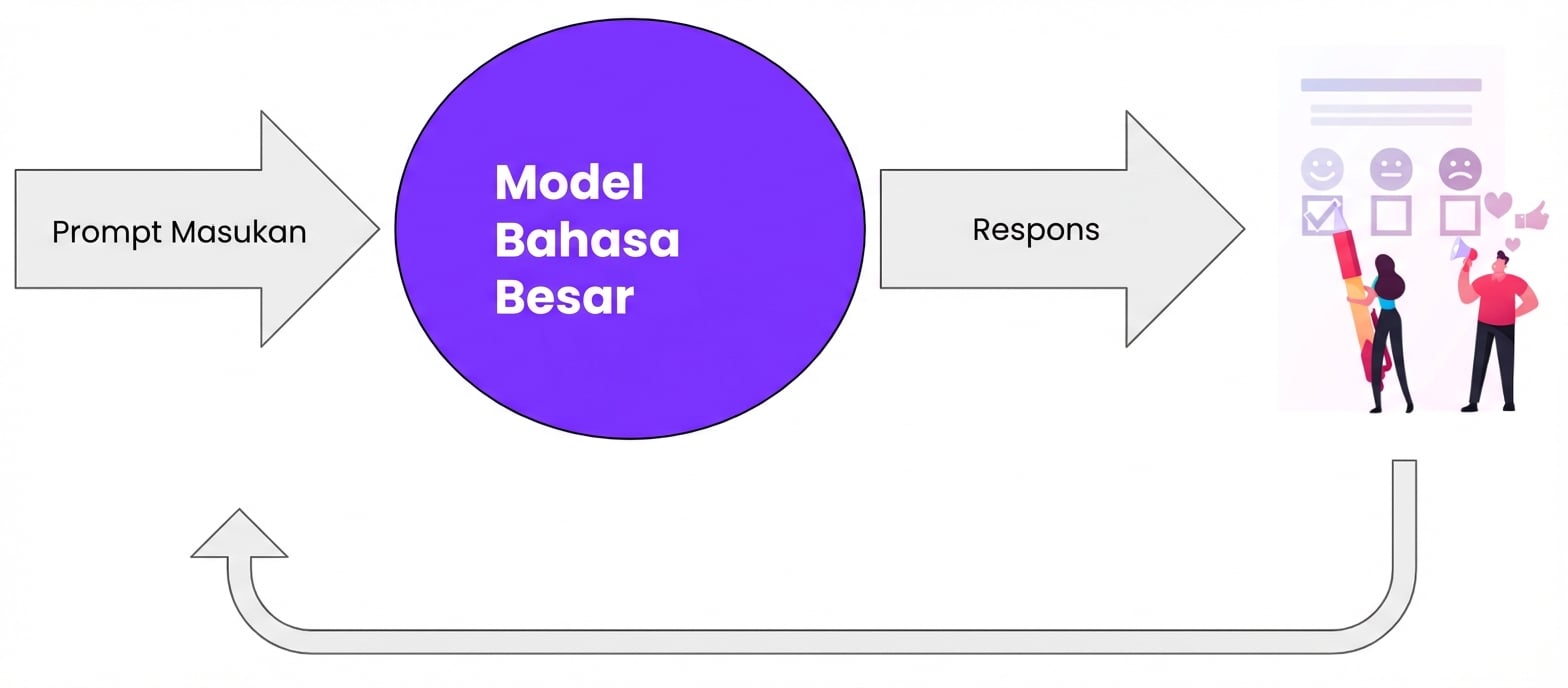

Menyederhanakan RLHF

- Keluaran model ditinjau manusia

- Model diperbarui berdasar umpan balik

- Langkah 1:

- Menerima prompt

- Menghasilkan beberapa respons

Masuk pakar manusia

- Langkah 2:

- Pakar manusia meninjau respons ini

- Memeringkat respons berdasarkan kualitas

- Akurasi

- Relevansi

- Koherensi

Waktunya umpan balik

- Langkah 3:

- Belajar dari peringkat pakar

- Menyelaraskan respons ke preferensi mereka ke depan

- Berulang terus!

- Tetap menghasilkan respons

- Menerima peringkat pakar

- Menyesuaikan pembelajaran

Ringkasan

- Pre-training untuk belajar pengetahuan bahasa umum

- Fine-tuning untuk tugas spesifik

- RLHF untuk meningkatkan fine-tuning lewat umpan balik manusia

- Kombinasinya sangat efektif!

Menyelesaikan LLM

Ayo berlatih!

Konsep Large Language Models (LLM)