Optimizer, pelatihan, dan evaluasi

Deep Learning Lanjutan dengan PyTorch

Michal Oleszak

Machine Learning Engineer

Training loop

import torch.nn as nn import torch.optim as optim criterion = nn.BCELoss() optimizer = optim.SGD(net.parameters(), lr=0.01)for epoch in range(1000): for features, labels in dataloader_train:optimizer.zero_grad()outputs = net(features)loss = criterion( outputs, labels.view(-1, 1) )loss.backward()optimizer.step()

- Tentukan loss function dan optimizer

BCELossuntuk klasifikasi biner- Optimizer

SGD

- Iterasi atas epoch dan batch pelatihan

- Hapus gradien

- Forward pass: dapatkan output model

- Hitung loss

- Hitung gradien

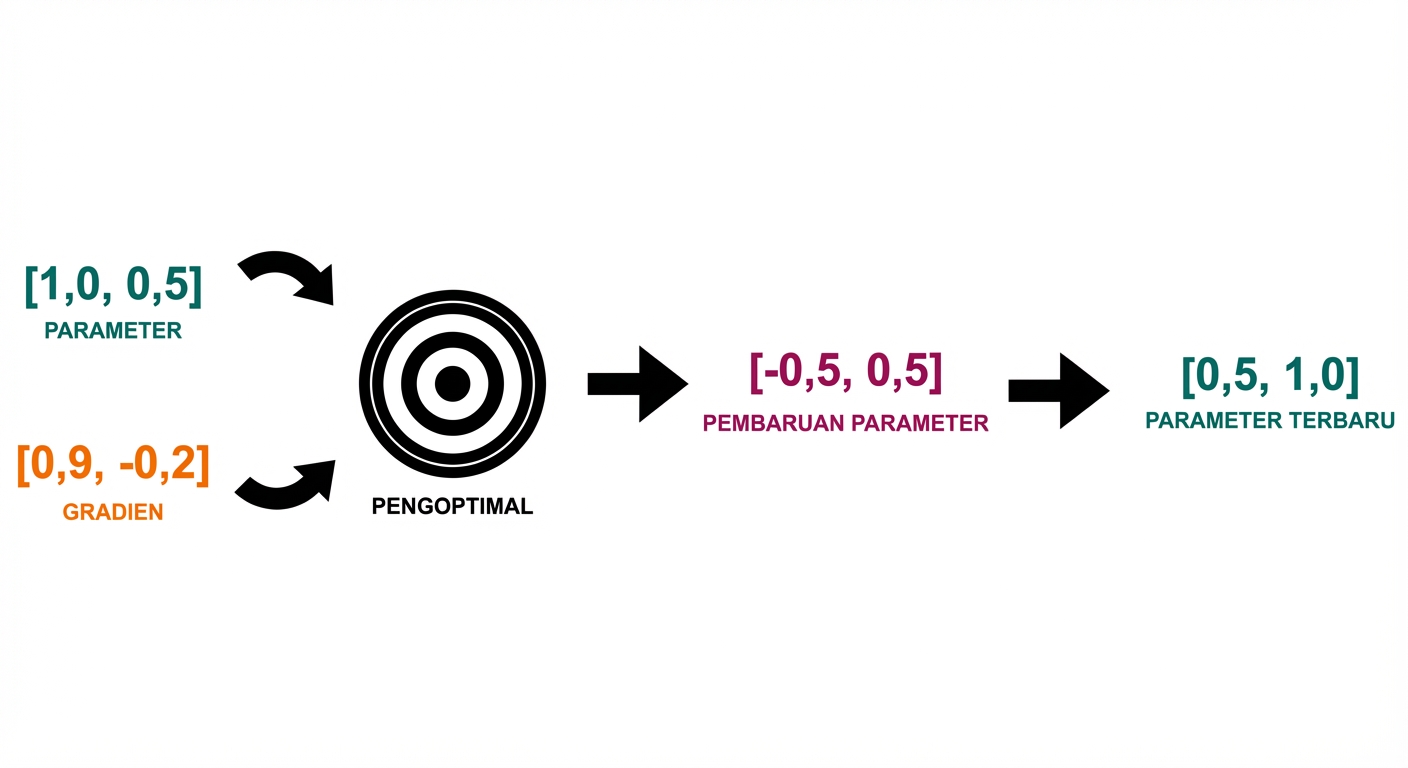

- Langkah optimizer: perbarui parameter

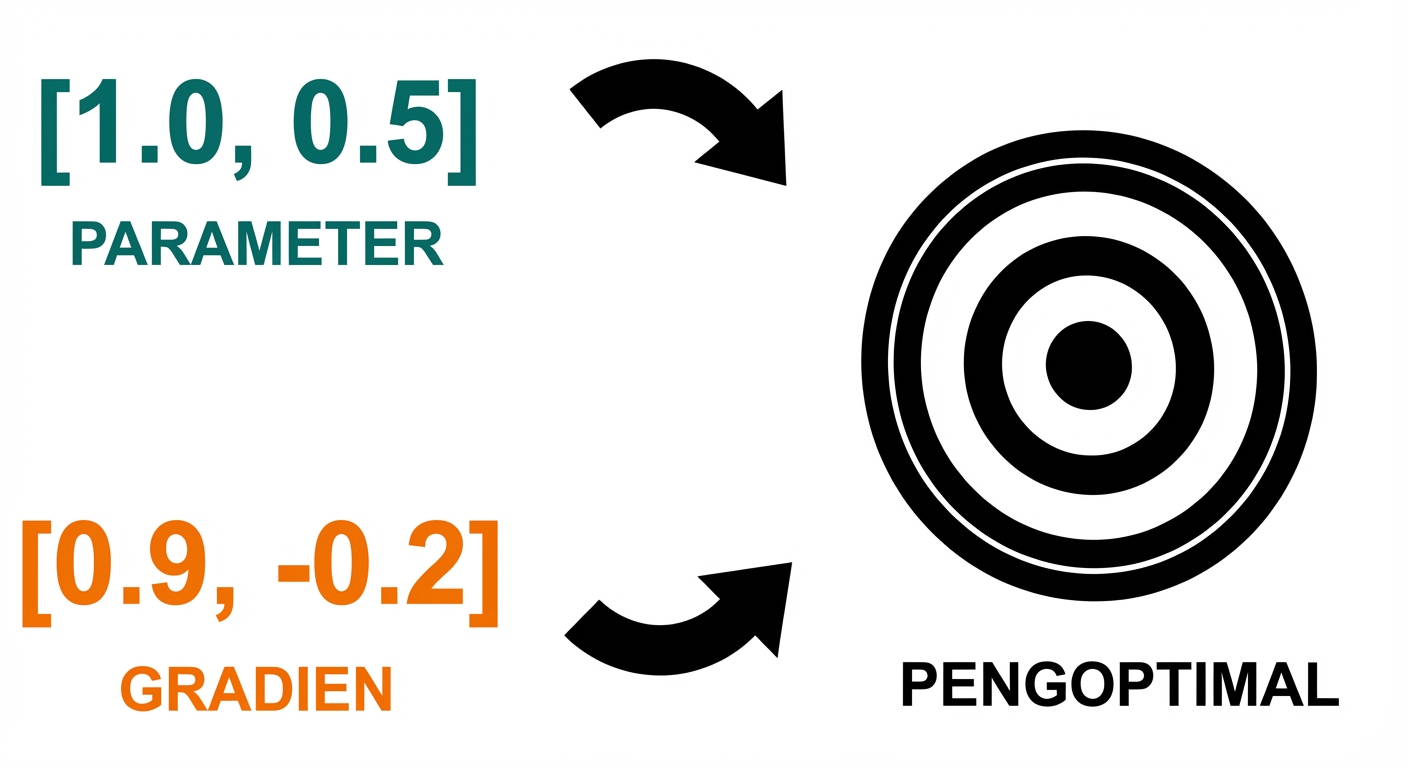

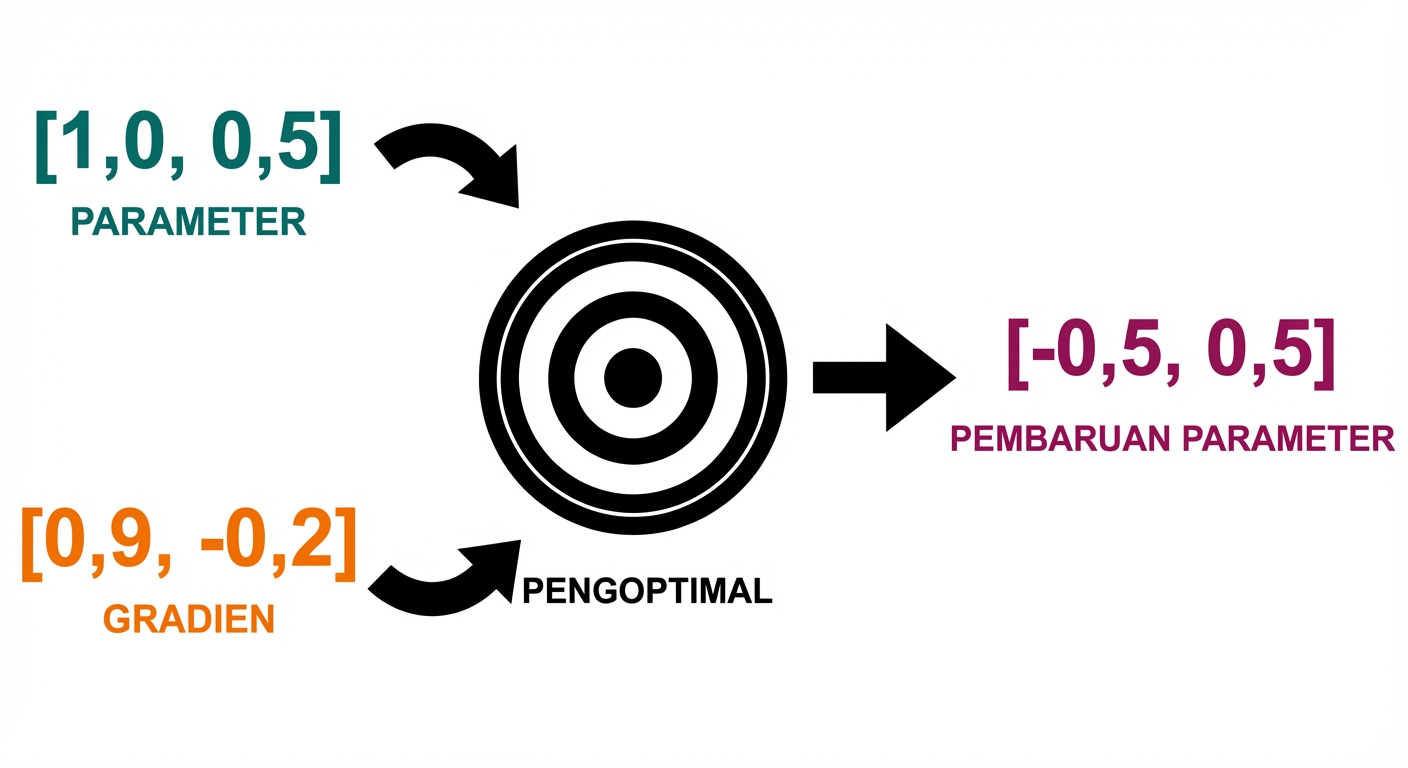

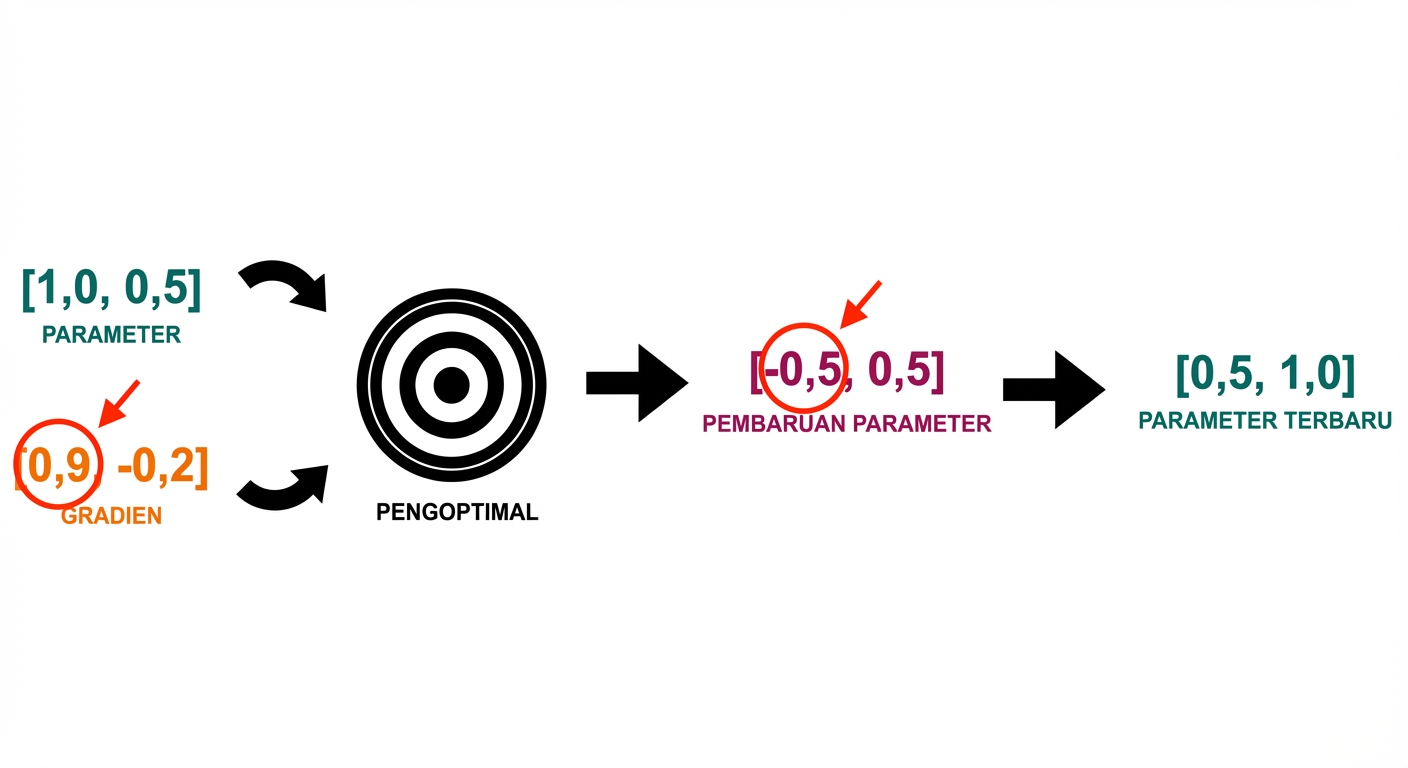

Cara kerja optimizer

Cara kerja optimizer

Cara kerja optimizer

Cara kerja optimizer

Cara kerja optimizer

Stochastic Gradient Descent (SGD)

optimizer = optim.SGD(net.parameters(), lr=0.01)

- Pembaruan bergantung pada learning rate

- Sederhana dan efisien, untuk model dasar

- Jarang dipakai dalam praktik

Adaptive Gradient (Adagrad)

optimizer = optim.Adagrad(net.parameters(), lr=0.01)

- Menyesuaikan learning rate per parameter

- Baik untuk data jarang (sparse)

- Dapat menurunkan learning rate terlalu cepat

Root Mean Square Propagation (RMSprop)

optimizer = optim.RMSprop(net.parameters(), lr=0.01)

- Pembaruan tiap parameter berdasarkan besar gradien sebelumnya

Adaptive Moment Estimation (Adam)

optimizer = optim.Adam(net.parameters(), lr=0.01)

- Paling serbaguna dan banyak digunakan

- RMSprop + momentum gradien

- Sering jadi pilihan utama

Evaluasi model

from torchmetrics import Accuracy acc = Accuracy(task="binary")net.eval() with torch.no_grad(): for features, labels in dataloader_test:outputs = net(features)preds = (outputs >= 0.5).float()acc(preds, labels.view(-1, 1))accuracy = acc.compute() print(f"Accuracy: {accuracy}")

Accuracy: 0.6759443283081055

- Siapkan metrik akurasi

- Mode evaluasi, iterasi batch data uji tanpa gradien

- Masukkan data ke model untuk probabilitas prediksi

- Hitung label prediksi

- Perbarui metrik akurasi

Ayo berlatih!

Deep Learning Lanjutan dengan PyTorch