Sel LSTM dan GRU

Deep Learning Lanjutan dengan PyTorch

Michal Oleszak

Machine Learning Engineer

Masalah memori jangka pendek

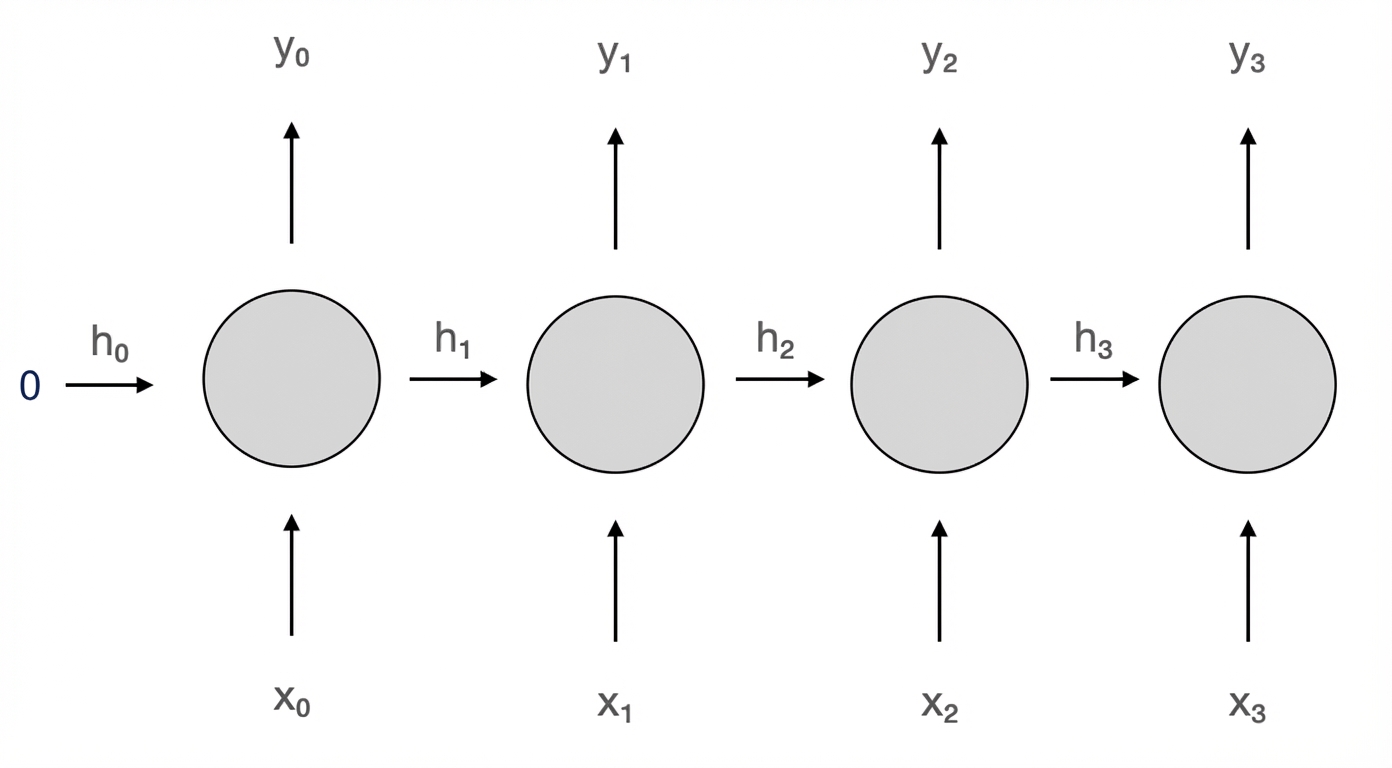

- Sel RNN menyimpan memori via state tersembunyi

- Memori ini sangat jangka pendek

- Dua sel lebih kuat mengatasi ini:

- LSTM (Long Short-Term Memory)

- GRU (Gated Recurrent Unit)

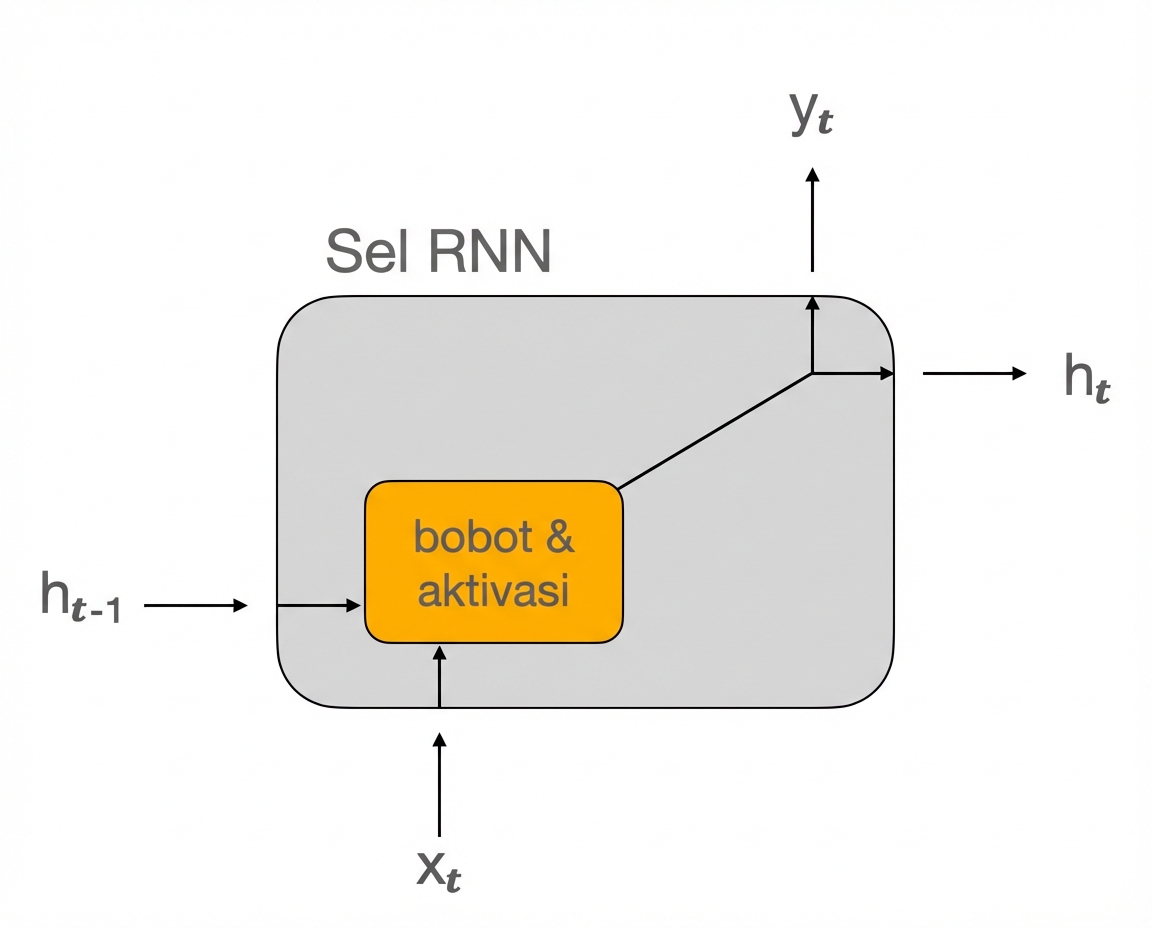

Sel RNN

- Dua masukan:

- data masukan saat ini

x - state tersembunyi sebelumnya

h

- data masukan saat ini

- Dua keluaran:

- keluaran saat ini

y - state tersembunyi berikutnya

h

- keluaran saat ini

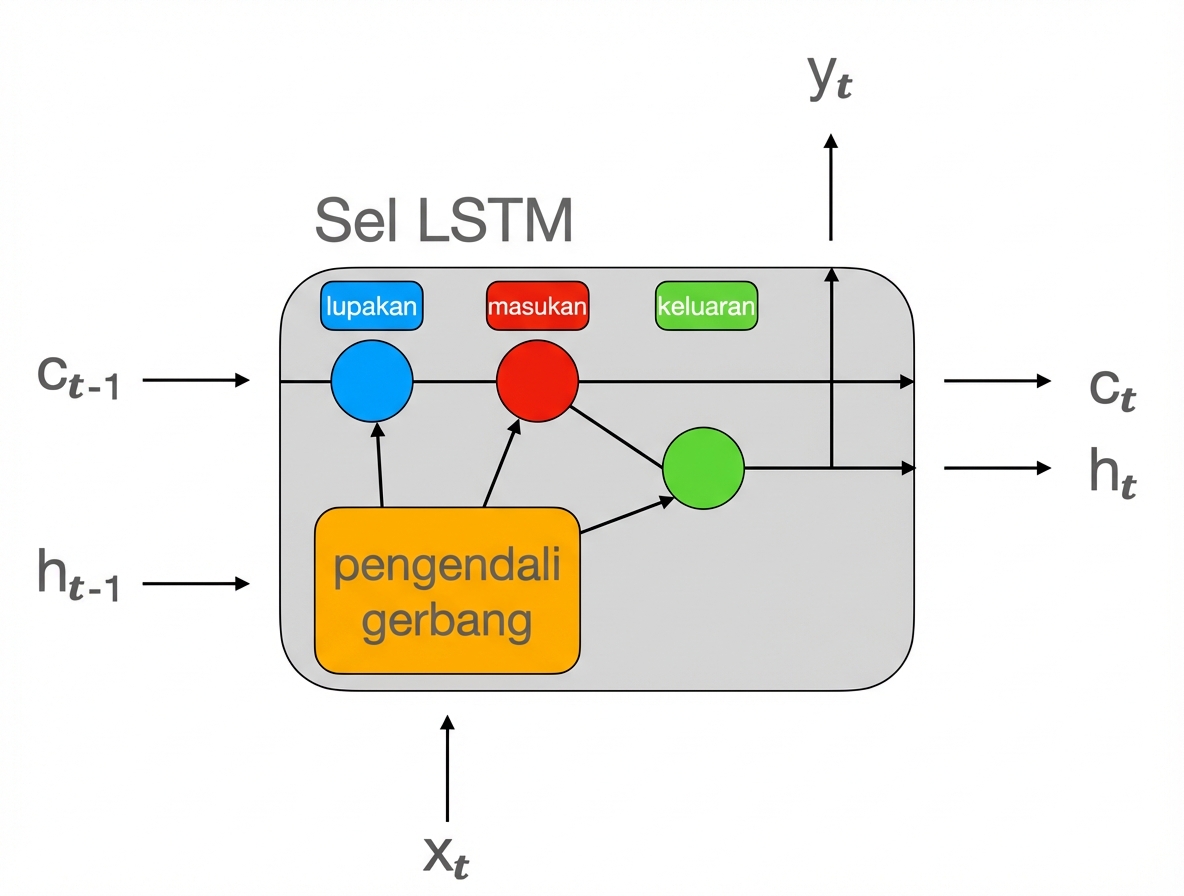

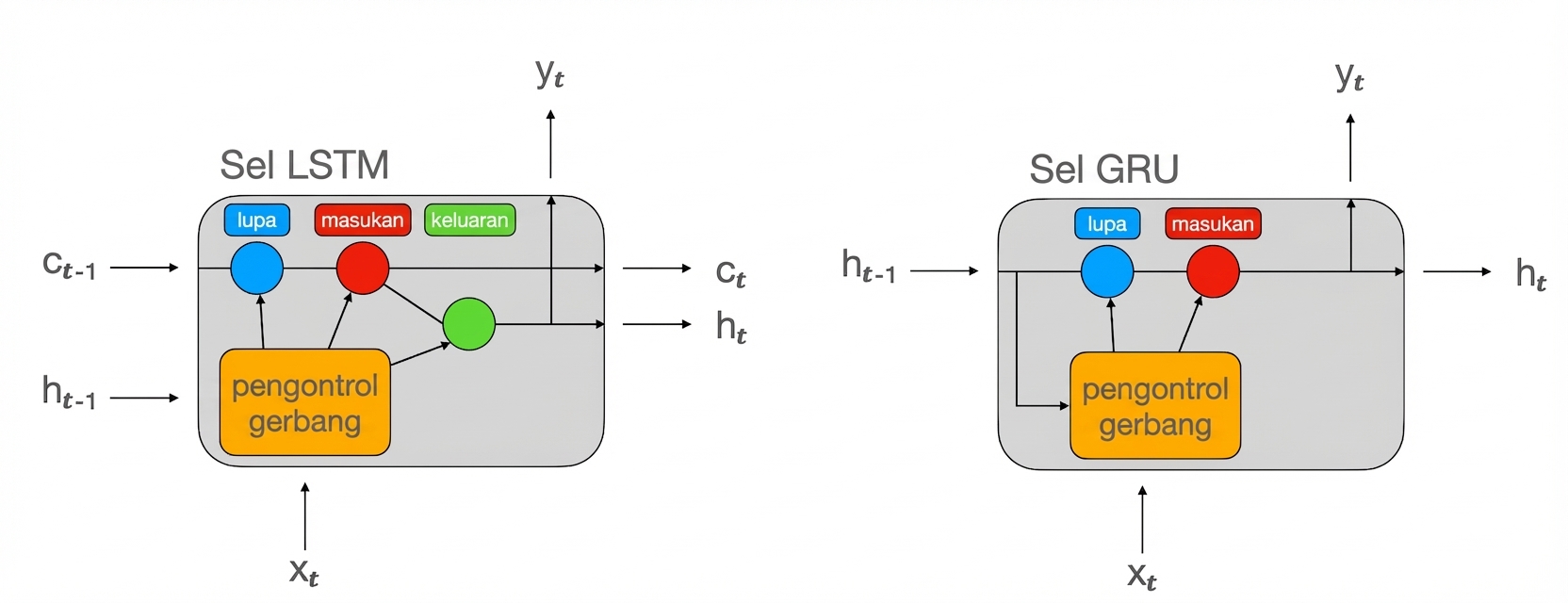

Sel LSTM

- Keluaran

hdanysama

Tiga masukan dan keluaran (dua state tersembunyi):

h: state jangka pendekc: state jangka panjang

Tiga "gerbang":

- Forget gate: apa yang dihapus dari memori jangka panjang

- Input gate: apa yang disimpan ke memori jangka panjang

- Output gate: apa yang dikembalikan pada langkah waktu saat ini

LSTM di PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.lstm = nn.LSTM( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) c0 = torch.zeros(2, x.size(0), 32)out, _ = self.lstm(x, (h0, c0))out = self.fc(out[:, -1, :]) return out

__init__():- Ganti

nn.RNNdengannn.LSTM

- Ganti

forward():- Tambahkan state tersembunyi

c - Inisialisasi

cdanhdengan nol - Teruskan kedua state ke layer

lstm

- Tambahkan state tersembunyi

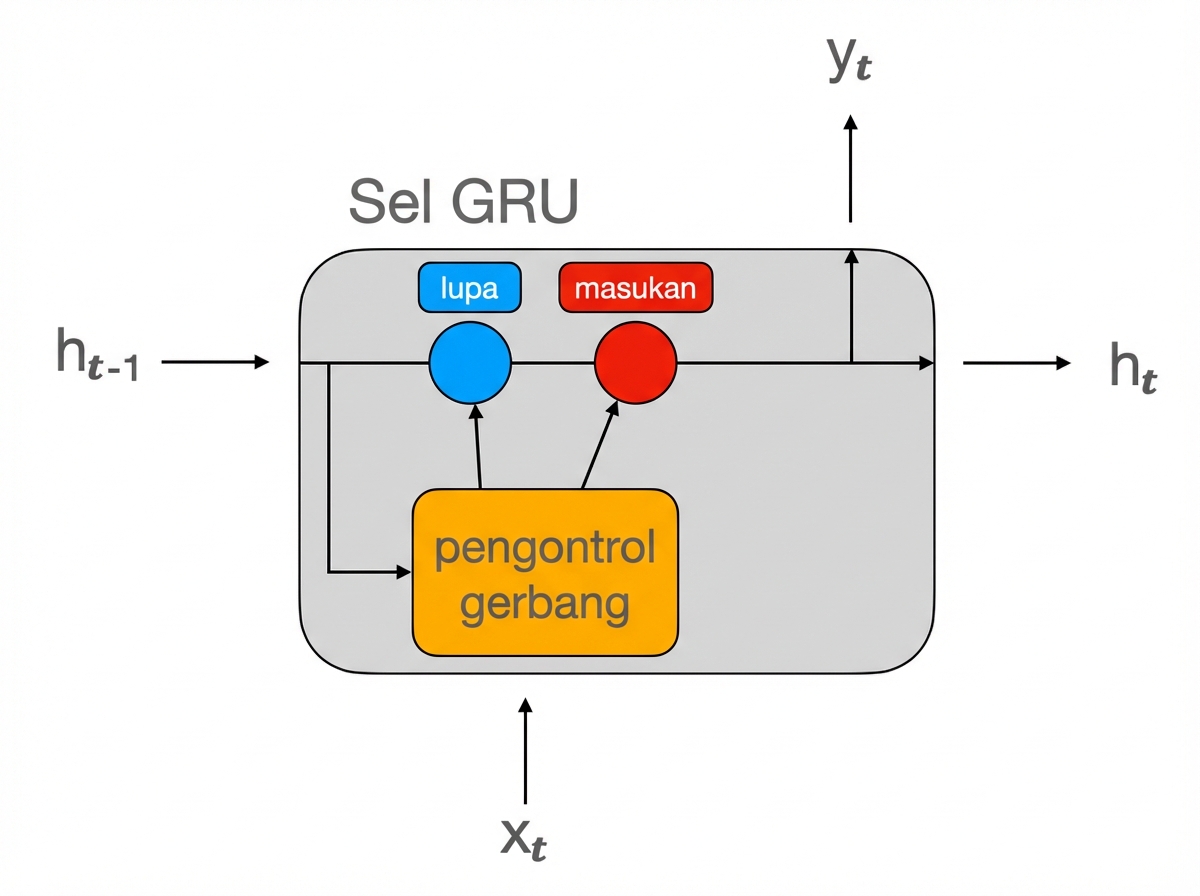

Sel GRU

- Versi sederhana dari sel LSTM

- Hanya satu state tersembunyi

- Tanpa gerbang keluaran

GRU di PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.gru = nn.GRU( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) out, _ = self.gru(x, h0) out = self.fc(out[:, -1, :]) return out

__init__():- Ganti

nn.RNNdengannn.GRU

- Ganti

forward():- Gunakan layer

gru

- Gunakan layer

Pilih RNN, LSTM, atau GRU?

- RNN kini jarang dipakai

- GRU lebih sederhana dari LSTM = komputasi lebih ringan

- Kinerja relatif tergantung kasus penggunaan

- Coba keduanya dan bandingkan

Ayo berlatih!

Deep Learning Lanjutan dengan PyTorch