Membangun rantai retrieval LCEL

Retrieval Augmented Generation (RAG) dengan LangChain

Meri Nova

Machine Learning Engineer

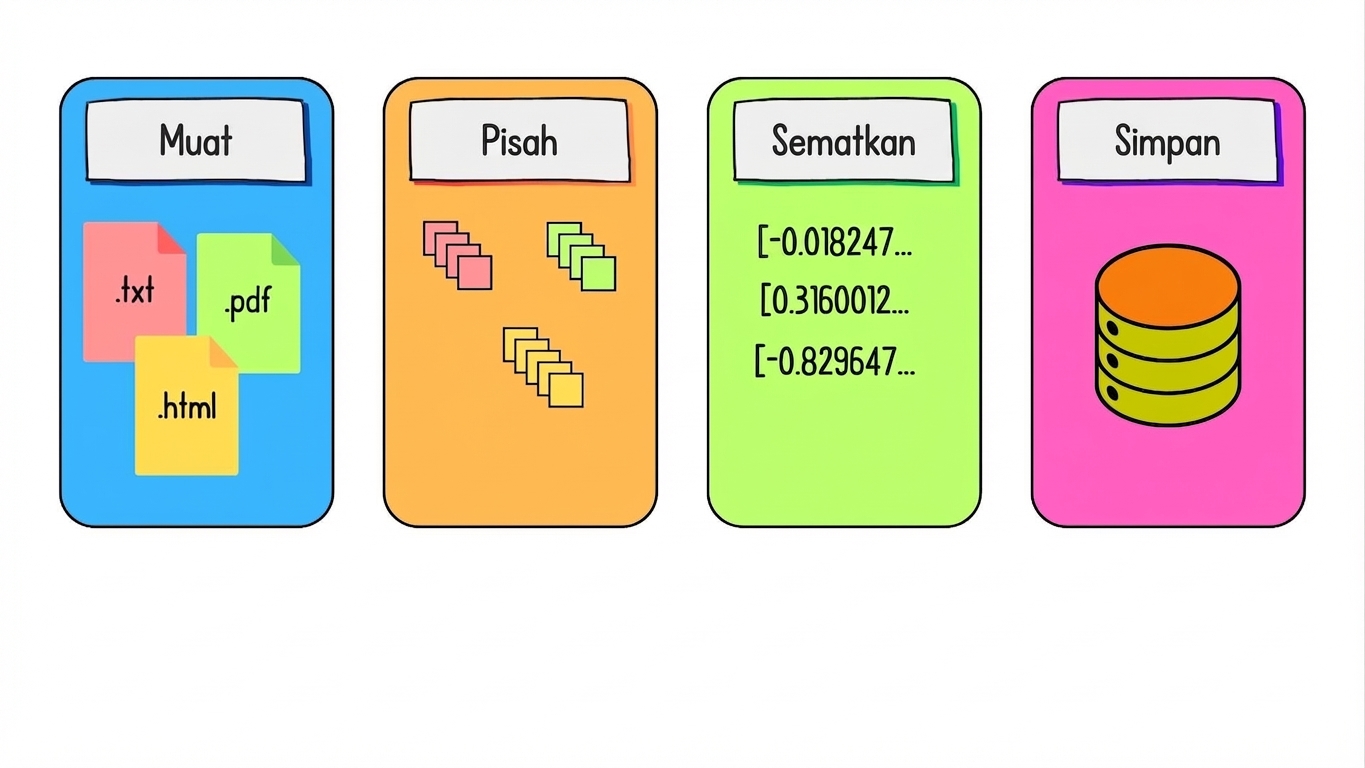

Menyiapkan data untuk retrieval

Pengantar LCEL untuk RAG

Pengantar LCEL untuk RAG

Pengantar LCEL untuk RAG

Pengantar LCEL untuk RAG

Pengantar LCEL untuk RAG

Pengantar LCEL untuk RAG

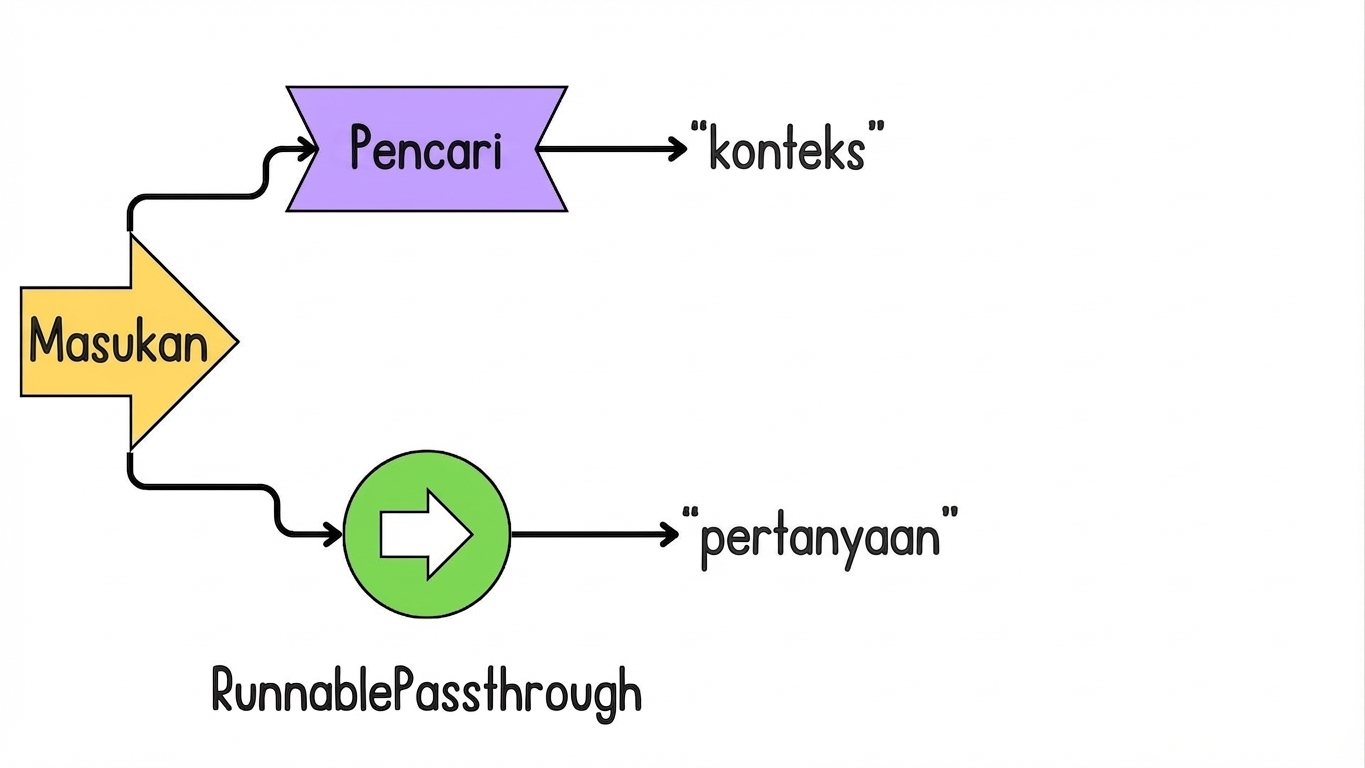

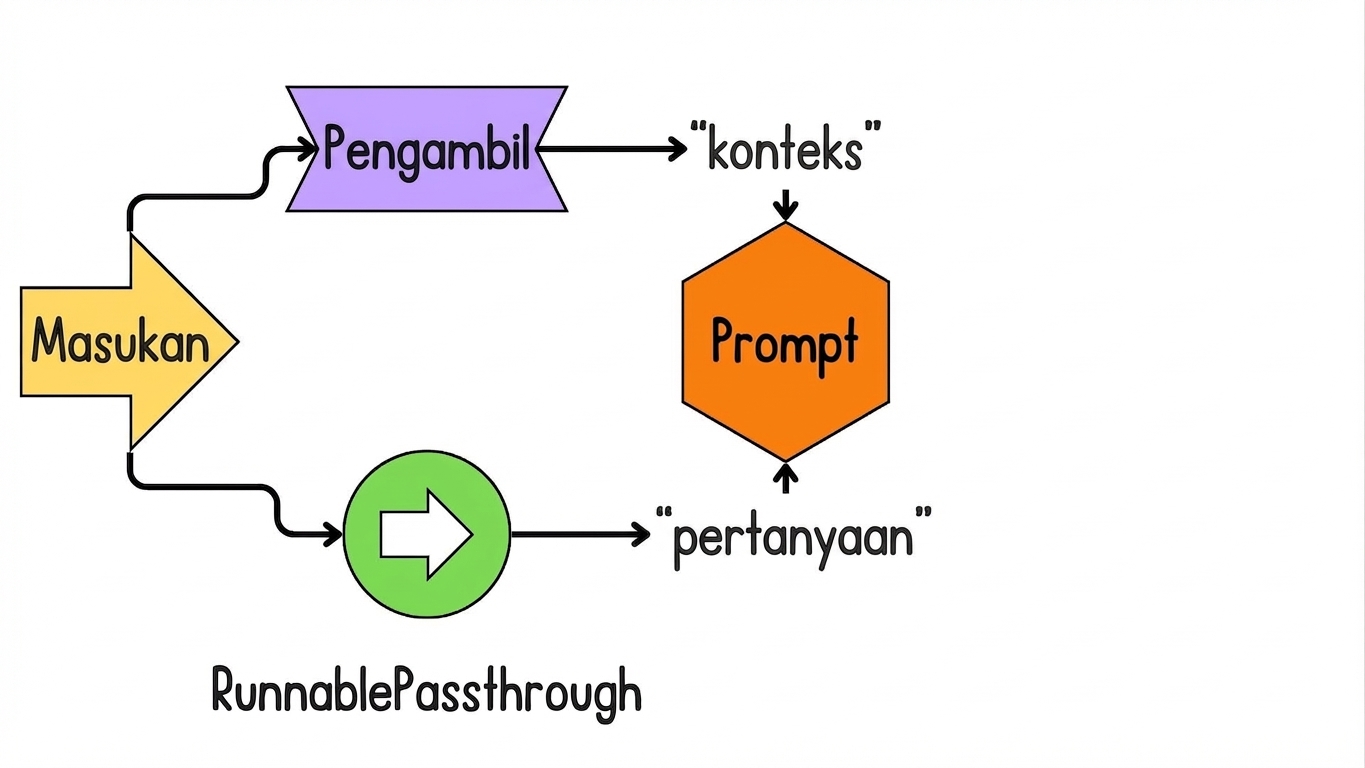

Membuat instance retriever

vector_store = Chroma.from_documents( documents=chunks, embedding=embedding_model )retriever = vector_store.as_retriever( search_type="similarity", search_kwargs={"k": 2} )

Membuat template prompt

from langchain_core.prompts import ChatPromptTemplateprompt = ChatPromptTemplate.from_template(""" Gunakan konteks berikut untuk menjawab pertanyaan di akhir. Jika tidak tahu jawabannya, katakan tidak tahu. Context: {context} Question: {question} """)

llm = ChatOpenAI(model="gpt-4o-mini", api_key="...", temperature=0)

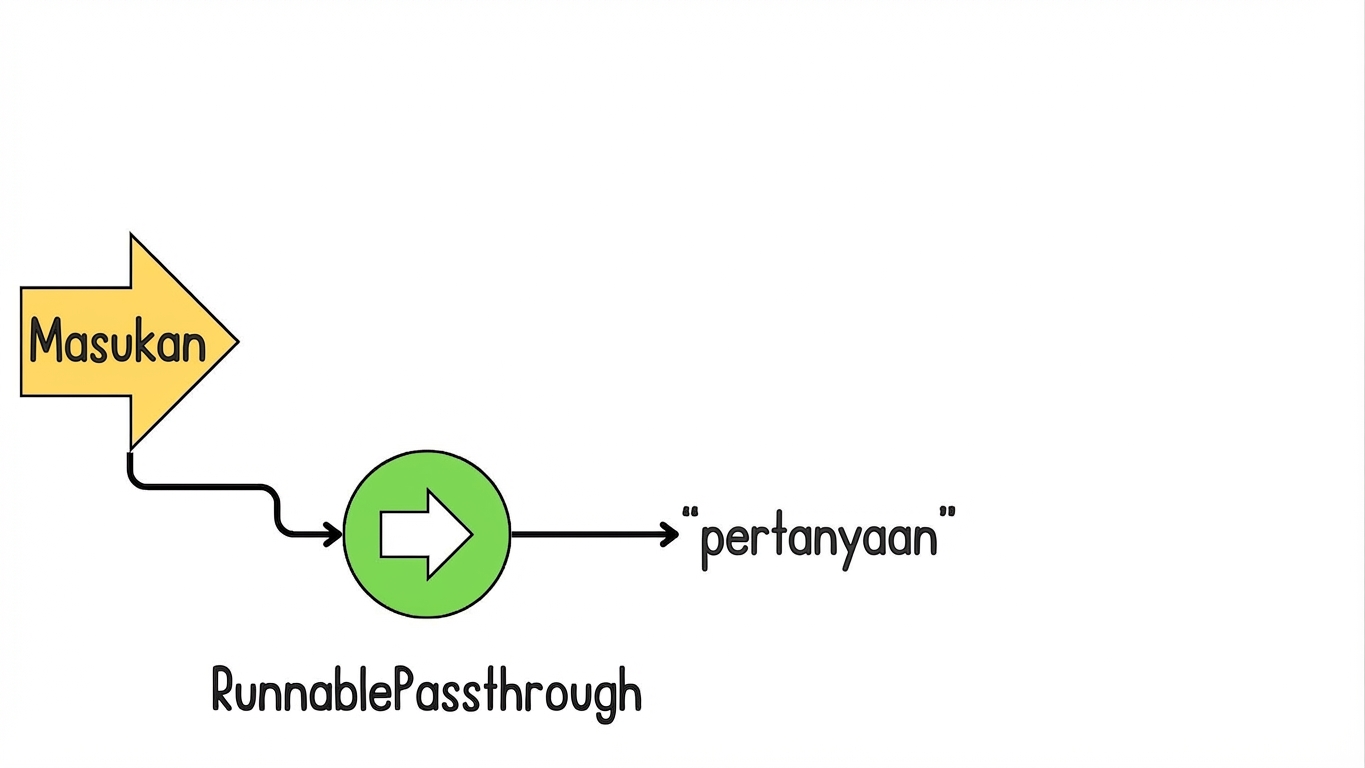

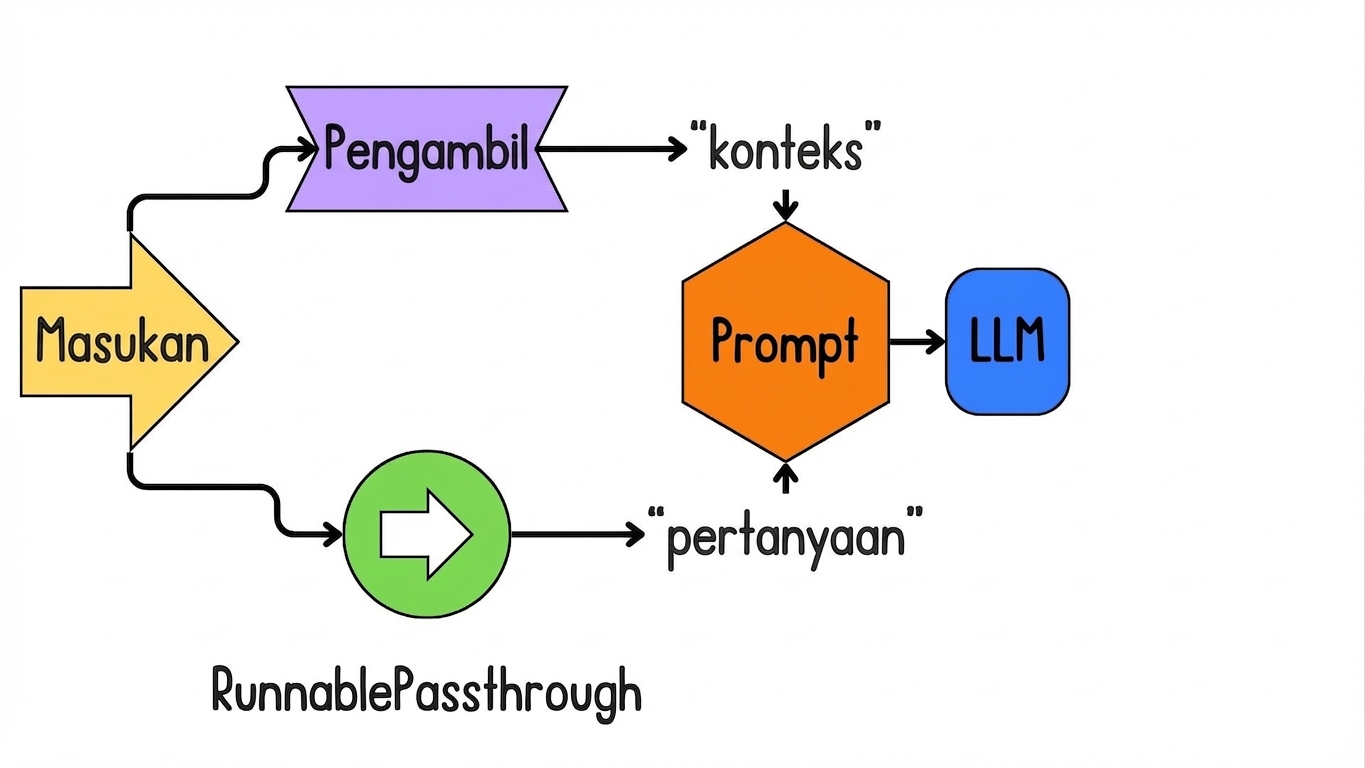

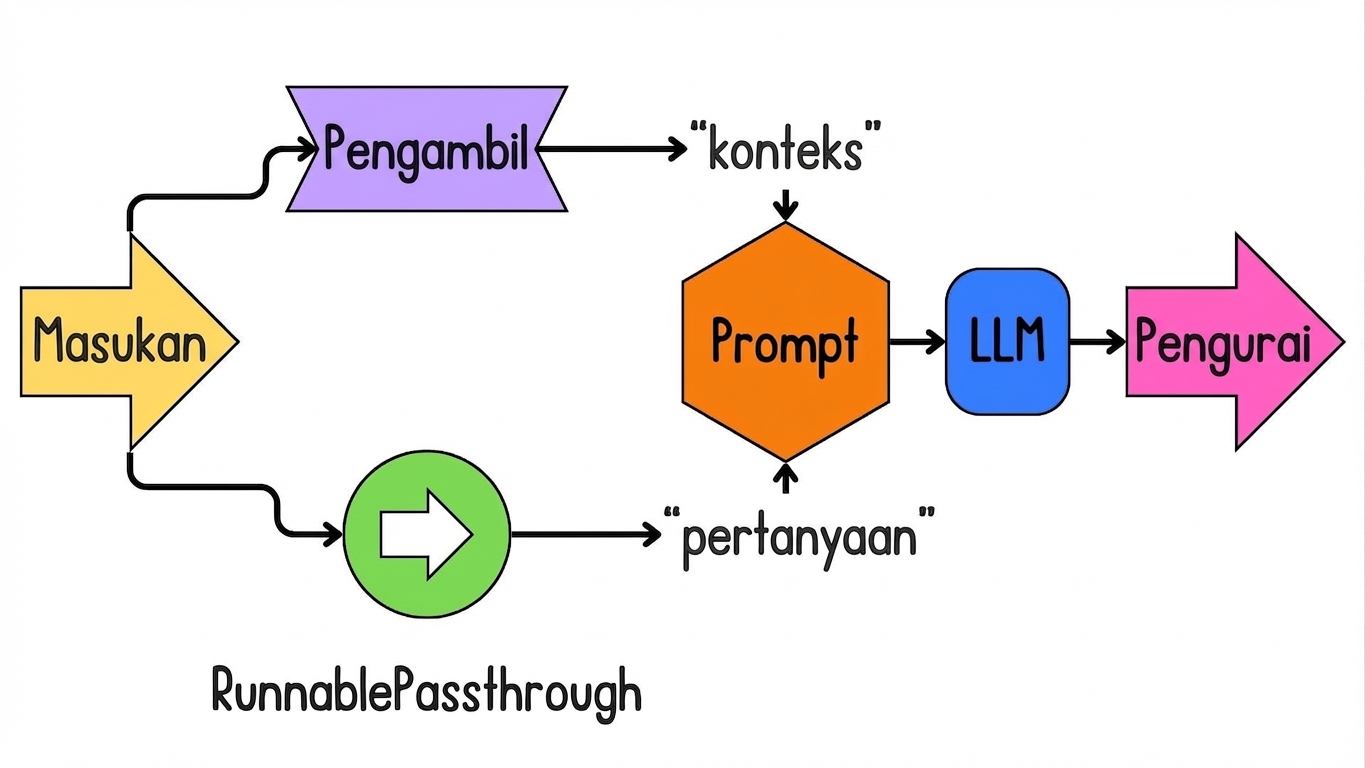

Membangun rantai retrieval LCEL

from langchain_core.runnables import RunnablePassthrough from langchain_core.output_parsers import StrOutputParserchain = ({"context": retriever, "question": RunnablePassthrough()}| prompt| llm| StrOutputParser())

Menjalankan rantai retrieval

result = chain.invoke({"question": "What are the key findings or results presented in the paper?"})

print(result)

- Kinerja puncak: Model RAG mencetak rekor baru pada tugas tanya jawab domain terbuka...

- Generasi lebih baik: Model RAG menghasilkan bahasa yang lebih spesifik, beragam, dan faktual...

- Pemakaian pengetahuan dinamis: Memori non-parametrik memungkinkan model RAG mengakses dan ...

Ayo berlatih!

Retrieval Augmented Generation (RAG) dengan LangChain