Pengenalan PySpark RDD

Fundamental Big Data dengan PySpark

Upendra Devisetty

Science Analyst, CyVerse

Apa itu RDD?

- RDD = Resilient Distributed Datasets

Membongkar RDD

Resilient Distributed Datasets

Resilient: Tahan terhadap kegagalan

Distributed: Meliputi banyak mesin

Datasets: Kumpulan data terpartisi, mis. Array, Tabel, Tuple, dll.

Membuat RDD. Bagaimana caranya?

Memparalelkan koleksi objek yang sudah ada

Dataset eksternal:

File di HDFS

Objek di bucket Amazon S3

Baris dalam file teks

Dari RDD yang sudah ada

Koleksi terparalel (parallelizing)

parallelize()untuk membuat RDD dari list Python

numRDD = sc.parallelize([1,2,3,4])

helloRDD = sc.parallelize("Hello world")

type(helloRDD)

<class 'pyspark.rdd.PipelinedRDD'>

Dari dataset eksternal

textFile()untuk membuat RDD dari dataset eksternal

fileRDD = sc.textFile("README.md")

type(fileRDD)

<class 'pyspark.rdd.PipelinedRDD'>

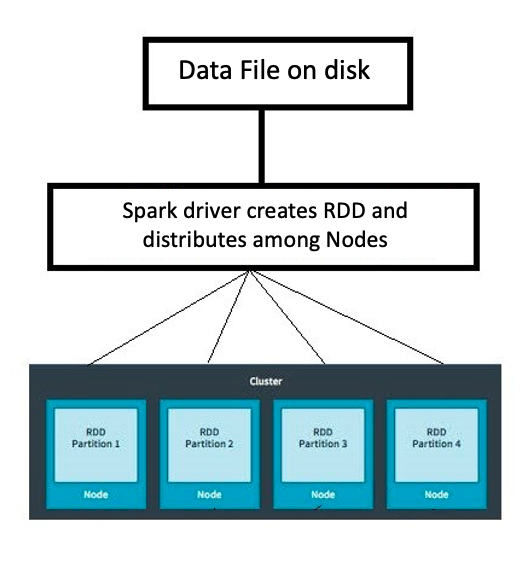

Memahami Partisi di PySpark

Partisi adalah pembagian logis dari himpunan data terdistribusi besar

Metode

parallelize()

numRDD = sc.parallelize(range(10), minPartitions = 6)

- Metode

textFile()

fileRDD = sc.textFile("README.md", minPartitions = 6)

- Jumlah partisi dalam RDD dapat dilihat dengan metode

getNumPartitions()

Ayo berlatih!

Fundamental Big Data dengan PySpark