Dasar-dasar Big Data

Fundamental Big Data dengan PySpark

Upendra Devisetty

Science Analyst, CyVerse

Apa itu Big Data?

- Big data adalah istilah untuk studi dan penerapan pada himpunan data yang terlalu kompleks bagi perangkat lunak pemrosesan data tradisional - Wikipedia

3 V Big Data

Volume, Variasi, dan Kecepatan

Volume: Ukuran data

Variasi: Sumber dan format berbeda

Kecepatan: Laju data

Konsep dan Terminologi Big Data

Komputasi berkluster: Kumpulan sumber daya dari banyak mesin

Komputasi paralel: Perhitungan serentak pada satu komputer

Komputasi terdistribusi: Kumpulan node (komputer berjaringan) yang berjalan paralel

Pemrosesan batch: Memecah tugas jadi bagian kecil dan menjalankannya di mesin masing-masing

Pemrosesan real-time: Pemrosesan data seketika

Sistem pemrosesan Big Data

Hadoop/MapReduce: Kerangka kerja skalabel dan toleran kesalahan, ditulis dalam Java

Sumber terbuka

Pemrosesan batch

Apache Spark: Sistem komputasi kluster serbaguna dan sangat cepat

Sumber terbuka

Pemrosesan batch dan real-time

Catatan: Kini Apache Spark lebih disukai daripada Hadoop/MapReduce

Fitur kerangka kerja Apache Spark

Kerangka komputasi kluster terdistribusi

Komputasi in-memory yang efisien untuk data besar

Pemrosesan data sangat cepat

Mendukung Java, Scala, Python, R, dan SQL

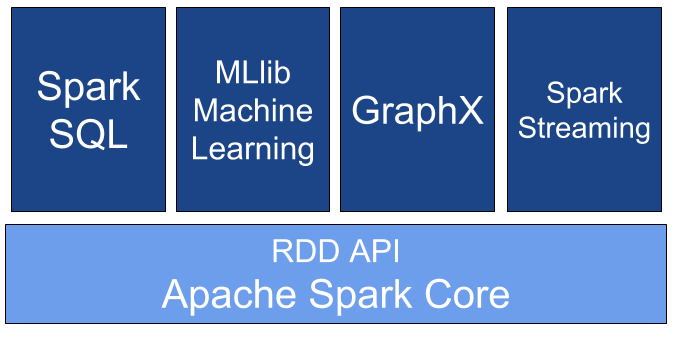

Komponen Apache Spark

Mode penerapan Spark

Mode lokal: Satu mesin, mis. laptop Anda

- Nyaman untuk uji, debug, dan demo

Mode kluster: Kumpulan mesin yang sudah ditentukan

- Cocok untuk produksi

Alur kerja: Lokal -> kluster

Tanpa ubah kode

Berikutnya: PySpark

Fundamental Big Data dengan PySpark