Memulai dengan Databricks SQL

Konsep Databricks

Kevin Barlow

Data Practitioner

Komputasi SQL vs. Komputasi Umum

Merancang klaster komputasi untuk beban kerja data science atau data engineering...

import pyspark.sql.functions as F

spark_df = (spark

.read

.table('user_table'))

spark_df = (spark_df

.withColumn('score',

F.flatten(...))

)

secara mendasar berbeda dengan merancang komputasi untuk beban kerja SQL

SELECT *

FROM user_table u

LEFT JOIN product_use p

ON u.userId = p.userId

WHERE country = 'USA'

AND utilization >= 0.6

SQL Warehouse

SQL Warehouse

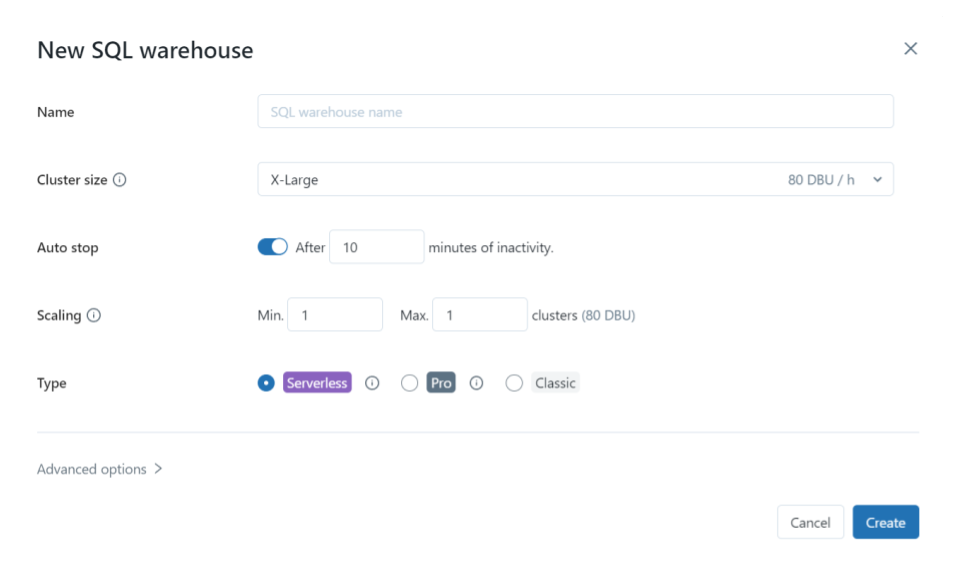

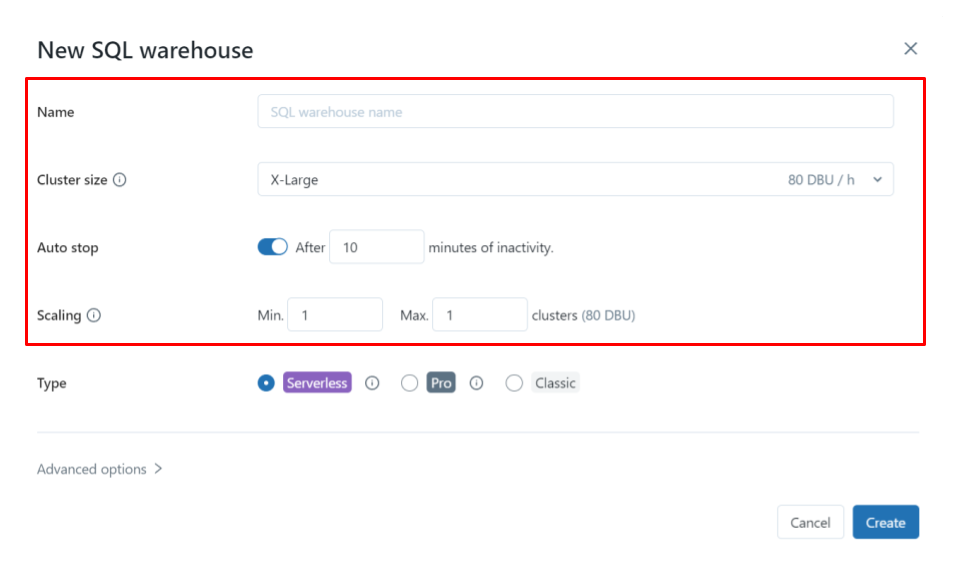

Opsi Konfigurasi SQL Warehouse

- Nama Klaster

- Ukuran Klaster (S, M, L, dll.)

- Perilaku penskalaan

SQL Warehouse

Opsi Konfigurasi SQL Warehouse

- Nama Klaster

- Ukuran Klaster (S, M, L, dll.)

- Perilaku penskalaan

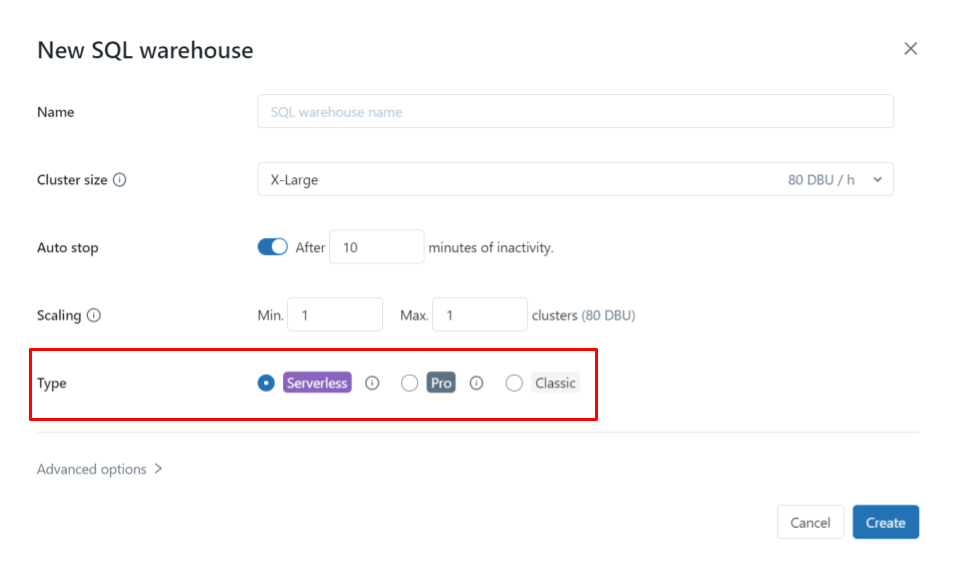

- Jenis Klaster

Jenis SQL Warehouse

Tipe berbeda memberi manfaat berbeda

Classic

- Komputasi SQL paling dasar

- Di cloud pelanggan

Pro

- Fitur lebih lanjut daripada Classic

- Di cloud pelanggan

Serverless

- Fitur terdepan

- Di cloud Databricks

- Paling hemat biaya

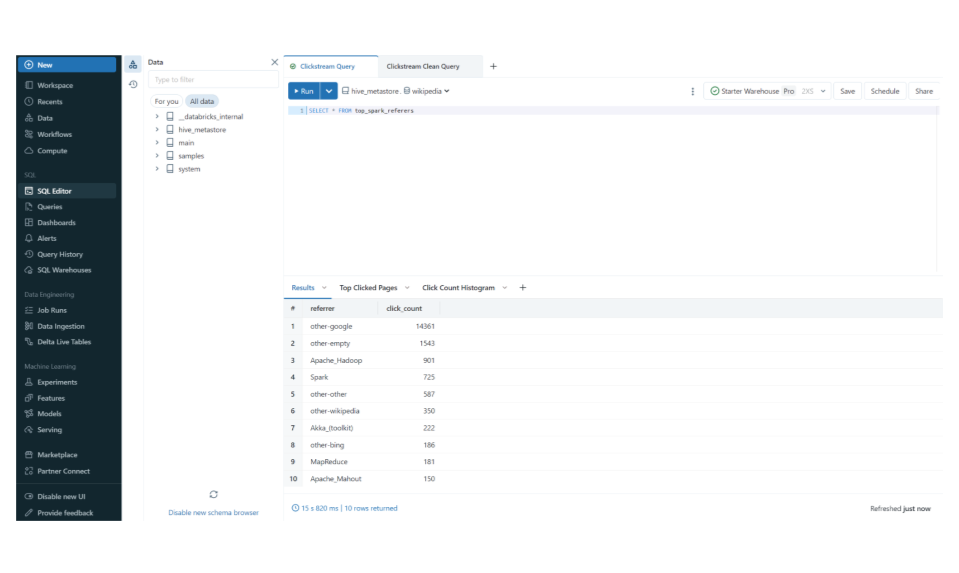

Editor SQL

Perintah SQL Umum

COPY INTO

- Ambil data mentah dan masukkan ke Delta

- Tahap Extract dalam ETL

COPY INTO my_table

FROM '/path/to/files'

FILEFORMAT = <format>

FORMAT_OPTIONS ('mergeSchema' = 'true')

COPY_OPTIONS ('mergeSchema' = 'true');

CREATE <entity> AS

- Buat Table atau View

- Tahap Transform dalam ETL

CREATE TABLE events

USING DELTA

AS (

SELECT *

FROM raw_events

WHERE ...

)

Ayo berlatih!

Konsep Databricks