Fungsi aktivasi

Pendahuluan TensorFlow di Python

Isaiah Hull

Visiting Associate Professor of Finance, BI Norwegian Business School

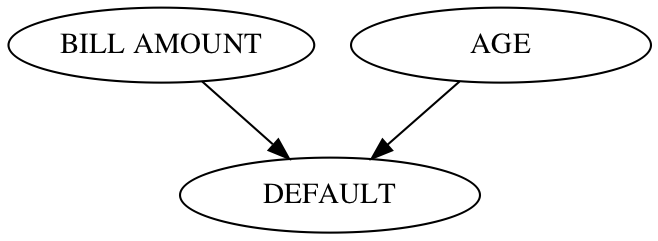

Apa itu fungsi aktivasi?

- Komponen lapisan tersembunyi umum

- Linear: Perkalian matriks

- Nonlinear: Fungsi aktivasi

Mengapa nonlinier penting

Mengapa nonlinier penting

Contoh sederhana

import numpy as np

import tensorflow as tf

# Definisikan fitur contoh peminjam

young, old = 0.3, 0.6

low_bill, high_bill = 0.1, 0.5

# Terapkan langkah perkalian matriks untuk semua kombinasi fitur

young_high = 1.0*young + 2.0*high_bill

young_low = 1.0*young + 2.0*low_bill

old_high = 1.0*old + 2.0*high_bill

old_low = 1.0*old + 2.0*low_bill

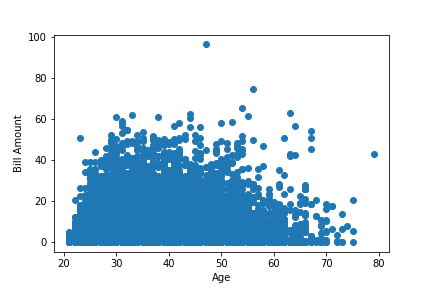

Contoh sederhana

# Perbedaan prediksi gagal bayar untuk muda

print(young_high - young_low)

# Perbedaan prediksi gagal bayar untuk tua

print(old_high - old_low)

0.8

0.8

Contoh sederhana

# Perbedaan prediksi gagal bayar untuk muda

print(tf.keras.activations.sigmoid(young_high).numpy() -

tf.keras.activations.sigmoid(young_low).numpy())

# Perbedaan prediksi gagal bayar untuk tua

print(tf.keras.activations.sigmoid(old_high).numpy() -

tf.keras.activations.sigmoid(old_low).numpy())

0.16337568

0.14204389

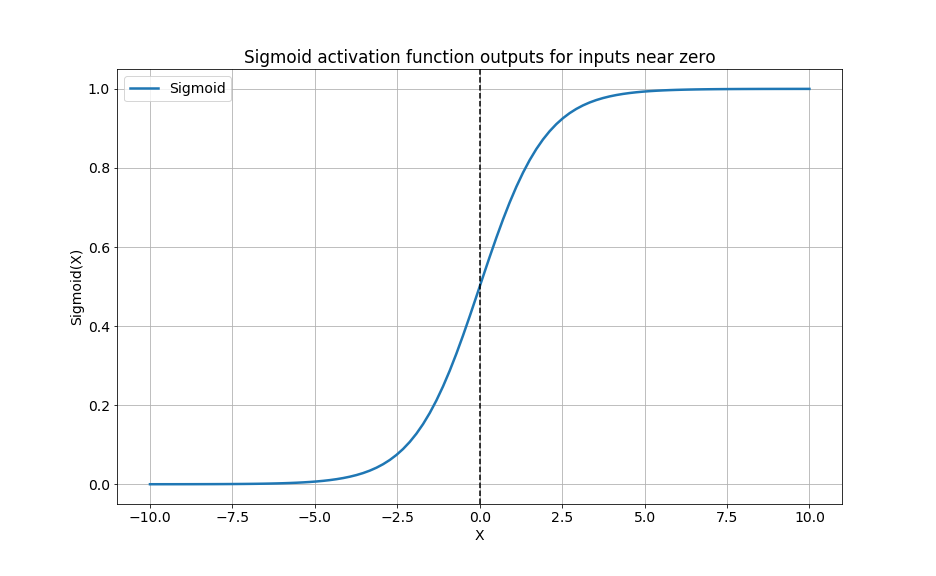

Fungsi aktivasi sigmoid

- Fungsi aktivasi sigmoid

- Klasifikasi biner

- Level rendah:

tf.keras.activations.sigmoid() - Level tinggi:

sigmoid

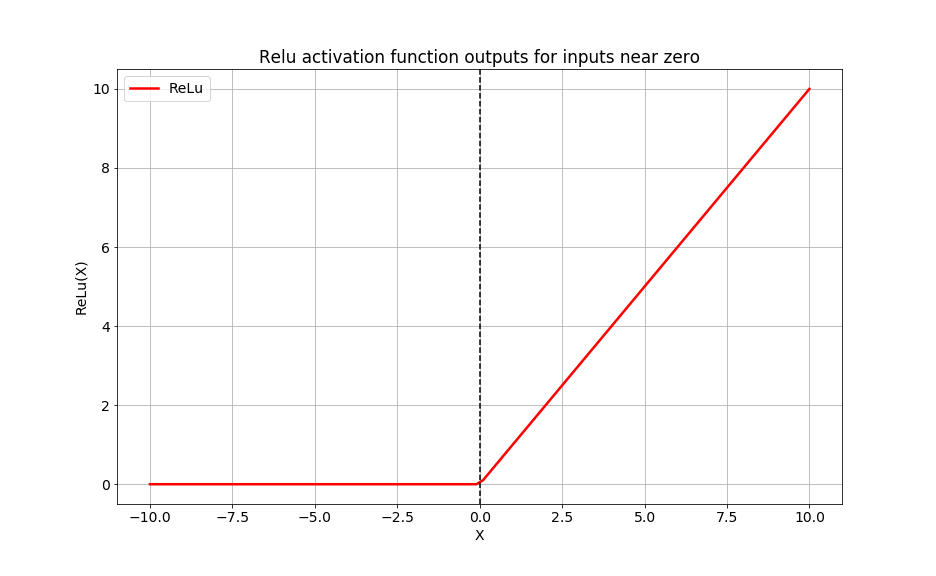

Fungsi aktivasi ReLU

- Fungsi aktivasi ReLU

- Lapisan tersembunyi

- Level rendah:

tf.keras.activations.relu() - Level tinggi:

relu

Fungsi aktivasi softmax

- Fungsi aktivasi softmax

- Lapisan keluaran (>2 kelas)

- Level rendah:

tf.keras.activations.softmax() - Level tinggi:

softmax

Fungsi aktivasi di jaringan saraf

import tensorflow as tf

# Definisikan lapisan masukan

inputs = tf.constant(borrower_features, tf.float32)

# Definisikan dense layer 1

dense1 = tf.keras.layers.Dense(16, activation='relu')(inputs)

# Definisikan dense layer 2

dense2 = tf.keras.layers.Dense(8, activation='sigmoid')(dense1)

# Definisikan lapisan keluaran

outputs = tf.keras.layers.Dense(4, activation='softmax')(dense2)

Ayo berlatih!

Pendahuluan TensorFlow di Python