Prapemrosesan data untuk fine-tuning

Fine-Tuning dengan Llama 3

Francesca Donadoni

Curriculum Manager, DataCamp

Menggunakan dataset untuk fine-tuning

Kualitas data sangat penting

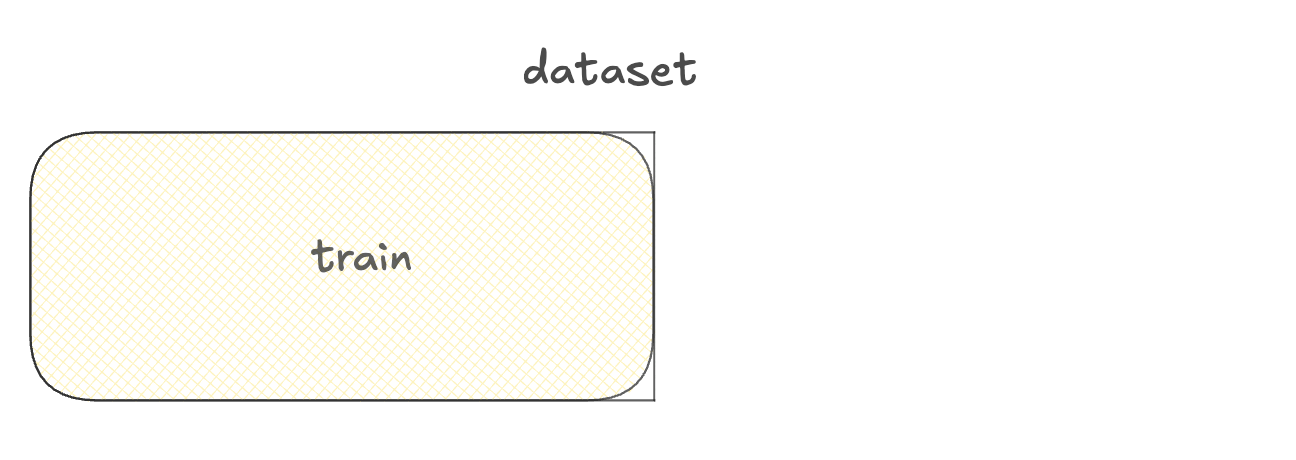

Training Set:

- Untuk melatih model

- Porsi data terbesar

Menggunakan dataset untuk fine-tuning

Kualitas data sangat penting

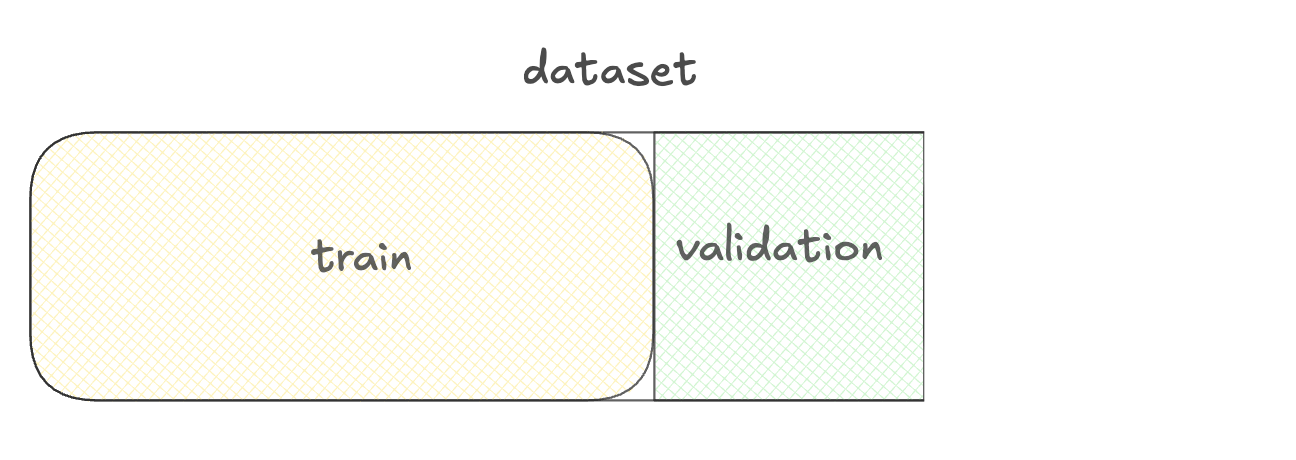

Training Set:

- Untuk melatih model

- Porsi data terbesar

- Validation Set:

- Untuk memilih versi model terbaik

Menggunakan dataset untuk fine-tuning

Kualitas data sangat penting

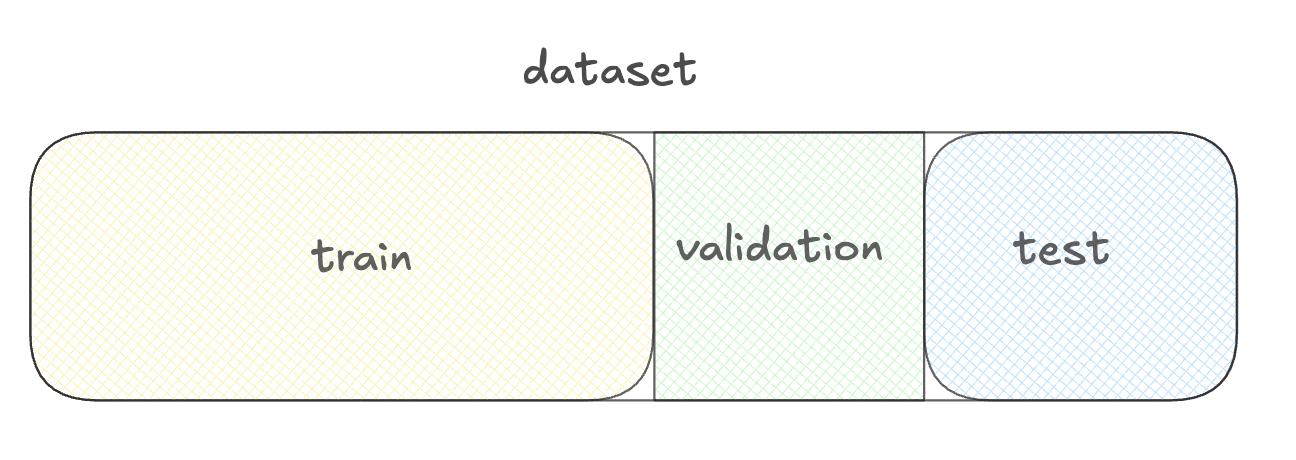

Training Set:

- Untuk melatih model

- Porsi data terbesar

- Validation Set:

- Untuk memilih versi model terbaik

- Test Set:

- Untuk mengevaluasi kinerja model

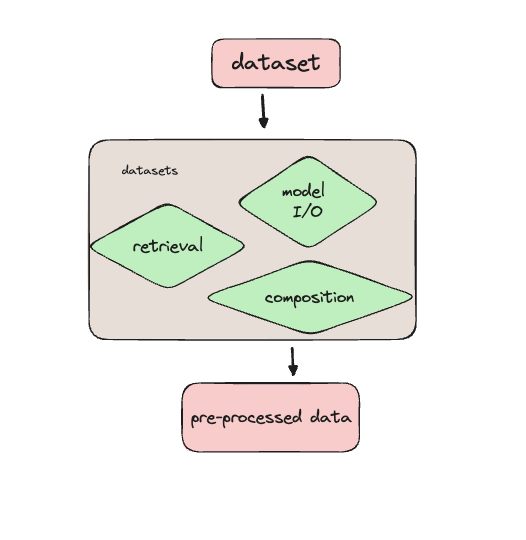

Menyiapkan data dengan pustaka datasets

- Pustaka Datasets

- Prapemrosesan

- Pembagian

- Pemuatan

- Kelola memori

Memuat dataset layanan pelanggan

from datasets import load_datasetds = load_dataset( 'bitext/Bitext-customer-support-llm-chatbot-training-dataset',split="train")print(ds.column_names)

['flags', 'instruction', 'category', 'intent', 'response']

Mengintip data

import pprint

pprint.pprint(ds[0])

{'category': 'ORDER',

'flags': 'B',

'instruction': 'question about cancelling order {{Order Number}}',

'intent': 'cancel_order',

'response': "I've understood you have a question regarding canceling order "

"{{Order Number}}, and I'm here to provide you with the "

'information you need. Please go ahead and ask your question, and '

"I'll do my best to assist you."}

Memfilter dataset

from datasets import load_dataset, Dataset ds = load_dataset( 'bitext/Bitext-customer-support-llm-chatbot-training-dataset', split="train")print(ds.shape)

(26872, 5)

first_thousand_points = ds[:1000]ds = Dataset.from_dict(first_thousand_points)

Prapemrosesan dataset

def merge_example(row):row['conversation'] = f"Query: {row['instruction']}\nResponse: {row['response']}" return rowds = ds.map(merge_example)print(ds[0]['conversation'])

Query: question about cancelling order {{Order Number}}

Response: I've understood you have a question regarding canceling order {{Order Number}},

and I'm here to provide you with the information you need. Please go ahead and ask your

question, and I'll do my best to assist you.

Menyimpan dataset yang telah dipraproses

ds.save_to_disk("preprocessed_dataset")

Menyimpan dataset (1/1 shard): 100%

26872/26872 [00:00<00:00, 383823.33 examples/s]

from datasets import load_from_disk

ds_preprocessed = load_from_disk("preprocessed_dataset")

Menggunakan dataset Hugging Face dengan TorchTune

- Dapat memakai dataset Hugging Face dengan TorchTune

- Tetapkan path dataset dan konfigurasi

tune run full_finetune_single_device --config llama3/8B_full_single_device \

dataset=preprocessed_dataset dataset.split=train

Ayo berlatih!

Fine-Tuning dengan Llama 3