Bonus entropi dan PPO

Deep Reinforcement Learning dengan Python

Timothée Carayol

Principal Machine Learning Engineer, Komment

Bonus entropi

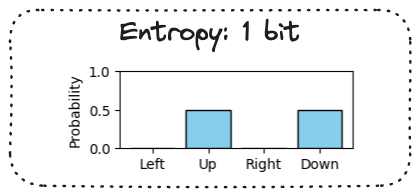

- Algoritme policy gradient bisa runtuh jadi kebijakan deterministik

- Solusi: tambahkan bonus entropi

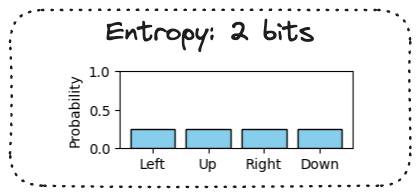

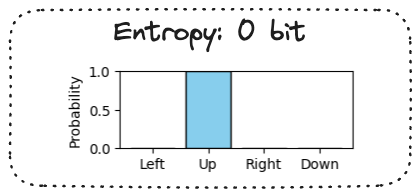

- Entropi mengukur ketidakpastian suatu distribusi!

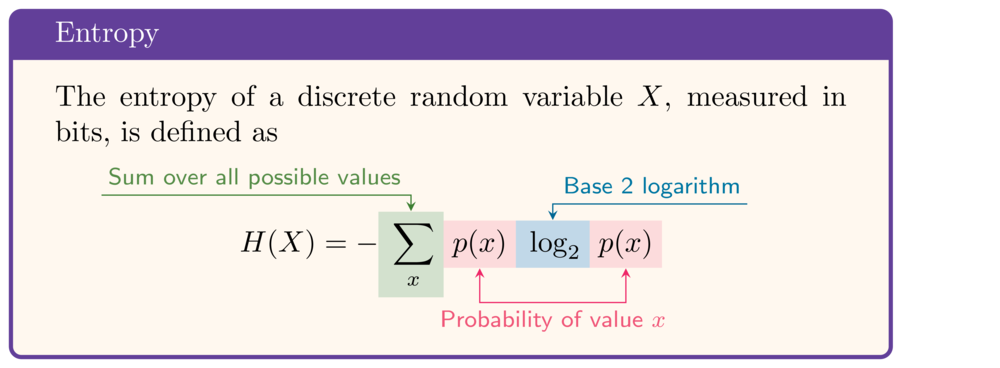

Entropi distribusi probabilitas

- Jika $\ln$ alih-alih $\log_2$: hasil diukur dalam nat.

- $1\ nat = \frac{1}{\ln 2}\ bit \approx 1{,}44\ bit$

Mengimplementasikan bonus entropi

def select_action(policy_network, state): action_probs = policy_network(state) action_dist = Categorical(action_probs) action = action_dist.sample() log_prob = action_dist.log_prob(action)# Obtain the entropy of the policy entropy = action_dist.entropy()return (action.item(), log_prob.reshape(1), entropy)

- Rugi actor:

actor_loss -= c_entropy * entropy - Catatan:

Categorical.entropy()dalam nat; bagi denganmath.log(2)untuk bit

Loop pelatihan PPO

for episode in range(10):

state, info = env.reset()

done = False

while not done:

action, action_log_prob, entropy = select_action(actor, state)

next_state, reward, terminated, truncated, _ = env.step(action)

done = terminated or truncated

actor_loss, critic_loss = calculate_losses(critic, action_log_prob, action_log_prob,

reward, state, next_state, done)

actor_loss -= c_entropy * entropy

actor_optimizer.zero_grad(); actor_loss.backward(); actor_optimizer.step()

critic_optimizer.zero_grad(); critic_loss.backward(); critic_optimizer.step()

state = next_state

Menuju PPO dengan pembaruan batch

- Memperbarui di tiap langkah: tidak memanfaatkan penuh objektif PPO

- Di tiap langkah, $\theta$ sebenarnya sama dengan $\theta_{old}$.

- Implementasi PPO penuh memisahkan:

- Pembaruan parameter (minibatch)

- Pembaruan kebijakan (rollout)

Ayo berlatih!

Deep Reinforcement Learning dengan Python