Proximal policy optimization

Deep Reinforcement Learning dengan Python

Timothée Carayol

Principal Machine Learning Engineer, Komment

A2C

- Pembaruan kebijakan A2C:

- Berdasar estimasi yang mudah berubah

- Bisa besar dan tidak stabil

- Dapat menurunkan kinerja

PPO

- PPO membatasi besar tiap pembaruan kebijakan

- Meningkatkan stabilitas

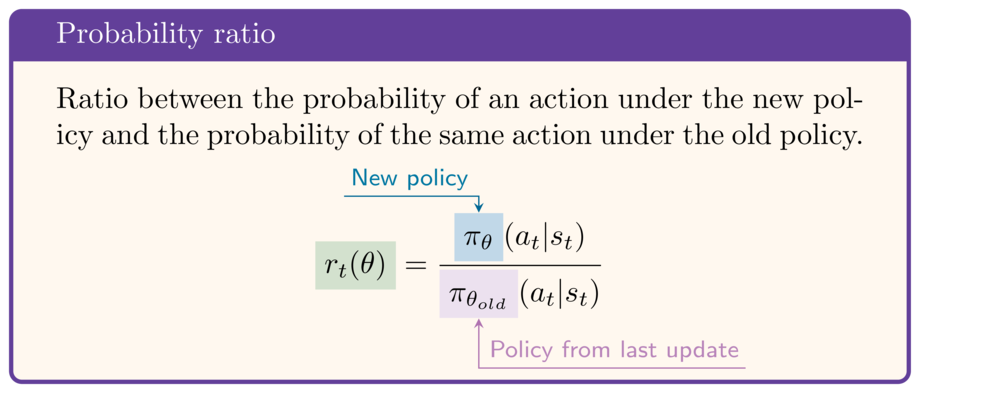

Rasio probabilitas

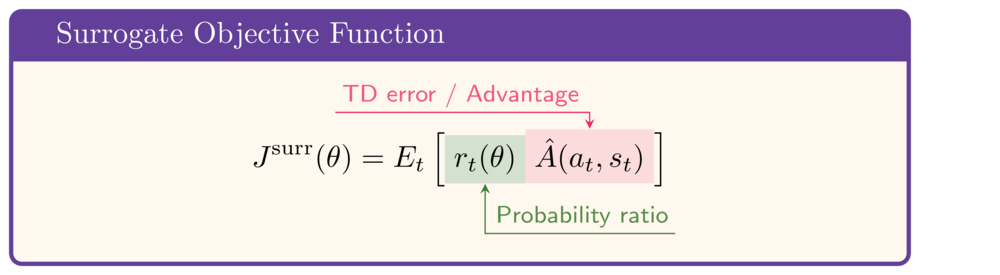

- Inovasi utama PPO: fungsi objektif baru

- Intinya:

- Seberapa lebih mungkin aksi $a_t$ dengan $\theta$ dibanding $\theta_{old}$?

ratio = action_log_prob.exp() / old_action_log_prob.exp().detach()# Or equivalently ratio = torch.exp(action_log_prob - old_action_log_prob.detach())

detachpembilang bawah untuk mencegah propagasi gradien

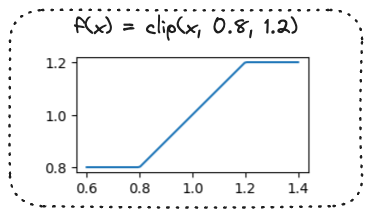

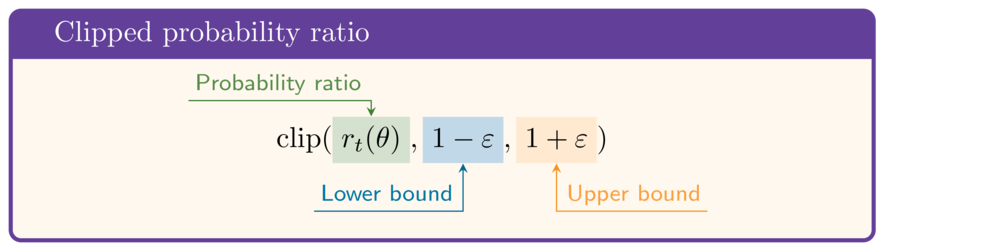

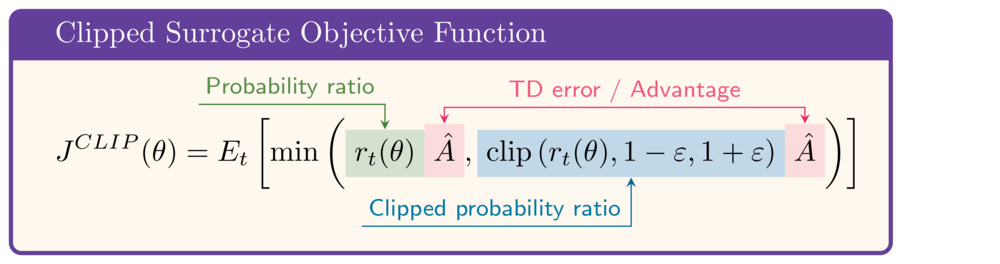

Mengklip rasio probabilitas

- Fungsi clip:

clipped_ratio = torch.clamp(ratio,

1-epsilon,

1+epsilon)

Fungsi calculate_ratios

def calculate_ratios(action_log_prob, action_log_prob_old, epsilon):prob = action_log_prob.exp() prob_old = action_log_prob_old.exp() prob_old_detached = prob_old.detach() ratio = prob / prob_old_detached clipped_ratio = torch.clamp(ratio, 1-epsilon, 1+epsilon)return (ratio, clipped_ratio)

Contoh dengan epsilon = .2:Rasio: tensor(1.25)Rasio terklip: tensor(1.20)

Fungsi objektif PPO

surr1 = ratio * td_error.detach()surr2 = clipped_ratio * td_error.detach()objective = torch.min(surr1, surr2)

- Surrogate dengan rasio terklip:

$$\mathrm{clip}(r_t(\theta),1-\varepsilon,1+\varepsilon)\hat{A}$$

- Fungsi objektif surrogate terklip PPO:

- Lebih stabil daripada A2C

Perhitungan loss PPO

def calculate_losses(critic_network,

action_log_prob,

action_log_prob_old,

reward, state, next_state,

done

):

# hitung galat TD (sama seperti A2C)

value = critic_network(state)

next_value = critic_network(next_state)

td_target = (reward +

gamma * next_value * (1-done))

td_error = td_target - value

...

... ratio, clipped_ratio = calculate_ratios(action_log_prob, action_log_prob_old, epsilon)surr1 = ratio * td_error.detach()surr2 = clipped_ratio * td_error.detach()objective = torch.min(surr1, surr2)actor_loss = -objectivecritic_loss = td_error ** 2 return actor_loss, critic_loss

Ayo berlatih!

Deep Reinforcement Learning dengan Python