Pencarian Terinformasikan: Kasar ke Halus

Penyetelan Hyperparameter di Python

Alex Scriven

Data Scientist

Pencarian Terinformasikan vs Tidak Terinformasikan

Sejauh ini semua yang kita lakukan adalah pencarian tidak terinformasikan:

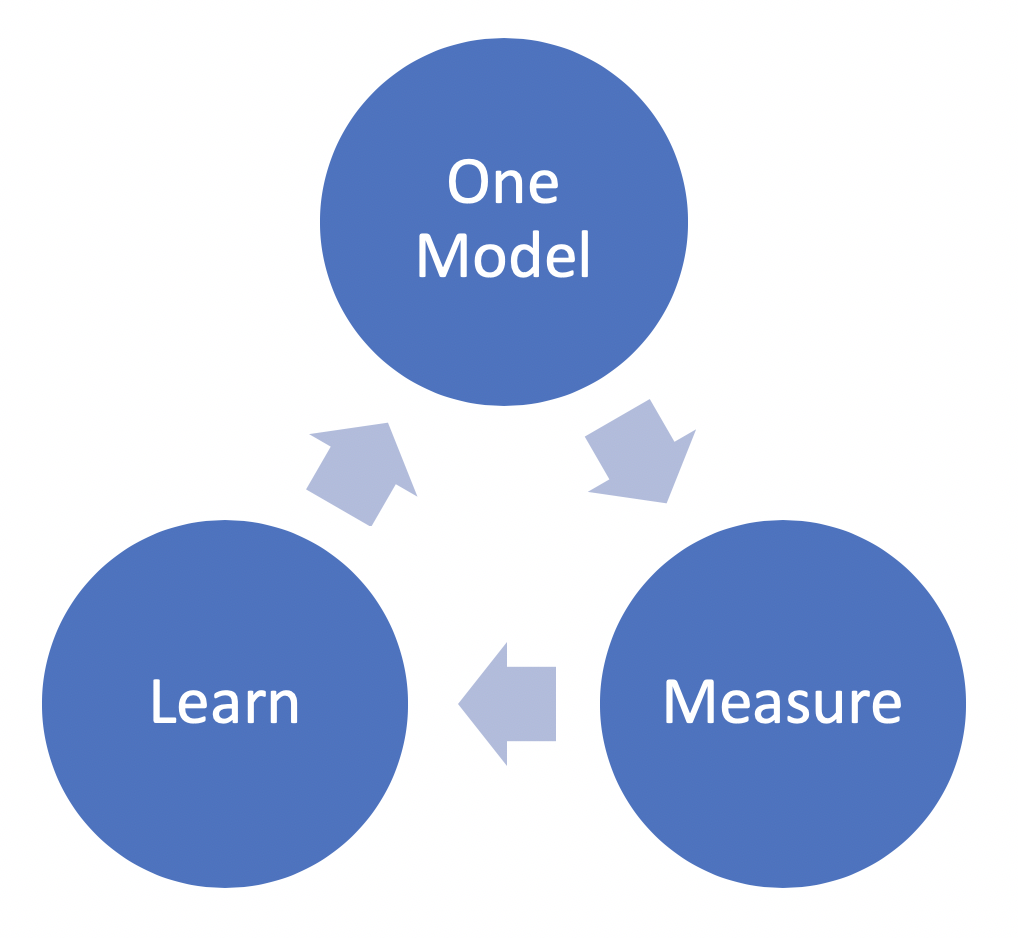

Pencarian tidak terinformasikan: Setiap iterasi penyetelan hyperparameter tidak belajar dari iterasi sebelumnya.

Ini yang memungkinkan kita memparalelkan pekerjaan. Namun ini terdengar kurang efisien?

Terinformasikan vs Tidak Terinformasikan

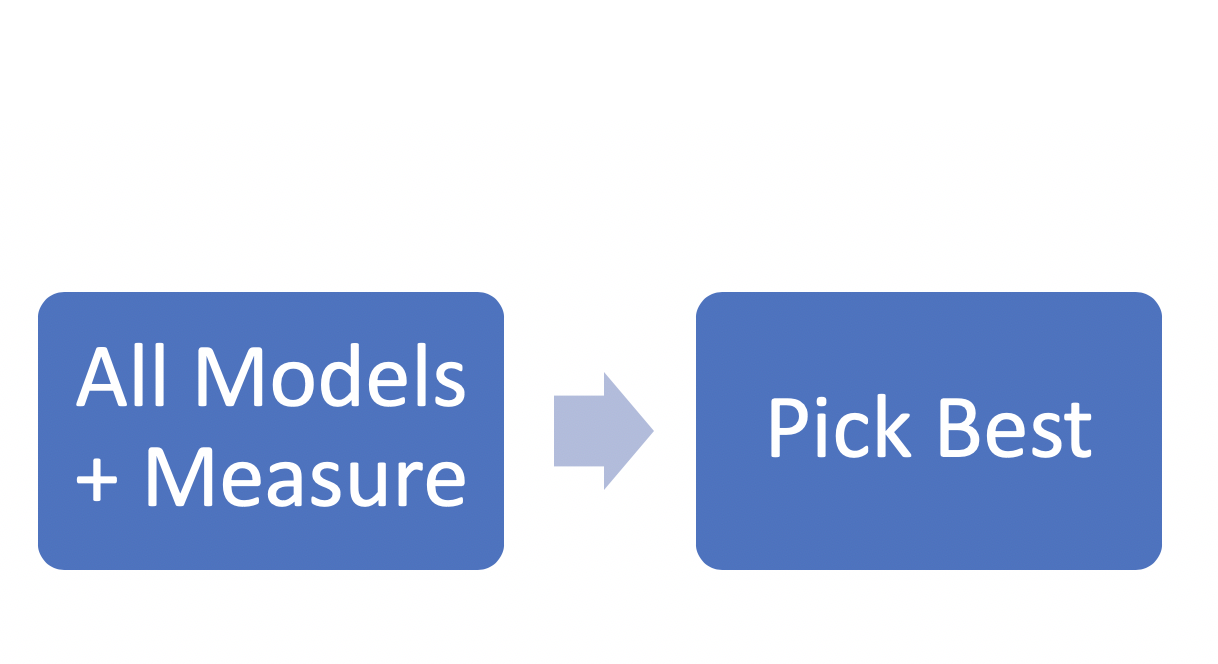

Proses sejauh ini:

Cara alternatif:

Penyetelan Kasar ke Halus

Metodologi dasar pencarian terinformasikan:

Mulai dengan pendekatan acak yang kasar lalu perhalus secara iteratif.

Prosesnya:

- Pencarian acak

- Temukan area menjanjikan

- Pencarian grid di area yang lebih kecil

- Lanjutkan hingga skor optimal diperoleh

Anda bisa mengganti (3) dengan pencarian acak lanjutan sebelum pencarian grid

Mengapa Kasar ke Halus?

Penyetelan kasar ke halus memiliki beberapa keunggulan:

- Memanfaatkan kelebihan pencarian grid dan acak.

- Pencarian lebar di awal

- Pencarian lebih dalam setelah Anda tahu area yang berpotensi baik

- Waktu dan komputasi lebih efektif sehingga iterasi lebih cepat

Tidak perlu membuang waktu pada ruang pencarian yang tidak memberi hasil baik!

Catatan: Ini terinformasikan pada batch, bukan satu model

Menerapkan Kasar ke Halus

Mari ambil contoh dengan rentang hyperparameter berikut:

max_depth_listantara 1 dan 65min_sample_listantara 3 dan 17learn_rate_list150 nilai antara 0.01 dan 150

Berapa banyak model yang mungkin?

combinations_list = [list(x) for x in product(max_depth_list, min_sample_list, learn_rate_list)]

print(len(combinations_list))

134400

Memvisualisasikan Kasar ke Halus

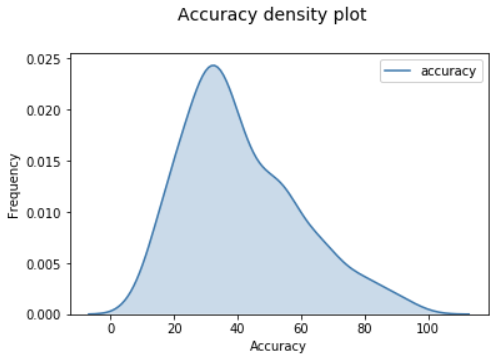

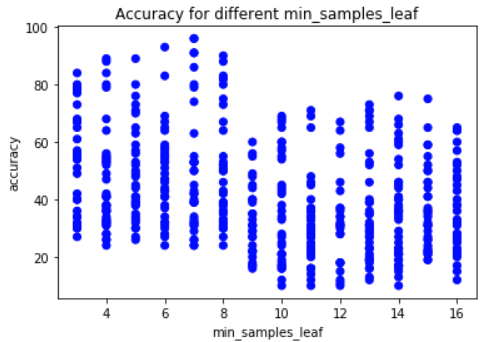

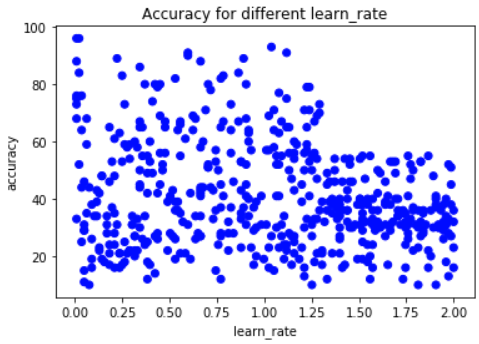

Mari lakukan pencarian acak pada 500 kombinasi saja.

Berikut plot skor akurasi:

Model mana yang bagus?

Memvisualisasikan Kasar ke Halus

Hasil teratas:

| max_depth | min_samples_leaf | learn_rate | accuracy |

|---|---|---|---|

| 10 | 7 | 0.01 | 96 |

| 19 | 7 | 0.023355705 | 96 |

| 30 | 6 | 1.038389262 | 93 |

| 27 | 7 | 1.11852349 | 91 |

| 16 | 7 | 0.597651007 | 91 |

Memvisualisasikan Kasar ke Halus

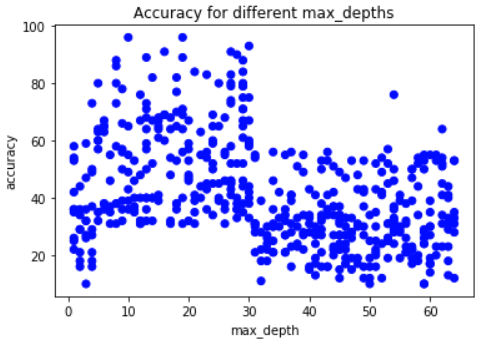

Mari visualisasikan nilai max_depth vs skor akurasi:

Memvisualisasikan Kasar ke Halus

min_samples_leaf lebih baik di bawah 8

learn_rate lebih buruk di atas 1.3

Langkah berikutnya

Yang kita tahu dari iterasi pertama:

max_depthantara 8 dan 30learn_ratekurang dari 1.3min_samples_leafmungkin kurang dari 8

Langkah berikutnya? Pencarian acak atau grid lagi dengan pengetahuan ini!

Catatan: Ini hanya analisis bivariat. Anda bisa mengeksplorasi banyak hyperparameter (3, 4, atau lebih!) dalam satu grafik, tetapi itu di luar cakupan kursus ini.

Ayo berlatih!

Penyetelan Hyperparameter di Python