Metode mengumpulkan umpan balik berkualitas tinggi

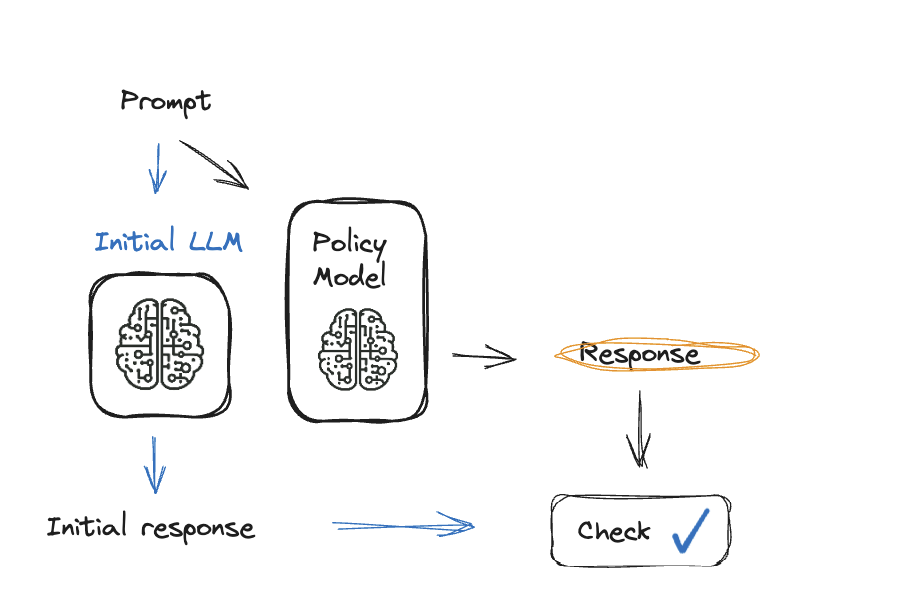

Reinforcement Learning from Human Feedback (RLHF)

Mina Parham

AI Engineer

Metode mengumpulkan umpan balik berkualitas tinggi

Metode mengumpulkan umpan balik berkualitas tinggi

Perbandingan berpasangan

- Memilih antara dua opsi:

- Kelebihan: Sederhana, intuitif, kurangi bias

- Tantangan: Info per label lebih sedikit

- Contoh: Film A vs. Film B: "Mana yang Anda pilih?

Perbandingan berpasangan

def evaluate_responses(responses_A, responses_B):

wins_A, wins_B = 0, 0

for (response_A, score_A), (response_B, score_B) in zip(responses_A, responses_B):

if score_A > score_B:

wins_A += 1

else:

wins_B += 1

success_rate_A = (wins_A / len(responses_A)) * 100

success_rate_B = (wins_B / len(responses_B)) * 100

return success_rate_A, success_rate_B

Rating

Memberi skor pada skala:

Kelebihan: Umpan balik lebih rinci

- Tantangan: Rentan bias, skala tidak konsisten

- Contoh:

Film A: 4/5 Film B: 3/5

Faktor psikologis

- Bias Kognitif:

- Framing Effect: Cara pertanyaan disajikan memengaruhi jawaban

- Serial Position Effect: Urutan opsi memengaruhi keputusan

- Anchoring: Info sebelumnya membias keputusan saat ini

Panduan mengumpulkan umpan balik berkualitas tinggi

- Beban kognitif: pengguna lelah, umpan balik tidak konsisten

- Rumuskan pertanyaan dengan cermat

- Untuk mengurangi risiko dari beban kognitif.

- Acak urutan pertanyaan

- Untuk meminimalkan bias karena anchoring dan framing

- Kumpulkan data beragam

- Untuk meredam noise.

Ayo berlatih!

Reinforcement Learning from Human Feedback (RLHF)