Menjelajahi LLM terlatih awal

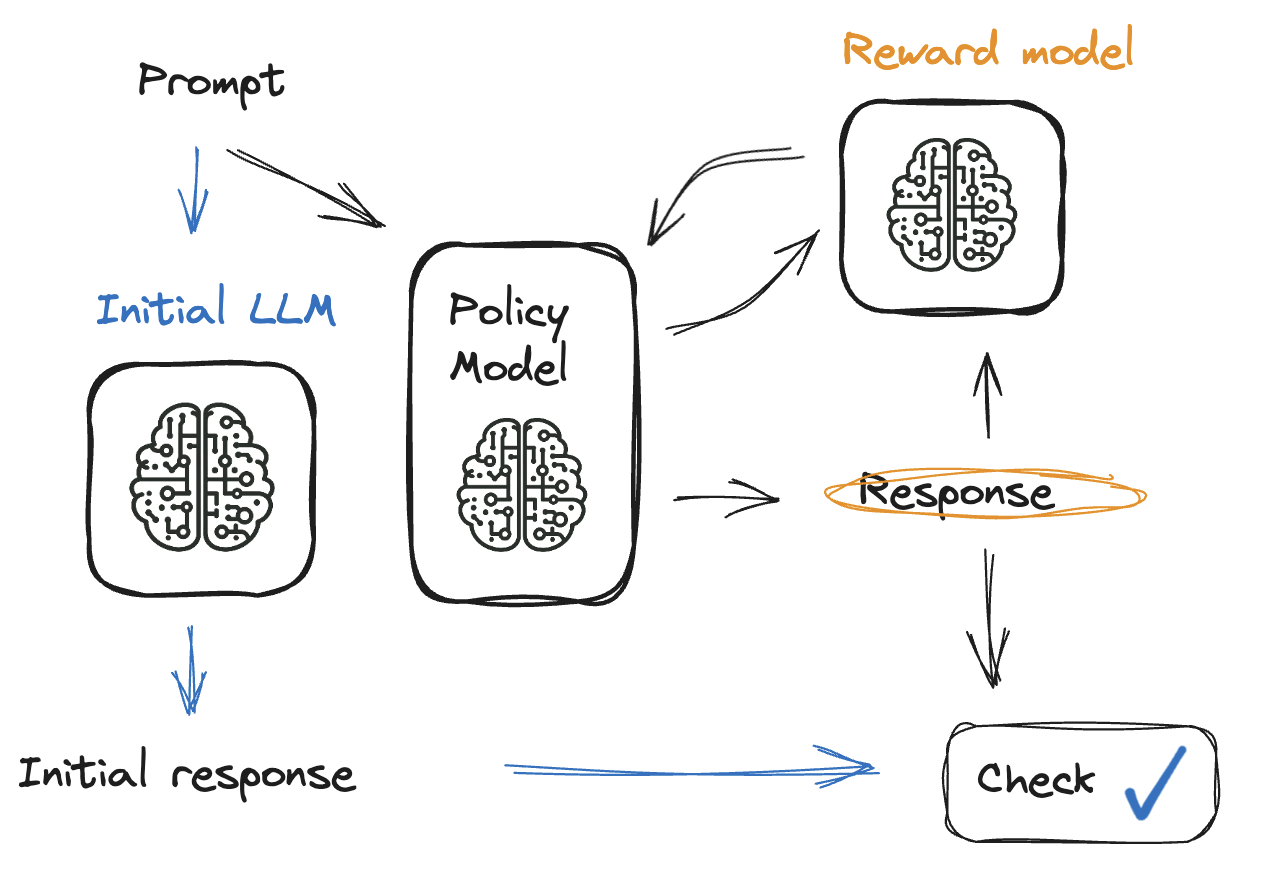

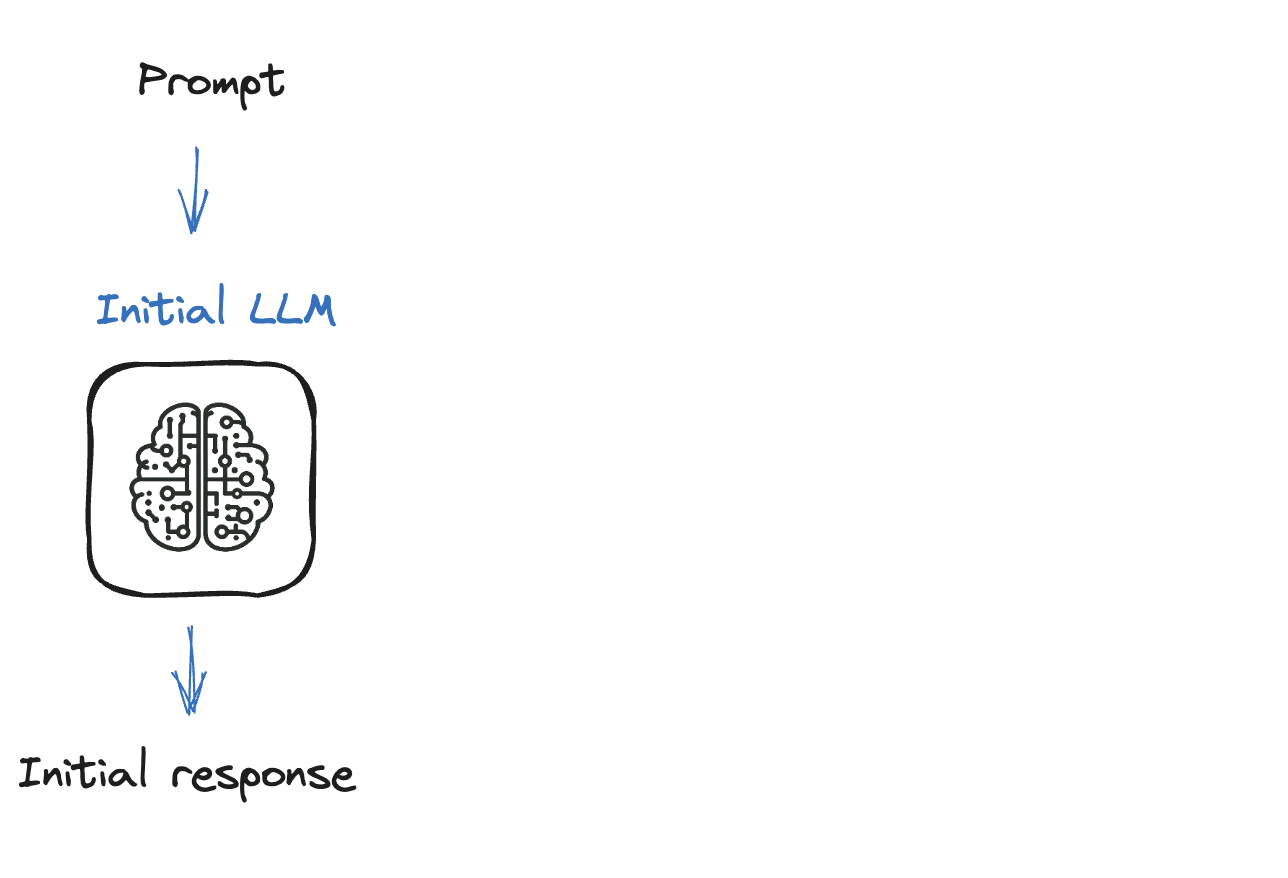

Reinforcement Learning from Human Feedback (RLHF)

Mina Parham

AI Engineer

Pentingnya fine-tuning

Pentingnya fine-tuning

Panduan langkah demi langkah untuk fine-tuning LLM

Panduan langkah demi langkah untuk fine-tuning LLM

Panduan langkah demi langkah untuk fine-tuning LLM

Langkah 1: muat data yang akan digunakan

from datasets import load_dataset

import pandas as pd

# `load_dataset` menyederhanakan pemuatan dan prapemrosesan dataset dari berbagai sumber

# Memberi akses mudah ke banyak dataset dengan setup minimal

dataset = load_dataset("mteb/tweet_sentiment_extraction")

df = pd.DataFrame(dataset['train'])

id text label label_text

0 cb774db0d1 I'd have responded, if I were going 1 neutral

1 549e992a42 Sooo SAD I will miss you in San Diego!!! 0 negative

2 08ac60f138 my boss is bullying me... 0 negative

Langkah 2: pilih model terlatih awal

from transformers import AutoModelForCausalLM

# AutoModelForCausalLM memudahkan pemuatan dan pergantian model

model = AutoModelForCausalLM.from_pretrained("openai-gpt")

- Model kausal: token sebelumnya “menyebabkan” token berikutnya

Langkah 3: tokenizer

from transformers import AutoTokenizer

# `AutoTokenizer` memuat tokenizer yang sesuai untuk model tertentu

tokenizer = AutoTokenizer.from_pretrained("openai-gpt")

tokenizer.add_special_tokens({'pad_token': '[PAD]'})

model.resize_token_embeddings(len(tokenizer))

- Padding: agar batch teks berukuran sama

Langkah 3: tokenizer

def tokenize_function(examples):

tokenized = tokenizer(examples["content"], padding="max_length", truncation=True)

return tokenized

tokenized_datasets = dataset.map(tokenize_function, batched=True)

- Parameter batched: untuk pemrosesan lebih cepat

Langkah 4: fine-tune dengan metode Trainer

training_args = TrainingArguments(

output_dir="test_trainer",

per_device_train_batch_size=1,

per_device_eval_batch_size=1,

gradient_accumulation_steps=4)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_dataset["train"],

eval_dataset=tokenized_dataset["test"])

trainer.train()

Ayo berlatih!

Reinforcement Learning from Human Feedback (RLHF)