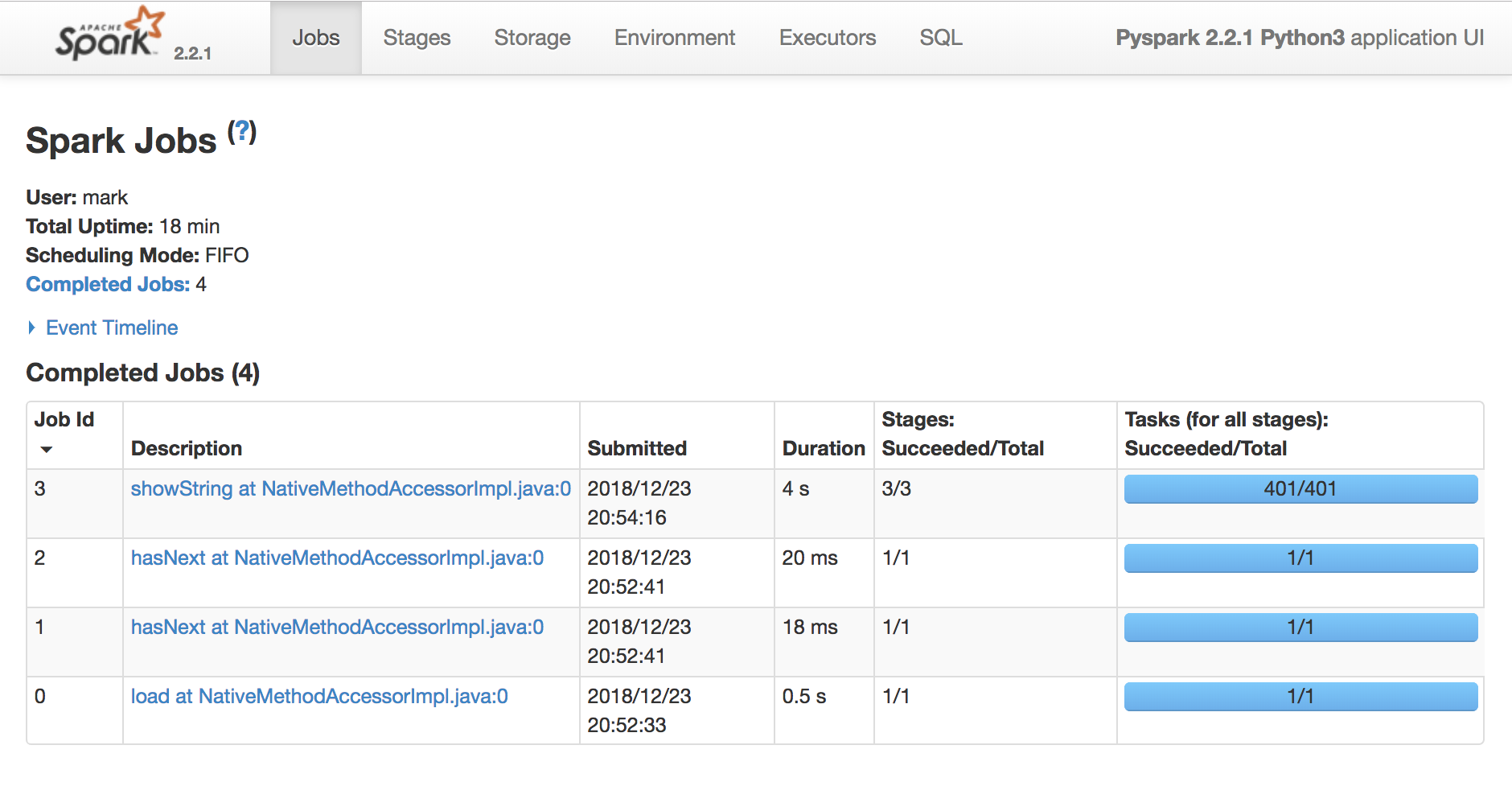

Spark UI

Pengantar Spark SQL dalam Python

Mark Plutowski

Data Scientist

Gunakan Spark UI untuk meninjau eksekusi

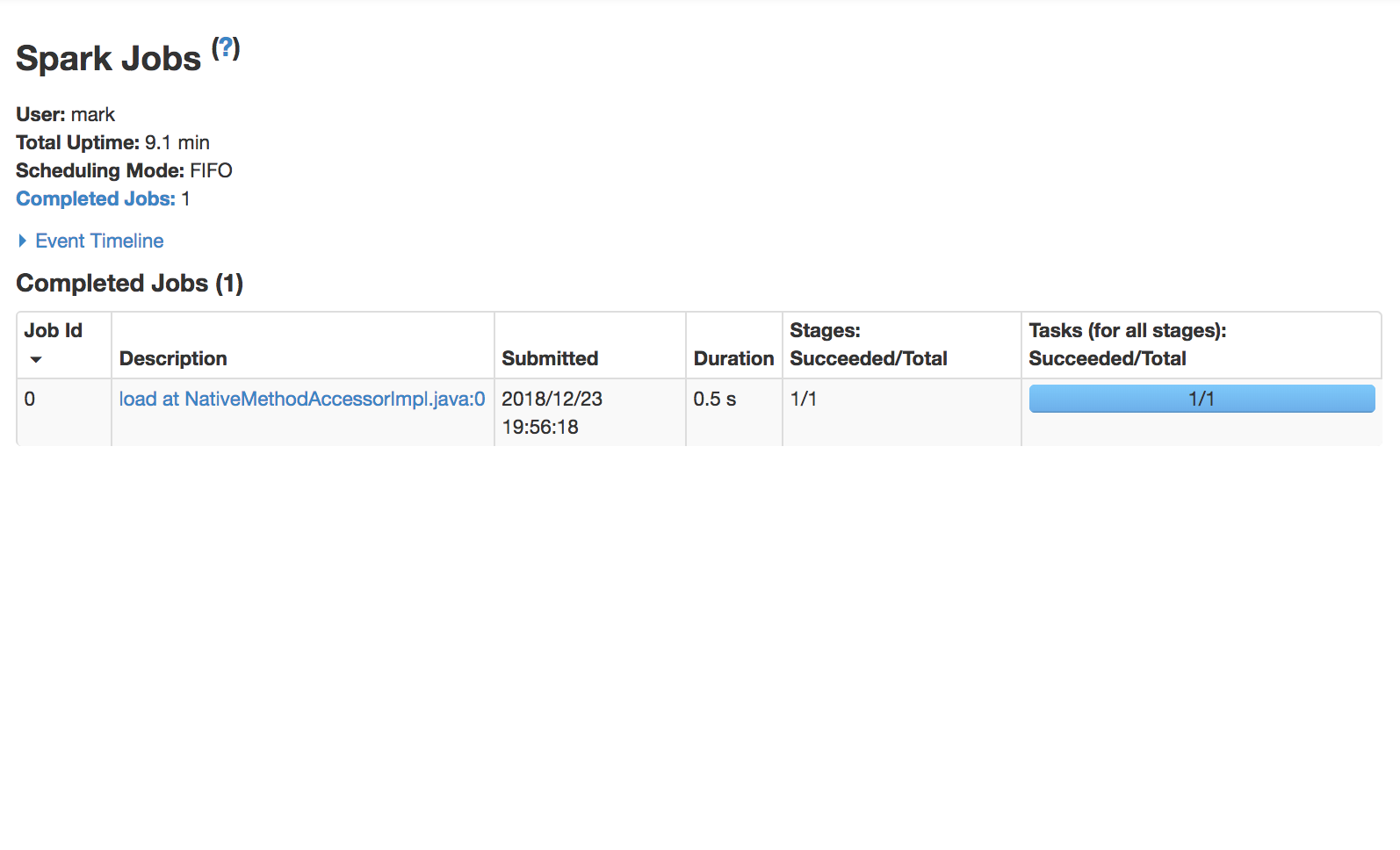

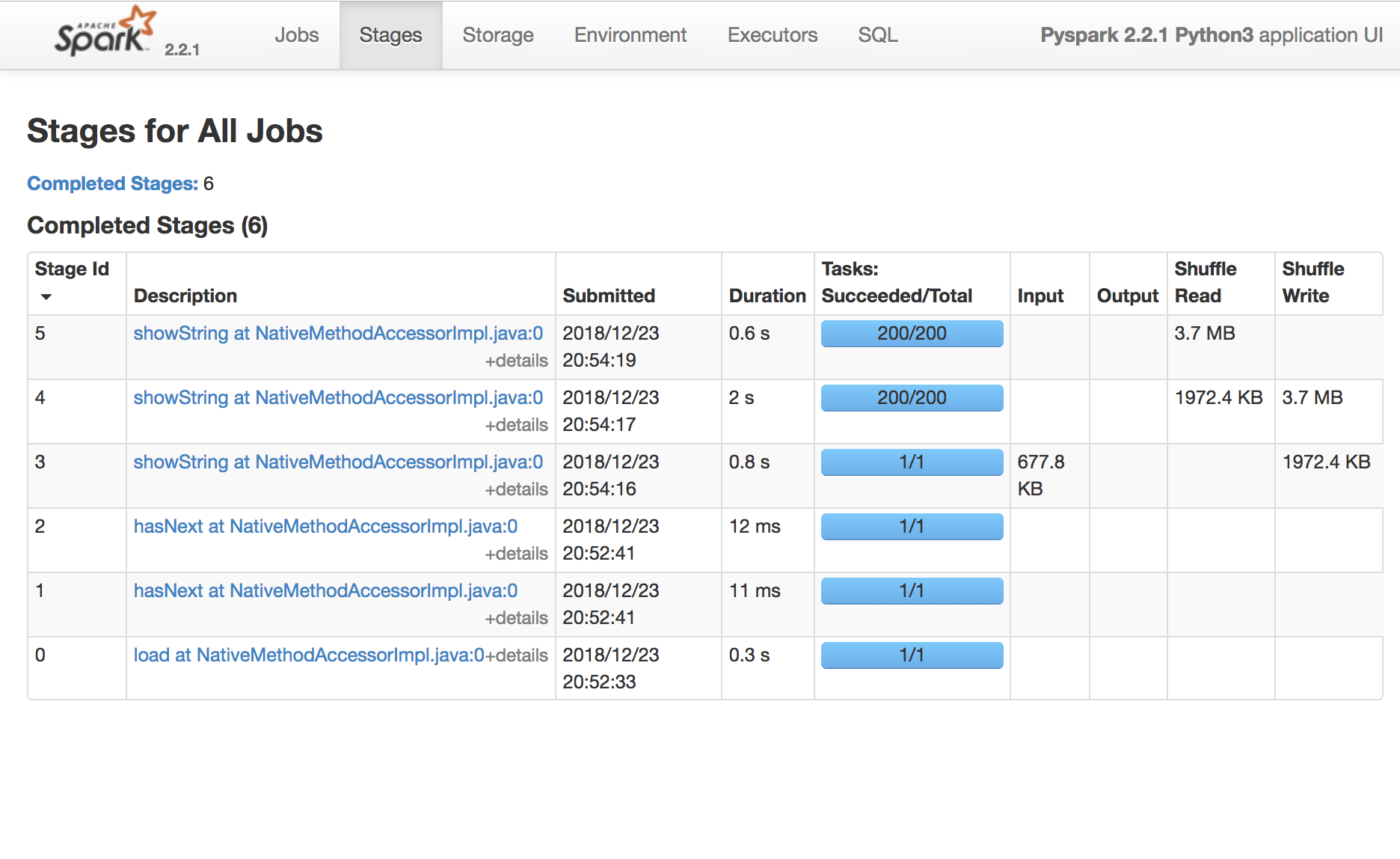

Spark Task adalah unit eksekusi yang berjalan pada satu CPU

Spark Stage adalah grup task yang melakukan komputasi yang sama secara paralel, tiap task biasanya berjalan pada subset data yang berbeda

Spark Job adalah komputasi yang dipicu oleh sebuah action, dipecah menjadi satu atau lebih stage.

Menemukan Spark UI

- http://[DRIVER_HOST]:4040

- http://[DRIVER_HOST]:4041

- http://[DRIVER_HOST]:4042

- http://[DRIVER_HOST]:4043

...

Operasi katalog Spark

spark.catalog.cacheTable('table1')spark.catalog.uncacheTable('table1')spark.catalog.isCached('table1')spark.catalog.dropTempView('table1')

Spark Catalog

spark.catalog.listTables()

[Table(name='text', database=None, description=None, tableType='TEMPORARY', isTemporary=True)]

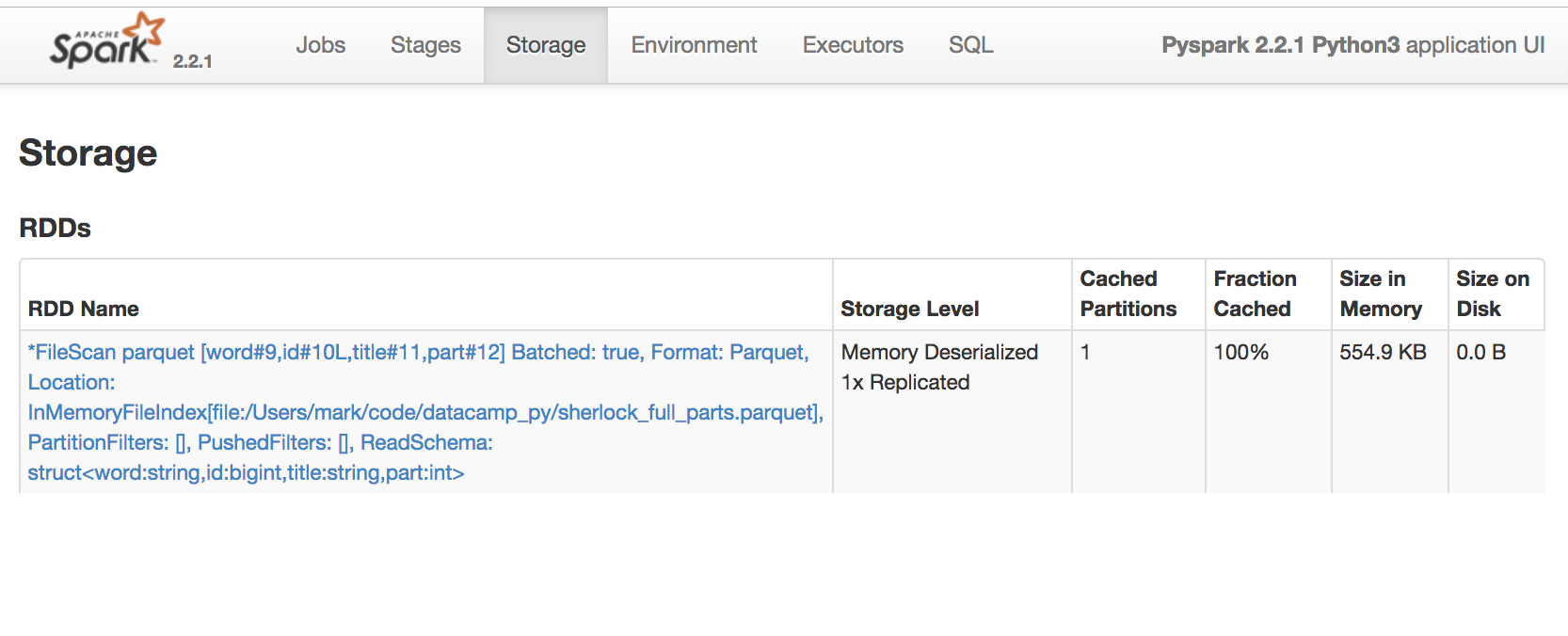

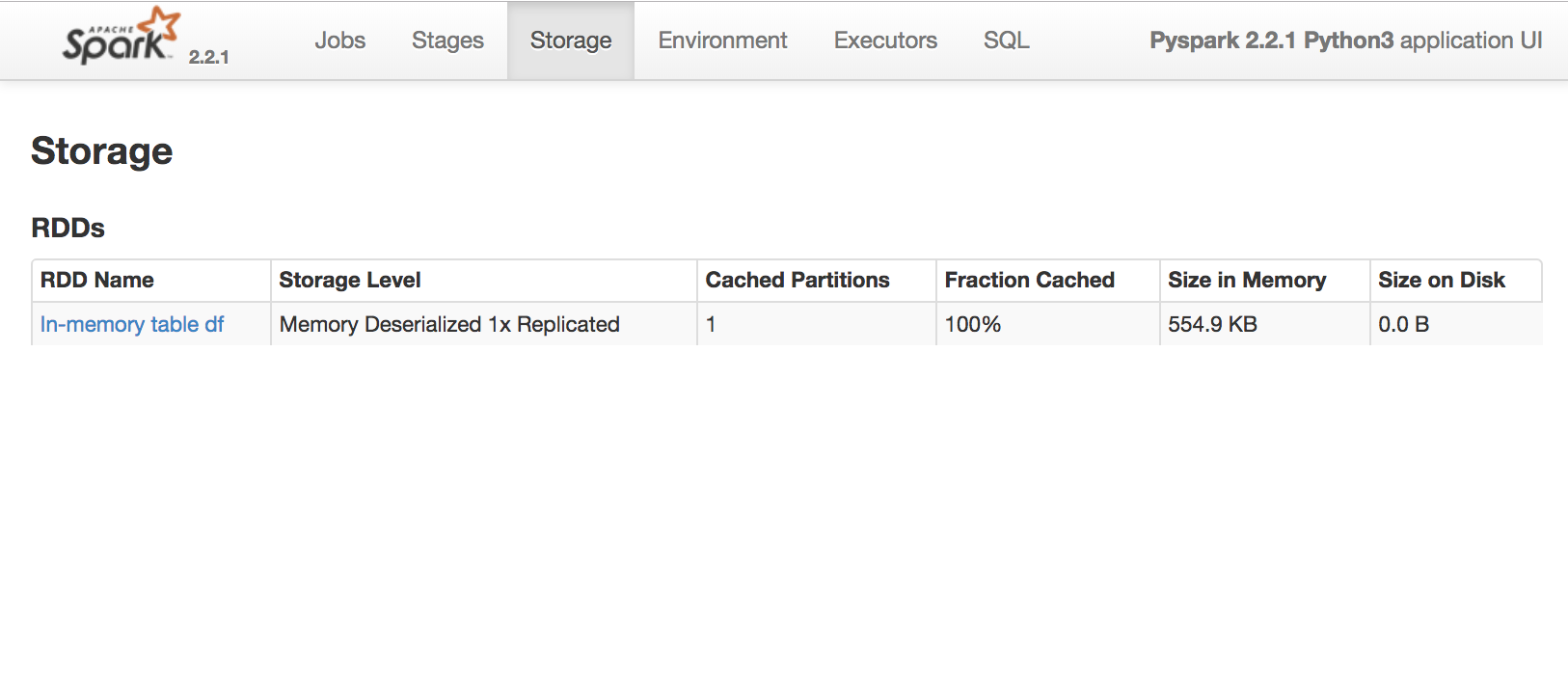

Tab Storage di Spark UI

Menampilkan lokasi partisi data

- di memori,

- atau di disk,

- di seluruh kluster,

- pada satu cuplikan waktu.

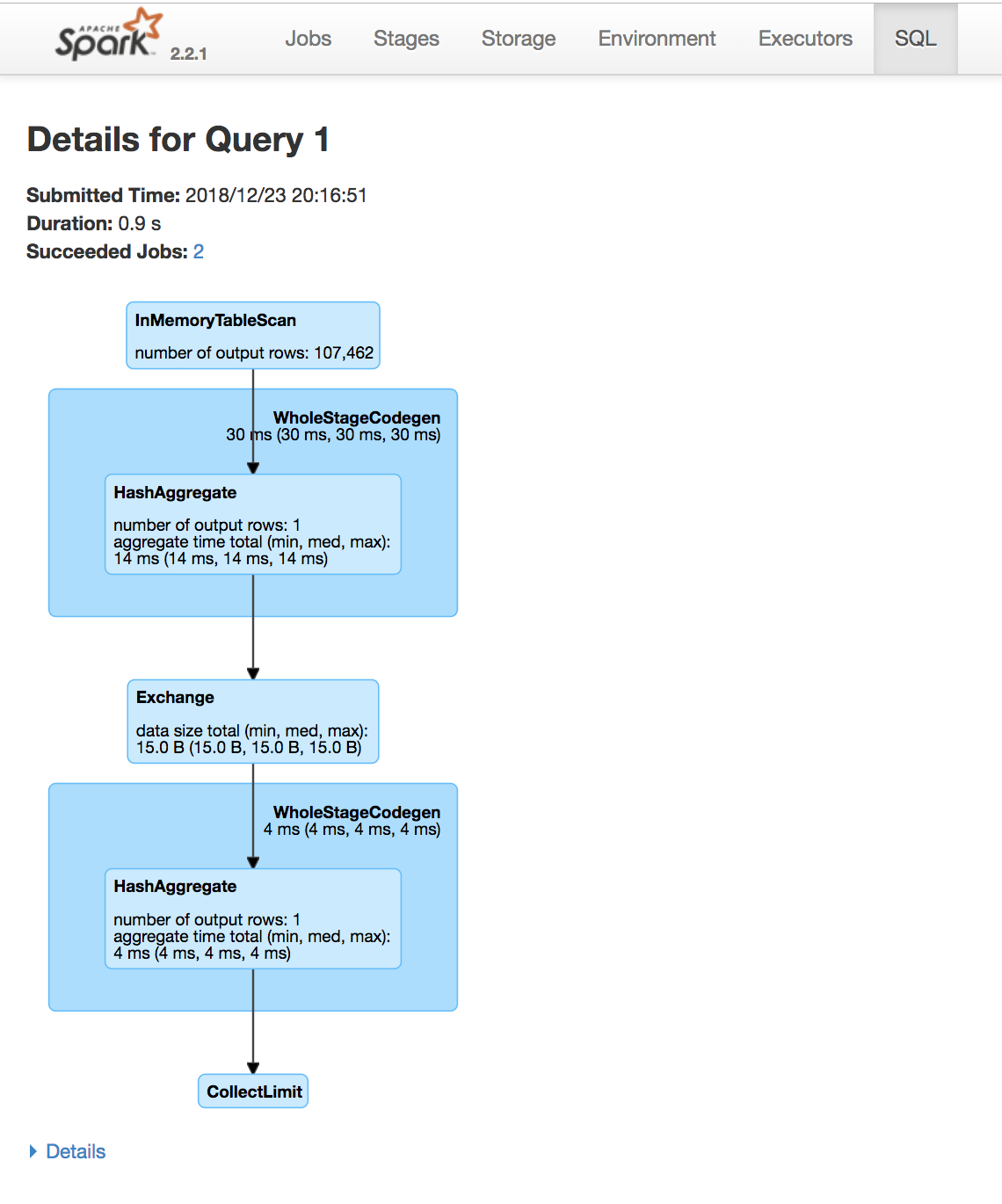

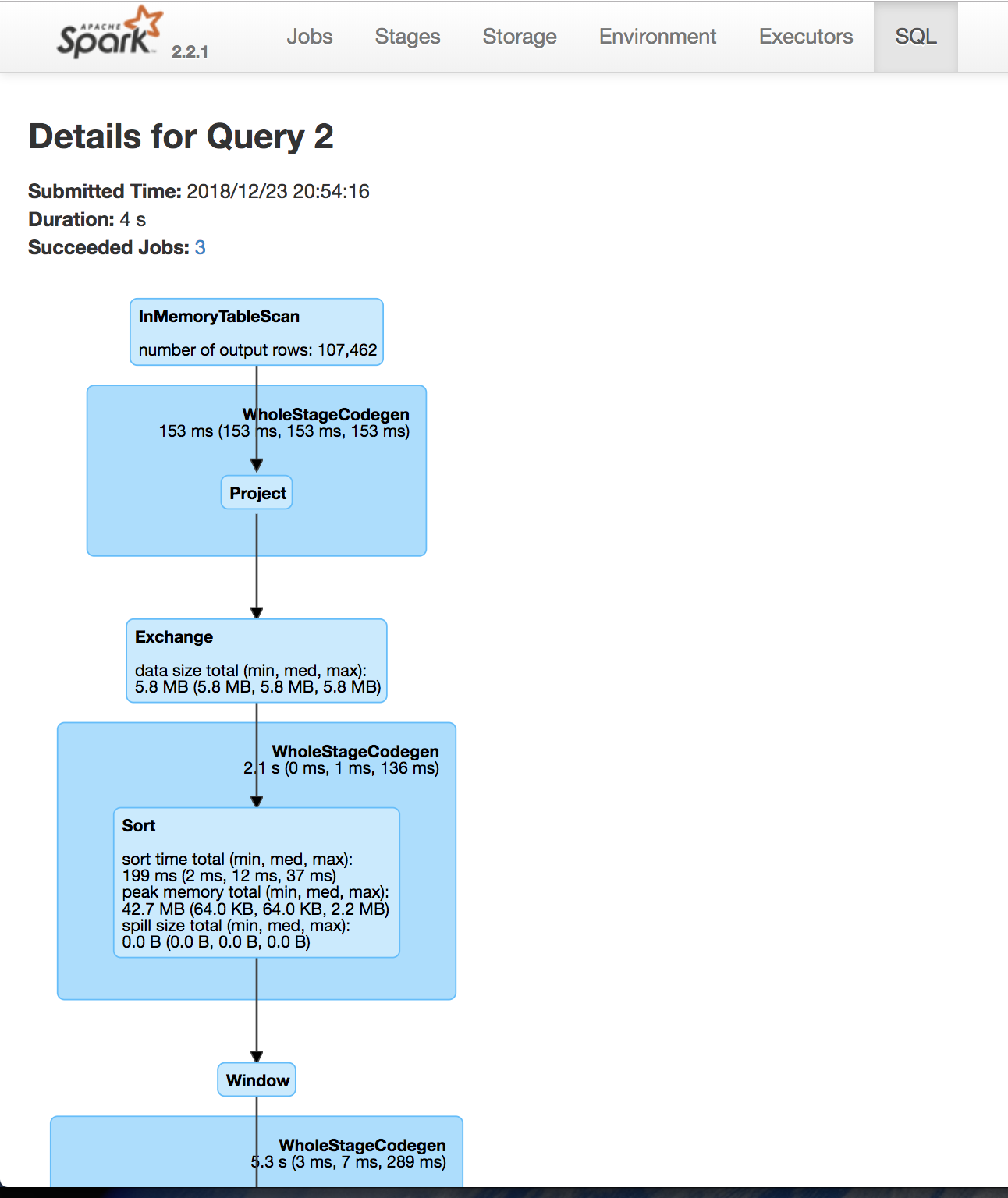

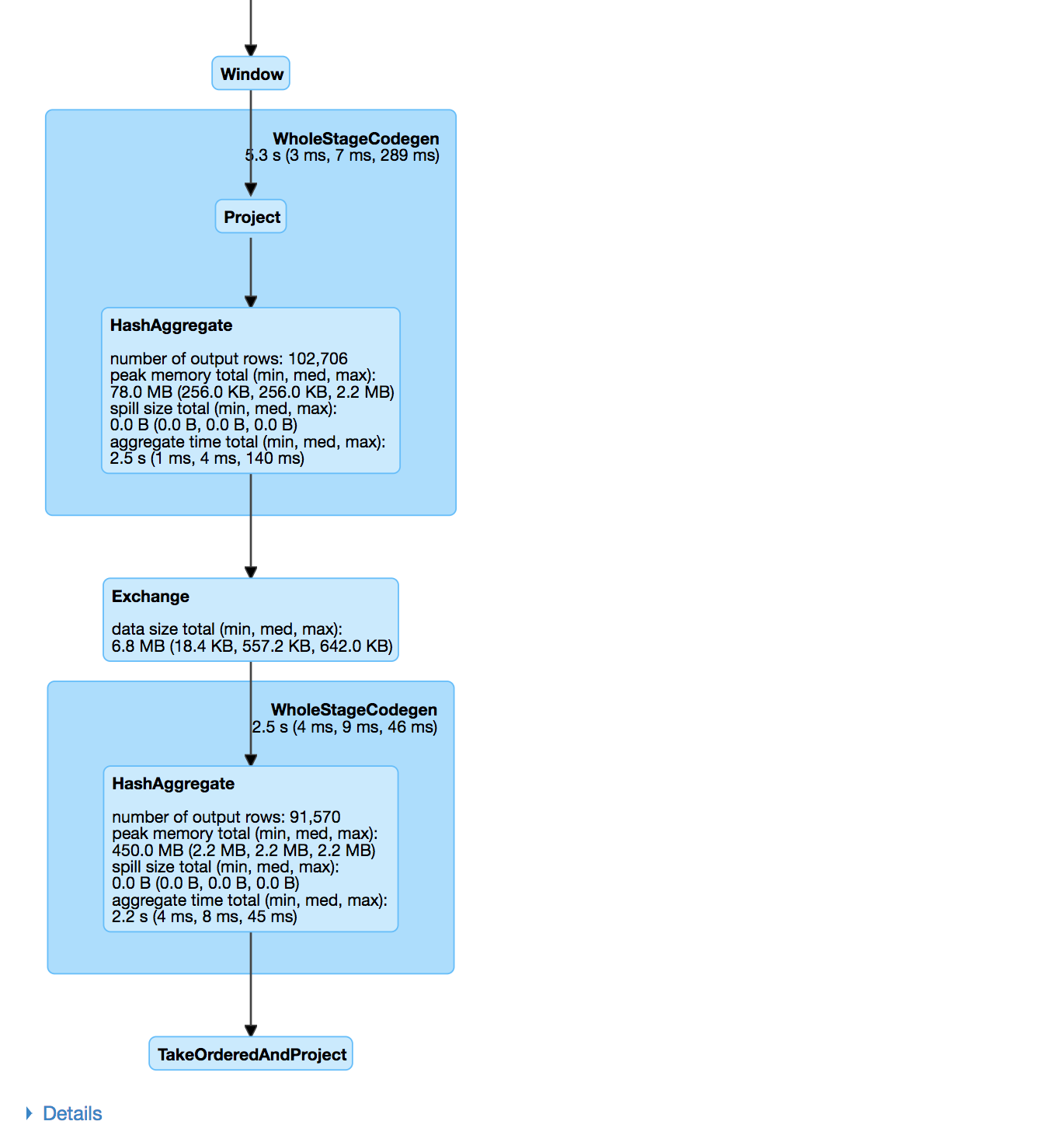

Tab SQL di Spark UI

query3agg = """ SELECT w1, w2, w3, COUNT(*) as count FROM ( SELECT word AS w1, LEAD(word,1) OVER(PARTITION BY part ORDER BY id ) AS w2, LEAD(word,2) OVER(PARTITION BY part ORDER BY id ) AS w3 FROM df ) GROUP BY w1, w2, w3 ORDER BY count DESC """spark.sql(query3agg).show()

Ayo berlatih!

Pengantar Spark SQL dalam Python