Optimisasi tabel Delta Lake

Transformasi dan Analisis Data dengan Microsoft Fabric

Luis Silva

Solution Architect - Data & AI

Apa itu Delta Lake?

- Lapisan penyimpanan open-source untuk lakehouse

- Transaksi ACID, penanganan metadata, dan versioning

- Fabric memakai format tabel Delta Lake (Parquet) sebagai standar

- Interoperabilitas di seluruh pengalaman Fabric

Pemeliharaan tabel

- Jaga tabel Delta tetap optimal

- Operasi pemeliharaan tabel:

- Optimize

- V-Order

- Vacuum

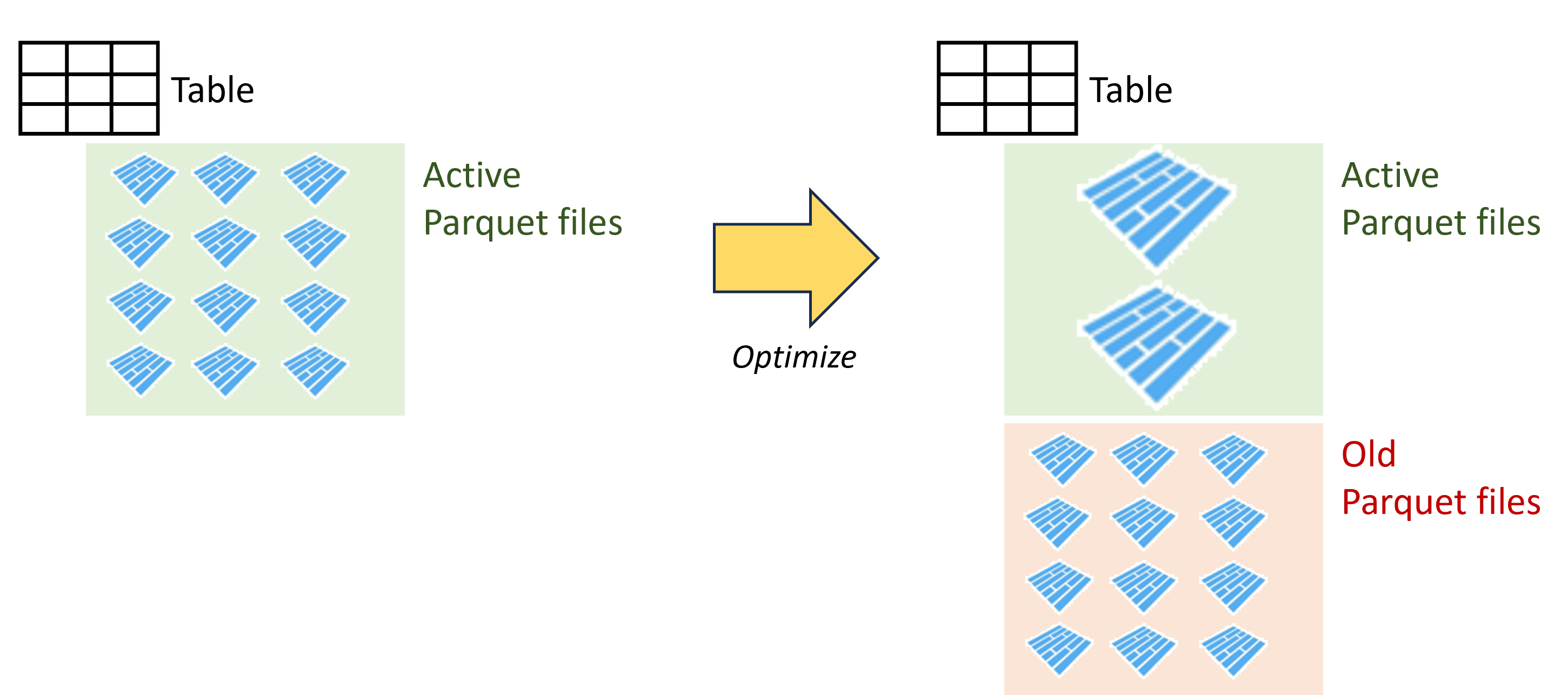

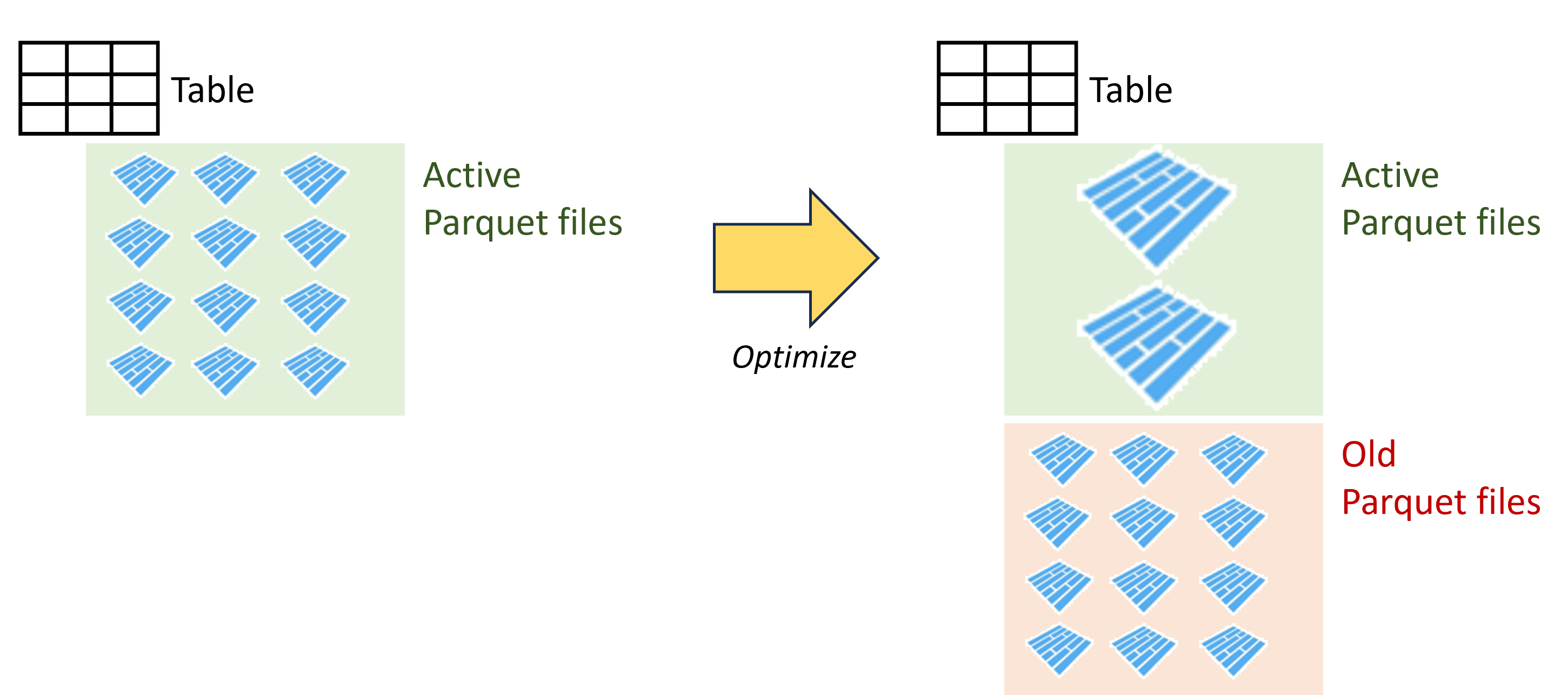

Optimize

- Gabungkan banyak file Parquet kecil menjadi file besar

- Ukuran ideal 128MB–1GB

- Perbaiki kompresi dan distribusi, baca lebih efisien

- Disarankan optimasi setelah memuat tabel besar

Optimize

- Gabungkan banyak file Parquet kecil menjadi file besar

- Ukuran ideal 128MB–1GB

- Perbaiki kompresi dan distribusi, baca lebih efisien

- Disarankan optimasi setelah memuat tabel besar

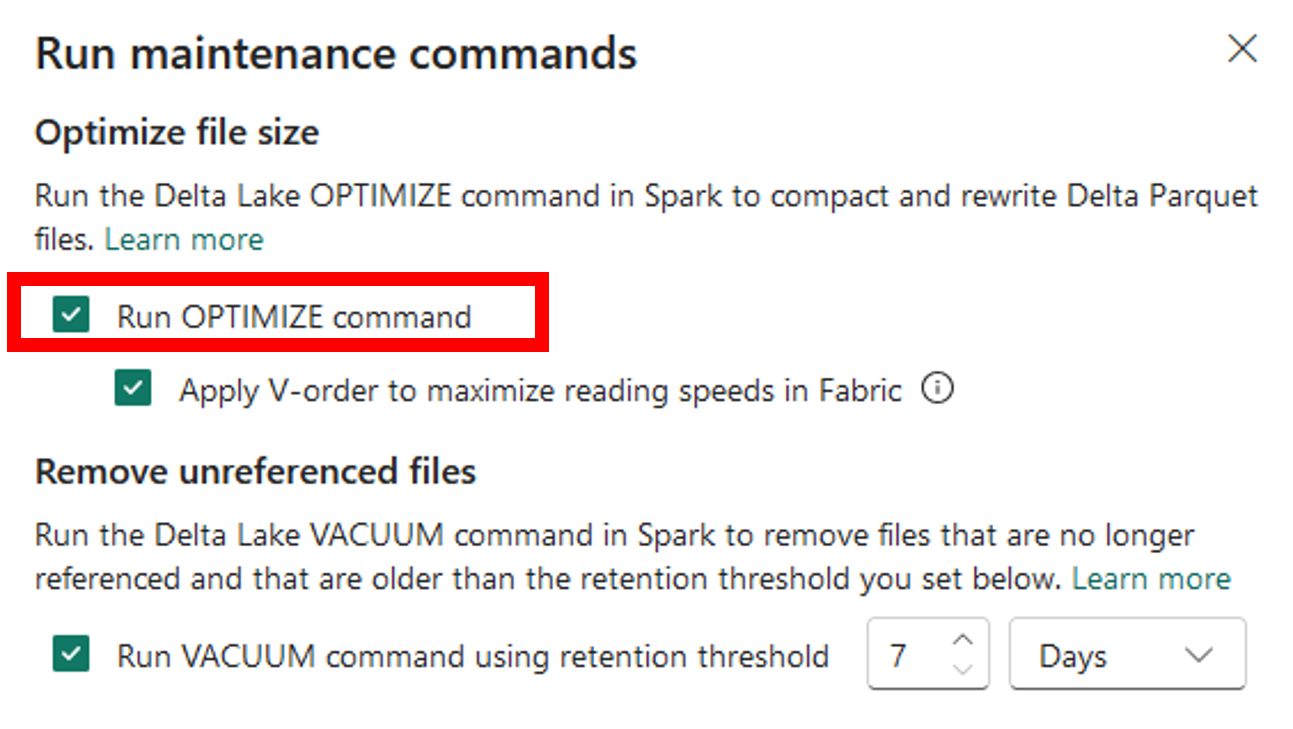

Menjalankan perintah Optimize dari penjelajah Lakehouse

Menjalankan perintah Optimize di Spark SQL

%%sql

OPTIMIZE <lakehouse>.<table>;

Menjalankan perintah Optimize di PySpark

from delta.tables import DeltaTable

dt = DeltaTable.forPath( spark, "Tables/<table>" )

dt.optimize().executeCompaction()

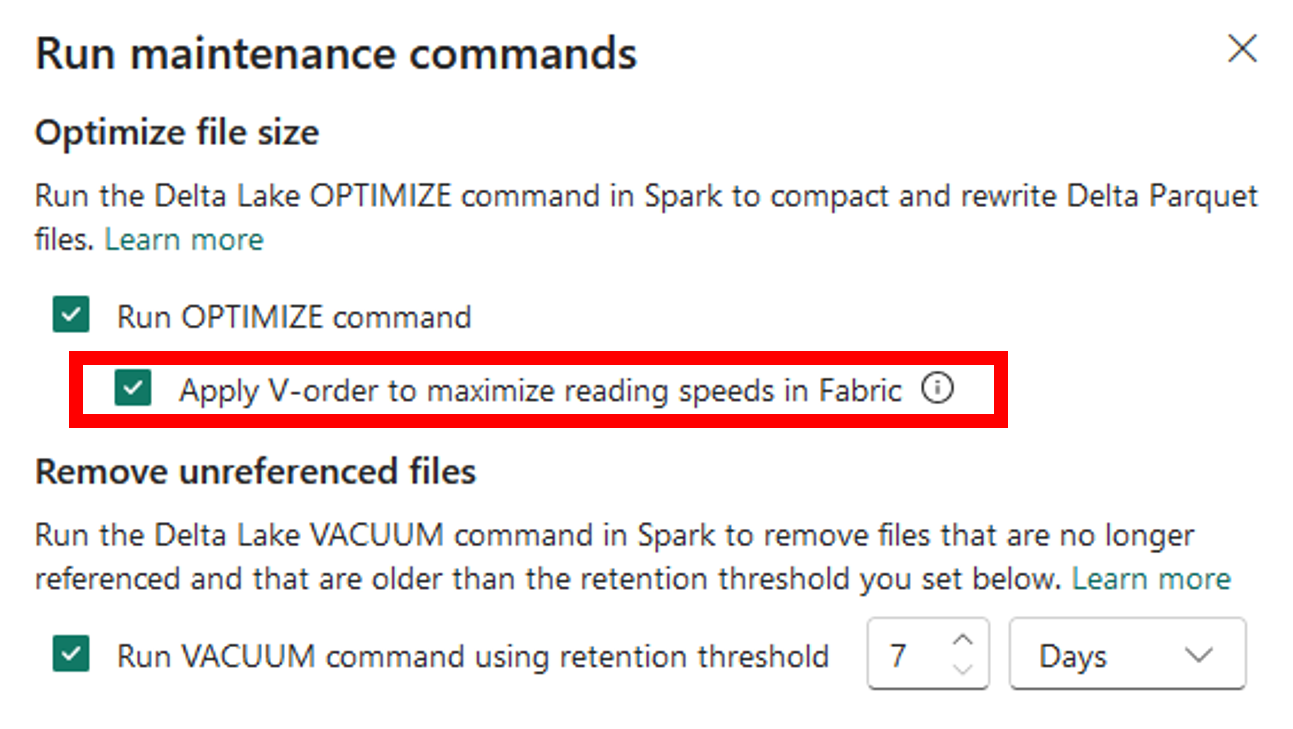

V-Order

- Optimisasi khusus saat menulis file Parquet

- Aktif secara default

Menerapkan V-Order dari penjelajah Lakehouse

Mengatur penulisan V-Order di sesi Apache Spark

Aktifkan V-Order untuk sesi

%%sql SET spark.sql.parquet.vorder.enabled=TRUENonaktifkan V-Order untuk sesi

%%sql SET spark.sql.parquet.vorder.enabled=FALSE

Menerapkan V-Order saat mengoptimalkan tabel

%%sql

OPTIMIZE <table|fileOrFolderPath> VORDER;

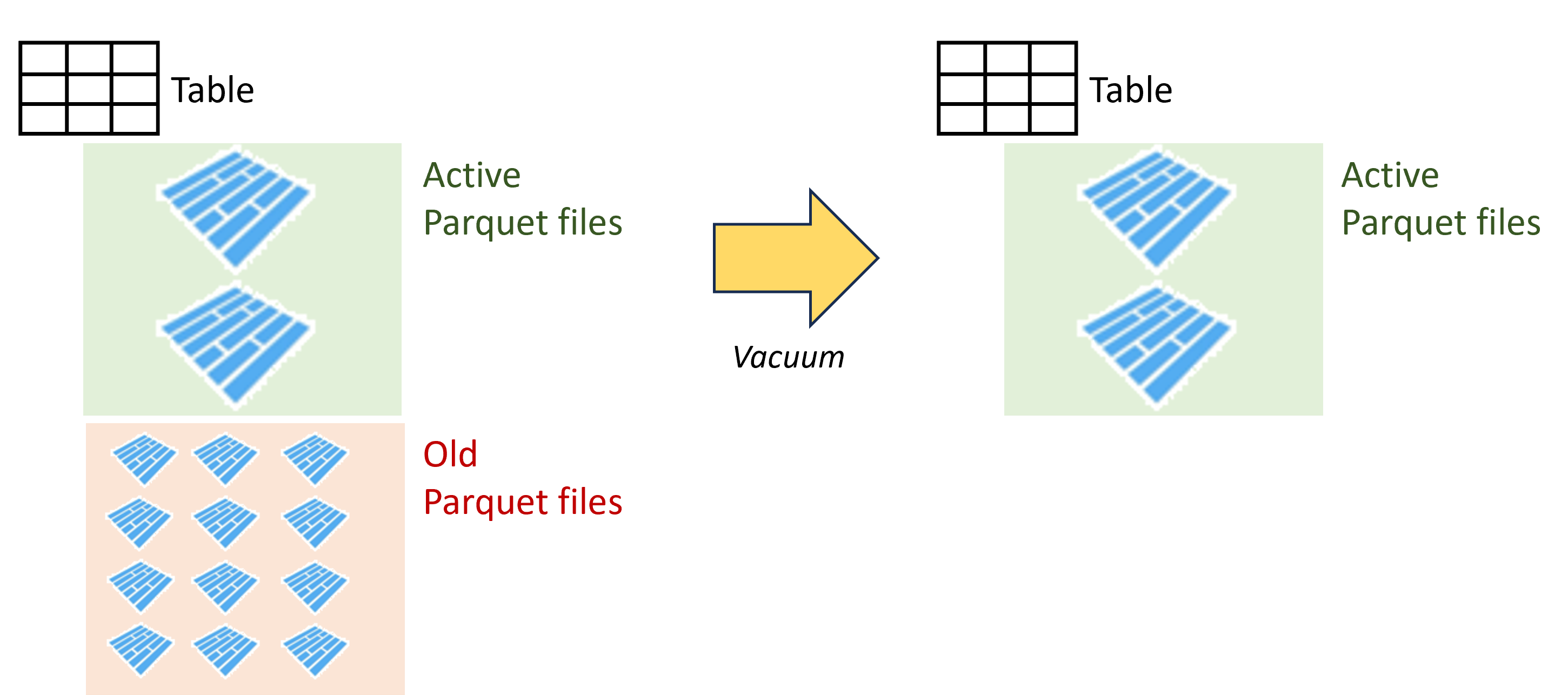

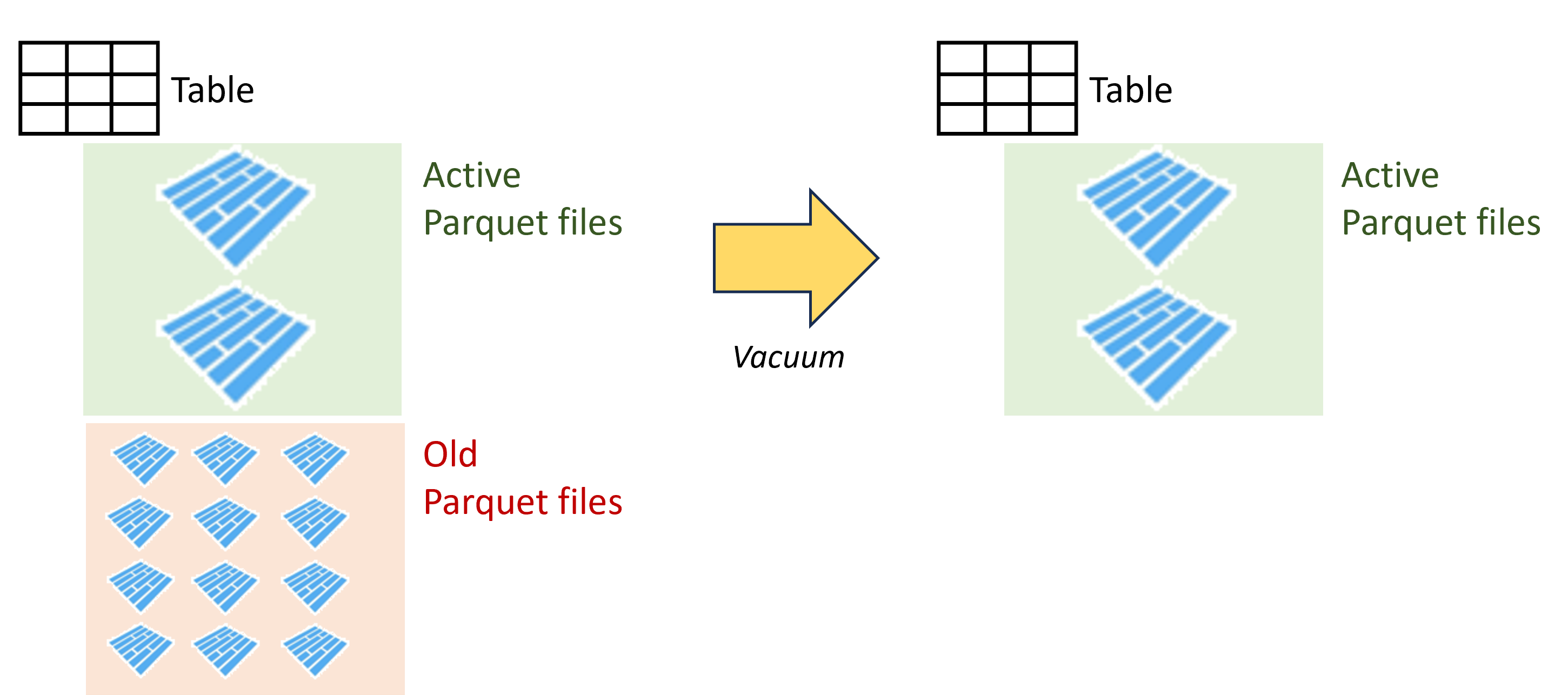

Vacuum

- Hapus file lama yang tidak lagi dibutuhkan dan lebih tua dari ambang retensi

- Kurangi biaya penyimpanan cloud

Vacuum

- Hapus file lama yang tidak lagi dibutuhkan dan lebih tua dari ambang retensi

- Kurangi biaya penyimpanan cloud

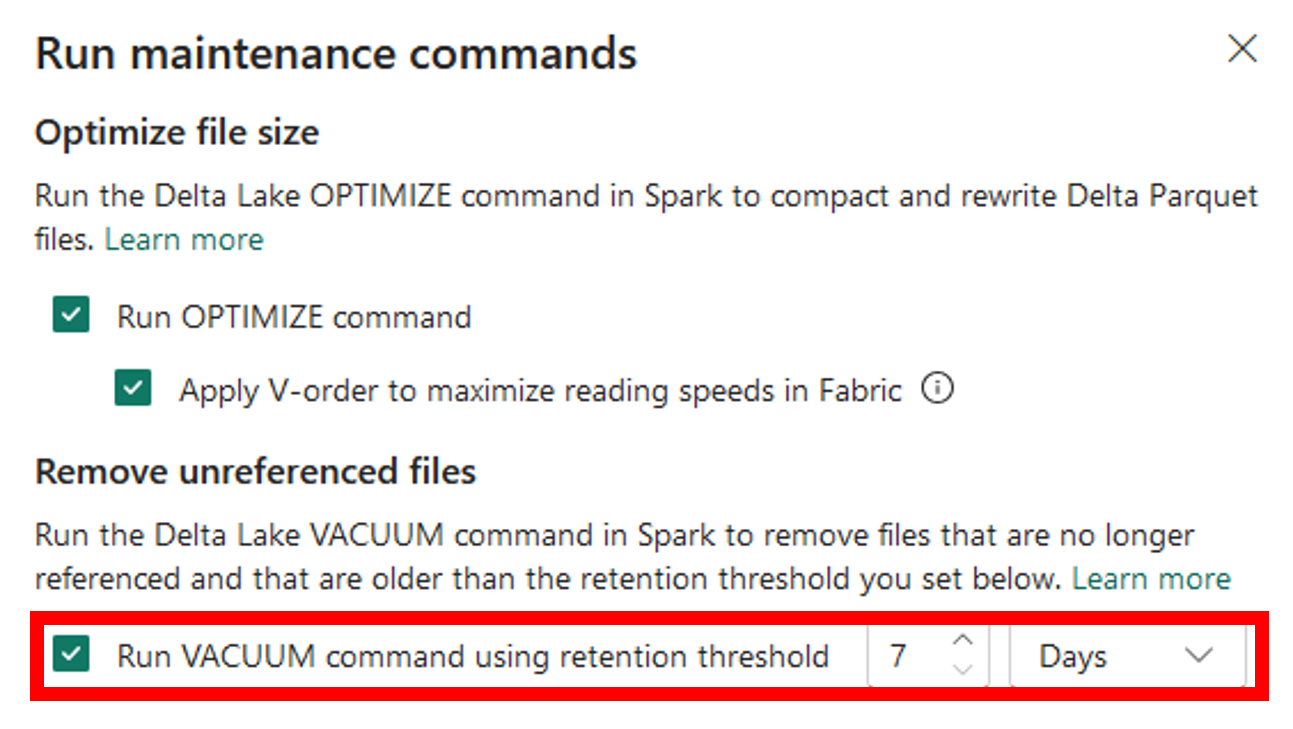

Menjalankan Vacuum dari penjelajah Lakehouse

Ayo berlatih!

Transformasi dan Analisis Data dengan Microsoft Fabric