Melatih model NMT

Penerjemahan Mesin dengan Keras

Thushan Ganegedara

Data Scientist and Author

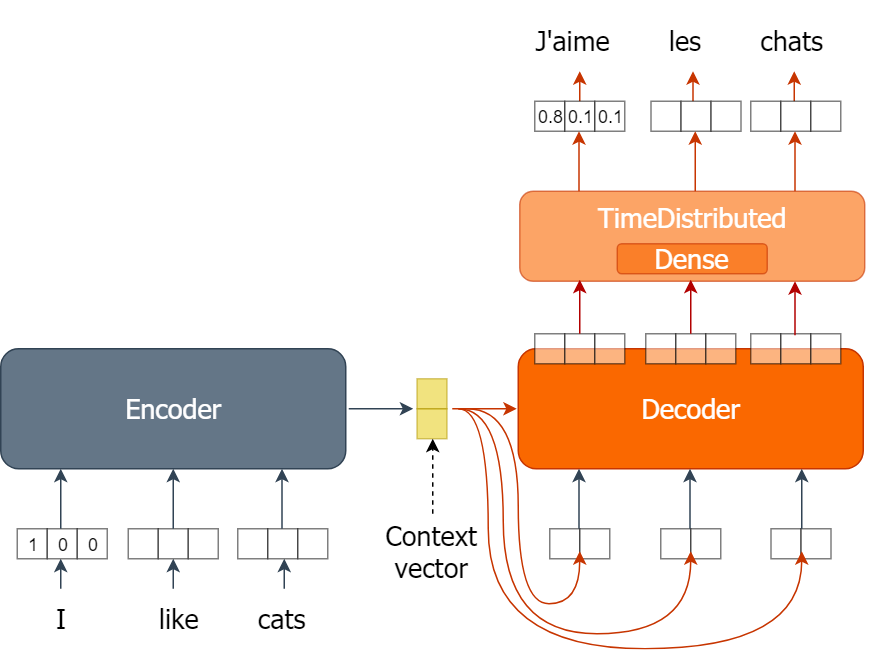

Meninjau ulang model

- GRU Encoder

- Memproses kata bahasa Inggris

- Menghasilkan vektor konteks

- GRU Decoder

- Menggunakan vektor konteks

- Menghasilkan urutan keluaran GRU

- Lapisan Prediksi Decoder

- Menggunakan urutan keluaran GRU

- Menghasilkan probabilitas prediksi untuk kata bahasa Prancis

Mengoptimalkan parameter

- Lapisan GRU dan Dense memiliki parameter

- Sering ditulis

W(bobot) danb(bias) (diinisialisasi acak) - Mengubah input menjadi output yang berguna

- Diubah untuk meminimalkan loss menggunakan optimizer

- Loss: Selisih antara:

- Prediksi (mis. kata bahasa Prancis dari model)

- Label asli (mis. kata bahasa Prancis sebenarnya).

- Loss: Selisih antara:

- Ditetapkan saat kompilasi model

nmt.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['acc'])

Melatih model

- Iterasi pelatihan

for ei in range(n_epochs): # Satu kali menelusuri dataset for i in range(0,data_size,bsize): # Memproses satu batch - Mengambil satu batch data latih

en_x = sents2seqs('source', en_text[i:i+bsize], onehot=True, reverse=True) de_y = sents2seqs('target', en_text[i:i+bsize], onehot=True) - Melatih pada satu batch

nmt.train_on_batch(en_x, de_y) - Mengevaluasi model

res = nmt.evaluate(en_x, de_y, batch_size=bsize, verbose=0)

Melatih model

- Mendapatkan training loss dan akurasi

res = nmt.evaluate(en_x, de_y, batch_size=bsize, verbose=0) print("Epoch {} => Train Loss:{}, Train Acc: {}".format( ei+1,res[0], res[1]*100.0))

Epoch 1 => Train Loss:4.8036723136901855, Train Acc: 5.215999856591225

...

Epoch 1 => Train Loss:4.718592643737793, Train Acc: 47.0880001783371

...

Epoch 5 => Train Loss:2.8161656856536865, Train Acc: 56.40000104904175

Epoch 5 => Train Loss:2.527724266052246, Train Acc: 54.368001222610474

Epoch 5 => Train Loss:2.2689621448516846, Train Acc: 54.57599759101868

Epoch 5 => Train Loss:1.9934935569763184, Train Acc: 56.51199817657471

Epoch 5 => Train Loss:1.7581449747085571, Train Acc: 55.184000730514526

Epoch 5 => Train Loss:1.5613118410110474, Train Acc: 55.11999726295471

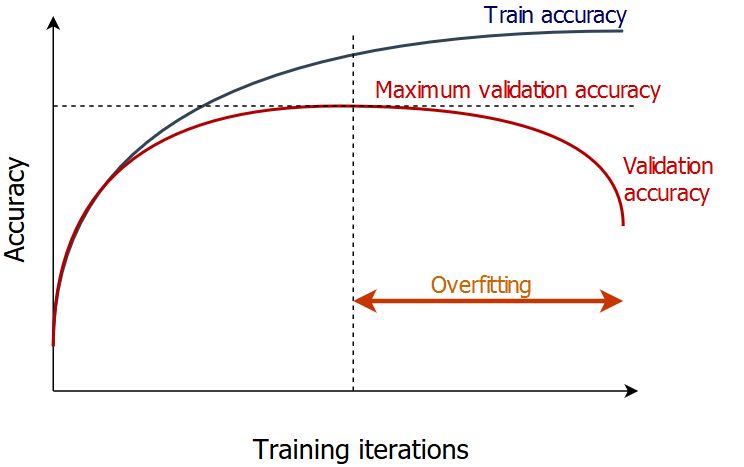

Menghindari overfitting

- Bagi dataset menjadi dua bagian

- Training set - untuk melatih model

- Validation set - untuk memantau akurasi model

- Hentikan pelatihan saat akurasi validasi tidak lagi meningkat.

Membagi dataset

Tentukan ukuran train dan valid

train_size, valid_size = 800, 200Acak indeks data secara acak

inds = np.arange(len(en_text)) np.random.shuffle(inds)Ambil indeks train dan valid

train_inds = inds[:train_size] valid_inds = inds[train_size:train_size+valid_size]

Membagi dataset

- Bagi dataset dengan memisahkan:

- Data berindeks train ke train set

- Data berindeks valid ke valid set

tr_en = [en_text[ti] for ti in train_inds]

tr_fr = [fr_text[ti] for ti in train_inds]

v_en = [en_text[ti] for ti in valid_inds]

v_fr = [fr_text[ti] for ti in valid_inds]

Melatih model dengan validasi

n_epochs, bsize = 5, 250 for ei in range(n_epochs):for i in range(0,train_size,bsize): en_x = sents2seqs('source', tr_en[i:i+bsize], onehot=True, pad_type='pre') de_y = sents2seqs('target', tr_fr[i:i+bsize], onehot=True) nmt.train_on_batch(en_x, de_y)v_en_x = sents2seqs('source', v_en, onehot=True, pad_type='pre') v_de_y = sents2seqs('target', v_fr, onehot=True)res = nmt.evaluate(v_en_x, v_de_y, batch_size=valid_size, verbose=0) print("Epoch: {} => Loss:{}, Val Acc: {}".format(ei+1,res[0], res[1]*100.0))

Epoch 1 => Train Loss:4.8036723136901855, Train Acc: 5.215999856591225

Ayo berlatih!

Penerjemahan Mesin dengan Keras