Informasi dan pentingnya fitur

Reduksi Dimensi di R

Matt Pickard

Owner, Pickard Predictives, LLC

1 Provost, Foster; Fawcett, Tom (2013-07-27). Data Science for Business: What you need to know about data mining and data-analytic thinking. O'Reilly Media. Kindle Edition.

Pentingnya fitur

Pentingnya fitur: ukuran informasi dalam pemodelan

Banyak cara mengukur pentingnya fitur

- Korelasi (dengan variabel target)

- Koefisien regresi terseragamkan

- Information gain

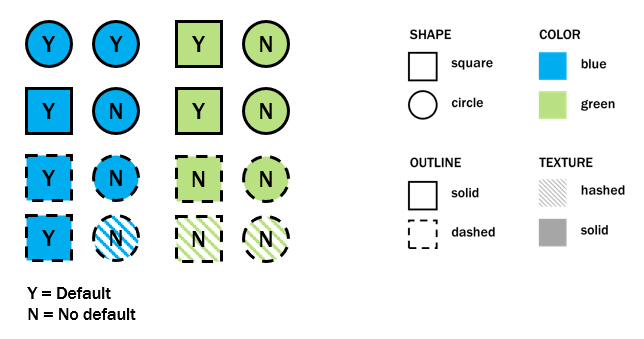

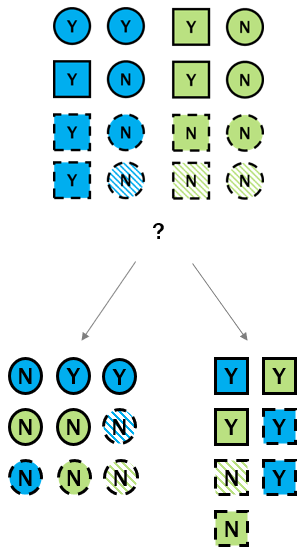

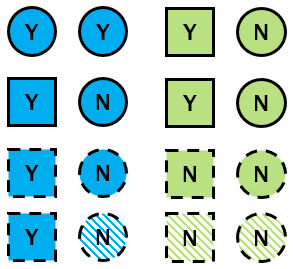

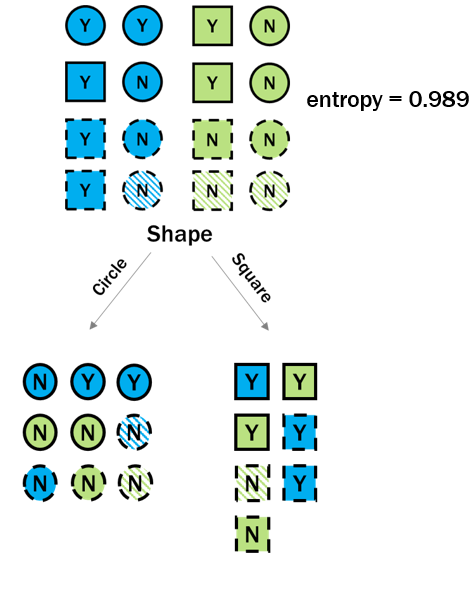

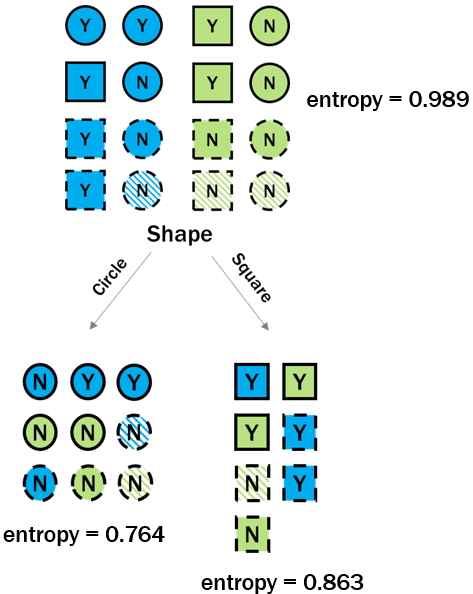

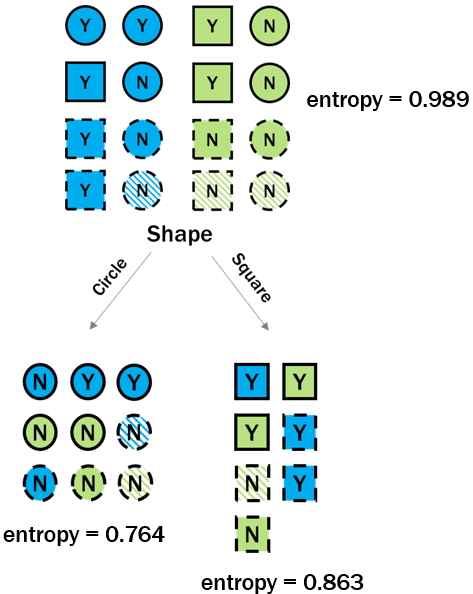

Contoh pohon keputusan

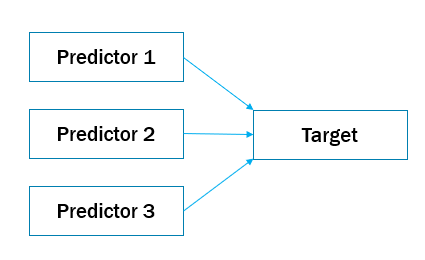

Pohon keputusan dan information gain

Information gain: seberapa banyak informasi tentang satu variabel yang kita ketahui dari mengamati variabel lain

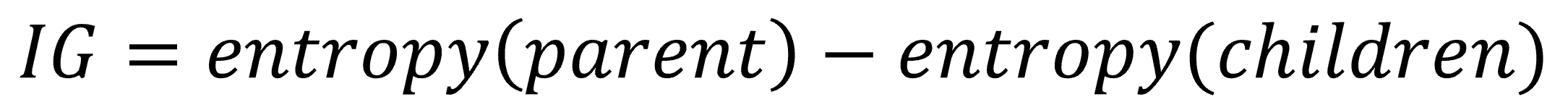

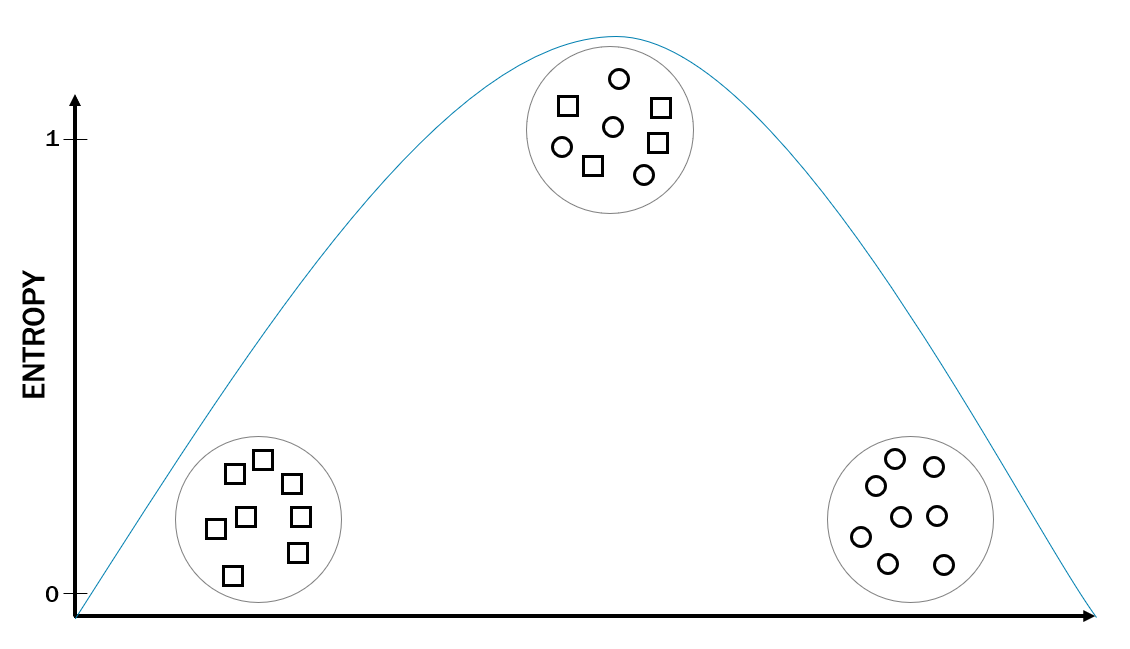

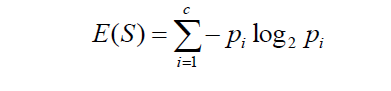

Entropi

- Ukuran ketidakaturan

- Semakin tinggi kemurnian, semakin rendah entropi

- Nilai entropi 0 (murni sempurna) hingga 1 (entropi sempurna)

Entropi: node akar

p_yes <- 7/16p_no <- 9/16entropy_root <- -(p_yes * log2(p_yes)) + -(p_no * log2(p_no))entropy_root

0.989

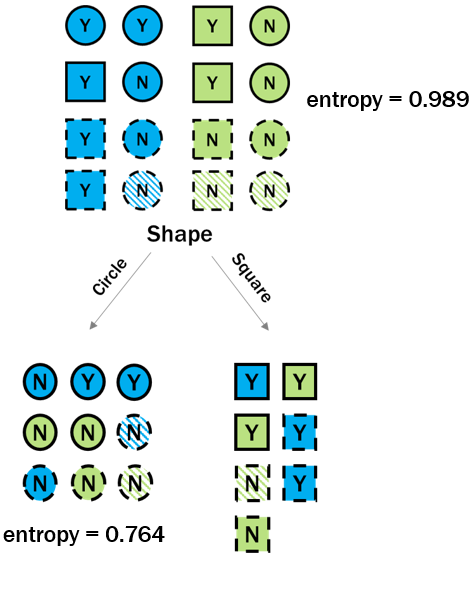

Entropi: node anak

p_left_yes <- 2/9p_left_no <- 7/9entropy_left <- -(p_left_yes * log2(p_left_yes)) + -(p_left_no * log2(p_left_no))

Entropi: node anak

p_left_yes <- 2/9p_left_no <- 7/9entropy_left <- -(p_left_yes * log2(p_left_yes)) + -(p_left_no * log2(p_left_no))entropy_left

0.764

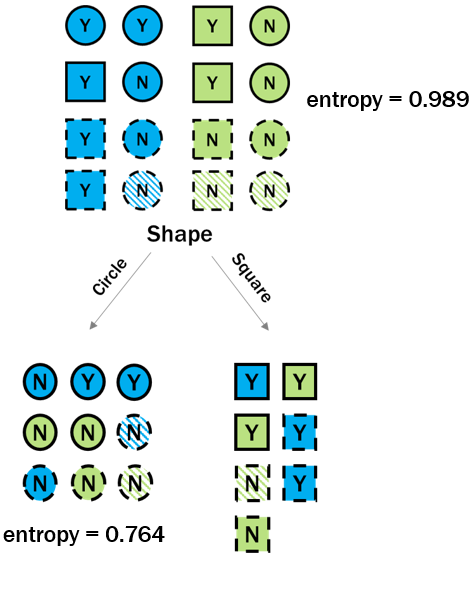

Entropi: node anak

p_right_yes <- 5/7p_right_no <- 2/7entropy_right <- -(p_right_yes * log2(p_right_yes)) + -(p_right_no * log2(p_right_no))

Entropi: node anak

p_right_yes <- 5/7p_right_no <- 2/7entropy_right <- -(p_right_yes * log2(p_right_yes)) + -(p_right_no * log2(p_right_no))entropy_right

0.863

Information gain: akar ke anak

p_left <- 9/16p_right <- 7/16info_gain <- entropy_root - (p_left * entropy_left + p_right * entropy_right)info_gain

0.181

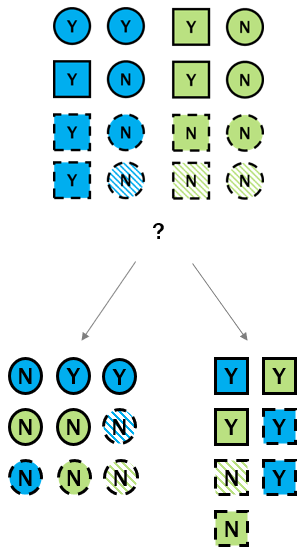

Bandingkan information gain antar fitur

| Fitur | Information Gain |

|---|---|

| shape | 0.181 |

| texture | 0.180 |

| outline | 0.106 |

| color | 0.106 |

Ayo berlatih!

Reduksi Dimensi di R