Ottimizzazione degli iperparametri

Vincere una competizione Kaggle con Python

Yauhen Babakhin

Kaggle Grandmaster

Iterazioni

| Modello | RMSE validazione | RMSE LB pubblico | Posizione LB pubblico |

|---|---|---|---|

| Media semplice | 9.986 | 9.409 | 1449 / 1500 |

| Media per gruppo | 9.978 | 9.407 | 1411 / 1500 |

| Gradient Boosting | 5.996 | 4.595 | 1109 / 1500 |

| Aggiungi feature ora | 5.553 | 4.352 | 1068 / 1500 |

| Aggiungi feature distanza | 5.268 | 4.103 | 1006 / 1500 |

| ... | ... | ... | ... |

Iterazioni

| Modello | RMSE validazione | RMSE LB pubblico | Posizione LB pubblico |

|---|---|---|---|

| Media semplice | 9.986 | 9.409 | 1449 / 1500 |

| Media per gruppo | 9.978 | ||

| Gradient Boosting | 5.996 | 4.595 | 1109 / 1500 |

| Aggiungi feature ora | 5.553 | ||

| Aggiungi feature distanza | 5.268 | 4.103 | 1006 / 1500 |

| ... | ... | ... | ... |

Ottimizzazione degli iperparametri

| Tipo di competizione | Feature engineering | Ottimizzazione iperparametri |

|---|---|---|

| Machine Learning classico | +++ | + |

| Deep Learning | - | +++ |

Ridge regression

Regressione lineare ai minimi quadrati

$$Loss = \sum_{i=1}^{N}{(y_i - \hat{y}_i)^2} \to \min$$

Regressione Ridge

Regressione lineare ai minimi quadrati

$$Loss = \sum_{i=1}^{N}{(y_i - \hat{y}_i)^2} \to \min$$

Regressione Ridge

$$Loss = \sum_{i=1}^{N}{(y_i - \hat{y}_i)^2 + \alpha\sum_{j=1}^{K}{{w_j}^2}} \to \min$$

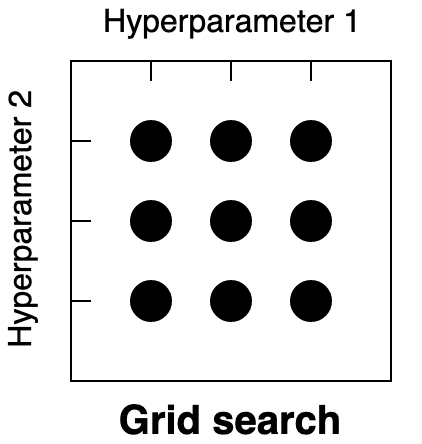

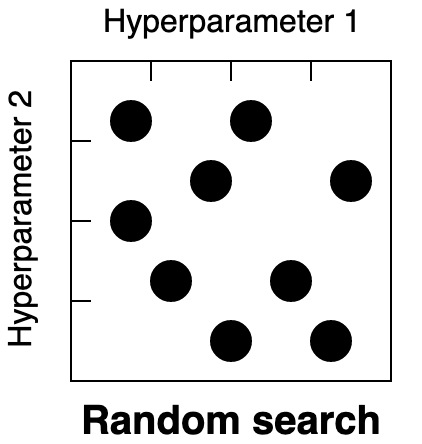

Strategie di ottimizzazione degli iperparametri

- Grid search. Scegli una griglia predefinita di valori degli iperparametri

- Random search. Definisci lo spazio di ricerca dei valori degli iperparametri

- Ottimizzazione bayesiana. Definisci lo spazio di ricerca dei valori degli iperparametri

Grid search

# Possible alpha values alpha_grid = [0.01, 0.1, 1, 10]from sklearn.linear_model import Ridge results = {} # For each value in the grid for candidate_alpha in alpha_grid:# Create a model with a specific alpha value ridge_regression = Ridge(alpha=candidate_alpha)# Find the validation score for this model# Save the results for each alpha value results[candidate_alpha] = validation_score

Ayo berlatih!

Vincere una competizione Kaggle con Python