Gradient boosting

Metodi Ensemble in Python

Román de las Heras

Data Scientist, Appodeal

Introduzione al gradient boosting machine

- Modello iniziale (stimatore debole): $y\sim f_1(X)$

- Nuovo modello sui residui: $y-f_1(X)\sim f_2(X)$

- Nuovo modello additivo: $y\sim f_1(X)+f_2(X)$

- Ripeti $n$ volte o finché l’errore è abbastanza piccolo

- Modello finale additivo: $$y\sim f_1(X)+f_2(X)+ ... +f_n(x)=\sum_{i=1}^{n} f_i(X)$$

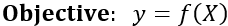

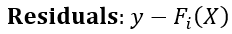

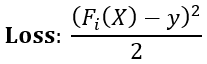

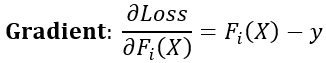

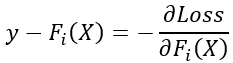

Equivalenza con la discesa del gradiente

Discesa del gradiente:

Residui = gradiente negativo

Classifier gradient boosting

Gradient Boosting Classifier

from sklearn.ensemble import GradientBoostingClassifier

clf_gbm = GradientBoostingClassifier(

n_estimators=100,

learning_rate=0.1,

max_depth=3,

min_samples_split,

min_samples_leaf,

max_features

)

n_estimators- Predefinito: 100

learning_rate- Predefinito: 0.1

max_depth- Predefinito: 3

min_samples_splitmin_samples_leafmax_features

Regressor gradient boosting

Gradient Boosting Regressor

from sklearn.ensemble import GradientBoostingRegressor

reg_gbm = GradientBoostingRegressor(

n_estimators=100,

learning_rate=0.1,

max_depth=3,

min_samples_split,

min_samples_leaf,

max_features

)

È ora di fare boosting!

Metodi Ensemble in Python