Informazione e importanza delle feature

Riduzione della dimensionalità in R

Matt Pickard

Owner, Pickard Predictives, LLC

1 Provost, Foster; Fawcett, Tom (2013-07-27). Data Science for Business: What you need to know about data mining and data-analytic thinking. O'Reilly Media. Kindle Edition.

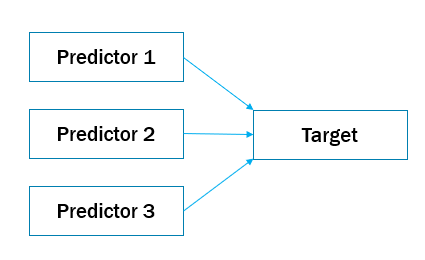

Importanza delle feature

Importanza delle feature: misura dell'informazione nella costruzione del modello

Modi per misurare l'importanza

- Correlazione (con la variabile target)

- Coefficienti di regressione standardizzati

- Guadagno d'informazione

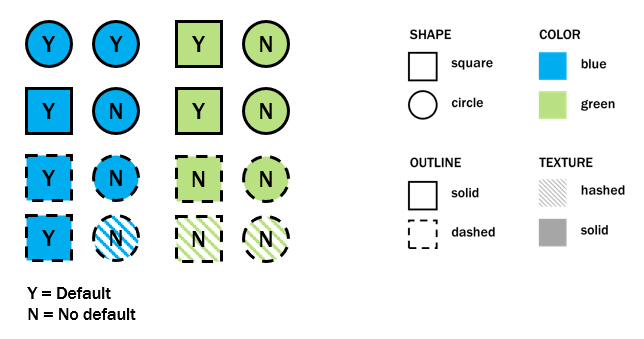

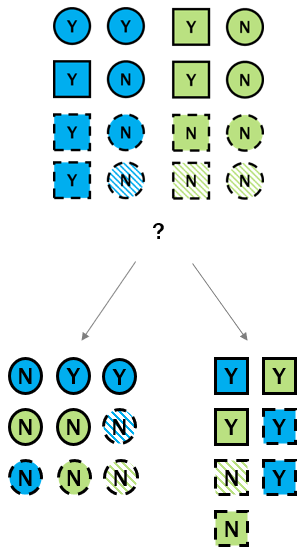

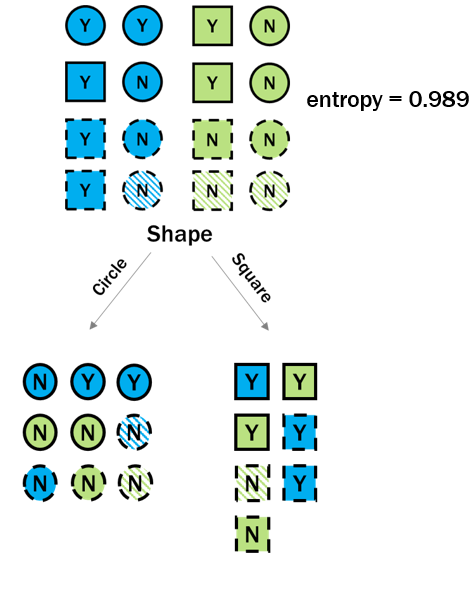

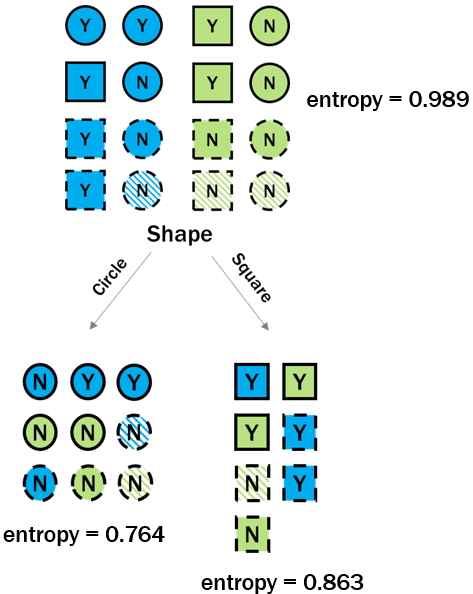

Esempio di albero decisionale

Alberi decisionali e guadagno d'informazione

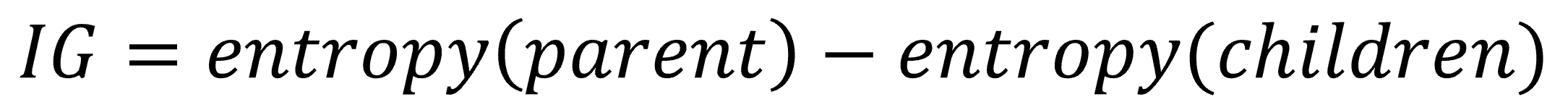

Guadagno d'informazione: quanta informazione otteniamo su una variabile osservandone un'altra

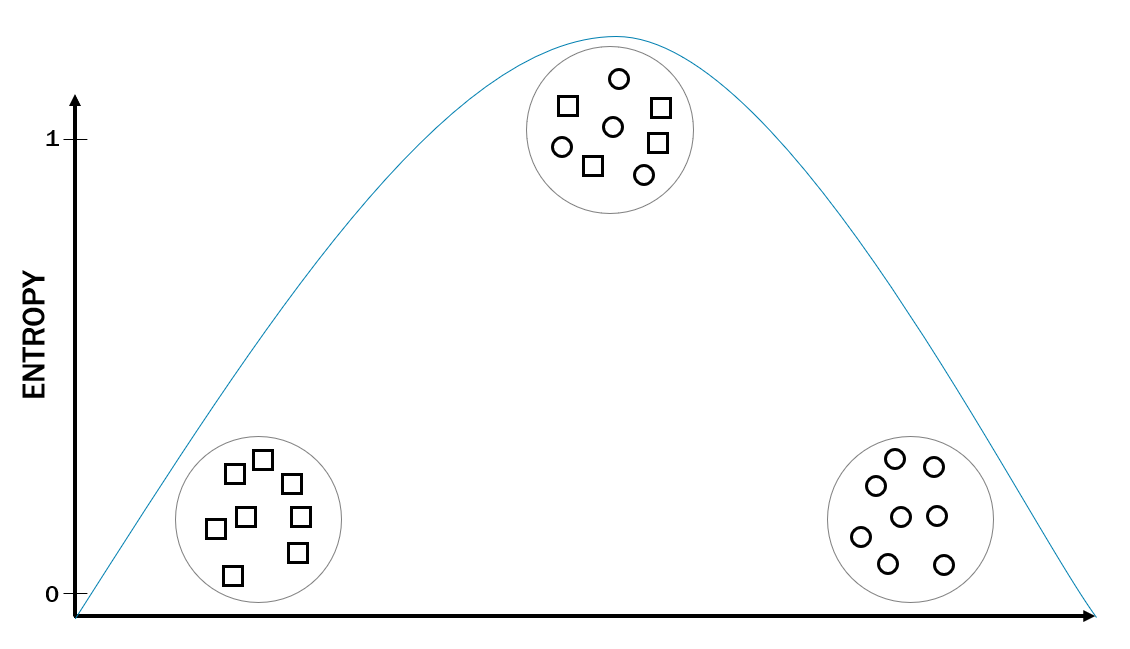

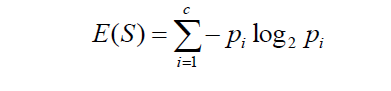

Entropia

- Misura del disordine

- Più purezza, meno entropia

- Entropia da 0 (pura) a 1 (massima)

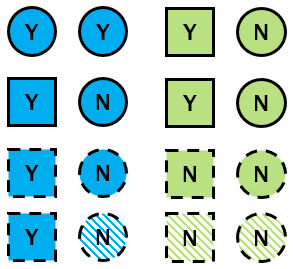

Entropia: nodo radice

p_yes <- 7/16p_no <- 9/16entropy_root <- -(p_yes * log2(p_yes)) + -(p_no * log2(p_no))entropy_root

0.989

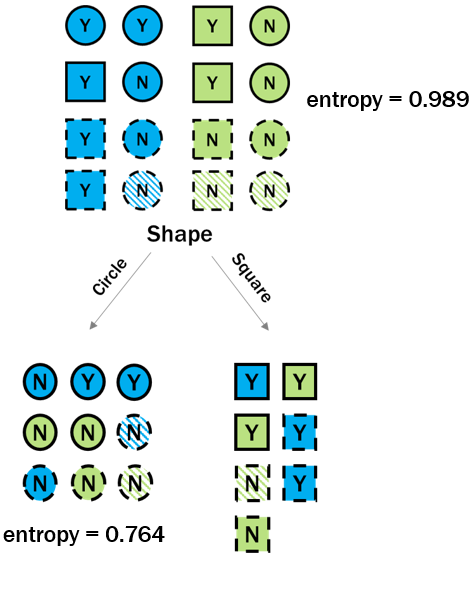

Entropia: nodi figli

p_left_yes <- 2/9p_left_no <- 7/9entropy_left <- -(p_left_yes * log2(p_left_yes)) + -(p_left_no * log2(p_left_no))

Entropia: nodi figli

p_left_yes <- 2/9p_left_no <- 7/9entropy_left <- -(p_left_yes * log2(p_left_yes)) + -(p_left_no * log2(p_left_no))entropy_left

0.764

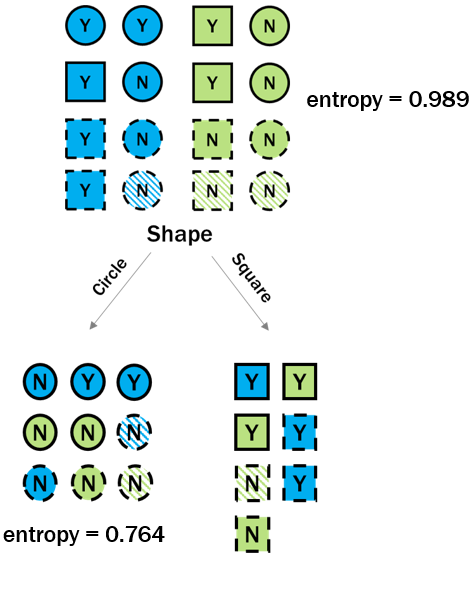

Entropia: nodi figli

p_right_yes <- 5/7p_right_no <- 2/7entropy_right <- -(p_right_yes * log2(p_right_yes)) + -(p_right_no * log2(p_right_no))

Entropia: nodi figli

p_right_yes <- 5/7p_right_no <- 2/7entropy_right <- -(p_right_yes * log2(p_right_yes)) + -(p_right_no * log2(p_right_no))entropy_right

0.863

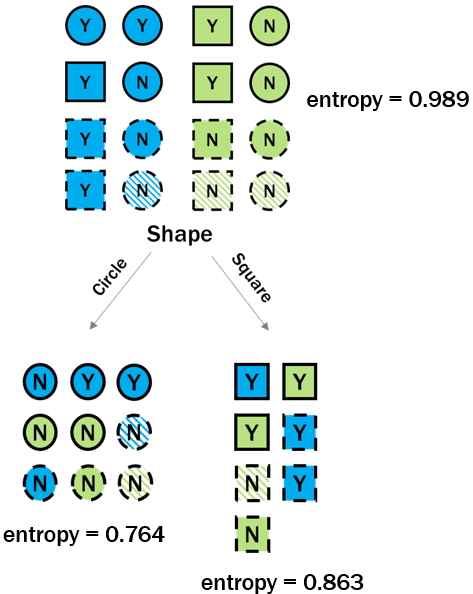

Guadagno d'informazione: dalla radice ai figli

p_left <- 9/16p_right <- 7/16info_gain <- entropy_root - (p_left * entropy_left + p_right * entropy_right)info_gain

0.181

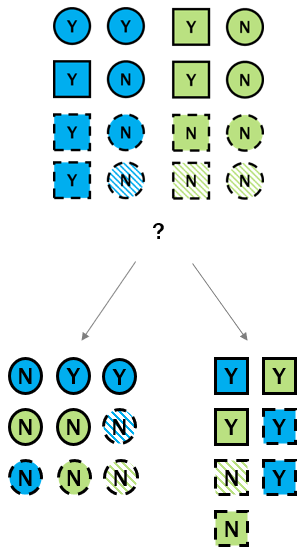

Confronta il guadagno tra feature

| Feature | Information Gain |

|---|---|

| shape | 0.181 |

| texture | 0.180 |

| outline | 0.106 |

| color | 0.106 |

Passiamo alla pratica !

Riduzione della dimensionalità in R