Classificazione di immagini zero-shot

Modelli multi-modali con Hugging Face

James Chapman

Curriculum Manager, DataCamp

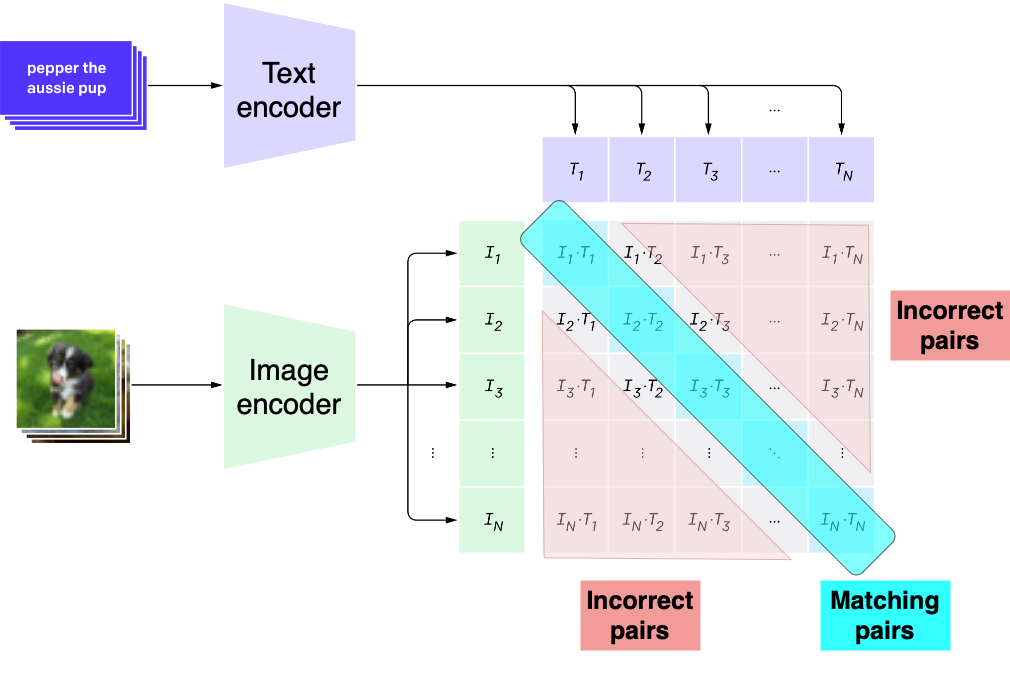

CLIP

- Contrastive Language-Image Pre-training

- Valuta la somiglianza tra immagini e testo

- Addestrato su 400M di coppie immagine-testo

- Due encoder:

- Encoder visivo

- Encoder testuale

- Coppie immagine-testo simili producono vettori simili

1 https://openai.com/index/clip/

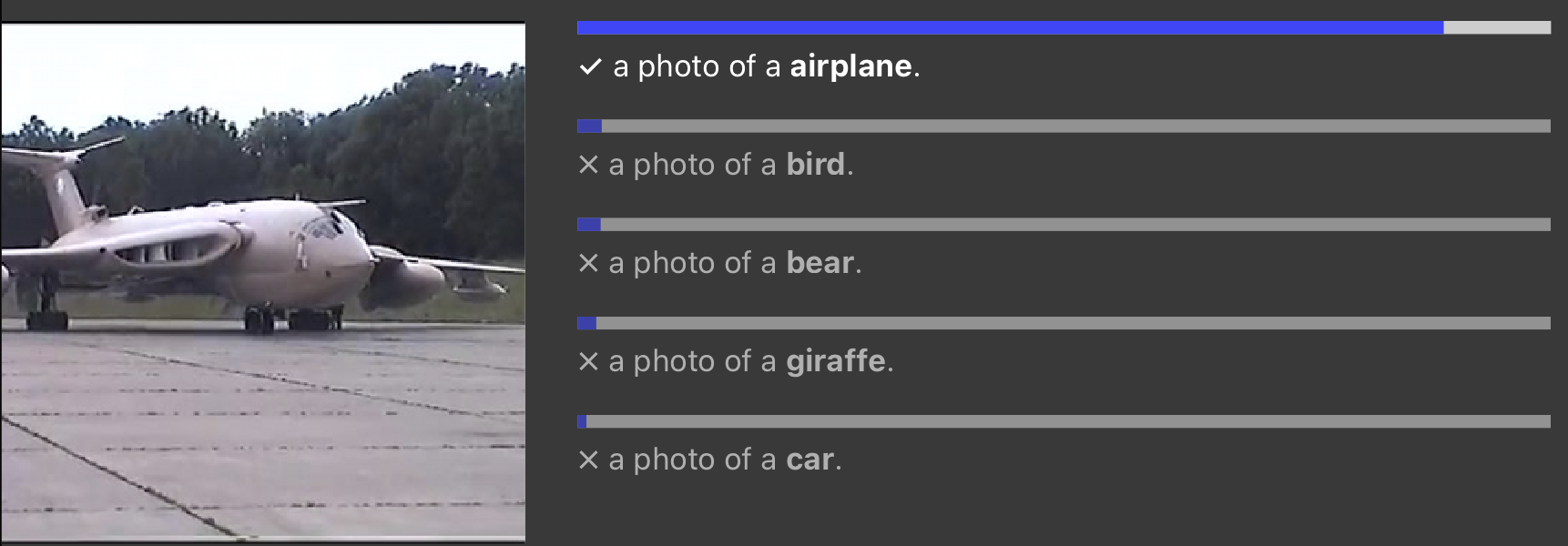

Zero-shot learning

- Svolge compiti per cui il modello non è stato addestrato

1 https://openai.com/index/clip/

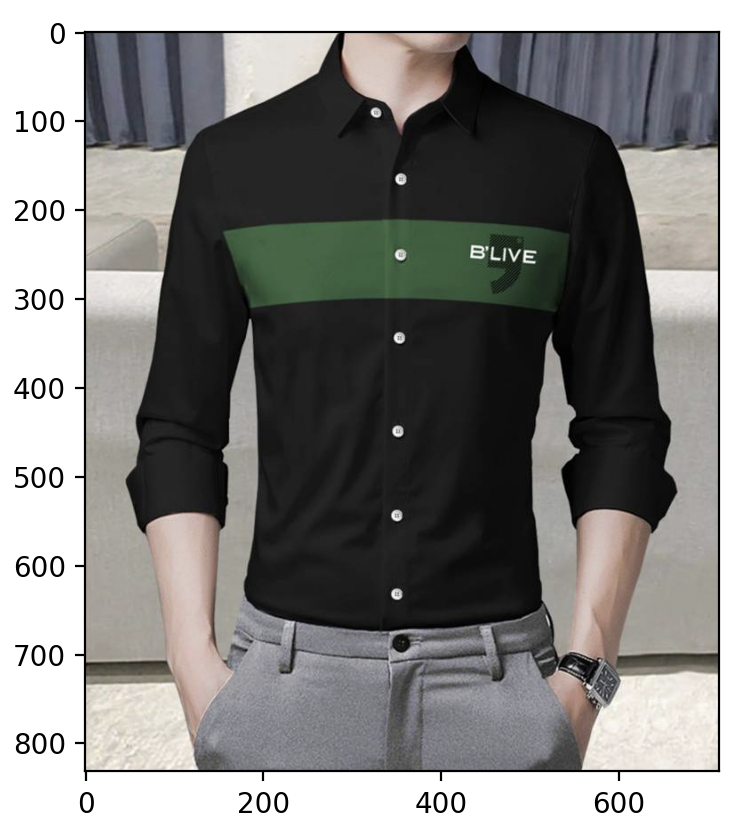

Caso d'uso: categorizzazione prodotti

from datasets import load_dataset import matplotlib.pyplot as plt dset = "rajuptvs/ecommerce_products_clip" dataset = load_dataset(dset)print(dataset["train"][0]["Description"])plt.imshow(dataset["train"][0]["image"]) plt.show()

Blive High quality premium Full sleeves printed

Shirt direct from the manufacturers.Gives you

a clean and classy look while also

making you feel comfortable.Trusted

brand online and no compromise on quality.

Zero-shot learning con CLIP

model = CLIPModel.from_pretrained("openai/clip-vit-base-patch32") processor = CLIPProcessor.from_pretrained("openai/clip-vit-base-patch32")categories = ["shirt", "trousers", "shoes", "dress", "hat", "bag", "watch"]inputs = processor(text=categories, images=dataset["train"][0]["image"], return_tensors="pt", padding=True) outputs = model(**inputs)probs = outputs.logits_per_image.softmax(dim=1)categories[probs.argmax().item()]

shirt

Il punteggio CLIP

- Somiglianza tra immagine codificata e descrizione codificata

- Va da

100(accordo perfetto) a0(nessun accordo)

from torchmetrics.functional.multimodal import clip_scoreimage = dataset["train"][0]["image"] description = dataset["train"][0]["Description"]from torchvision.transforms import ToTensor image = ToTensor()(image)*255score = clip_score(image, description, "openai/clip-vit-base-patch32")print(f"CLIP score: {score}")

CLIP score: 28.495952606201172

Passons à la pratique !

Modelli multi-modali con Hugging Face