Preprocessare diverse modalità

Modelli multi-modali con Hugging Face

James Chapman

Curriculum Manager, DataCamp

Preprocessare testo

- Tokenizer: mappa testo → input del modello

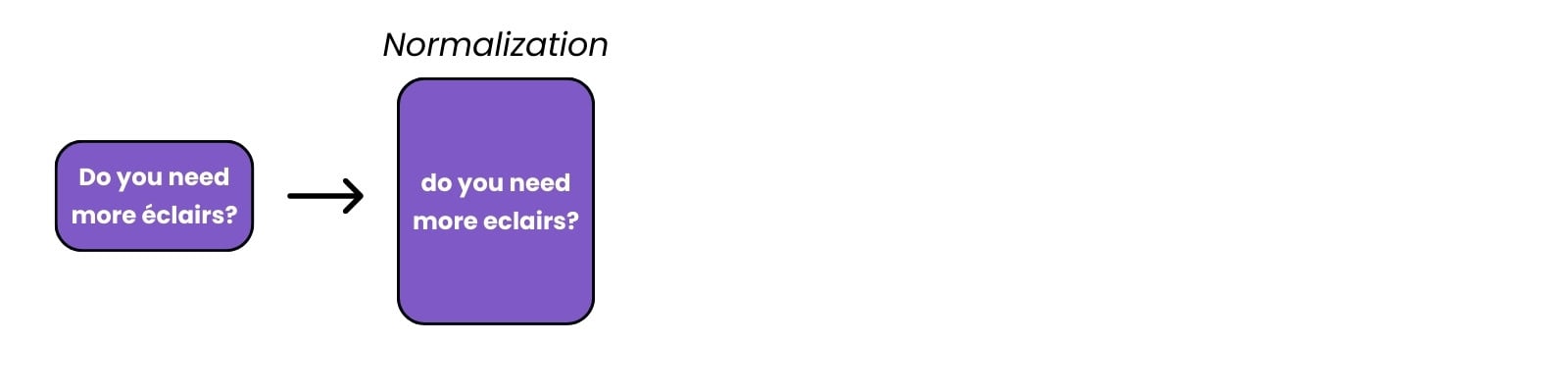

Preprocessare testo

- Tokenizer: mappa testo → input del modello

- Normalizzazione: minuscole, rimozione caratteri speciali, rimozione spazi extra

Preprocessare testo

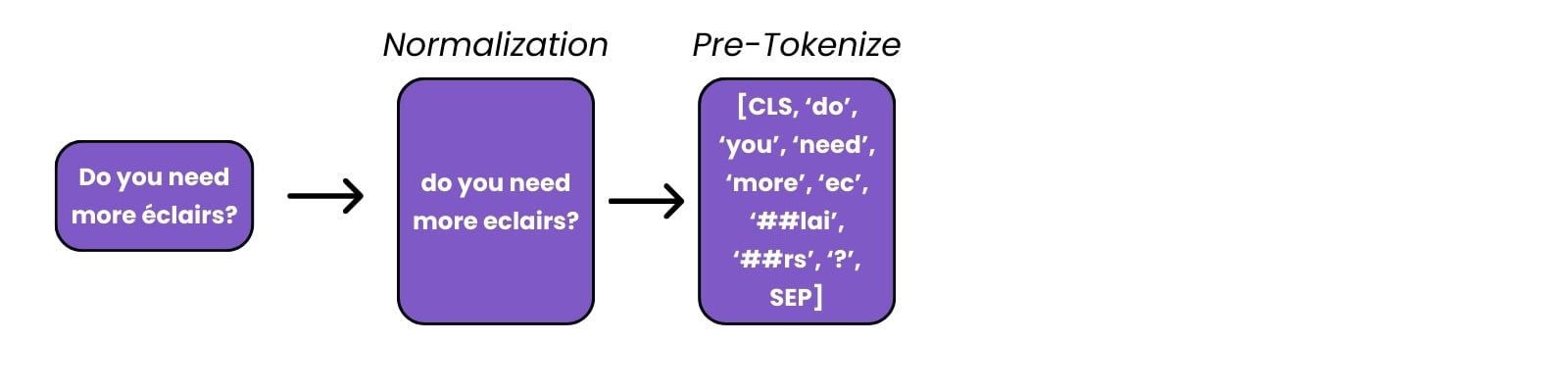

- Tokenizer: mappa testo → input del modello

- Normalizzazione: minuscole, rimozione caratteri speciali, rimozione spazi extra

- (Pre-)tokenizzazione: divisione in parole/sottoparole

Preprocessare testo

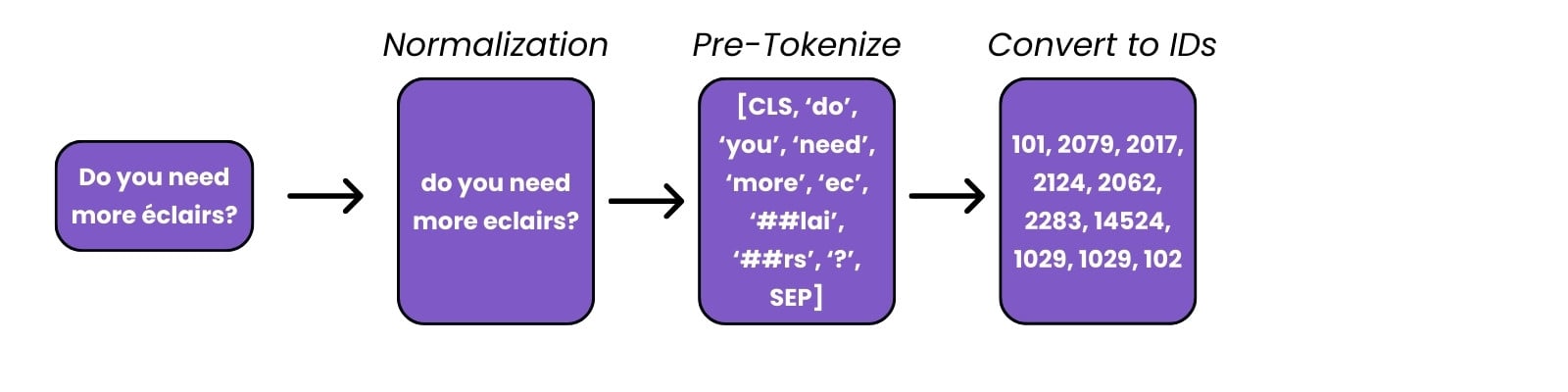

- Tokenizer: mappa testo → input del modello

- Normalizzazione: minuscole, rimozione caratteri speciali, spazi

- (Pre-)tokenizzazione: divisione in parole/sottoparole

- Conversione ID: mappa token a interi usando un vocabolario

Preprocessare testo

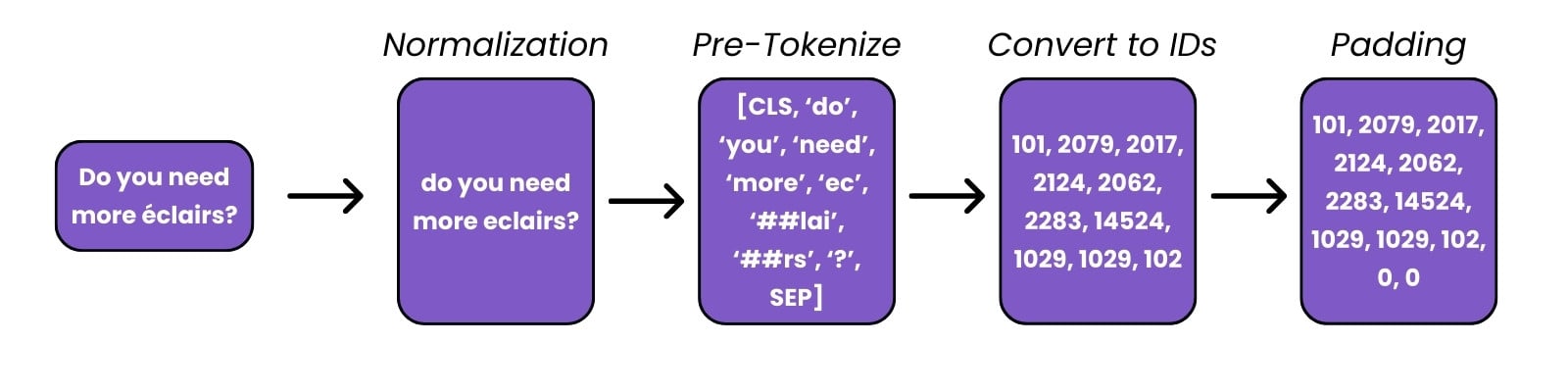

- Tokenizer: mappa testo → input del modello

- Normalizzazione: minuscole, rimozione caratteri speciali, spazi

- (Pre-)tokenizzazione: divisione in parole/sottoparole

- Conversione ID: mappa token a interi usando un vocabolario

- Padding: aggiunge token per lunghezza uniforme

Preprocessare testo

from transformers import AutoTokenizer tokenizer = AutoTokenizer.from_pretrained('distilbert/distilbert-base-uncased')text = "Do you need more éclairs?"print(tokenizer.backend_tokenizer.normalizer.normalize_str(text))

do you need more eclairs

tokenizer(text, return_tensors='pt', padding=True)

{'input_ids': tensor([[ 101, ..., 102]]), ...}

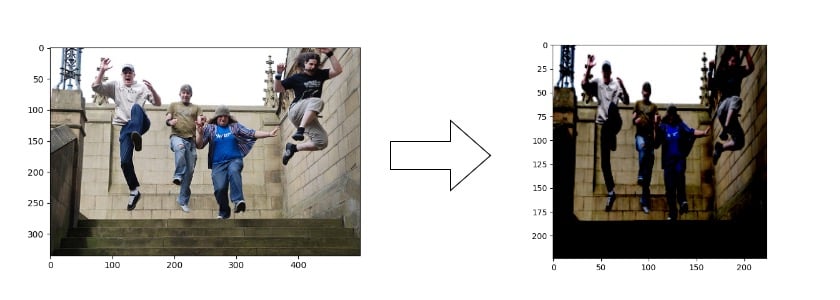

Preprocessare immagini

- Normalizzazione: aggiornamento intensità pixel

- Resize: adatta all’input del modello

- Regola generale → usa il preprocessing del modello originale

1 https://huggingface.co/datasets/nlphuji/flickr30k

Preprocessare immagini

I task multimodali richiedono preprocessamento coerente:

from transformers import BlipProcessor, BlipForConditionalGenerationcheckpoint = "Salesforce/blip-image-captioning-base"model = BlipForConditionalGeneration.from_pretrained(checkpoint) processor = BlipProcessor.from_pretrained(checkpoint)

Codifica immagine → trasforma in encoding testo → decodifica testo

image = load_dataset("nlphuji/flickr30k")['test'][11]["image"] inputs = processor(images=image, return_tensors="pt")output = model.generate(**inputs)print(processor.decode(output[0]))

[{'generated_text': 'a group of people jumping'}]

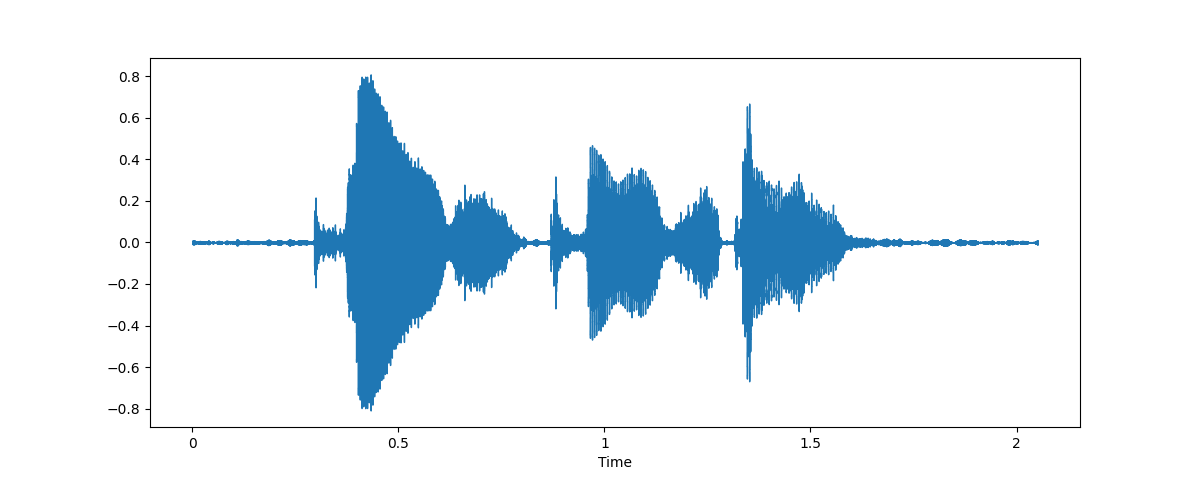

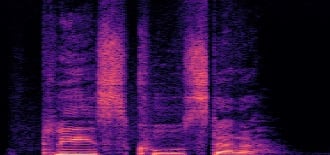

Preprocessare audio

- Preprocessamento audio:

- Array sequenziale → filtro/padding

- Frequenza di campionamento → ricampionamento

Estrazione di feature come input del modello (spettrogramma)

Preprocessare audio

from datasets import load_dataset, Audiodataset = load_dataset("CSTR-Edinburgh/vctk")["train"] dataset = dataset.cast_column("audio", Audio(sampling_rate=16_000))

- Preprocessori completi specifici del modello dovrebbero essere disponibili:

from transformers import AutoProcessor

processor = AutoProcessor.from_pretrained("openai/whisper-small")

audio_pp = processor(dataset[0]["audio"]["array"],

sampling_rate=16_000, return_tensors="pt")

- La frequenza di campionamento deve rispettare i requisiti del modello

1 https://huggingface.co/datasets/CSTR-Edinburgh/vctk

Passiamo alla pratica !

Modelli multi-modali con Hugging Face