Visual question-answering (VQA)

Modelli multi-modali con Hugging Face

James Chapman

Curriculum Manager, DataCamp

Attività di QA multimodale

- Codifica separata della domanda e dell'altra modalità

Attività di QA multimodale

- Codifica separata della domanda e dell'altra modalità

- Combinazione delle feature codificate

Attività di QA multimodale

- Codifica separata della domanda e dell'altra modalità

- Combinazione delle feature codificate

- Ulteriori layer del modello per predire i token della risposta

VQA

import requests from PIL import Image url = "https://www.worldanimalprotection .org/cdn-cgi/image/width=1920,format= auto/globalassets/images/elephants/1 033551-elephant.jpg"image = Image.open(requests.get(url, stream=True).raw)text = "What animal is in this photo?"

VQA

- Il modello conosce feature visive e testuali di molti oggetti

- Modelli riutilizzabili senza ulteriore fine-tuning

VQA

from transformers import ViltProcessor, ViltForQuestionAnsweringprocessor = ViltProcessor.from_pretrained("dandelin/vilt-b32-finetuned-vqa") model = ViltForQuestionAnswering.from_pretrained("dandelin/vilt-b32-finetuned-vqa")encoding = processor(image, text, return_tensors="pt")outputs = model(**encoding)idx = outputs.logits.argmax(-1).item()print("Predicted answer:", model.config.id2label[idx])

Predicted answer: elephant

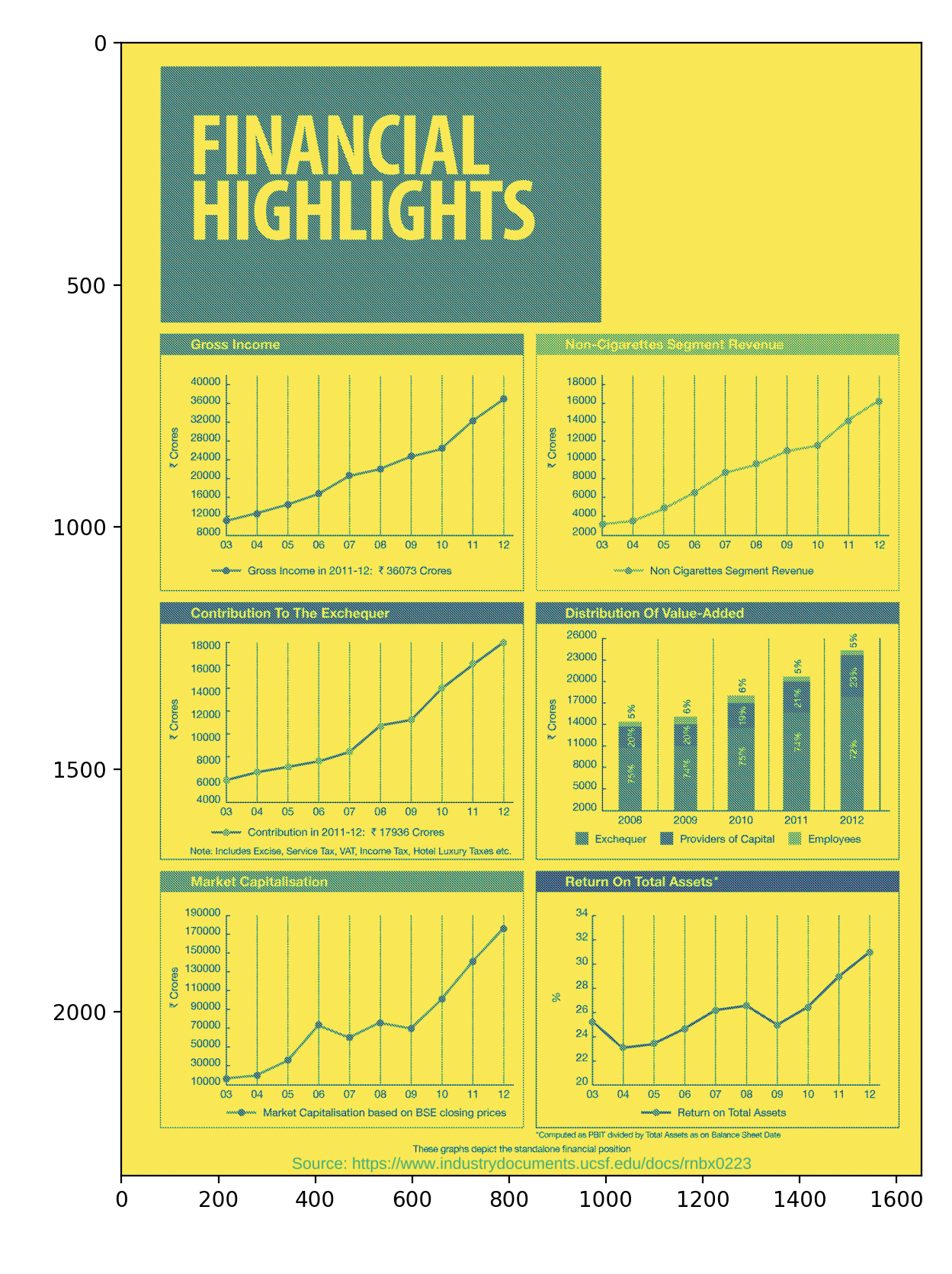

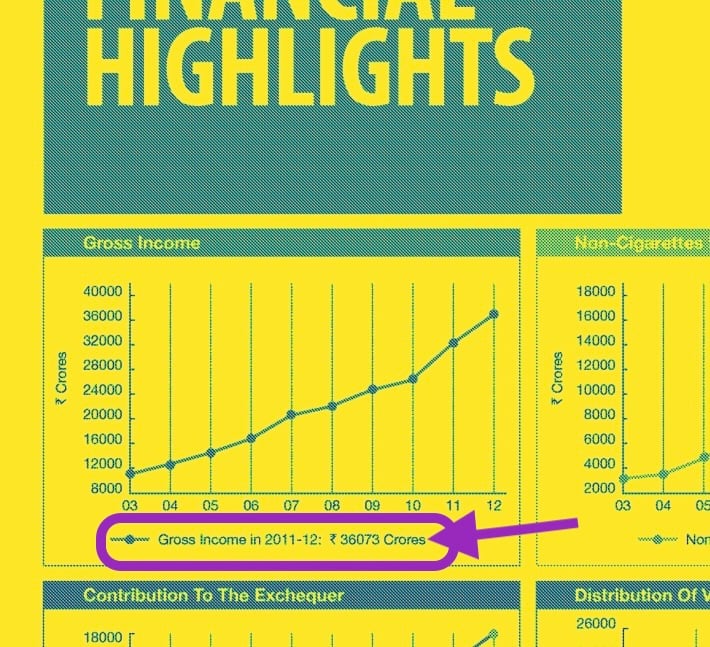

Document VQA

- Estensione del VQA per rilevare grafici, tabelle e testo (OCR) nelle immagini

from datasets import load_dataset from transformers import pipeline dataset = load_dataset("lmms-lab/DocVQA")import matplotlib.pyplot as plt plt.imshow(dataset["test"][2]["image"]) plt.show()

Document VQA

- Servono dipendenze extra per eseguire l'OCR

pytesseractsi installa conpip- Tesseract OCR via installer (es.

apt-get,exeohomebrew/macports)

Document VQA

- LayoutLM: addestrato con immagini e Q/A dal dataset DocVQA

from transformers import pipeline pipe = pipeline("document-question-answering", "impira/layoutlm-document-qa")result = pipe( dataset["test"][2]["image"], "What was the gross income in 2011-2012?" )

Document VQA

print(result)

[{'score': 0.05149758607149124,

'answer': '3 36073 Crores', ...}]

Passiamo alla pratica!

Modelli multi-modali con Hugging Face