テキスト分類モデルへの敵対的攻撃

PyTorch で学ぶテキストの Deep Learning

Shubham Jain

Instructor

敵対的攻撃とは

- 入力データの微調整

- ランダムではなく計算された悪意ある変更

- AIの判断に大きく影響し得る

堅牢性の重要性

- コメントを有害/無害と判定するAI

- 偏ったデータから負のステレオタイプを増幅してしまうAI

- 誤解を招く情報を出すAI

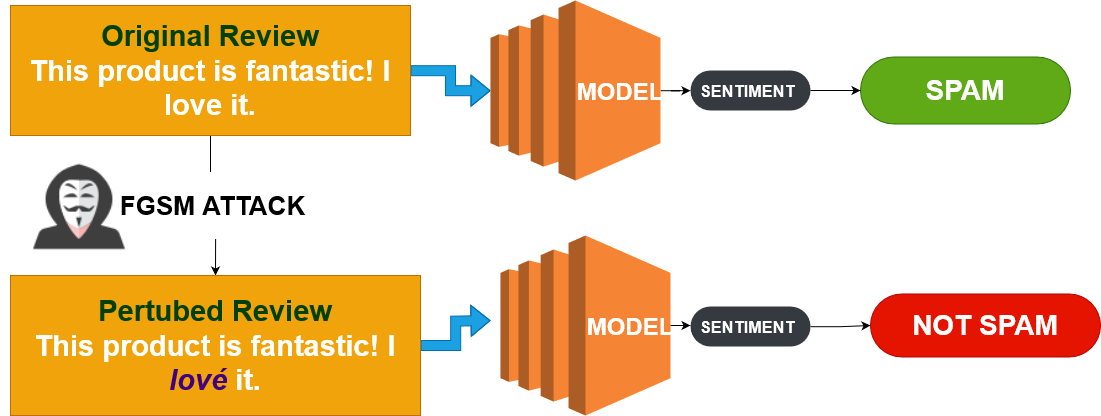

Fast Gradient Sign Method (FGSM)

- モデルの学習情報を突く

- 可能な限り最小の変更で欺く

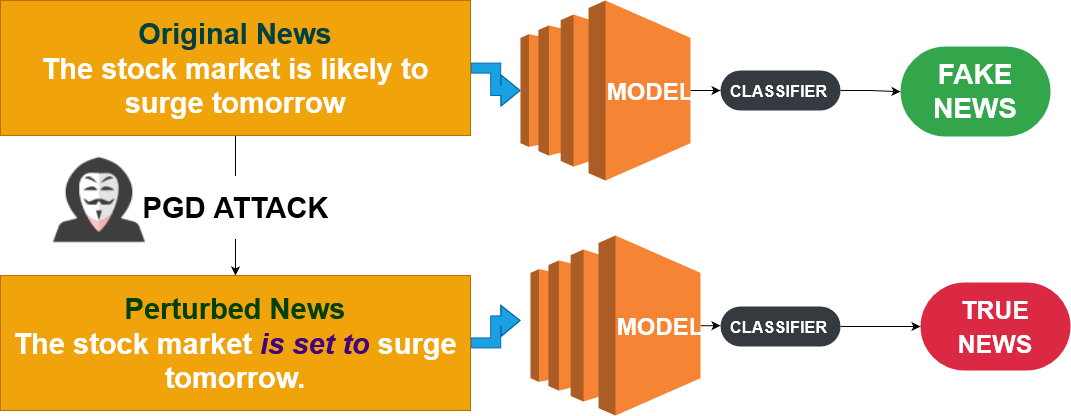

Projected Gradient Descent (PGD)

- FGSMより高機能:反復的

- 最も効果的な摂動を探索

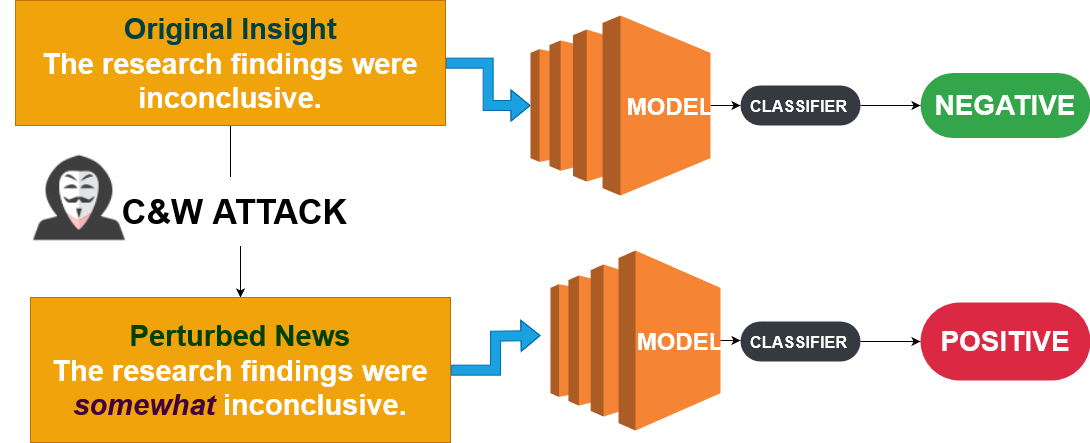

Carlini & Wagner (C&W) 攻撃

- 損失関数の最適化に注力

- だますだけでなく検出回避も重視

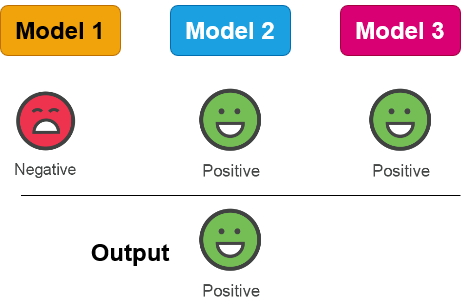

防御の構築:戦略

- アンサンブル学習:

- 複数モデルを併用

- 堅牢なデータ拡張:

- データ拡張

- 敵対的学習:

- 欺瞞を想定

防御の構築:ツールと手法

- PyTorch Robustness Toolbox:

- テキストモデルを強化

- 勾配マスキング:

- 学習データに多様性を加え、悪用可能なパターンを隠す

- 正則化手法:

- モデルのバランスを確保

1 https://adversarial-robustness-toolbox.readthedocs.io/en/latest/, https://stock.adobe.com/ie/contributor/209161356/designer-s-circle

Ayo berlatih!

PyTorch で学ぶテキストの Deep Learning